Halucynacja

Halucynacja w modelach językowych występuje, gdy AI generuje tekst, który wydaje się prawdopodobny, ale w rzeczywistości jest nieprawidłowy lub zmyślony. Dowied...

Czym są halucynacje w AI, dlaczego się pojawiają i jak ich unikać? Dowiedz się, jak utrzymać dokładność odpowiedzi chatbota AI dzięki praktycznym, skoncentrowanym na człowieku strategiom.

Chatboty AI są mądrzejsze niż kiedykolwiek, ale czasem wymyślają rzeczy z niczego. Te błędy, zwane „halucynacjami”, mogą zamienić pomocnego asystenta w źródło zamieszania, a nawet ryzyka. Jeśli zależy Ci na wiarygodnych odpowiedziach, musisz zrozumieć, czym są halucynacje, dlaczego się pojawiają i jak je powstrzymać, zanim narobią szkód.

Halucynacja w AI to sytuacja, gdy chatbot lub model językowy udziela odpowiedzi, która brzmi poprawnie, ale w rzeczywistości jest fałszywa, wymyślona lub wręcz niemożliwa. Te błędy to nie przypadkowe literówki, lecz pewne siebie, wiarygodnie brzmiące stwierdzenia, które nie mają podstaw w rzeczywistości.

Na przykład możesz zapytać chatbota: „Kto zdobył Nagrodę Nobla w dziedzinie fizyki w 2025 roku?” Jeśli model nie widział najnowszych informacji, może wymyślić nazwisko zamiast przyznać, że nie wie. W odróżnieniu od wyszukiwarki, która zwróci „brak wyników”, chatbot może wypełnić luki, czasem przekonującymi, ale nieprawdziwymi szczegółami.

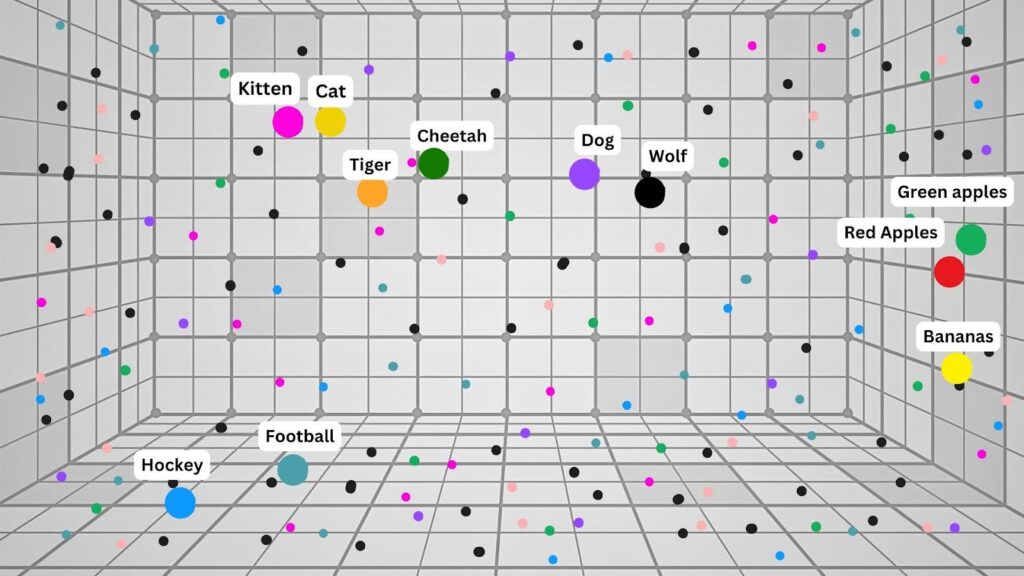

Halucynacje to nie błąd, lecz efekt uboczny sposobu działania dużych modeli językowych (LLM) takich jak ChatGPT, Copilot czy Gemini. Modele te:

Najczęstsze przyczyny halucynacji to:

Żadne AI nie jest doskonałe, ale są sprawdzone sposoby na ograniczenie halucynacji i poprawę jakości odpowiedzi. Oto co działa najlepiej:

Nowoczesne narzędzia AI mogą łączyć się z bazami danych, wyszukiwarkami czy firmowymi wiki. Przy zadaniach krytycznych zawsze dostarczaj AI sprawdzony kontekst lub wskaż wiarygodne źródła.

Nie bierz odpowiedzi za pewnik – poproś AI o podanie źródeł, linków lub przynajmniej wyjaśnienie, jak doszło do wniosku.

Przykładowe polecenie:

Korzystając wyłącznie z dostarczonego podręcznika firmowego i najnowszych wyników wyszukiwania w internecie, odpowiedz na to pytanie. Wymień źródła i wyjaśnij swoje rozumowanie.

To nie tylko pozwala zweryfikować odpowiedź, ale także uczy AI samokontroli.

Im bardziej precyzyjne pytanie, tym lepszy rezultat. Powiedz AI, z jakich informacji ma korzystać, czego unikać i w jakim formacie oczekujesz odpowiedzi. Przykład:

Podsumuj kluczowe wnioski z załączonego raportu rynkowego (edycja 2024). Jeśli informacje są nieobecne, napisz „nie znaleziono” zamiast zgadywać.

Wiele zaawansowanych chatbotów oferuje wtyczki do wyszukiwania w czasie rzeczywistym, generowanie wspomagane wyszukiwaniem (RAG) lub integrację z wiedzą firmową. Zawsze korzystaj z tych opcji, jeśli zależy Ci na aktualności lub dokładności faktów.

Niezależnie od zaawansowania chatbota, nadzór człowieka jest kluczowy. Przeglądaj ważne wyniki, zwłaszcza w wrażliwych obszarach jak zdrowie, finanse czy prawo.

„Człowiek w pętli” oznacza:

Chcesz dowiedzieć się więcej o strategiach „człowieka w pętli”? Wkrótce opublikujemy artykuł poświęcony temu zagadnieniu!

Halucynacje AI mogą zdarzyć się każdemu chatbotowi, nawet najlepszemu. Kluczem jest zrozumienie, dlaczego pojawiają się te błędy i wdrożenie działań, by je wcześnie wychwycić:

Dzięki tym nawykom zamienisz swojego chatbota z „twórczego bajkopisarza” w godnego zaufania asystenta, zachowując jednocześnie pełną odpowiedzialność (i osąd) po swojej stronie.

Chcesz wykorzystywać AI w codziennej pracy? Otrzymaj praktyczne przewodniki, rzeczywiste przykłady i gotowe do wdrożenia schematy pracy dla zapracowanych profesjonalistów. Od pisania lepszych maili po automatyzację notatek ze spotkań – Akademia AI pomaga pracować mądrzej z AI.

👉 Sprawdź więcej na Akademii AI i zacznij eksperymentować już dziś!

Pomagamy firmom takim jak Twoja rozwijać inteligentne chatboty, serwery MCP, narzędzia AI lub inne rodzaje automatyzacji AI, aby zastąpić człowieka w powtarzalnych zadaniach w Twojej organizacji.

Halucynacja w modelach językowych występuje, gdy AI generuje tekst, który wydaje się prawdopodobny, ale w rzeczywistości jest nieprawidłowy lub zmyślony. Dowied...

Zwiększ dokładność swojego chatbota AI dzięki funkcji pomijania indeksowania w FlowHunt. Wyklucz nieodpowiednie treści, aby utrzymać rozmowy na odpowiednim pozi...

Potężne narzędzie AI do natychmiastowych odpowiedzi i wglądów. Narzędzie Ask AI od FlowHunt wykorzystuje sztuczną inteligencję, aby zapewnić błyskawiczne odpowi...