الاستدلال

الاستدلال هو العملية الإدراكية لاستخلاص الاستنتاجات، وإجراء الاستنباطات، أو حل المشكلات بناءً على المعلومات والحقائق والمنطق. استكشف أهميته في الذكاء الاصطناعي،...

اكتشف كيف يقلد استدلال الذكاء الاصطناعي تفكير الإنسان لحل المشكلات واتخاذ القرار، وتطوره، وتطبيقاته في الرعاية الصحية، وأحدث النماذج مثل o1 من OpenAI.

الاستدلال في الذكاء الاصطناعي هو وسيلة منطقية تساعد الآلات على استخلاص الاستنتاجات، والتنبؤات، وحل المشكلات بطريقة مشابهة لتفكير الإنسان. يتضمن سلسلة من الخطوات التي يستخدم فيها نظام الذكاء الاصطناعي المعلومات المتاحة لاكتشاف رؤى جديدة أو اتخاذ قرارات. في الأساس، يهدف الاستدلال في الذكاء الاصطناعي إلى تقليد قدرة الدماغ البشري على معالجة المعلومات والوصول إلى الاستنتاجات. وهذا أمر أساسي لتطوير أنظمة ذكية قادرة على اتخاذ قرارات مستنيرة بنفسها.

يقع الاستدلال في الذكاء الاصطناعي ضمن نوعين رئيسيين:

يُحسّن الاستدلال في الذكاء الاصطناعي بشكل كبير عمليات اتخاذ القرار في مختلف المجالات. من خلال إضافة قدرات الاستدلال، تستطيع الأنظمة الذكية الفهم بشكل أفضل والعمل بكفاءة أعلى، مما يؤدي إلى تطبيقات أكثر تقدمًا.

تشكّل نمو الاستدلال في الذكاء الاصطناعي عبر عدة محطات هامة:

ويواصل الاستدلال في الذكاء الاصطناعي تطوره مع استمرار البحث والتطوير نحو تحسين هذه النماذج وتوسيع استخداماتها. ومع تزايد قدرة الأنظمة الذكية على الاستدلال المعقد، سيتسع تأثيرها المحتمل على المجتمع والصناعة، مما يوفر فرصًا وتحديات جديدة.

يمثل الذكاء العصبي-الرمزي تحولًا في الذكاء الاصطناعي من خلال دمج منهجين مختلفين: الشبكات العصبية والذكاء الرمزي. يستخدم هذا النموذج المدمج قدرات التعرف على الأنماط للشبكات العصبية مع مهارات الاستدلال المنطقي للأنظمة الرمزية. من خلال الدمج بين هذين المنهجين، يهدف الذكاء العصبي-الرمزي إلى معالجة نقاط الضعف الموجودة في كل منهج عند استخدامه بشكل منفرد.

تستلهم الشبكات العصبية من الدماغ البشري. فهي تتكون من عقد مترابطة أو “خلايا عصبية” تتعلم من البيانات لمعالجة المعلومات. تتميز هذه الشبكات بقدرتها على التعامل مع البيانات غير المهيكلة مثل الصور والصوت والنصوص، وتشكل أساس تقنيات التعلم العميق. وتتفوق في المهام التي تتطلب التعرف على الأنماط، وتصنيف البيانات، والتنبؤ استنادًا إلى معلومات سابقة. على سبيل المثال، تُستخدم في أنظمة التعرف على الصور مثل ميزة الوسم التلقائي في فيسبوك، التي تتعلم التعرف على الوجوه في الصور من مجموعات بيانات ضخمة.

يستخدم الذكاء الرمزي الرموز للتعبير عن المفاهيم، ويعتمد على استدلال قائم على المنطق لمعالجة هذه الرموز. هذا النهج يحاكي التفكير البشري، مما يتيح للذكاء الاصطناعي التعامل مع المهام التي تتطلب معرفة منظمة واتخاذ قرارات قائمة على القواعد. ويعمل الذكاء الرمزي بشكل جيد في المواقف التي تتطلب قواعد محددة واستنتاج منطقي، مثل حل ألغاز الرياضيات أو اتخاذ قرارات استراتيجية في ألعاب مثل الشطرنج.

حسّنت نماذج الاستدلال في الذكاء الاصطناعي دقة تشخيص الأمراض بشكل كبير من خلال تقليد الاستدلال البشري. تقوم هذه النماذج بمعالجة كميات ضخمة من البيانات لاكتشاف الأنماط والشذوذات التي قد يغفلها الإنسان. فعلى سبيل المثال، عند دمج خوارزميات تعلم الآلة مع البيانات السريرية، يمكن للذكاء الاصطناعي المساعدة في تشخيص الحالات المعقدة بدقة أعلى. ويفيد ذلك بشكل خاص في التشخيص بالأشعة، حيث يفحص الذكاء الاصطناعي الأشعة والصور الطبقية للكشف عن علامات مبكرة لأمراض مثل السرطان.

تدعم نماذج الاستدلال في الذكاء الاصطناعي اتخاذ القرار السريري من خلال تقديم توصيات قائمة على الأدلة. فهي تحلل بيانات المرضى، مثل التاريخ الطبي والأعراض، لاقتراح تشخيصات وعلاجات محتملة. من خلال معالجة مجموعات بيانات ضخمة، يستطيع مقدمو الرعاية الصحية اتخاذ قرارات أفضل، مما يؤدي إلى تحسين نتائج المرضى. على سبيل المثال، في حالات الطوارئ، يقيم الذكاء الاصطناعي بيانات المرضى بسرعة لتحديد أولوية التدخلات.

تقوم نماذج الذكاء الاصطناعي بأتمتة الأعمال الروتينية مثل جدولة المواعيد، والفوترة، وإدارة سجلات المرضى، مما يقلل من عبء العمل على موظفي الرعاية الصحية. تتيح هذه الكفاءة للعاملين التركيز بشكل أكبر على رعاية المرضى. كما تضمن الأنظمة المدعومة بالذكاء الاصطناعي دقة البيانات وسهولة الوصول إليها، مما يحسّن كفاءة الخدمات الصحية بشكل عام.

تلعب نماذج الاستدلال في الذكاء الاصطناعي دورًا محوريًا في تطوير الطب الشخصي، حيث تُخصص خطط العلاج لكل مريض على حدة. يحلل الذكاء الاصطناعي المعلومات الجينية، وبيانات نمط الحياة، ومؤشرات صحية أخرى لإنشاء استراتيجيات علاجية شخصية. تزيد هذه المقاربة من الفعالية وتقلل من الآثار الجانبية، مما يجعل الطب أكثر تركيزًا على المريض ودقة.

رغم الفوائد العديدة لنماذج الاستدلال في الذكاء الاصطناعي، إلا أنها تثير أيضًا قضايا أخلاقية وخصوصية. يتطلب استخدام الذكاء الاصطناعي للبيانات الصحية الحساسة تدابير قوية لحماية الخصوصية. كما يوجد خطر التحيز في خوارزميات الذكاء الاصطناعي، مما قد يؤدي إلى نتائج غير متكافئة. هناك حاجة مستمرة للبحث وتطوير أنظمة عادلة وشفافة تضع حقوق وسلامة المرضى في الأولوية.

ملخص: تغير نماذج الاستدلال في الذكاء الاصطناعي قطاع الرعاية الصحية عبر تحسين دقة التشخيص، ودعم القرار السريري، وتبسيط الإدارة، وتمكين الطب الشخصي، ومعالجة القضايا الأخلاقية. وتبرز هذه التطبيقات إمكانات الذكاء الاصطناعي التحويلية لتحقيق خدمات صحية أكثر كفاءة وفاعلية وعدالة.

حسّنت نماذج الاستدلال في الذكاء الاصطناعي الدقة بشكل كبير في مهام اتخاذ القرار المعقدة. فهي تتفوق في البيئات التي تتطلب فهمًا وتكيفًا سريعًا، مثل التشخيص الطبي والتنبؤ المالي. من خلال الاستفادة من مجموعات البيانات الضخمة، يعزز الذكاء الاصطناعي قدراته التنبؤية، مما يؤدي إلى نتائج أكثر دقة — وأحيانًا تتجاوز خبرة المختصين البشريين.

تقوم نماذج الاستدلال في الذكاء الاصطناعي بأتمتة المهام الروتينية، مما يسرّع العمليات ويقلل من تكاليف العمالة والأخطاء البشرية. في القطاع المالي، يمكن للذكاء الاصطناعي إدارة المعاملات واكتشاف الاحتيال وإدارة المحافظ المالية بقليل من الإشراف، مما يؤدي إلى توفير كبير. وفي الصناعة، يعمل الذكاء الاصطناعي على تحسين سلاسل التوريد وإدارة المخزون، مما يؤدي إلى تقليل التكاليف أكثر.

تشمل التطورات الأخيرة نماذج ذكاء اصطناعي تعاونية متعددة تعمل معًا لتعزيز اتخاذ القرار وتحسين الدقة الواقعية. من خلال النقاش وتبادل الآراء، تصل هذه النماذج إلى استنتاجات أدق من نظام ذكاء اصطناعي واحد، مما يضمن نتائج دقيقة ومدروسة وقوية.

في حين تقدم نماذج الذكاء الاصطناعي المتخصصة دقة أفضل في مجالات محددة، إلا أنها قد تصبح شديدة التركيز وتواجه صعوبة في التطبيقات العامة. موازنة التخصص والقدرة العامة أمر أساسي لبقاء نماذج الذكاء الاصطناعي مرنة وفعالة.

تثير نماذج الاستدلال في الذكاء الاصطناعي قضايا أخلاقية ومرتبطة بالخصوصية، خاصة عند التعامل مع بيانات حساسة. الحفاظ على خصوصية البيانات والاستخدام الأخلاقي أمر بالغ الأهمية. وتدور مناقشات مستمرة حول مدى استقلالية الأنظمة الذكية، خاصة في مجالات مثل الرعاية الصحية والمالية، حيث يكون للقرارات آثار كبيرة.

ملخص: تعزز نماذج الاستدلال في الذكاء الاصطناعي الكفاءة والدقة في العديد من المجالات. ولتحقيق إمكاناتها الكاملة بشكل مسؤول، من الضروري معالجة التخصص الزائد والقضايا الأخلاقية.

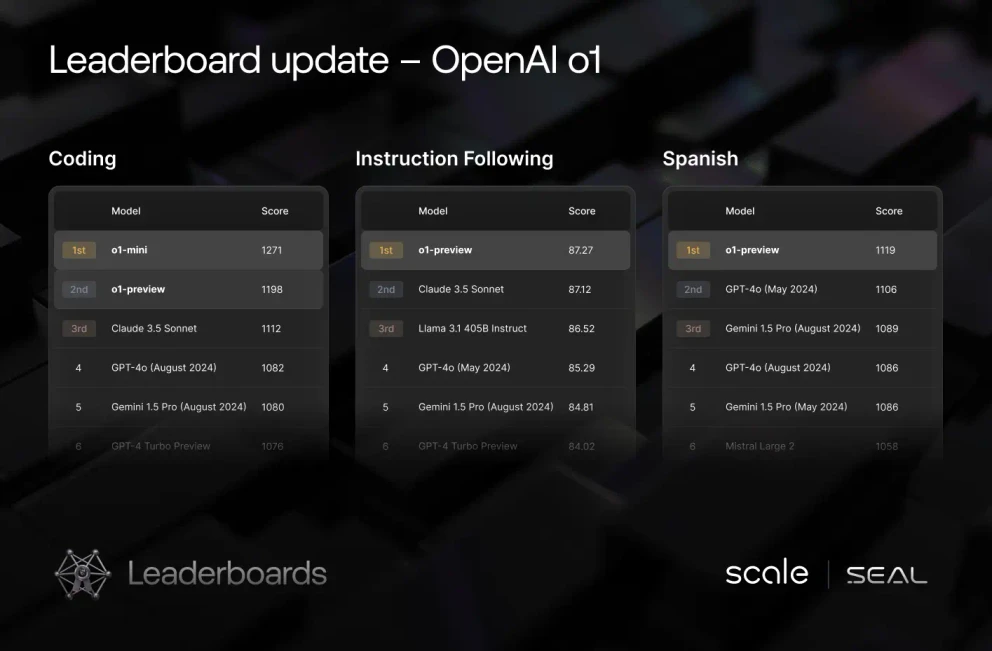

سلسلة o1 من OpenAI من النماذج المتقدمة في الاستدلال، حيث تتفوق في معالجة الاستدلال المعقد وحل المشكلات باستخدام التعلم المعزز ومعالجة سلسلة الأفكار. تقدم سلسلة o1 تطورات كبيرة، متفوقة على نماذج سابقة مثل GPT-4 من حيث الأداء والسلامة.

أنواع النماذج: o1-Preview و o1-Mini

معالجة سلسلة الأفكار

ميزات أمان متقدمة

الأداء في معايير العلوم والتكنولوجيا والهندسة والرياضيات

تقليل الهلوسة

تدريب على بيانات متنوعة

الكفاءة والتكلفة وسهولة الوصول

تقييمات السلامة والعدالة

المصدر: مدونة Scale AI

أطلقت مايكروسوفت Tay، روبوت محادثة ذكاء اصطناعي مصمم ليتعلم من تويتر. بدأ Tay بسرعة في نشر تغريدات مسيئة بعد أن تعلم من تفاعلات المستخدمين غير المفلترة. أدى ذلك إلى إغلاق Tay خلال يوم واحد وأثار تساؤلات حول سلامة الذكاء الاصطناعي، ومراقبة المحتوى، ومسؤولية المطورين.

استخدم مشروع Maven من جوجل الذكاء الاصطناعي لتحليل لقطات الطائرات بدون طيار لأغراض عسكرية. أثار ذلك مخاوف أخلاقية بشأن استخدام الذكاء الاصطناعي في الحروب وقاد إلى احتجاجات الموظفين، مما دفع جوجل لعدم تمديد العقد مع وزارة الدفاع — مسلطاً الضوء على التحديات الأخلاقية وتأثير نشاط الموظفين.

وجد أن أداة التوظيف بالذكاء الاصطناعي لدى أمازون متحيزة ضد النساء لأنها تعلمت من بيانات تاريخية تفضل الرجال. تم إيقاف الأداة، مما يبرز الحاجة للعدالة والشفافية في الذكاء الاصطناعي المؤثر على التوظيف والتنوع.

تم جمع بيانات ملايين من مستخدمي فيسبوك بدون إذن لاستخدامها في التأثير على الحملات السياسية. سلط هذا الحادث الضوء على أهمية خصوصية البيانات والاستخدام الأخلاقي للمعلومات الشخصية، وأكد على الحاجة لقوانين حماية بيانات صارمة والوعي بمخاطر إساءة استخدام الذكاء الاصطناعي في السياسة.

واجه IBM Watson، الذي تم تطويره للمساعدة في علاج السرطان، انتقادات بسبب تقديم توصيات غير آمنة. أظهر ذلك حدود الذكاء الاصطناعي في اتخاذ القرارات الطبية المعقدة وبيّن ضرورة إشراف الإنسان.

أنشأت Clearview AI قاعدة بيانات للتعرف على الوجوه بجمع صور من وسائل التواصل الاجتماعي لاستخدامها من قبل الجهات الأمنية. أثار ذلك مخاوف بشأن الخصوصية والموافقة، وسلّط الضوء على المعضلات الأخلاقية للمراقبة والتوازن بين الأمن وحقوق الخصوصية.

واجه مشروع السيارات ذاتية القيادة من أوبر أول حادث وفاة عندما صدمت مركبة أحد المشاة، لتكون أول حادثة من هذا النوع. أظهر ذلك تحديات السلامة والحاجة لاختبارات تنظيمية صارمة.

يراقب نظام الرصيد الاجتماعي في الصين سلوك المواطنين ويمنحهم نقاطاً تؤثر على وصولهم للخدمات، مما يثير مخاوف أخلاقية كبيرة حول المراقبة والخصوصية والتمييز المحتمل. توضح هذه الحالة أهمية تحقيق التوازن بين الفوائد المجتمعية وحقوق الأفراد عند نشر الذكاء الاصطناعي.

توضح هذه الأمثلة إمكانات وتحديات نشر الذكاء الاصطناعي. وتؤكد على ضرورة الاعتبارات الأخلاقية والشفافية والإشراف الدقيق في تطوير وتطبيق تقنيات الذكاء الاصطناعي.

يعني التحيز في نماذج الذكاء الاصطناعي التفضيل أو التحيز نحو نتائج معينة، وغالبًا ما يكون ذلك بسبب البيانات المستخدمة في التدريب. تشمل الأنواع:

يمكن أن يكون للانحياز في الذكاء الاصطناعي آثار خطيرة:

ضمان العدالة في الذكاء الاصطناعي يعني بناء نماذج لا تفضل أو تستغل أشخاصًا بناءً على العرق أو الجنس أو الوضع الاجتماعي والاقتصادي. تساعد العدالة في منع ترسيخ أوجه عدم المساواة وتشجع على نتائج متكافئة. ويتطلب ذلك فهم أنواع التحيز وتطوير استراتيجيات للحد منه.

الاستدلال في الذكاء الاصطناعي هو عملية منطقية تُمكّن الآلات من استخلاص الاستنتاجات، والتنبؤات، وحل المشكلات بطريقة مشابهة لطريقة التفكير البشري. يشمل الاستدلال الرسمي (القائم على القواعد) والاستدلال باللغة الطبيعية.

الاستدلال في الذكاء الاصطناعي يعزز اتخاذ القرار، وحل المشكلات، وتفاعل الإنسان مع الذكاء الاصطناعي. فهو يمكّن الأنظمة من مراعاة عوامل ونتائج متعددة، مما يؤدي لنتائج أفضل في مجالات مثل الرعاية الصحية والمالية والروبوتات.

هناك نوعان رئيسيان: الاستدلال الرسمي، الذي يستخدم منطقًا صارمًا قائمًا على القواعد، والاستدلال باللغة الطبيعية، الذي يسمح للذكاء الاصطناعي بالتعامل مع غموض وتعقيد اللغة البشرية.

يُحسن الاستدلال في الذكاء الاصطناعي دقة التشخيص، ويساعد في اتخاذ القرار السريري، ويُبسط المهام الإدارية، ويُمكّن الطب الشخصي من خلال تحليل بيانات المرضى وتقديم توصيات قائمة على الأدلة.

o1 من OpenAI هو نموذج استدلال متقدم في الذكاء الاصطناعي يتميز بمعالجة سلسلة الأفكار، وسلامة محسّنة، وأداء مرتفع في مجالات العلوم والتكنولوجيا والهندسة والرياضيات، وتقليل الهلوسة، وتوفير نسخ فعّالة من حيث التكلفة لاستخدام الذكاء الاصطناعي المتقدم بشكل متاح.

تشمل التحديات الرئيسية التعامل مع التحيز وضمان العدالة، والحفاظ على خصوصية البيانات، ومنع التخصص الزائد، والتعامل مع القضايا الأخلاقية عند تطبيق الذكاء الاصطناعي في مختلف الصناعات.

يمكن تقليل التحيز من خلال مجموعات بيانات متنوعة وتمثيلية، وتصميم خوارزميات تركز على العدالة، والمراقبة والتعديلات المنتظمة لضمان نتائج متكافئة لجميع المستخدمين.

روبوتات محادثة ذكية وأدوات ذكاء اصطناعي تحت سقف واحد. وصل بين الكتل التفاعلية لتحويل أفكارك إلى تدفقات مؤتمتة.

الاستدلال هو العملية الإدراكية لاستخلاص الاستنتاجات، وإجراء الاستنباطات، أو حل المشكلات بناءً على المعلومات والحقائق والمنطق. استكشف أهميته في الذكاء الاصطناعي،...

الاستدلال متعدد الخطوات هو عملية في الذكاء الاصطناعي، خاصة في معالجة اللغة الطبيعية والرسوم البيانية المعرفية، حيث تقوم الأنظمة بربط عدة أجزاء من المعلومات للإج...

تشير الشفافية في الذكاء الاصطناعي إلى الانفتاح والوضوح في طريقة عمل أنظمة الذكاء الاصطناعي، بما في ذلك عمليات اتخاذ القرار والخوارزميات والبيانات المستخدمة. تعت...