معالجة اللغة الطبيعية (NLP)

معالجة اللغة الطبيعية (NLP) هي فرع من فروع الذكاء الاصطناعي (AI) يتيح للحواسيب فهم اللغة البشرية وتفسيرها وتوليدها. اكتشف الجوانب الرئيسية، وكيفية عملها، وتطبيق...

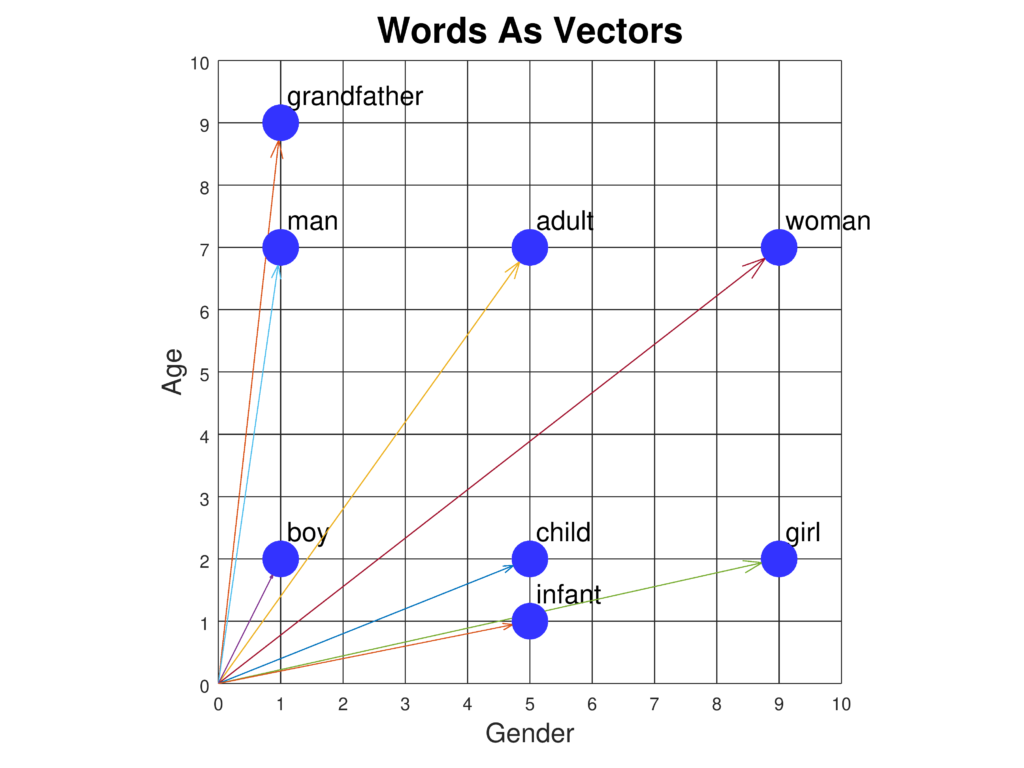

تقوم تضمينات الكلمات بتمثيل الكلمات في فضاء متجه مستمر، ملتقطة معانيها وسياقها لتحسين تطبيقات معالجة اللغة الطبيعية.

تُعد تضمينات الكلمات عنصرًا محوريًا في معالجة اللغة الطبيعية كونها جسرًا بين الإنسان والحاسوب. اكتشف الجوانب الرئيسية، وآلية العمل، والتطبيقات اليوم!

البحوث حول تضمينات الكلمات في معالجة اللغة الطبيعية

تعلم تضمينات معاني الكلمات من تعريفات معاني الكلمات

تشي لي، تيانشي لي، باباو تشانغ (2016) يقترحون طريقة لمعالجة تحدي الكلمات متعددة المعاني في تضمينات الكلمات عبر إنشاء تضمين لكل معنى باستخدام تعريفات معاني الكلمات. تعتمد طريقتهم على التدريب المعتمد على النصوص لتحقيق تضمينات عالية الجودة للمعاني. أظهرت النتائج تحسنًا في مهام تشابه الكلمات وتمييز المعاني، مما يؤكد إمكانات تضمينات معاني الكلمات في تعزيز تطبيقات معالجة اللغة الطبيعية. اقرأ المزيد

تصفية الضوضاء المعتمدة على الشبكات العصبية من تضمينات الكلمات

كيم أن نغوين، سابين شولت إيم فالده، نغوك ثانغ فو (2016) يقدمون نموذجين لتحسين تضمينات الكلمات من خلال تصفية الضوضاء. يحددون المعلومات غير الضرورية ضمن التضمينات التقليدية ويقترحون تقنيات تعلم غير مراقبة لإنشاء تضمينات منقّاة من الضوضاء. تستخدم هذه النماذج شبكة عصبية أمامية عميقة لتعزيز المعلومات المهمة وتقليل الضوضاء. أظهرت النتائج أداءً متفوقًا للتضمينات المنقّاة في المهام المرجعية. اقرأ المزيد

استعراض حول تضمينات الكلمات العصبية

إرهان سيزرر، سلمى تكير (2021) يقدمان مراجعة شاملة لتضمينات الكلمات العصبية، متتبعين تطورها وتأثيرها على معالجة اللغة الطبيعية. يشمل الاستعراض النظريات الأساسية ويستعرض أنواع التضمينات المختلفة مثل تضمينات المعنى، وتضمينات المورفيم، والتضمينات السياقية. كما يناقش الورقة مجموعات البيانات المرجعية وتقييمات الأداء، مبرزًا الأثر التحويلي للتضمينات العصبية على مهام معالجة اللغة الطبيعية. اقرأ المزيد

تحسين التفسير عبر طبقة رسم تفاعل الكلمات الصريحة

أرشديب سيخون، هانجيي تشن، أمان شريفاستافا، جه وانغ، يانغفينغ جي، يانجون تشي (2023) يركزون على تعزيز قابلية تفسير النماذج في معالجة اللغة الطبيعية من خلال WIGRAPH، وهي طبقة في الشبكة العصبية تبني رسم تفاعل عالمي بين الكلمات. يمكن دمج هذه الطبقة في أي مصنف نصوص NLP، مما يحسن كل من القابلية للتفسير ودقة التنبؤ. تؤكد الدراسة على أهمية التفاعلات بين الكلمات في فهم قرارات النماذج. اقرأ المزيد

تضمينات الكلمات لقطاع البنوك

أفنيش باتيل (2023) يستكشف تطبيق تضمينات الكلمات في القطاع المصرفي، مسلطًا الضوء على دورها في مهام مثل تحليل المشاعر وتصنيف النصوص. تدرس الدراسة استخدام كل من التضمينات الساكنة للكلمات (مثل Word2Vec و GloVe) والنماذج السياقية، مع التأكيد على تأثيرها في مهام معالجة اللغة الطبيعية الخاصة بالصناعة. اقرأ المزيد

تضمينات الكلمات هي تمثيلات متجهية كثيفة للكلمات، حيث يتم تمثيل الكلمات المتشابهة دلاليًا بنقاط متقاربة في فضاء مستمر، مما يمكّن النماذج من فهم السياق والعلاقات في اللغة.

تعزز مهام معالجة اللغة الطبيعية من خلال التقاط العلاقات الدلالية والتركيبية، تقليل الأبعاد، تمكين التعلم الانتقالي، وتحسين التعامل مع الكلمات النادرة.

تشمل التقنيات الشائعة Word2Vec و GloVe و FastText و TF-IDF. تتعلم النماذج العصبية مثل Word2Vec و GloVe التضمينات من مجموعات نصية ضخمة، بينما يدمج FastText معلومات تحت-الكلمة.

تواجه التضمينات التقليدية صعوبة مع التعدد الدلالي (الكلمات ذات المعاني المتعددة)، وقد تعكس تحيزات البيانات، ويمكن أن تتطلب موارد حسابية كبيرة للتدريب على مجموعات نصية ضخمة.

تُستخدم في تصنيف النصوص، الترجمة الآلية، التعرف على الكيانات، استرجاع المعلومات، وأنظمة الإجابة على الأسئلة لتحسين الدقة والفهم السياقي.

ابدأ ببناء حلول ذكاء اصطناعي متقدمة باستخدام أدوات سهلة لمعالجة اللغة الطبيعية، بما في ذلك تضمين الكلمات والمزيد.

معالجة اللغة الطبيعية (NLP) هي فرع من فروع الذكاء الاصطناعي (AI) يتيح للحواسيب فهم اللغة البشرية وتفسيرها وتوليدها. اكتشف الجوانب الرئيسية، وكيفية عملها، وتطبيق...

تمكن معالجة اللغة الطبيعية (NLP) أجهزة الكمبيوتر من فهم اللغة البشرية وتفسيرها وتوليدها باستخدام اللغويات الحاسوبية وتعلم الآلة والتعلم العميق. تدعم NLP تطبيقات...

متجه التضمين هو تمثيل عددي كثيف للبيانات في فضاء متعدد الأبعاد، يلتقط العلاقات الدلالية والسياقية. تعرف على كيفية تمكين متجهات التضمين لمهام الذكاء الاصطناعي مث...