أفضل منصات بناء الوكلاء الذكاء الاصطناعي في عام 2026: دليل شامل لمنصات الذكاء المستقل

استكشف أفضل منصات بناء وكلاء الذكاء الاصطناعي في عام 2026، من المنصات بدون كود إلى أطر العمل المخصصة للمؤسسات. اكتشف الأدوات الأنسب لاستخدامك وكيف تعزز FlowHunt...

يقطع ضجيج multi-agent. إجماع الصناعة في 2026، تكلفة الـ 15× من الرموز، أنماط الـ prompt الأربعة، وبرنامج تعليمي في FlowHunt مدته 45 دقيقة يستخدم نمط الإجماع.

نظام الذكاء الاصطناعي متعدد الوكلاء هو شبكة من وكلاء الذكاء الاصطناعي يعملون معًا لحل مشكلة. لكن البنية التي يتم نشرها فعلًا في 2026 أضيق مما يوحي به المصطلح الرائج: orchestrator واحد يملك السياق الكامل للمحادثة ويُنشئ subagents معزولة سريعة الزوال تُعيد فقط ملخصًا مضغوطًا. تقاربت Anthropic وCognition وOpenAI وAutoGen-عبر-Microsoft Agent Framework وLangChain جميعها على هذا النمط. أما تصاميم “GroupChat” بنمط peer collaboration — حيث يتحدث العمال إلى بعضهم البعض مباشرة — فقد فقدت موقعها بهدوء.

يفعل هذا المقال ثلاثة أشياء. أولًا، يشرح نمط orchestrator + subagent ولماذا تقاربت الصناعة عليه. ثانيًا، يعرض واقع التكلفة: علاوة الرموز المُقاسة بـ ~15× من Anthropic، وأوراق 2026 التي تُظهر أن أنظمة الوكيل الواحد تُضاهي أو تتفوق على multi-agent عند ميزانيات رموز متساوية. ثالثًا، يُبيّن كيف تبني نمط الإجماع في FlowHunt دون كتابة كود.

في الواقع، لا توجد سوى بنيتين تستحقان المقارنة، ومعظم المواد التسويقية تخلط بينهما.

Peer collaboration. يعمل عدة وكلاء بالتوازي ويتواصلون عبر ناقل مشترك. يمكنهم طرح أسئلة على بعضهم البعض، وتسليم المهام، وإيقاظ بعضهم البعض. يتوسّط supervisor ولكن لا يملك السياق الوحيد. AutoGen GroupChat وCrewAI hierarchical وأي تصميم من نوع “فريق وكلاء على بثّ” يقع هنا. التكلفة حقيقية: كل wakeup يُعيد قراءة النص الكامل، و system prompt يحمل بروتوكول تنسيق طويلًا في كل استدعاء، وعلاقات الاتصال تتوسّع بمعدّل O(n²).

Orchestrator + subagents معزولة. وكيل واحد يملك السياق الكامل. يُنشئ subagents سريعي الزوال لتنفيذ مهام فرعية معزولة. كل subagent يعمل في نافذة سياق جديدة خاصة به مع system prompt مخصّص، يُنفّذ مهمته، ويُعيد سلسلة ملخص واحدة. لا توجد قناة peer-to-peer ولا حالة قابلة للتغيير مشتركة. نظام الأبحاث متعدد الوكلاء من Anthropic، وأداة Task في Claude Code، و agents-as-tools من OpenAI، و Managed Devins من Cognition في مارس 2026 — كلها تستخدم هذا النمط.

النمط الثاني هو تقنيًا multi-agent، لكن تكلفة التنسيق فيه محدودة. لا يوجد ناقل peer، ومن ثَم لا انفجار اتصالي تربيعي ولا ضريبة إعادة تشغيل النص.

انهار النقاش المستقطب لعام 2025 فعليًا.

كانت ورقة Cognition Don’t Build Multi-Agents (يونيو 2025) أقوى موقف معلَن ضد تصاميم multi-agent — single-threaded فقط، مع LLM ضغط منفصل لإدارة السياق. وبعد تسعة أشهر، في مارس 2026، أصدرت Cognition ورقة Devin can now Manage Devins : منسّق يحدّد نطاق العمل، ويُسند كل قطعة إلى managed Devin يعمل في VM معزول خاص به، ثم يُجمّع النتائج. التبرير — “السياق يتراكم، والتركيز يتدهور، وجودة كل مهمة فرعية تتأثر” — هو نفس حجة العزل التي قدّمتها Anthropic في 2025. لا يسحب المقال المقالة السابقة بالاسم، لكن التنازل المعماري واضح.

تحرّك موقف Anthropic في الاتجاه المعاكس خلال الفترة نفسها — نحو بنى “brain/hands” المنفصلة بدلًا من توسيع fan-out بالتوازي. مقالة Managed Agents في أبريل 2026 و harness ثلاثي الوكلاء للتطوير full-stack تُؤكّد على subagents بنطاق دور بدلًا من فِرَق peer.

جعل تحديث Agents SDK من OpenAI في 15 أبريل 2026 سجل nested handoff opt-in افتراضيًا — مما يقلّل من تسرّب السياق بين الوكلاء. اندمج AutoGen في Microsoft Agent Framework 1.0؛ ولم يعد peer GroupChat هو الواجهة. توصي LangChain الآن بـ supervisor-as-tool بدلًا من مكتبة supervisor.

خمسة موردين، اتجاه واحد. peer GroupChat في تراجع.

الرقم الأكثر اقتباسًا من المقالة الهندسية لـ Anthropic في يونيو 2025:

“يُظهر التحليل الداخلي أن الوكلاء يستخدمون عادةً حوالي 4× من الرموز أكثر من تفاعلات الدردشة، وأن أنظمة multi-agent تستخدم حوالي 15× من الرموز أكثر من الدردشات.”

والملاحظة التشخيصية الحاسمة:

“استخدام الرموز وحده يُفسّر 80% من تباين الأداء على BrowseComp.”

تدفع الأدبيات الأكاديمية لعام 2026 الاستنتاج نفسه بقوة أكبر. اختبر Tran & Kiela (arXiv 2604.02460 ، أبريل 2026، Stanford / Contextual AI) Qwen3 وDeepSeek-R1-Distill-Llama وGemini 2.5 ويُبلّغون: “تحت ميزانية reasoning-token ثابتة ومع استخدام مثالي للسياق، تكون أنظمة single-agent أكثر كفاءة معلوماتيًا… تُضاهي أنظمة single-agent أو تتفوق باستمرار على أنظمة multi-agent في مهام الاستدلال متعدد القفزات عندما يُحفظ عدد reasoning tokens ثابتًا.” الأرضية النظرية هي عدم مساواة معالجة البيانات: تمرير المعلومات عبر مزيد من الوكلاء يمكنه فقط أن يخسر، لا أن يضيف.

تصل ورقة OneFlow لـ Xu et al. (يناير 2026) إلى الاستنتاج نفسه عبر سبعة benchmarks، مع الإشارة إلى إعادة استخدام KV-cache كميزة الكفاءة.

هذا لا يعني أن multi-agent خاطئ دائمًا. يعني أن عبء الإثبات يقع على multi-agent، لا على التصميم الأبسط.

تتقارب أدلة 2026 على مجموعة ضيقة من الحالات.

العمل القابل للتوازي والمكثّف للقراءة. نظام Anthropic لعام 2025 يُوزّع subagents (fan-out) على استعلامات بحث فرعية مستقلة. تُنمذج AORCHESTRA (arXiv 2602.03786

، فبراير 2026) كل subagent باعتباره رباعية (INSTRUCTION, CONTEXT, TOOLS, MODEL) يُنشئها orchestrator عند الطلب وتُبلّغ عن تحسّن نسبي +16.28% مقابل أقوى baseline على GAIA وSWE-Bench وTerminal-Bench باستخدام Gemini-3-Flash. تُبلّغ AdaptOrch (2602.16873

) عن +12–23% فوق baselines ثابتة بطوبولوجيا واحدة باستخدام نماذج أساسية مماثلة — يأتي الفوز من توجيه الطوبولوجيا، لا من peer collaboration.

موثوقية ضيقة النطاق. أجرت ورقة Drammeh عن الاستجابة للحوادث (2511.15755 v2 ، يناير 2026) 348 تجربة مضبوطة وتُبلّغ عن معدل توصيات قابلة للتنفيذ 100% مقابل 1.7% لـ single-agent، مع 80× من خصوصية الإجراءات و140× من صحة الحلول، و*“تباين جودة صفري عبر جميع التجارب.”* النطاق ضيق والعمل متوازٍ؛ نمط orchestrator يفوز بشكل حاسم.

نطاقات أدوات أو سياق منفصلة حيث يخدم handoff بمثابة حدّ أمني — وكيل فوترة لا ينبغي حقًا أن يرى أدوات الهندسة، على سبيل المثال.

أما لتنفيذ المهام التسلسلية، أو الوكلاء الذين يمسّون حالة مشتركة، أو أي شيء يبدو مثل “نفّذ هذه الخطوات بالترتيب مع إصدار حكم بينها” — هذه الشروط لا تنطبق. تُوصي الأدبيات بوكيل واحد مع إدارة سياق منضبطة.

بمجرد أن تُقرّر أن multi-agent هو الخيار الصحيح، تكون بنية الـ prompt أكثر توحيدًا مما توحي به معظم المواد التسويقية. كل تطبيق رئيسي تمّ مسحه — Claude Code وAnthropic Research وOpenAI Agents SDK وCrewAI وAutoGen وLangGraph وAOrchestra — يستخدم النمط نفسه، المُسمّى P2 في أدبيات بناء الـ prompt: system prompt مخصّص للـ subagent، بالإضافة إلى task brief منظَّم يُسلَّم كأول رسالة مستخدم.

مقال Anthropic لعام 2025 هو الأكثر صراحة بشأن ما يدخل في الـ brief:

“يحتاج كل subagent إلى هدف، وصيغة مخرجات، وإرشادات حول الأدوات والمصادر التي يستخدمها، وحدود واضحة للمهمة.”

وهم صريحون أيضًا حول كيف يبدو الفشل عند تخطّي ذلك:

“بدأنا بالسماح للوكيل القائد بإعطاء تعليمات بسيطة وقصيرة مثل ‘ابحث عن نقص أشباه الموصلات’، لكننا وجدنا أن هذه التعليمات كانت في الغالب غامضة بما يكفي لجعل subagents يُسيئون فهم المهمة أو يُجرون نفس عمليات البحث بالضبط.”

تخرج ثلاث قواعد من الإجماع:

قاعدة رابعة، كثيرًا ما يُغفل عنها: مرّر مخرجات العامل مباشرة إلى المستخدم عندما تكون المهمة المتبقية الوحيدة للـ supervisor هي تسليمها. قاس benchmark LangChain لعام 2025 أن نحو 50% من مكسب أداء swarm-vs-supervisor يأتي من هذا التغيير المنفرد. الجولة الثلاثية “supervisor يقرأ مخرجات العامل، يُعيد الصياغة للمستخدم، يُعيد صياغة رد المستخدم للعامل التالي” هي هدر صرف.

تظهر هذه في المراجعات الإنتاجية، وفي benchmark LangChain، وفي Multi-Agent Orchestration Failure Playbook for 2026 من Cogent. وهي السبب وراء تحوّل الصناعة.

| وضع الفشل | كيف يبدو |

|---|---|

| إعادة تشغيل النص الكامل عند كل wakeup | كل وكيل يعيد ابتلاع المحادثة الكاملة في كل دور. خطّي في الأدوار × الوكلاء. |

| تضخّم system prompt من بروتوكول التنسيق | كل وكيل يشحن وصف البروتوكول وقائمة الأدوار ومفردات الإشارات في كل استدعاء. |

| جولة “ترجمة” supervisor الترددية | supervisor يقرأ مخرجات العامل، يُعيد الصياغة للمستخدم، يُعيد صياغة رد المستخدم للعامل التالي. ~50% من التكلفة القابلة للتجنّب. |

| افتراضات ضمنية متضاربة | عمال يعملون بالتوازي يتّخذون قرارات جمالية أو معمارية دقيقة لا تتوافق. الادعاء المركزي لـ Cognition في 2025. |

| انفجار حواف التنسيق | n من الوكلاء يتواصلون عبر O(n²) من الحواف. إضافة الوكيل الخامس تُضاعف رسم الرسائل. |

| عبء HITL/التعليق | الإيقاف المؤقت والاستئناف يُعيد فوترة النص الكامل قبل التعليق. |

| الإجماع المبكر / “herding” | يتقارب وكلاء peer على إجابة واثقة لكنها خاطئة لأن ثقة كل وكيل تُعزّز ثقة الآخرين. اكتشاف جديد لعام 2026 (Tian et al.، 2025؛ مُعزَّز في 2026). |

تشخيص مفيد: إذا كان بإمكانك تسمية ثلاثة من السبعة في تطبيقك الخاص، فأنت تدفع ضريبة multi-agent مقابل بنية لا تُوصي بها الأدبيات. الإصلاح نادرًا ما يكون “اقتلاع فريق الوكلاء” — بل ضغط التاريخ، تخزين البادئة الثابتة للـ prompt مؤقتًا، إعادة الملخصات بدلًا من النصوص الكاملة، وتمرير مخرجات العامل مباشرة إلى المستخدم.

التطوّر الجديد فعلًا في 2026 هو بدائيات التنسيق على مستوى البنية التحتية، لا أنماط الـ framework.

انضم بروتوكول Agent2Agent (A2A) إلى MCP تحت Linux Foundation AI & Agents Foundation (AAIF) في ديسمبر 2025، بدعم مؤسس من OpenAI وAnthropic وGoogle وMicrosoft وAWS وBlock. يستهدف A2A صراحة “الاتصال بين الوكلاء، تفويض المهام، والتنسيق التعاوني لـ multi-agent workflows الموزّعة.” بحلول فبراير 2026، تجاوز MCP نحو 97 مليون تنزيل SDK شهريًا.

تستحق بدائيتان بحثيتان المتابعة. تُظهر KVCOMM (NeurIPS 2025) إعادة استخدام أكثر من 70% من KV-cache و~7.8× من السرعة في إعدادات خمسة وكلاء عبر مشاركة حالة KV بدلًا من الرموز. تُبلّغ Phase-Scheduled Multi-Agent Systems (PSMAS، فبراير 2026) عن تخفيض 34.8% من الرموز عبر معاملة تفعيل الوكيل كتحكّم متواصل في الانتباه المشترك بدلًا من RPC منفصل.

تتجاوز هذه البدائيات الثنائية orchestrator-vs-peer من خلال تغيير ما يعنيه “السياق” بين الوكلاء أصلًا. ليست بعد لبنات بناء جاهزة للإنتاج، لكنها الشيء الصحيح للمتابعة — وتُعزّز الاتجاه العام: ستُخفَّض التكلفة عبر تنسيق أذكى في طبقة البنية التحتية، لا عبر تصاميم peer أكثر تفصيلًا في طبقة الـ framework.

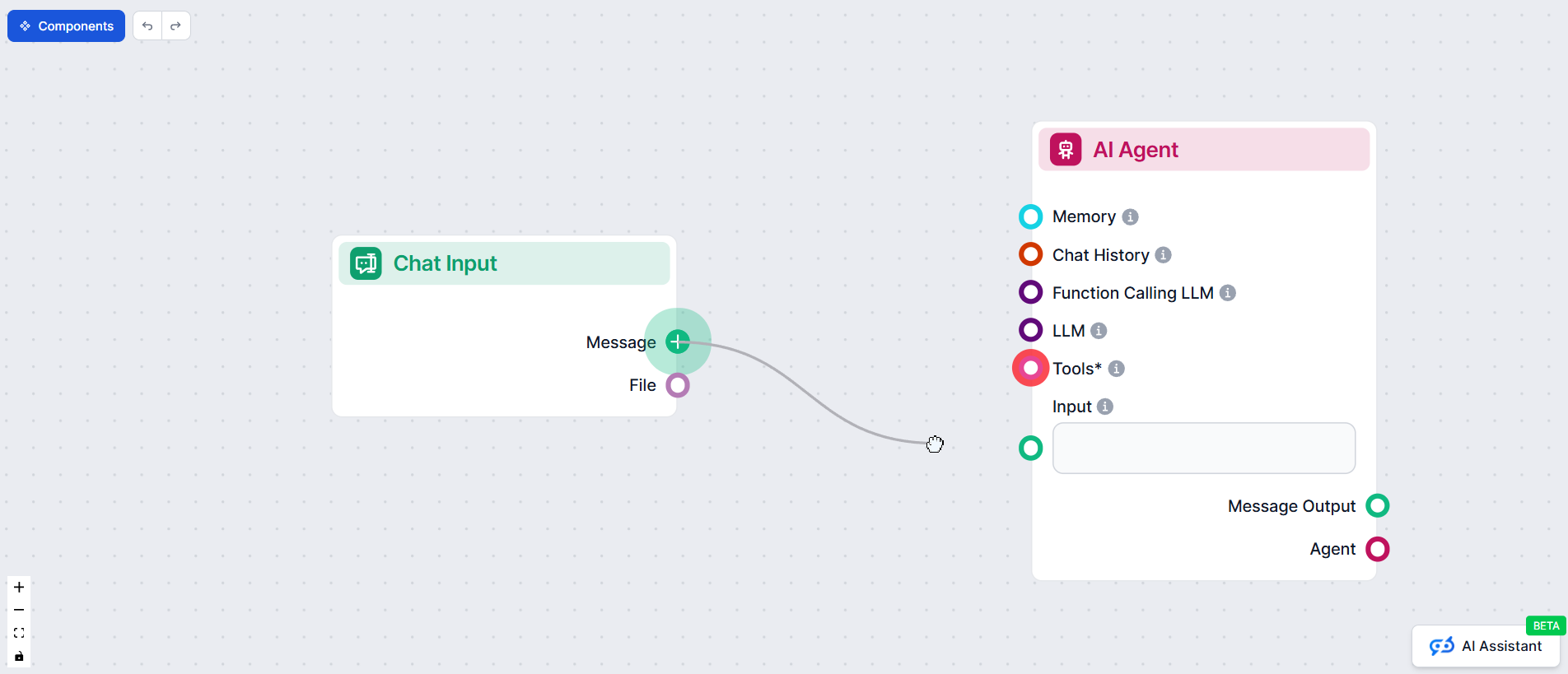

لست بحاجة إلى أن تكون مهندس برمجيات لبناء نمط orchestrator + subagent. يُطابق بنّاء FlowHunt البصري بشكل نظيف عقد الـ subagent: عقدة orchestrator تملك المحادثة، عقد العمال تعمل بـ system prompt خاص بها، والوصلات تحمل brief منظَّمًا للخارج وملخصًا للداخل.

أدناه إرشاد مدته 45 دقيقة لخط أنابيب أبحاث محتوى يستخدم نمط الإجماع.

سجّل الدخول إلى FlowHunt وانقر Create New Workflow. سمِّه Content Research Pipeline. اضبط trigger على Manual. يحتوي workflow على ثلاثة أدوار: orchestrator يملك طلب المستخدم، research subagent (قراءة قابلة للتوازي)، و fact-check subagent (قراءة قابلة للتوازي). يُعيد كلا الـ subagent ملخصات.

أضِف عقدة Google Search. اضبطها لتأخذ موضوعًا كمدخل، وتُعيد أعلى 5 نتائج، وتستبعد الإعلانات، وتُصدر URL والعنوان والمقتطف والتاريخ.

أضِف عقدة OpenAI في المرحلة التالية. هذا هو فتحة “system prompt” للـ subagent. أعطه prompt مخصّصًا ومركّزًا:

أنت research subagent. من نتائج البحث،

استخرج الادعاءات الواقعية مع URL المصادر وتواريخ النشر.

المخرجات هي قائمة JSON من كائنات {claim, url, date}.

الحدود: لا تُركّب، لا تُلخّص، لا تُعلّق.

هذا هو نمط P2: prompt مخصّص للـ subagent، محدود النطاق. اربط Google Search → OpenAI Extraction.

أضِف عقدة Text Synthesis. مهمتها هي تنظيم مخرجات الـ research subagent في outline منظَّم — قسم واحد لكل موضوع، كلٌّ مدعوم بادعاءات المصادر.

أضِف عقدة OpenAI لصياغة المقال. أعطها prompt مركّزًا: outline داخل، draft خارج. اربط Synthesis → OpenAI Generation.

أضِف عقدة AI Agent مكوَّنة كـ fact-checker. يبدو الـ brief المنظَّم مثل وصفة Anthropic — هدف، صيغة، أدوات، حدود:

الهدف: التحقق من كل ادعاء واقعي في draft المقال.

صيغة المخرجات: draft مُعلَّق بحالة التحقق لكل ادعاء

(verified | unverified | contradicted) و confidence score من 0–1.

الأدوات: knowledge base lookup، web search.

الحدود: لا تُعد كتابة المقال. ضع علامات، لا تُصحّح.

أضِف Markdown formatter كعقدة المخرجات النهائية. اربط Fact-Checker → Markdown.

Research subagent → Synthesis → Fact-Check subagent → Output. كل وصلة تحمل مخرجات الخطوة السابقة باعتبارها brief منظَّمًا للخطوة التالية.

هذا تسلسلي بدلًا من fan-out، وهو مناسب هنا — يحتاج التركيب إلى مخرجات البحث، ويحتاج fact-check إلى التركيب. إذا أردت التوسّع إلى عشرة استعلامات بحث فرعية بالتوازي، فستستبدل عقدة البحث الواحدة بـ fan-out: orchestrator يُنشئ N من subagents بالتوازي، كلٌّ يأخذ استعلامًا فرعيًا واحدًا من brief منظَّم، كلٌّ يُعيد ملخصه الخاص، ويدمج الـ orchestrator قبل التمرير إلى التركيب.

انقر Run Workflow. قدّم موضوعًا مثل “ما هو الحوسبة الكمومية؟”. توقّع ~45–60 ثانية من البداية إلى النهاية. راقب مخرجات كل عقدة في واجهة FlowHunt لرؤية ما تلقاه كل subagent كـ brief وما أعاده.

بعد التحقق، انشر إلى webhook، أو جدول، أو trigger يدوي. اضبط وجهة المخرجات (email، Slack، Google Drive، قاعدة بيانات). فعّل التسجيل لكل دور — اكتشاف Anthropic أن “80% من التباين هو إنفاق الرموز” يجعل من قياسات الرموز لكل دور شرطًا أساسيًا لأي ضبط.

قائمة قصيرة بأشياء تُوصي بها أدبيات 2025–2026 صراحة بعدم القيام بها:

هذه هي حالات الاستخدام التي يستحق فيها نمط orchestrator + subagent علاوته.

يستعلم research subagent APIs وقواعد البيانات الأكاديمية والمستندات الداخلية ويُعيد ملخصًا منظَّمًا للمصادر. تُنظّم خطوة التركيب النتائج في outline. يتحقق fact-check subagent من الادعاءات بدرجات ثقة. تُبلّغ فِرَق الإنتاج عن تخفيض ~70% من وقت fact-checking وزيادة 40% في إنتاج المحتوى — أرقام متّسقة مع sweet spot القراءة القابلة للتوازي.

يسحب data-enrichment subagent بيانات الملف الشخصي من CRM، Clearbit/Apollo، LinkedIn، وسلوك الموقع — قراءات متوازية حقيقية من مصادر مستقلة. يُقارن scoring subagent مع ICP ويُعيّن درجة. يُطابق routing subagent العملاء المحتملين عالي الدرجات مع المندوب الصحيح بناءً على المنطقة والحمل. مُبلَّغ: زيادة 35% في معدل التحويل، تخفيض 50% في وقت معالجة العملاء المحتملين.

يستخرج first-line subagent نوع التذكرة والمشاعر ويُحاول الحل من knowledge base. يُقيّم escalation subagent النتيجة ويُوجّه إلى المتخصص الصحيح. يُحزّم handoff subagent السياق للإنسان. يخدم نمط orchestrator هنا معيار النطاق المنفصل: للفوترة والدعم التقني والشكاوى أدوات مختلفة وصلاحيات وصول بيانات مختلفة.

تعمل collection subagents متوازية — news scraper، agent مالي، agent للمشاعر الاجتماعية، مراقب مواقع المنافسين — في fan-out حقيقي. يستلم analysis subagent الملخصات الأربعة ويُحدّد الاتجاهات. يُصيغ report subagent الملخص التنفيذي. هذا هو الأقرب إلى نظام الأبحاث متعدد الوكلاء من Anthropic لعام 2025، وحالة الاستخدام الأكثر دعمًا بأرقام AORCHESTRA لعام 2026.

مستقبل الذكاء الاصطناعي ليس نموذجًا فائق الذكاء واحدًا، وليس سربًا متعاونًا من الـ peers. إنه منسّق واحد يملك السياق ومجموعة صغيرة من العمال المنضبطين والمعزولين الذين يُعيدون ملخصات. هذا هو النمط الذي يدعمه البحث، وهذا هو النمط الذي بُني FlowHunt ليجعله سهلًا.

{{ cta-dark-panel heading=“ابنِ أول نظام ذكاء اصطناعي متعدد الوكلاء اليوم” description=“يجعل بنّاء سير العمل بدون كود من FlowHunt من السهل إنشاء نمط orchestrator + subagent، واختباره، ونشره. ابدأ بحساب مجاني وابنِ خط أنابيب من 3 وكلاء في أقل من ساعة.” ctaPrimaryText=“جرّب FlowHunt مجانًا” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“احجز عرضًا توضيحيًا” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#3b82f6” gradientEndColor="#8b5cf6” gradientId=“multi-agent-cta” }}

ياشا مطور برمجيات موهوب متخصص في بايثون وجافا وتعلم الآلة. يكتب ياشا مقالات تقنية عن الذكاء الاصطناعي، وهندسة البرومبت، وتطوير روبوتات الدردشة.

يجعل بنّاء سير العمل بدون كود من FlowHunt من السهل إنشاء وتنسيق عدة وكلاء ذكاء اصطناعي. ابدأ بأتمتة المهام المعقدة في دقائق — دون الحاجة إلى البرمجة.

استكشف أفضل منصات بناء وكلاء الذكاء الاصطناعي في عام 2026، من المنصات بدون كود إلى أطر العمل المخصصة للمؤسسات. اكتشف الأدوات الأنسب لاستخدامك وكيف تعزز FlowHunt...

اكتشف كيف يُحدث الذكاء الاصطناعي الوكيل وأنظمة الوكلاء المتعددة ثورة في أتمتة سير العمل من خلال اتخاذ القرار الذاتي، والقدرة على التكيف، والتعاون—ما يعزز الكفاء...

دليل شامل لأفضل منصات بناء الوكلاء الذكيين في عام 2025، مع استعراض FlowHunt.io و OpenAI و Google Cloud. اكتشف مراجعات مفصلة، تصنيفات ومقارنات للمطورين والمؤسسات...