Mistral AI

Zjistěte více o Mistral AI a modelech LLM, které nabízí. Objevte, jak se tyto modely používají a čím se odlišují od ostatních.

LLM Mistral na FlowHunt umožňuje flexibilní integraci pokročilých AI modelů Mistral pro plynulé generování textu v chatbotech a AI nástrojích.

Popis komponenty

Komponenta LLM Mistral propojuje modely Mistral s vaším tokem. Zatímco Generátory a Agenti jsou místem, kde se odehrává skutečné kouzlo, LLM komponenty vám umožňují řídit použitý model. Všechny komponenty mají ve výchozím nastavení ChatGPT-4. Pokud si přejete model změnit nebo získat nad ním větší kontrolu, můžete připojit tuto komponentu.

Pamatujte, že připojení LLM komponenty je volitelné. Všechny komponenty využívající LLM mají jako výchozí model ChatGPT-4o. LLM komponenty umožňují změnit model a nastavit jeho parametry.

Tokeny představují jednotlivé jednotky textu, které model zpracovává a generuje. Využití tokenů se mezi modely liší a jeden token může znamenat slovo, část slova nebo jeden znak. Modely jsou obvykle účtovány v milionech tokenů.

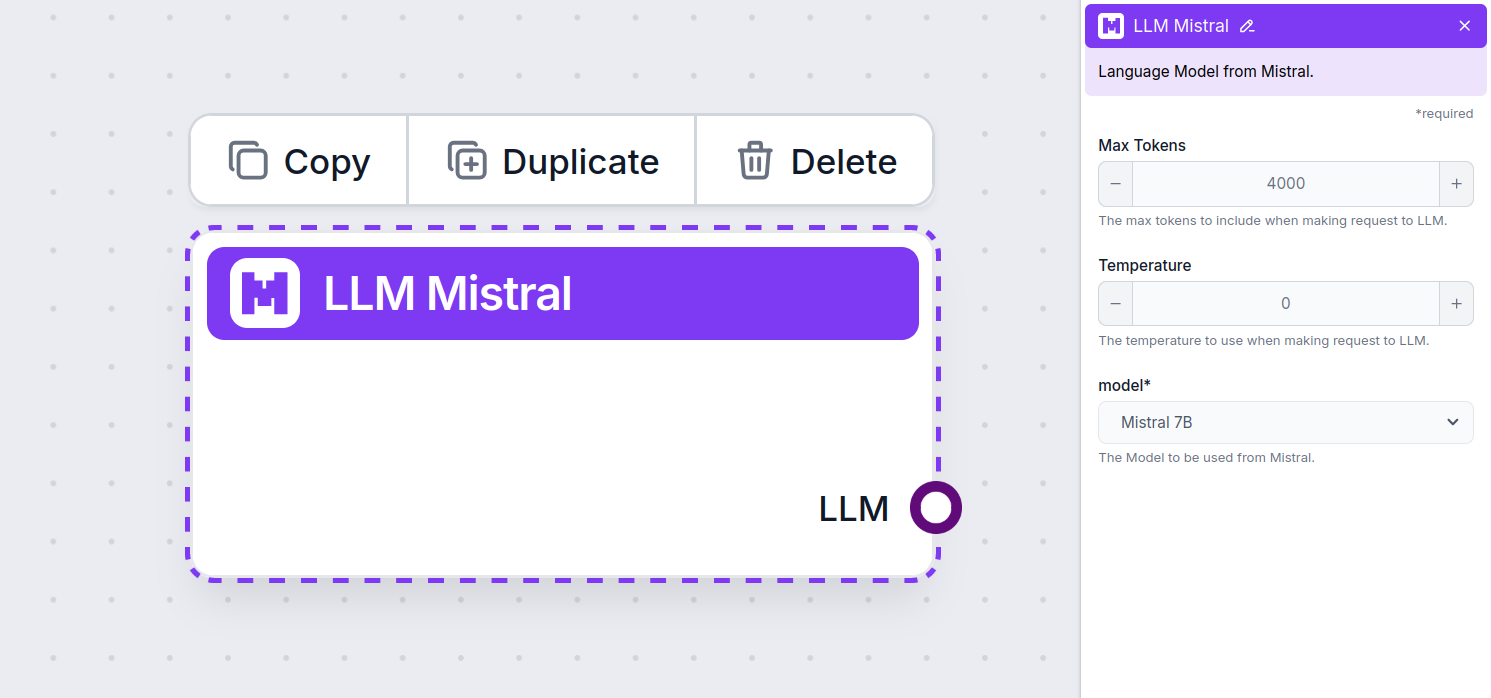

Nastavení max tokenů omezuje celkový počet tokenů, které lze zpracovat během jedné interakce nebo požadavku, a zajišťuje, že odpovědi budou generovány v rozumných mezích. Výchozí limit je 4 000 tokenů, což je optimální velikost například pro sumarizaci dokumentů nebo více zdrojů pro vytvoření odpovědi.

Teplota určuje variabilitu odpovědí a pohybuje se od 0 do 1.

Teplota 0,1 zajistí, že odpovědi budou velmi věcné, ale mohou být opakující se a méně bohaté.

Vysoká teplota 1 umožňuje maximální kreativitu v odpovědích, ale zvyšuje riziko irelevantních nebo dokonce halucinačních výstupů.

Doporučená teplota pro chatboty zákaznické podpory je například mezi 0,2 a 0,5. Tato úroveň udrží odpovědi relevantní a podle scénáře, ale umožní přirozenou variabilitu.

Zde vybíráte konkrétní model. Najdete zde všechny podporované modely Mistral. Aktuálně podporujeme tyto modely:

Jak přidat LLM Mistral do vašeho toku

Všimnete si, že všechny LLM komponenty mají pouze výstupní konektor. Vstup přes komponentu neprochází, protože reprezentuje pouze model, zatímco generování probíhá v AI Agentech a Generátorech.

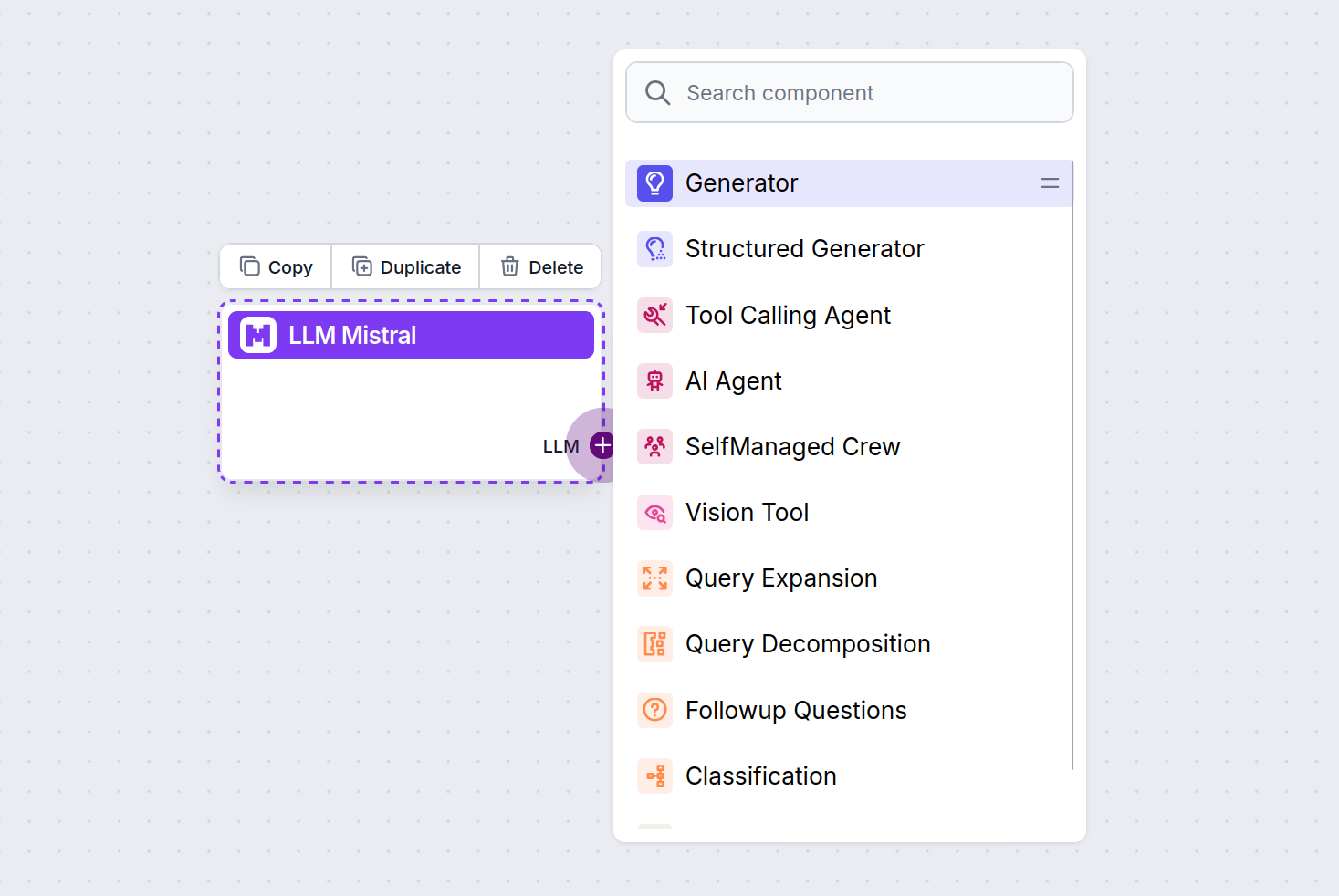

Konektor LLM je vždy fialový. Vstupní konektor LLM najdete na každé komponentě, která využívá AI pro generování textu nebo zpracování dat. Možnosti zobrazíte kliknutím na konektor:

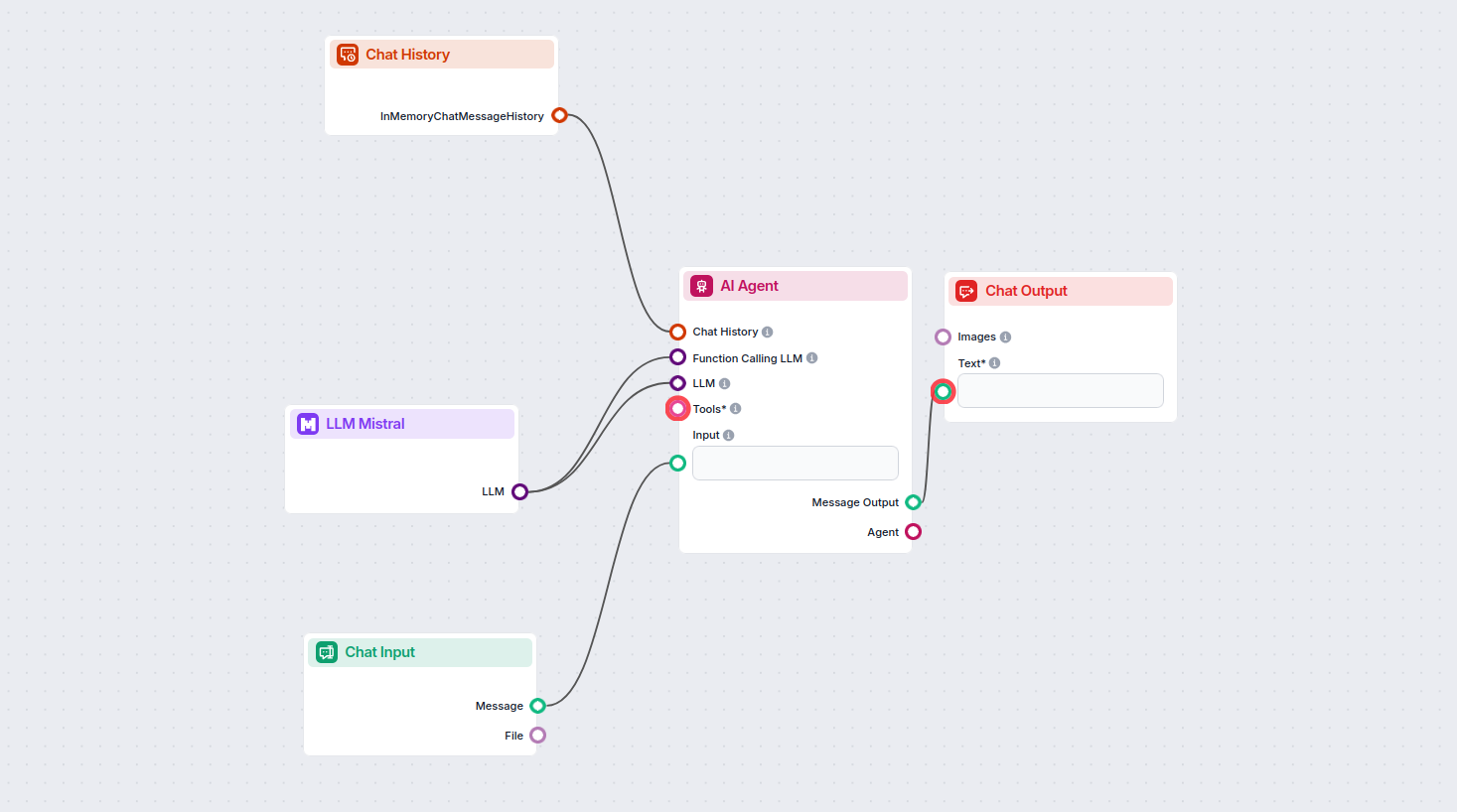

To vám umožní vytvářet různé nástroje. Podívejme se na komponentu v akci. Zde je jednoduchý tok AI Agenta, který využívá model Mistral 7B k vygenerování odpovědí. Můžete si to představit jako základní Mistral chatbot.

Tento jednoduchý Chatbot Flow zahrnuje:

Začněte stavět chytřejší AI chatboty a nástroje integrací výkonných jazykových modelů Mistral s FlowHunt bez nutnosti kódování.

Zjistěte více o Mistral AI a modelech LLM, které nabízí. Objevte, jak se tyto modely používají a čím se odlišují od ostatních.