Přepisovač vět

Objevte, co je AI přepisovač vět, jak funguje, jeho použití a jak pomáhá spisovatelům, studentům a marketérům přeformulovat text při zachování významu a zlepšen...

OpenAI Whisper je open-source ASR systém, který přesně převádí řeč na text v 99 jazycích, podporuje přepis, překlad a identifikaci jazyka pro robustní AI automatizaci.

OpenAI Whisper lze považovat jak za model, tak za systém, podle kontextu.

Hlavní funkcí Whisperu je přepis mluvené řeči do textového výstupu. Vyniká v:

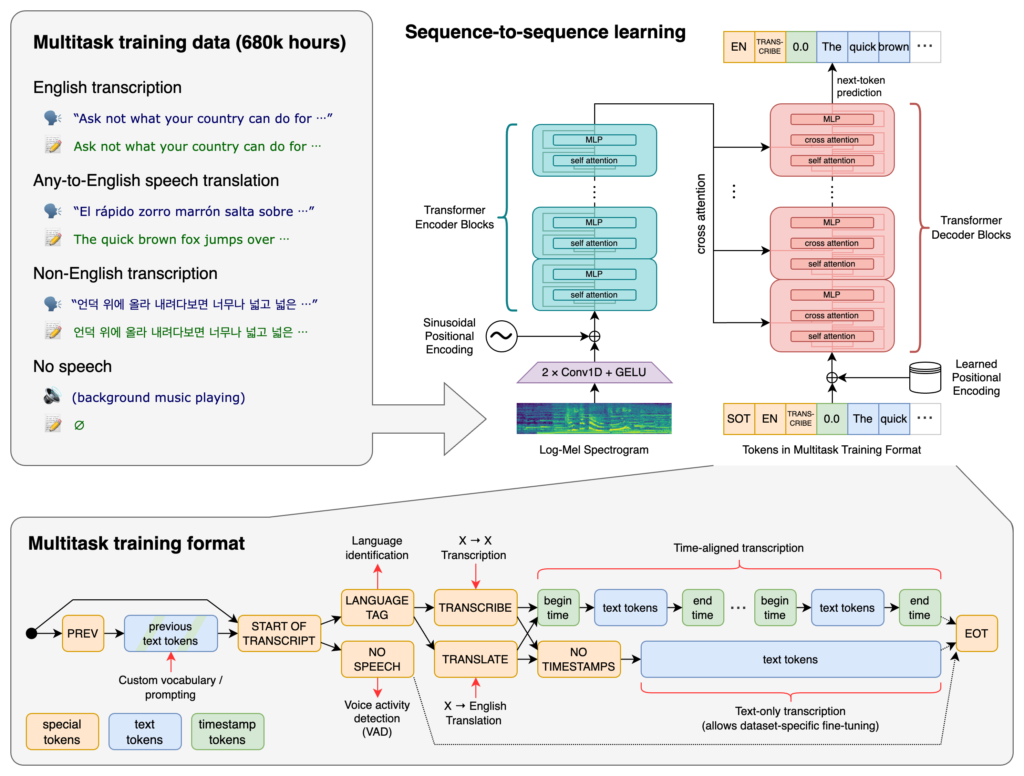

Základem Whisperu je transformerová architektura, konkrétně model enkodér-dekodér. Transformery jsou neuronové sítě, které vynikají ve zpracování sekvenčních dat a rozumí kontextu i na dlouhých sekvencích. Byly představeny v článku “Attention is All You Need” v roce 2017 a staly se základem mnoha NLP úloh.

Proces Whisperu zahrnuje:

Whisper byl trénován na obrovském datasetu 680 000 hodin supervizovaných dat získaných z webu. Ten obsahuje:

Díky pokrytí 99 jazyků vyniká Whisper schopností zvládat rozmanité jazykové vstupy. Tato vícejazyčná kapacita je vhodná pro globální aplikace a služby zaměřené na mezinárodní publikum.

Díky rozsáhlým trénovacím datům dosahuje Whisper vysoké přesnosti v přepisovacích úlohách. Jeho robustnost vůči různým přízvukům, dialektům i šumu zajišťuje spolehlivost v reálných scénářích.

Kromě přepisu dokáže Whisper:

Whisper je uvolněn jako open-source software, což umožňuje:

Integrací Whisperu do chatbotů a AI asistentů mohou vývojáři umožnit:

Whisper je implementován jako Python knihovna, což umožňuje snadnou integraci do Python projektů. Použití Whisperu v Pythonu zahrnuje nastavení prostředí, instalaci potřebných závislostí a využití funkcí knihovny pro přepis nebo překlad audio souborů.

Než začnete Whisper používat, připravte si vývojové prostředí instalací Pythonu, PyTorch, FFmpeg a samotné knihovny Whisper.

Pokud nemáte Python, stáhněte jej z oficiálních stránek. Pro instalaci PyTorch použijte pip:

pip install torch

Nebo navštivte stránky PyTorch pro konkrétní instrukce dle OS a verze Pythonu.

Whisper ke zpracování audia vyžaduje FFmpeg. Instalujte jej vhodným balíčkovacím systémem pro váš operační systém.

Ubuntu/Debian:

sudo apt update && sudo apt install ffmpeg

MacOS (Homebrew):

brew install ffmpeg

Windows (Chocolatey):

choco install ffmpeg

Nainstalujte Whisper Python balíček pomocí pip:

pip install -U openai-whisper

Pro instalaci nejnovější verze přímo z GitHub repozitáře:

pip install git+https://github.com/openai/whisper.git

Ujistěte se, že je zapnutý vývojářský režim:

Whisper nabízí několik modelů různých velikostí a schopností. Modely sahají od tiny až po large, přičemž každý má jiné kompromisy mezi rychlostí a přesností.

| Velikost | Parametry | Model pouze pro angličtinu | Vícejazyčný model | Potřebná VRAM | Relativní rychlost |

|---|---|---|---|---|---|

| tiny | 39 M | tiny.en | tiny | ~1 GB | ~32x |

| base | 74 M | base.en | base | ~1 GB | ~16x |

| small | 244 M | small.en | small | ~2 GB | ~6x |

| medium | 769 M | medium.en | medium | ~5 GB | ~2x |

| large | 1550 M | N/A | large | ~10 GB | 1x |

.en): Optimalizované pro anglický přepis, vyšší přesnost u anglického audia.Po nastavení prostředí a instalaci komponent můžete začít Whisper využívat ve svých Python projektech.

Začněte importem knihovny Whisper a načtením modelu:

import whisper

# Načtěte požadovaný model

model = whisper.load_model("base")

Nahraďte "base" názvem modelu, který odpovídá vaší aplikaci.

Whisper nabízí jednoduchou funkci transcribe pro převod audio souborů na text.

Příklad: Přepis anglického audio souboru

# Přepis audio souboru

result = model.transcribe("path/to/english_audio.mp3")

# Výpis přepisu

print(result["text"])

model.transcribe(): Zpracuje audio soubor a vrátí slovník obsahující přepis i další metadata.result["text"]: Vrátí samotný přepsaný text.Whisper zvládá překlad audia z různých jazyků do angličtiny.

Příklad: Překlad španělského audia do angličtiny

# Přepis a překlad španělského audia do angličtiny

result = model.transcribe("path/to/spanish_audio.mp3", task="translate")

# Výpis přeloženého textu

print(result["text"])

task="translate": Zadává modelu, aby místo doslovného přepisu provedl překlad do angličtiny.Whisper zvládne jazyk detekovat automaticky, ale jeho zadání může zvýšit přesnost a rychlost.

Příklad: Přepis francouzského audia

# Přepis francouzského audia se specifikací jazyka

result = model.transcribe("path/to/french_audio.wav", language="fr")

# Výpis přepisu

print(result["text"])

Whisper umí identifikovat jazyk mluvený v audio souboru pomocí metody detect_language.

Příklad: Detekce jazyka

# Načtení a předzpracování audia

audio = whisper.load_audio("path/to/unknown_language_audio.mp3")

audio = whisper.pad_or_trim(audio)

# Převod na log-Mel spektrogram

mel = whisper.log_mel_spectrogram(audio).to(model.device)

# Detekce jazyka

_, probs = model.detect_language(mel)

language = max(probs, key=probs.get)

print(f"Detekovaný jazyk: {language}")

whisper.load_audio(): Načte audio soubor.whisper.pad_or_trim(): Upraví délku audia pro vstupní požadavky modelu.whisper.log_mel_spectrogram(): Převádí audio do formátu očekávaného modelem.model.detect_language(): Vrací pravděpodobnosti pro každý jazyk a určí nejpravděpodobnější.Pro detailnější řízení přepisu lze využít nižší úrovně funkcí a přizpůsobit dekódovací volby.

decodeFunkce decode umožňuje specifikovat volby jako jazyk, úlohu nebo zda zahrnout časové značky.

Příklad: Vlastní dekódovací volby

# Nastavení dekódovacích voleb

options = whisper.DecodingOptions(language="de", without_timestamps=True)

# Dekódování audia

result = whisper.decode(model, mel, options)

# Výpis rozpoznaného textu

print(result.text)

Whisper lze integrovat pro přepis živého zvuku z mikrofonu.

Příklad: Přepis živého vstupu z mikrofonu

import whisper

import sounddevice as sd

# Načtení modelu

model = whisper.load_model("base")

# Nahrávání zvuku z mikrofonu

duration = 5 # sekundy

fs = 16000 # Vzorkovací frekvence

print("Nahrávám...")

audio = sd.rec(int(duration * fs), samplerate=fs, channels=1, dtype='float32')

sd.wait

OpenAI Whisper je pokročilý systém automatického rozpoznávání řeči (ASR) vyvinutý OpenAI, určený pro přepis mluveného jazyka do psaného textu pomocí hlubokého učení. Podporuje 99 jazyků a vyniká v transkripci, překladu i identifikaci jazyka.

Whisper používá architekturu enkodér-dekodér založenou na transformerech, zpracovává zvuk do log-Mel spektrogramů a vytváří textový výstup pomocí jazykového modelu. Byl natrénován na 680 000 hodin vícejazyčných, multitask dat pro vysokou přesnost a robustnost.

Whisper podporuje vícejazyčné rozpoznávání řeči, překlad řeči, automatickou identifikaci jazyka, odolnost vůči přízvukům a šumu a poskytuje open-source přístup pro přizpůsobení a integraci.

Hardwarové požadavky závisí na velikosti modelu: menší modely jako 'tiny' potřebují ~1GB VRAM, největší vyžaduje ~10GB. Whisper běží rychleji na GPU, ale lze jej provozovat i na CPU s delší dobou zpracování.

Ano, Whisper je implementován jako Python knihovna a lze jej instalovat přes pip. Umožňuje snadnou integraci do Python projektů pro přepis řeči, překlad a hlasové aplikace v reálném čase.

Mezi běžné příklady patří automatizovaný přepis schůzek, hlasově ovládaní chatboti, živý překlad, nástroje pro přístupnost (titulky a asistivní technologie), automatizace call center a hlasem ovládané automatizační systémy.

Ano, alternativy zahrnují open-source enginy jako Mozilla DeepSpeech, Kaldi, Wav2vec a komerční API jako Google Cloud Speech-to-Text, Microsoft Azure AI Speech a AWS Transcribe.

Ano, OpenAI Whisper je open-source, což umožňuje vývojářům jej přizpůsobit, doladit a integrovat do vlastních produktů a služeb bez licenčních omezení.

Integrujte pokročilé schopnosti převodu řeči na text do svých aplikací, automatizujte workflow a zlepšete uživatelskou zkušenost s OpenAI Whisper a FlowHunt.

Objevte, co je AI přepisovač vět, jak funguje, jeho použití a jak pomáhá spisovatelům, studentům a marketérům přeformulovat text při zachování významu a zlepšen...

Perplexity AI je pokročilý vyhledávač poháněný umělou inteligencí a konverzační nástroj, který využívá NLP a strojové učení k poskytování přesných, kontextových...

Odemkněte sílu vlastních jazykových modelů s komponentou Vlastní OpenAI LLM ve FlowHunt. Bezproblémově integrujte své vlastní modely kompatibilní s OpenAI – vče...