Vektor vnoření

Vektor vnoření je hustá číselná reprezentace dat v mnohorozměrném prostoru, která zachycuje sémantické a kontextové vztahy. Zjistěte, jak vektory vnoření poháně...

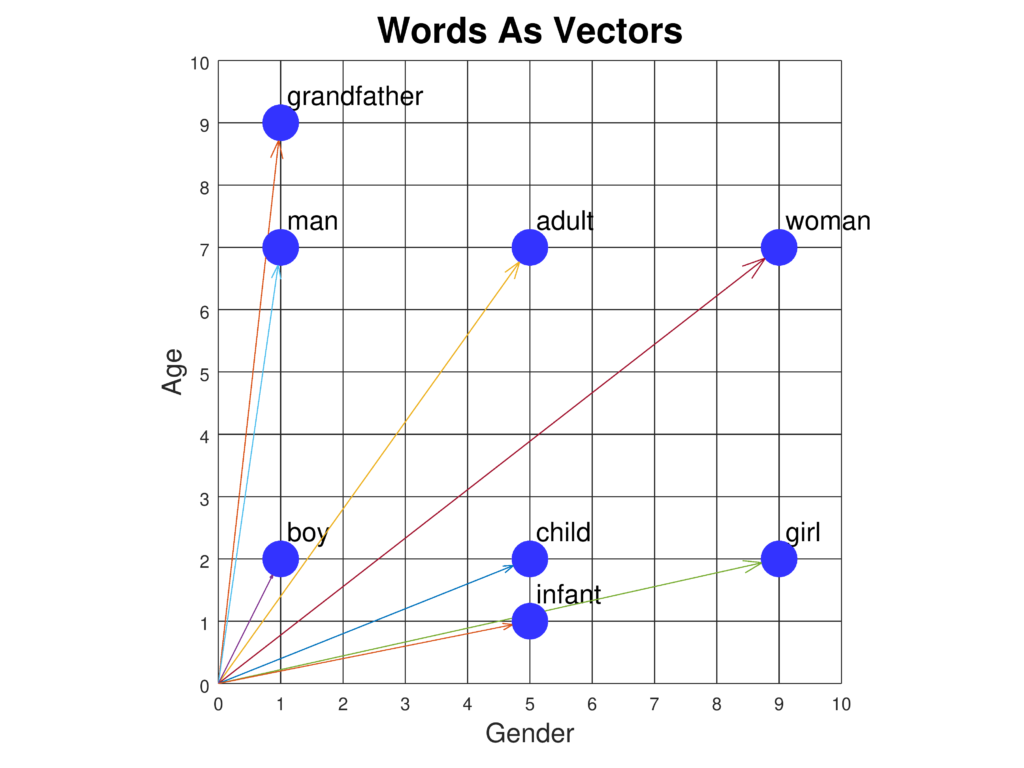

Vektorové reprezentace slov mapují slova do vektorů v plynulém prostoru, zachycují jejich význam a kontext pro vylepšené NLP aplikace.

Vektorové reprezentace slov hrají klíčovou roli v NLP a propojují lidsko-počítačovou komunikaci. Objevte jejich klíčové aspekty, principy fungování a využití dnes z několika důvodů:

Výzkum v oblasti vektorových reprezentací slov v NLP

Learning Word Sense Embeddings from Word Sense Definitions

Qi Li, Tianshi Li, Baobao Chang (2016) představují metodu, která řeší problém polysémních a homonymních slov ve vektorových reprezentacích pomocí tvorby jednoho embeddingu pro každý význam slova na základě jeho definice. Jejich přístup využívá trénování na korpusu pro dosažení vysoce kvalitních embeddingů významů slov. Experimentální výsledky ukazují zlepšení v úlohách podobnosti slov a disambiguace významu. Studie demonstruje potenciál embeddingů významů slov pro rozšíření NLP aplikací. Více zde

Neural-based Noise Filtering from Word Embeddings

Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016) představují dva modely pro vylepšení vektorových reprezentací slov pomocí filtrace šumu. Identifikují zbytečné informace v tradičních embeddingech a navrhují nesupervizované techniky pro tvorbu embeddingů bez šumu. Tyto modely využívají hlubokou dopřednou neuronovou síť ke zvýraznění podstatných informací a minimalizaci šumu. Výsledky ukazují lepší výkon embeddingů bez šumu v benchmarkových úlohách. Více zde

A Survey On Neural Word Embeddings

Erhan Sezerer, Selma Tekir (2021) přinášejí komplexní přehled neuronových embeddingů slov, mapují jejich vývoj a dopad na NLP. Přehled pokrývá základní teorie a zkoumá různé typy embeddingů, jako jsou embeddingy významů, morfémové a kontextuální embeddingy. Práce také diskutuje benchmarkové datasety a srovnání výkonu, zdůrazňuje transformační vliv neuronových embeddingů na NLP úlohy. Více zde

Improving Interpretability via Explicit Word Interaction Graph Layer

Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023) se zaměřují na zvýšení interpretovatelnosti modelů v NLP pomocí WIGRAPH, vrstvy neuronové sítě, která vytváří globální graf interakcí mezi slovy. Tuto vrstvu lze integrovat do libovolného NLP klasifikátoru textu, čímž zlepšuje jak interpretovatelnost, tak přesnost predikce. Studie zdůrazňuje význam interakcí mezi slovy pro pochopení rozhodnutí modelu. Více zde

Word Embeddings for Banking Industry

Avnish Patel (2023) zkoumá využití embeddingů slov v bankovnictví, zejména jejich úlohu v analýze sentimentu a klasifikaci textu. Studie se zabývá využitím jak statických embeddingů (např. Word2Vec, GloVe), tak kontextuálních modelů a zdůrazňuje jejich dopad na oborově specifické NLP úlohy. Více zde

Vektorové reprezentace slov jsou husté vektorové reprezentace, které mapují sémanticky podobná slova do blízkých bodů v plynulém prostoru, což umožňuje modelům rozumět kontextu a vztahům v jazyce.

Zlepšují NLP úlohy tím, že zachycují sémantické a syntaktické vztahy, snižují rozměrnost dat, umožňují transfer learning a zlepšují práci se vzácnými slovy.

Mezi oblíbené techniky patří Word2Vec, GloVe, FastText a TF-IDF. Neuronové modely jako Word2Vec a GloVe se učí embeddingy z velkých textových korpusů, zatímco FastText zahrnuje informace o podslovech.

Klasické embeddingy mají potíže s polysémií (slova s více významy), mohou přenášet zkreslení z dat a jejich trénink na velkých korpusech vyžaduje značné výpočetní zdroje.

Používají se v klasifikaci textu, strojovém překladu, rozpoznávání pojmenovaných entit, vyhledávání informací a systémech pro odpovídání na dotazy k vylepšení přesnosti a pochopení kontextu.

Začněte budovat pokročilá AI řešení s intuitivními nástroji pro NLP, včetně vektorových reprezentací slov a dalšího.

Vektor vnoření je hustá číselná reprezentace dat v mnohorozměrném prostoru, která zachycuje sémantické a kontextové vztahy. Zjistěte, jak vektory vnoření poháně...

Zpracování přirozeného jazyka (NLP) umožňuje počítačům porozumět, interpretovat a generovat lidský jazyk s využitím počítačové lingvistiky, strojového učení a h...

Zpracování přirozeného jazyka (NLP) je podoblorem umělé inteligence (AI), který umožňuje počítačům rozumět, interpretovat a generovat lidský jazyk. Objevte klíč...