AI Red Teaming vs. tradiční penetrační testování: Klíčové rozdíly

AI red teaming a tradiční penetrační testování řeší různé aspekty bezpečnosti AI. Tento průvodce vysvětluje klíčové rozdíly, kdy použít jednotlivé přístupy a pr...

AI red teaming je strukturované adversariální bezpečnostní cvičení, při kterém specialisté systematicky zkoumají AI systémy — LLM chatboty, agenty a pipeline — pomocí realistických útočných technik za účelem identifikace zranitelností dříve, než je objeví škodliví aktéři.

AI red teaming aplikuje vojenský koncept adversariálních cvičení “red team vs. blue team” na bezpečnostní hodnocení systémů umělé inteligence. Red team specialistů přijímá myšlení a techniky útočníků a zkoumá AI systém s cílem nalézt zneužitelné zranitelnosti, porušení politik a selhání.

Termín “red teaming” pochází z vojenské strategie — označuje skupinu pověřenou zpochybňováním předpokladů a simulací chování protivníka. V kybernetické bezpečnosti provádějí red teamy adversariální testování systémů a organizací. AI red teaming rozšiřuje tuto praxi na jedinečné charakteristiky systémů založených na LLM.

Po vysoce medializovaných incidentech zahrnujících manipulaci s chatboty, jailbreaking a exfiltraci dat organizace včetně Microsoftu, Google, OpenAI a vlády USA významně investovaly do AI red teamingu jako bezpečnostní praxe.

I když jsou příbuzné, AI red teaming a tradiční penetrační testování řeší různé modely hrozeb:

| Aspekt | AI Red Teaming | Tradiční penetrační testování |

|---|---|---|

| Primární rozhraní | Přirozený jazyk | Síťové/aplikační protokoly |

| Útočné vektory | Prompt injection, jailbreaking, manipulace s modelem | SQL injection, XSS, obcházení autentizace |

| Selhání | Porušení politik, halucinace, drift chování | Poškození paměti, eskalace oprávnění |

| Nástroje | Vlastní prompty, adversariální datasety | Skenovací nástroje, exploit frameworky |

| Požadovaná expertíza | Architektura LLM + bezpečnost | Síťová/webová bezpečnost |

| Výsledky | Behaviorální nálezy + technické zranitelnosti | Technické zranitelnosti |

Většina podnikových AI nasazení má prospěch z obojího: tradičního penetračního testování pro infrastrukturu a bezpečnost API, AI red teamingu pro zranitelnosti specifické pro LLM.

Systematický red teaming používá kurátorované knihovny útoků zarovnané s frameworky jako OWASP LLM Top 10 nebo MITRE ATLAS. Každá kategorie je testována vyčerpávajícím způsobem, což zajišťuje, že pokrytí není závislé na individuální kreativitě.

Efektivní red teaming není jednorázový průchod. Úspěšné útoky jsou zdokonalovány a eskalovány, aby se prozkoumalo, zda jsou mitigace efektivní. Neúspěšné útoky jsou analyzovány, aby se pochopilo, jaké obranné mechanismy jim zabránily.

Automatizované nástroje mohou testovat tisíce variant promptů ve velkém měřítku. Ale nejsofistikovanější útoky — vícetahová manipulace, kontextově specifické sociální inženýrství, kombinace nových technik — vyžadují lidský úsudek a kreativitu.

Cvičení red teamingu by měla být založena na realistickém modelování hrozeb: kdo jsou pravděpodobní útočníci (zvědaví uživatelé, konkurenti, škodliví insideři), jaké jsou jejich motivace a jak by vypadal úspěšný útok z perspektivy dopadu na podnikání?

Pro organizace nasazující AI ve velkém měřítku zahrnuje kontinuální program red teamingu:

AI red teaming je adversariální bezpečnostní cvičení, při kterém specialisté hrají roli útočníků a systematicky zkoumají AI systém z hlediska zranitelností, porušení politik a selhání. Cílem je identifikovat slabiny dříve, než je objeví skuteční útočníci — a následně je odstranit.

Tradiční penetrační testování se zaměřuje na technické zranitelnosti v softwaru a infrastruktuře. AI red teaming přidává útočné vektory v přirozeném jazyce — prompt injection, jailbreaking, sociální inženýrství modelu — a řeší specifická selhání AI jako halucinace, nadměrné spoléhání a obcházení politik. Obě disciplíny se vzájemně doplňují.

AI red teaming je nejefektivnější, když jej provádějí specialisté, kteří rozumí jak architektuře AI/LLM, tak ofenzivním bezpečnostním technikám. Interní týmy mají cenný kontext, ale mohou mít slepá místa; externí red teamy přinášejí nové perspektivy a aktuální znalosti o útocích.

Naše AI red team cvičení používají aktuální útočné techniky k nalezení zranitelností ve vašem chatbotu dříve, než je najdou útočníci — a poskytují jasný plán nápravy.

AI red teaming a tradiční penetrační testování řeší různé aspekty bezpečnosti AI. Tento průvodce vysvětluje klíčové rozdíly, kdy použít jednotlivé přístupy a pr...

AI penetrační testování je strukturované bezpečnostní hodnocení AI systémů — včetně LLM chatbotů, autonomních agentů a RAG pipeline — pomocí simulovaných útoků ...

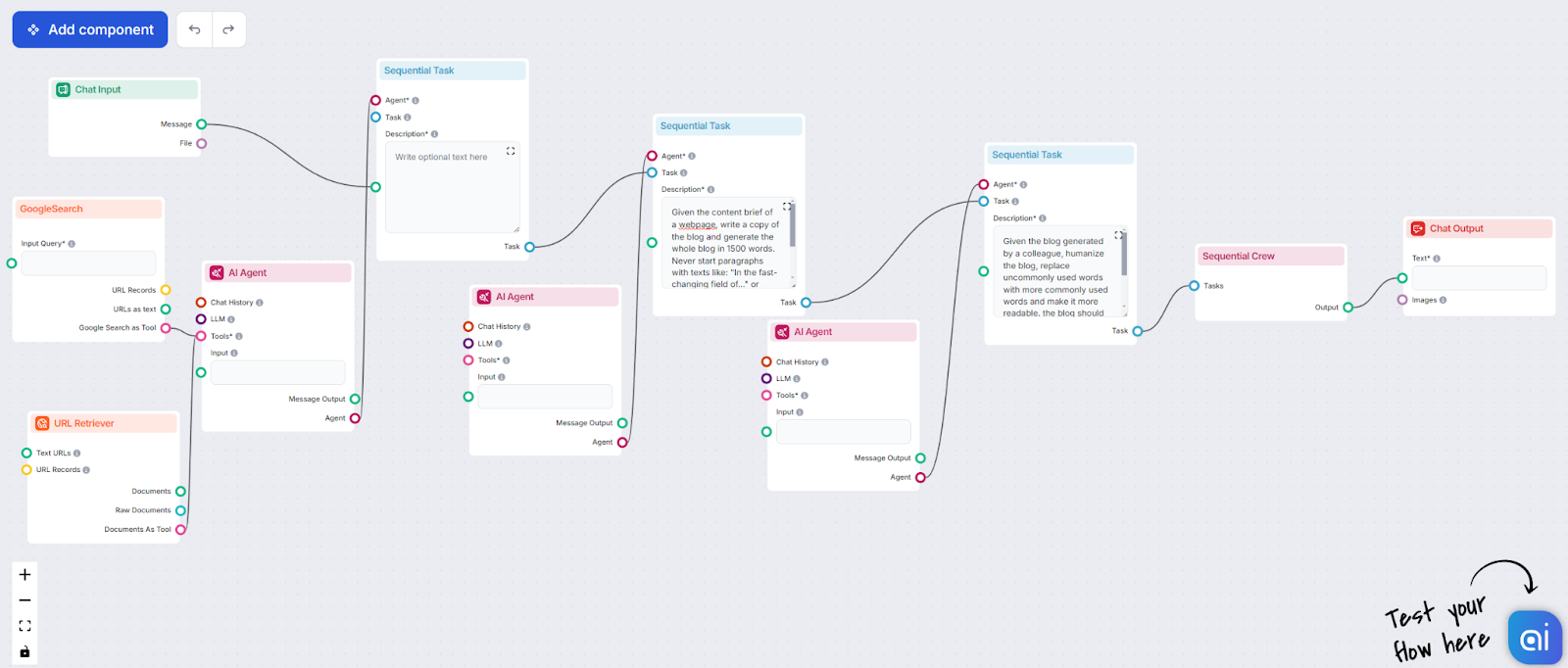

Nechte celé týmy AI spolupracovníků řešit složité úkoly. Zjistěte více o vytváření týmů agentů pomocí komponenty Sekvenční tým ve FlowHunt.