Hallucination

En hallucination i sprogmodeller opstår, når AI genererer tekst, der virker plausibel, men faktisk er forkert eller opdigtet. Lær om årsager, detektionsmetoder ...

Hvad er hallucinationer i AI, hvorfor opstår de, og hvordan kan du undgå dem? Lær at holde dine AI chatbot-svar præcise med praktiske, menneskecentrerede strategier.

AI-chatbots er klogere end nogensinde, men nogle gange finder de på ting ud af det blå. Disse fejl, kaldet “hallucinationer”, kan forvandle en hjælpsom assistent til en kilde til forvirring eller endda risiko. Hvis du vil have pålidelige svar, skal du forstå, hvad hallucinationer er, hvorfor de opstår, og hvordan du stopper dem, før de skaber problemer.

En hallucination i AI er, når en chatbot eller sprogmodel giver dig et svar, der lyder korrekt, men faktisk er falsk, opdigtet eller endda umuligt. Disse fejl er ikke tilfældige tastefejl, de er selvsikre, overbevisende udsagn uden grundlag i virkeligheden.

For eksempel kan du spørge en chatbot: “Hvem vandt Nobelprisen i Fysik i 2025?” Hvis modellen ikke har set opdateret information, kan den finde på et navn i stedet for at indrømme, at den ikke ved det. I modsætning til en søgemaskine, der returnerer “ingen resultater”, kan en chatbot udfylde hullerne, nogle gange med overbevisende men forkerte oplysninger.

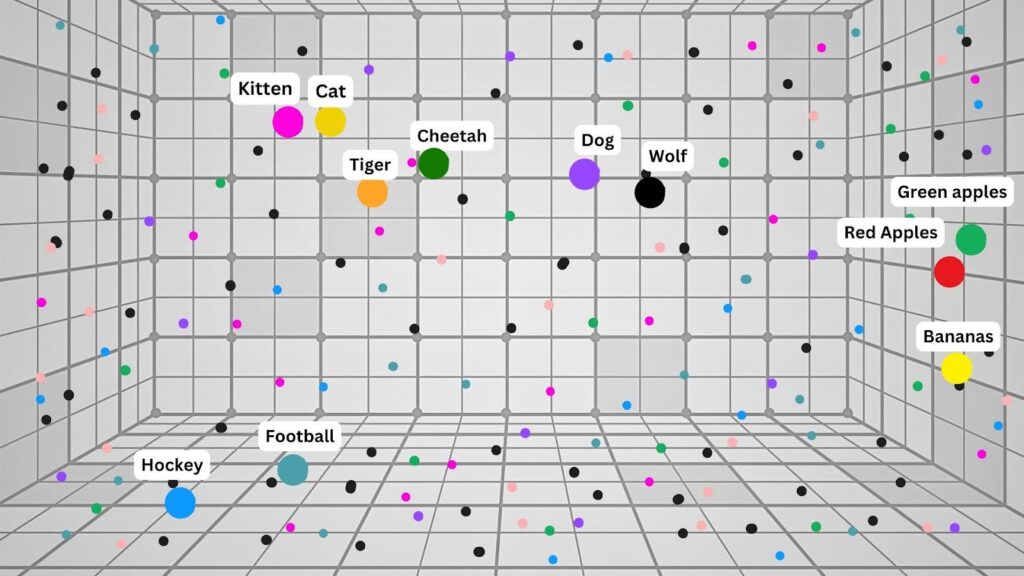

Hallucinationer er ikke en fejl, men en bivirkning af, hvordan store sprogmodeller (LLM’er) som ChatGPT, Copilot eller Gemini fungerer. Disse modeller:

Almindelige årsager til hallucinationer inkluderer:

Ingen AI er perfekt, men der findes dokumenterede måder at reducere hallucinationer og øge kvaliteten af svarene på. Her er det, der virker bedst:

Moderne AI-værktøjer kan forbinde til databaser, søgemaskiner eller virksomheds-wikier. Til kritiske opgaver skal du altid give din AI pålidelig kontekst eller pege den mod troværdige kilder.

Tag ikke bare svaret for gode varer – bed AI’en om at oplyse kilder, links eller i det mindste forklare, hvordan den er nået frem til svaret.

Eksempel på prompt:

Brug kun den vedlagte personalehåndbog og den seneste web-søgning til at besvare dette spørgsmål. Angiv venligst dine kilder og forklar din begrundelse.

Dette hjælper dig ikke kun med at verificere svaret, men lærer også AI’en at tjekke sig selv.

Jo mere specifikt dit spørgsmål er, jo bedre resultat. Fortæl AI’en, hvilken information den skal bruge, hvad den skal undgå, og hvilket format du forventer. For eksempel:

Opsummer de vigtigste fund fra den vedlagte markedsrapport (2024-udgaven). Hvis oplysninger mangler, sig “ikke fundet” i stedet for at antage noget.

Mange avancerede chatbots tilbyder realtids-søgeplugins, retrieval-augmented generation (RAG) eller integration med virksomhedens viden. Tænd altid for disse, hvis opdateret eller faktuel nøjagtighed er påkrævet.

Uanset hvor avanceret din chatbot er, er menneskelig kontrol afgørende. Gennemgå altid vigtige svar, især i følsomme områder som sundhed, økonomi eller jura.

Et “menneske i loopet” betyder:

Vil du vide mere om human-in-the-loop-strategier? Hold øje med vores kommende artikel om emnet!

AI-hallucinationer kan ske for enhver chatbot, selv de bedste. Nøglen er at forstå, hvorfor disse fejl opstår, og tage skridt til at fange dem tidligt:

Med disse vaner forvandler du din chatbot fra en “kreativ historiefortæller” til en troværdig assistent, mens du stadig har det endelige ansvar (og dømmekraft) i egne hænder.

Vil du bruge AI i dit daglige arbejde? Få praktiske guides, cases fra virkeligheden og trin-for-trin workflows lavet til travle professionelle. Fra at skrive bedre e-mails til at automatisere mødenoter hjælper AI Academy dig med at arbejde smartere med AI.

👉 Udforsk mere på AI Academy og begynd at eksperimentere i dag!

Vi hjælper virksomheder som din med at udvikle smarte chatbots, MCP-servere, AI-værktøjer eller andre typer AI-automatisering til at erstatte mennesker i gentagne opgaver i din organisation.

En hallucination i sprogmodeller opstår, når AI genererer tekst, der virker plausibel, men faktisk er forkert eller opdigtet. Lær om årsager, detektionsmetoder ...

Forbedr din AI-chatbots nøjagtighed med FlowHunts funktion til at springe indeksering over. Ekskluder uegnet indhold for at holde interaktioner relevante og sik...

Reducer AI-hallucinationer og sikr nøjagtige chatbot-svar ved at bruge FlowHunts Skema-funktion. Opdag fordelene, praktiske anvendelsestilfælde og en trin-for-t...