AI-agenter er fundamentalt anderledes end chatbots. En chatbot venter på brugerinput og reagerer. En agent forfølger mål autonomt, kalder værktøjer, ræsonnerer om problemer og udfører handlinger uden menneskelig input i hvert trin.

Denne forskel betyder noget, fordi agenter kan automatisere hele workflows. En lead-kvalificeringsagent scorer prospects, beriger deres data og tildeler dem til salgsmedarbejdere – alt sammen uden menneskelig indgriben. En agent til triage af indhold kategoriserer support-tickets, dirigerer dem til specialister og eskalerer grænsetilfælde til mennesker.

I denne guide lærer du, hvordan du arkitekterer pålidelige agenter, integrerer dem med forretningssystemer, forhindrer almindelige fejl og måler deres effekt. Vi dækker reelle mønstre brugt i produktion hos virksomheder, der automatiserer lead-kvalificering, dokumentbehandling og kundeservice i stor skala.

Hvad er AI-agenter, og hvordan adskiller de sig fra chatbots?

Definition af AI-agenter (autonome systemer, der opfatter, beslutter, handler)

En AI-agent er et softwaresystem, der:

- Opfatter sit miljø (læser input, værktøjsresultater, hukommelse)

- Ræsonnerer om den bedste handling (bruger en LLM til planlægning)

- Handler ved at kalde værktøjer eller tage skridt mod et mål

- Tilpasser sig baseret på feedback og resultater

Agenter er måldrevne. Du definerer målet (“Score og kvalificér dette lead”), og agenten finder ud af, hvordan det opnås.

Nøgleforskel: Chatbots er reaktive; agenter er autonome

Chatbots: Bruger starter → Model reagerer

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

Brugeren driver hver interaktion. Chatbotten er tilstandsløs – hvert budskab er uafhængigt.

Agenter: Måldrevne, udfører handlinger uden brugerinput i hvert trin

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

Agenten arbejder mod et defineret mål og træffer flere beslutninger og værktøjskald autonomt.

Hvorfor agenter betyder noget for workflows

Automatisering i stor skala (håndter tusindvis af opgaver uden menneskelig indgriben)

Manuel lead-kvalificering: 5 minutter pr. lead × 100 leads = 500 timer/måned. Omkostning: 10.000 USD/måned (ved 20 USD/time).

Agent-drevet: 10 sekunder pr. lead × 100 leads = 16 timer/måned. Omkostning: 100 USD (agent API-kald). Besparelse: 99 %.

Agenter multiplicerer dit teams kapacitet uden ansættelse.

Flertrins-ræsonnering (bryd komplekse problemer ned i delopgaver)

Komplekse opgaver kræver flere trin:

- Lead-kvalificering: Score → Berig → Tildel → Notificér

- Dokumenttriage: Udtræk → Klassificér → Rute → Arkivér

- Kundeservice: Forstå → Søg i vidensbase → Generér svar → Rute om nødvendigt

Agenter håndterer denne ræsonnering automatisk. Du definerer målet; agenten bryder det ned i trin.

Værktøjsbrug (agenter kalder API’er, databaser, eksterne tjenester)

Agenter er “hænder”. De kalder API’er for at:

- Forespørge databaser

- Opdatere CRM-systemer

- Sende e-mails eller Slack-beskeder

- Kalde tredjepartstjenester (databerigelse, betalingsbehandling)

En enkelt agent kan orkestrere 5-10 værktøjskald for at fuldføre et workflow.

Adaptiv adfærd (lær af feedback, juster tilgang)

Agenter kan forbedres over tid. Hvis en agent fejlklassificerer dokumenter, giver du feedback. Agenten lærer og justerer sin prompting-strategi.

Kerne-komponenter i en AI-agent (agent-loopet)

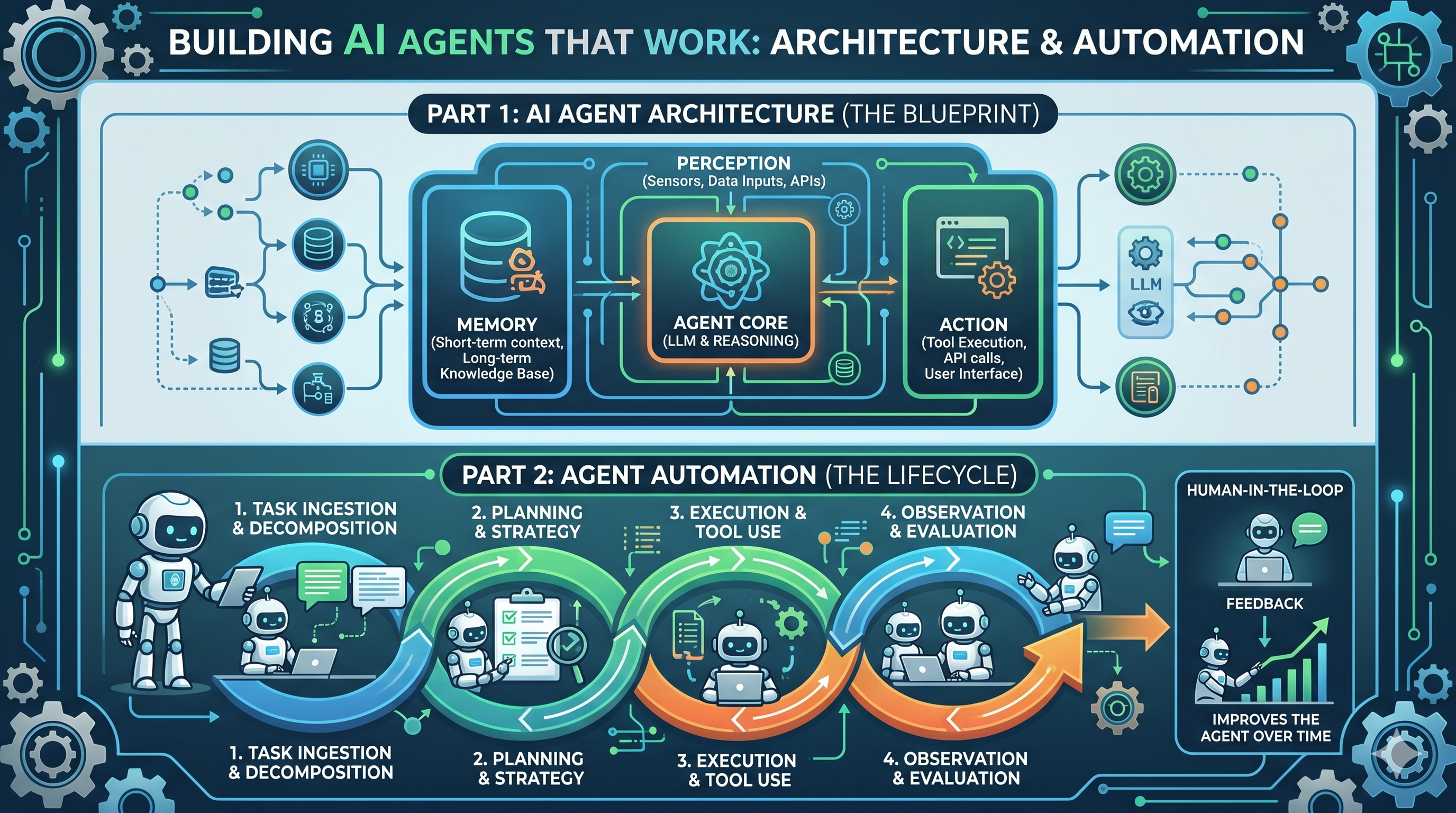

Agentens ræsonneringsloop (med diagrambeskrivelse)

Kernen i enhver agent er et loop:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Observation: Agenten opfatter tilstand (input, miljø, værktøjsresultater)

Agenten læser:

- Initielt input (lead-data, dokumenttekst, kundespørgsmål)

- Værktøjsresultater fra tidligere trin (API-svar, databaseforespørgsler)

- Hukommelse (samtalehistorik, tidligere beslutninger, vidensbase)

- Aktuel tilstand (hvad er udført, hvad mangler)

Ræsonnering: LLM beslutter næste handling (planlægning, værktøjsvalg)

LLM’en modtager en prompt som:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

LLM’en svarer: “Jeg bør berige leadet først for at få omsætningsdata, derefter score, derefter tildele.”

Handling: Udfør værktøjskald eller tag skridt mod mål

Agenten udfører det valgte værktøj:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: Evaluér resultat, juster strategi om nødvendigt

Agenten tjekker: Lykkedes værktøjskaldet? Bevægede det sig mod målet? Opdater hukommelse og loop.

Loop: Gentag indtil målet er nået eller maks. trin er nået

Agenten gentager observation → ræsonnering → handling → feedback indtil:

- Målet er nået (“Lead scoret og tildelt”)

- Maks. trin er nået (forhindre uendelige loops)

- Fejl opstår (eskalér til menneske)

Værktøjsintegration (agentens “hænder”)

Definition af værktøjer (funktionssignaturer, beskrivelser, parametre)

Værktøjer er funktioner, agenten kan kalde. Definér dem klart:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Klare beskrivelser hjælper LLM’en med at vælge det rette værktøj.

Værktøjskald (hvordan agenter vælger og kalder værktøjer)

LLM’en svarer med et værktøjskald:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Dit agent-framework udfører værktøjet og sender resultatet tilbage til LLM’en.

Håndtering af værktøjsresultater (parsing af svar, fejlgendannelse)

Håndter både succes og fejl:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Hvis et værktøj fejler, skal agenten prøve en anden tilgang eller eskalere til et menneske.

Hukommelsessystemer (hvad agenter husker)

Korttidshukommelse (nuværende samtalekontekst)

Agentens arbejdshukommelse: aktuelt input, værktøjsresultater, ræsonneringstrin. Gemmes normalt i kontekstvinduet (prompten).

Eksempel: Lead-kvalificeringsagent husker:

- Original lead-data

- Berigelsesresultater

- Score

- Hvilken salgsmedarbejder der blev tildelt

Langtidshukommelse (vidensbase, tidligere interaktioner)

Persistent hukommelse: tidligere beslutninger, lærte mønstre, vidensbase.

Brugsscenarier:

- Vidensbase: Agenten henter relevante artikler ved besvarelse af kundespørgsmål

- Beslutningshistorik: Agenten lærer, hvilke leads der konverterede (forbedrer scoring)

- Interaktionslogs: Agenten husker tidligere interaktioner med en kunde

Implementér med vektordatabaser (Pinecone, Weaviate) til semantisk søgning.

Hukommelsesbegrænsninger (kontekstvindue-begrænsninger)

LLM’er har begrænsede kontekstvinduer (4K-128K tokens). Agenter kan ikke huske alt. Strategier:

- Sammenfatning: Komprimér gamle samtaler til opsummeringer

- Retrieval-augmented generation (RAG): Hent kun relevant hukommelse efter behov

- Hierarkisk hukommelse: Gem nylige interaktioner i korttidshukommelse, ældre i langtidshukommelse

Ræsonneringsrygrad (“hjernen”)

Valg af LLM (GPT-4, Claude, open source-modeller)

- GPT-4: Bedst ræsonnering, håndterer komplekse opgaver. Pris: 0,03-0,06 USD pr. 1K tokens.

- Claude 3.5 Sonnet: Stærk ræsonnering, lang kontekst (200K tokens). Pris: 0,003-0,015 USD pr. 1K tokens.

- Open source (LLaMA 4): Billigere (0,01-0,03 USD pr. 1M tokens), tilpasselig, privatlivsvenlig.

For de fleste agenter er Claude eller open source-modeller tilstrækkelige og billigere.

Ræsonneringstilstande (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought: Agent tænker trin for trin. “Jeg skal berige → score → tildele.”

- Tree-of-thought: Agent udforsker flere stier, vælger den bedste. Langsommere, men mere præcis for komplekse problemer.

- Reflexion: Agent kritiserer sit eget output, prøver igen om nødvendigt. Reducerer hallucinationer.

Eksempel på reflexion-prompt:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Afvejninger: Hastighed vs. nøjagtighed

- Hurtige agenter: Enkelt-turn ræsonnering, ingen værktøjsvalidering. 2-5 sekunder pr. opgave. 85 % nøjagtighed.

- Nøjagtige agenter: Flertrins-ræsonnering, validering, reflexion. 10-30 sekunder pr. opgave. 95 % nøjagtighed.

Vælg hastighed til real-time (kundeservice). Vælg nøjagtighed til højrisiko (finansielle beslutninger).

Typer af agenter, og hvornår man skal bruge hver

Reaktive agenter (simple, hurtige, tilstandsløse)

Sådan fungerer de (enkelt tur: input → handling)

Reaktive agenter træffer en enkelt beslutning og handler. Ingen flertrins-planlægning.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

Bedst til: Simpel værktøjsbrug, API-kald, øjeblikkelige svar

- Kundeservice Q&A (slå ordre op, tjek saldo)

- Simple API-kald (hent vejr, tjek aktiekurs)

- Øjeblikkelige svar nødvendige (< 2 sekunders latency)

Eksempel: Kundeservice-chatbot med vidensbase-opslag

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latency: 1-3 sekunder. Omkostning: 0,001-0,01 USD pr. forespørgsel.

Planlægningsagenter (måldrevne, flertrins-ræsonnering)

Sådan fungerer de (nedbryd mål i delopgaver, udfør plan)

Planlægningsagenter bryder komplekse mål ned i trin.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

Bedst til: Komplekse workflows, research-opgaver, dataanalyse

- Lead-kvalificering (berig → score → tildel)

- Dokumentbehandling (udtræk → klassificér → gem)

- Research-opgaver (søg → opsummér → saml)

Eksempel: Lead-kvalificeringsagent (score → berig → tildel)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latency: 5-15 sekunder. Omkostning: 0,02-0,05 USD pr. lead.

Lærende agenter (adaptive, forbedrer sig over tid)

Sådan fungerer de (inkorporerer feedback, justerer adfærd)

Lærende agenter bliver bedre med feedback.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

Bedst til: Langvarige processer, personalisering, optimering

- Indholdsanbefaling (lærer brugerpræferencer)

- Kundeservice-routing (lærer hvilke agenter der håndterer hvilke problemer bedst)

- Prisoptimering (lærer hvilke priser der konverterer bedst)

Eksempel: Indholdsanbefaling-agent (lærer brugerpræferencer)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Over tid forbedres anbefalingerne, efterhånden som agenten lærer brugerpræferencer.

Hierarkiske agenter (agenter der styrer andre agenter)

Sådan fungerer de (supervisor-agent uddelegerer til specialister)

En supervisor-agent koordinerer specialistagenter.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

Bedst til: Enterprise-workflows, storskala-automatisering

- Indholdsskabelse (research → skriv → redigér → publicér agenter)

- Kompleks kundeservice (triage → løs → eskalér agenter)

- Databehandlings-pipelines (udtræk → transformér → indlæs agenter)

Eksempel: Indholdsskabelses-pipeline (research → skriv → redigér → publicér)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Hver specialistagent er optimeret til sin opgave. Supervisor orkestrerer.

Topværktøjer og frameworks til AI-agenter i 2026 (sammenligningstabel)

Evalueringskriterier

Ræsonneringsevne (Chain-of-Thought, planlægning, Reflexion)

Hvor sofistikeret agentens tænkning er. Simple agenter bruger chain-of-thought. Komplekse agenter bruger planlægning og reflexion.

Værktøjsintegration (hvor nemt at tilføje brugerdefinerede værktøjer)

Kan du nemt tilslutte API’er, databaser, CRM-systemer? Eller har du brug for brugerdefineret kode?

Indlæringskurve (opsætningstid, dokumentationskvalitet)

Hvor hurtigt kan en udvikler få en fungerende agent? No-code-platforme er hurtigere; Python-frameworks er mere fleksible.

Prismodel (gratis, pr. API-kald, abonnement)

Nogle frameworks er open source (gratis). Andre opkræver pr. API-kald eller abonnement.

Bedste brugsscenarier

Hvad er hvert værktøj optimeret til?

Sammenligningstabel: Topværktøjer og frameworks til AI-agenter (2026)

| Tool | Framework Type | Reasoning Capability | Tool Integration | Learning Curve | Pricing | Best For |

|---|---|---|---|---|---|---|

| n8n | Visual workflow builder | Chain-of-thought | 500+ integrations | Low | Free + paid | Non-technical users, quick setup |

| CrewAI | Python framework | Planning + reflexion | Custom tools (Python) | Medium | Open-source | Developers, complex agents |

| Autogen | Python framework | Multi-agent reasoning | Custom tools | High | Open-source | Research, multi-agent systems |

| LangGraph | Python framework | Planning + state management | LangChain ecosystem | Medium | Open-source | Complex workflows, state tracking |

| FlowHunt | Native platform | Chain-of-thought + planning | Native + API integrations | Low | Subscription | Workflow automation, ease-of-use |

| Lindy.ai | No-code platform | Chain-of-thought | 100+ integrations | Very low | Freemium | Non-technical, quick agents |

| Gumloop | No-code platform | Chain-of-thought | 50+ integrations | Very low | Freemium | Simple automation, templates |

Nøgleforskelle:

- No-code (n8n, FlowHunt, Lindy.ai): Hurtige at bygge, begrænset tilpasning. Gode til standard-workflows.

- Python-frameworks (CrewAI, Autogen, LangGraph): Fleksible, kraftfulde, stejlere indlæringskurve. Gode til kompleks logik.

- Open source (CrewAI, Autogen, LangGraph): Gratis, men du administrerer infrastrukturen. Betalte platforme håndterer hosting.

Sådan vælger du det rigtige værktøj til din use case

- Hurtig prototype (< 1 uge): Brug no-code (FlowHunt, n8n, Lindy.ai)

- Kompleks agent med brugerdefineret logik: Brug Python-framework (CrewAI, LangGraph)

- Multi-agent system (agenter der koordinerer): Brug Autogen

- Produktions-workflow-automatisering: Brug FlowHunt (administreret, overvåget, skaleret)

Byg din første agent: Arkitektur trin for trin

Definér agentens mål og omfang

Hvilket problem løser den?

Vær specifik. Dårligt: “Automatisér lead-håndtering.” Godt: “Score leads 0-100, berig med virksomhedsdata, tildel til salgsmedarbejdere baseret på kapacitet.”

Hvad er succeskriterierne?

- Nøjagtighed: % korrekte beslutninger (mål: > 90 %)

- Latency: Tid til at fuldføre opgave (mål: < 10 sekunder)

- Omkostninger: API-kald pr. opgave (mål: < 0,05 USD)

- Automatiseringsrate: % opgaver udført uden menneskelig indgriben (mål: > 80 %)

Hvad er begrænsningerne (latency, omkostninger, nøjagtighed)?

Afvejninger:

- Real-time workflows: Kræver < 5 sekunders latency. Brug hurtige modeller, færre værktøjskald.

- Batch-workflows: Kan tolerere 5-30 minutter. Brug mere præcis ræsonnering, flere værktøjskald.

- Omkostningsfølsom: Brug open source-modeller, færre API-kald.

- Nøjagtighedskritisk: Brug dyre modeller (GPT-4), flertrins-validering.

Design agent-loopet

Hvad vil agenten observere?

Inputdata: lead-data, dokumenttekst, kundespørgsmål, kontekst fra hukommelse.

Hvilken ræsonneringstilstand (simpel chain-of-thought vs. planlægning)?

- Chain-of-thought: Hurtig, simpel. “Jeg laver trin 1, derefter trin 2.”

- Planlægning: Langsommere, mere præcis. “Lad mig planlægge alle trin først, derefter udføre.”

Hvilke værktøjer har den brug for?

Oplist API’er, databaser, tjenester som agenten vil kalde.

Eksempel for lead-kvalificering:

- CRM API (hent/opdater lead)

- Databerigelse API (hent virksomhedsdata)

- Scoring-model (score lead)

- Notifikationstjeneste (send Slack/e-mail)

Hvordan ved den, hvornår den skal stoppe?

Definér succesbetingelsen. “Stop når lead er scoret og tildelt.”

Definér også maks. trin for at undgå uendelige loops. “Stop efter 10 trin, uanset hvad.”

Implementér og test

Pseudokode eller reelt kodeeksempel (CrewAI eller FlowHunt)

CrewAI-eksempel:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Teststrategi (unit-tests til værktøjskald, integrationstests til loops)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Debugging af almindelige problemer (uendelige loops, hallucinationer, forkerte værktøjer)

- Uendelige loops: Tilføj maks. trin-grænse. Log hvert trin. Overvåg gentagne handlinger.

- Hallucinationer: Tilføj validering. Faktatjek output mod kildedata.

- Forkerte værktøjer: Forbedr værktøjsbeskrivelser. Tilføj værktøjsvalidering før udførelse.

Reelt eksempel: Lead-kvalificeringsagent

Mål: Score leads, berig data, tildel til salgsteam

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Værktøjer: CRM API, databerigelsestjeneste, scoring-model

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Pseudokode-gennemgang (observér lead → score → berig → tildel)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Resultater: Nøjagtighed, latency, omkostningsmetrikker

- Nøjagtighed: 94 % (lead-score matcher manuel gennemgang)

- Latency: 8 sekunder (5 værktøjskald, 3 LLM-ræsonneringstrin)

- Omkostning: 0,03 USD pr. lead (GPT-4 API-kald + berigelse API)

- Gennemløb: 450 leads/time (enkelt agent-instans)

- Automatiseringsrate: 87 % (13 % eskaleret til menneske for gennemgang)

Integration af agenter med forretningssystemer

API-integrationsmønstre

REST API’er (mest almindelige)

De fleste agenter kalder REST API’er. Brug standard HTTP-klient:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (hændelsesdrevne agent-triggers)

Udløs agenter ved hændelser (nyt lead, indkommende e-mail, formularindsendelse):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Autentificering og sikkerhed (API-nøgler, OAuth, rate limiting)

- API-nøgler: Gem i miljøvariable, ikke i kode

- OAuth: Til brugervendte integrationer (Salesforce, HubSpot)

- Rate limiting: Respektér API-grænser. Implementér backoff og retry-logik

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Database-integration

Læs-kun (agent forespørger data)

Agent læser kundedata, tidligere interaktioner, vidensbase:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Skriveoperationer (agent gemmer beslutninger/resultater)

Agent skriver beslutninger til database:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transaktioner og konsistens (sikre dataintegritet)

Brug transaktioner til flertrins-operationer:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

CRM- og forretningsværktøjsintegration

Salesforce, HubSpot, Pipedrive integrationsmønstre

Brug officielle SDK’er:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Slack, e-mail, Jira integration (agent sender notifikationer/opdateringer)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Autentificering og tilladelses-scoping

Brug OAuth-scopes til at begrænse, hvad agenter kan gøre:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Human-in-the-loop workflows

Hvornår agenter har brug for menneskelig godkendelse

Højrisiko-beslutninger: finansielle transaktioner, kunderefusioner, politikundtagelser.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Eskaleringsmønstre (højrisiko-beslutninger, grænsetilfælde)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Feedback-loops (mennesker retter agent-fejl)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Almindelige agent-fejl og hvordan man forhindrer dem

Uendelige loops (agent sidder fast i at gentage samme handling)

Årsag: Dårlig måldefinition, værktøj der ikke gør fremskridt

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

Forebyggelse: Maks. trin-grænse, fremskridtssporing, værktøjsdiversitet

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Genopretning: Timeout, eskalering til menneske

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Hallucinationer (agent opfinder fakta eller værktøjsoutput)

Årsag: LLM’s tendens til at konfabulere, dårlige værktøjsbeskrivelser

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

Forebyggelse: Retrieval-augmented generation (RAG), værktøjsvalidering, faktatjek

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Brug RAG til at forankre agenten i fakta:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Genopretning: Fallback til menneske, prøv igen med anden ræsonnering

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Værktøjsmisbrug (agent kalder forkert værktøj eller med forkerte parametre)

Årsag: Tvetydige værktøjsbeskrivelser, dårlig ræsonnering

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Forebyggelse: Klar værktøjsdokumentation, træning i værktøjsbrug, validering før udførelse

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Genopretning: Fejlhåndtering, foreslå korrekt værktøj, prøv igen

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Omkostningsoverskridelser (agent bruger for mange API-kald)

Årsag: Ineffektiv ræsonnering, overflødige værktøjskald

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

Forebyggelse: Budgetgrænser, opkald-deduplikering, caching

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementér caching:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Genopretning: Omkostningsovervågning, throttling, billigere model-fallback

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Latency-problemer (agent for langsom til real-time brug)

Årsag: Flere ræsonneringstrin, langsomme værktøjssvar

En agent, der laver 5 sekventielle API-kald med 1 sekund hver = 5+ sekunders latency.

Forebyggelse: Parallel værktøjsudførelse, caching, hurtigere modeller

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Brug hurtigere modeller:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Genopretning: Timeout, returnér delvise resultater, sæt i kø til async

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Måling af agent-performance og ROI

Nøglemetrikker at spore

Nøjagtighed (% korrekte beslutninger/handlinger)

Sammenlign agent-output med ground truth (menneskelig gennemgang, faktiske resultater).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latency (tid til at fuldføre opgave)

Mål end-to-end-tid fra input til output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Omkostninger pr. opgave (API-kald, compute, menneskelig gennemgang)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Brugertilfredshed (hvis human-in-the-loop)

Spørg brugere: “Hvor tilfreds er du med agent-beslutninger?”

Automatiseringsrate (% opgaver udført uden menneskelig indgriben)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

ROI-beregning

Baseline: Omkostning ved manuel proces (menneske-timer × timepris)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agent-omkostninger: Infrastruktur + API-kald + menneskeligt tilsyn

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Tilbagebetalingsperiode: Når agent-omkostning < manuel omkostning

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Eksempel: ROI for lead-kvalificeringsagent

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Løbende forbedring

Overvåg metrikker over tid

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

A/B-test forskellige agent-konfigurationer

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Inkorporér feedback for at forbedre nøjagtighed

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Skalér succesfulde agenter, pensionér underpræsterende

Overvåg ROI. Hvis en agent ikke leverer værdi, pensionér den. Skalér succesfulde agenter til andre teams.

Ofte stillede spørgsmål

FAQ-sektionen rendres automatisk fra frontmatter og vises nedenfor.

{{ cta-dark-panel heading=“Build Agents Without the Complexity” description=“FlowHunt’s native agent platform handles tool integration, error handling, and monitoring. Start building autonomous workflows in minutes, not weeks.” ctaPrimaryText=“Try FlowHunt Free” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Book a Demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}