Slack-integration

FlowHunts Slack-integration muliggør problemfri AI-samarbejde direkte i dit Slack-arbejdsområde. Bring ethvert Flow ind i Slack, automatiser arbejdsgange, få AI...

Forbind enhver LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) til Slack ved hjælp af FlowHunts no-code flow-builder. Opsætningen er den samme for hver model — vælg den model, der passer til din brugssituation, og gå i drift på få minutter.

At tilføje en AI-assistent til Slack betød tidligere at vælge en leverandør, skrive integrationskode og bygge alt om, når en bedre model udkom seks måneder senere. Med FlowHunt er integrationen afkoblet fra modellen: du bygger Slack-flowet én gang, kobler den ønskede LLM på — Claude, GPT, Gemini, Grok, Llama, Mistral — og udskifter den når som helst uden at røre resten.

Denne guide gennemgår hele opsætningen. Den første halvdel er den samme for hver model. Den anden halvdel forklarer, hvilken model der passer til hvilken brugssituation, med noter specifikt for hver LLM-familie. Spring til det afsnit, der matcher din stack, eller læs hele vejen igennem, hvis du starter fra nul.

Slack er der, hvor teams stiller spørgsmål. En AI-agent, der lever der, besvarer dem øjeblikkeligt — uden at skifte kontekst til et separat chatværktøj, dashboard eller vidensbase. Almindelige anvendelser:

Botten lever i Slack, så adoptionen er automatisk — ingen skal lære et nyt værktøj.

Opsætningen er identisk uanset hvilken AI-model du vælger. Vælg din model i trin 4; alt andet forbliver det samme.

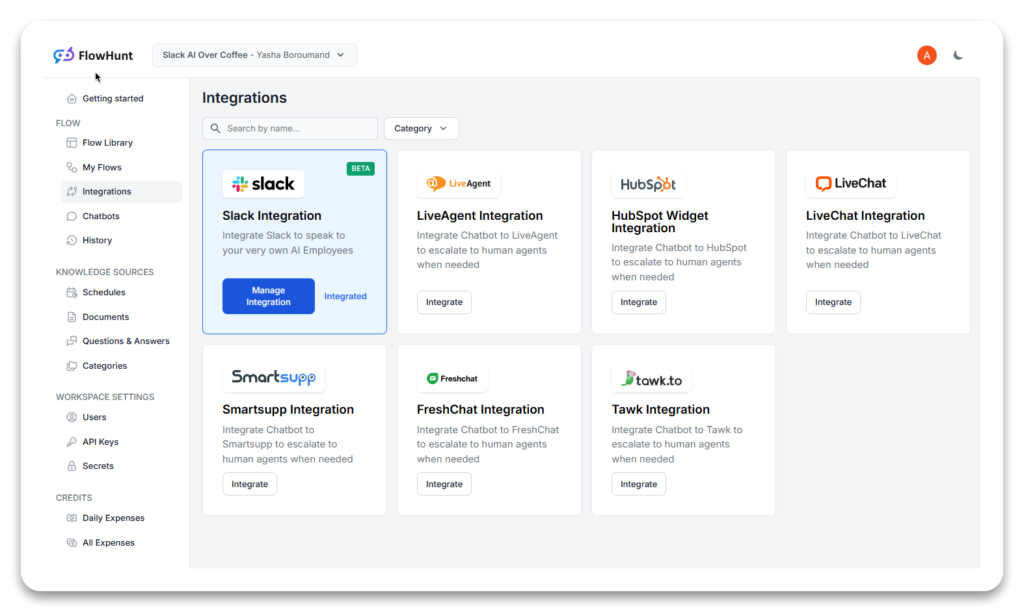

Log ind på din FlowHunt -konto og åbn fanen Integrations. Vælg Slack, klik Connect, og autorisér appen på Slacks OAuth-skærm. Giv de læse-/skriverettigheder, FlowHunt anmoder om — de gør det muligt for botten at modtage beskeder og poste svar i dit workspace.

Din workspace-URL vises i øverste venstre hjørne af Slack-skrivebords- eller webappen — kopier den derfra, hvis FlowHunt beder om det. Når den er autoriseret, er Slack forbundet og klar til brug i ethvert flow.

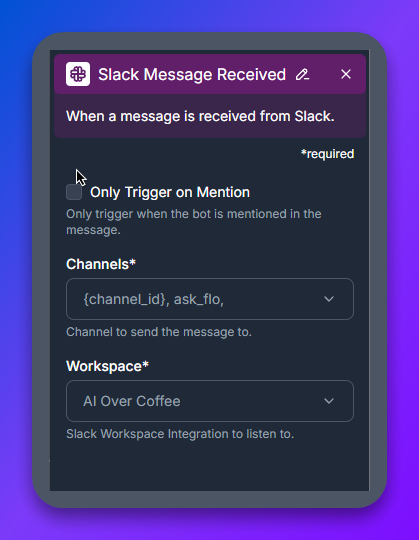

I FlowHunts flow-builder, slip en Slack Message Received-komponent på lærredet. Denne blok lytter efter indkommende Slack-beskeder og udløser resten af flowet.

Konfigurer to indstillinger:

#ai-assistant-kanal er den reneste opsætning.

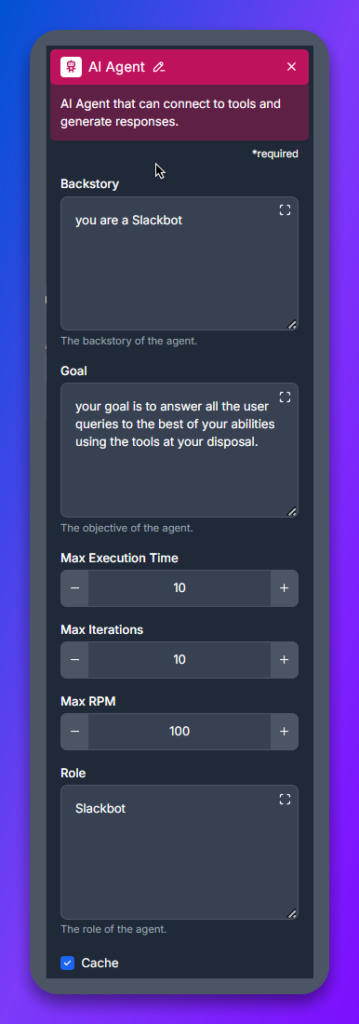

AI Agent-blokken er bottens ræsonnementlag. Den tager brugerens besked, beslutter hvilke værktøjer der skal bruges, og udformer svaret.

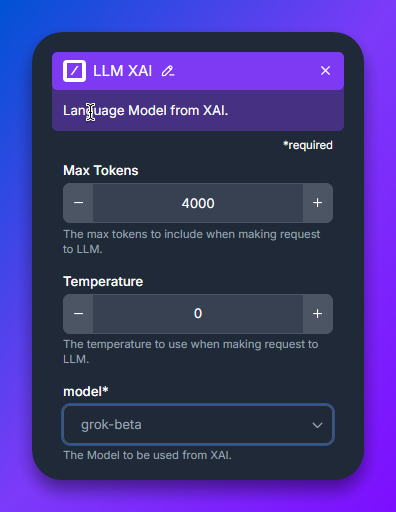

Forbind en LLM-komponent til AI Agenten. Det er her, du vælger, hvilken AI-model der driver botten. FlowHunt har en separat LLM-komponent for hver leverandør — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — og inde i hver vælger du den specifikke modelvariant.

Dette er det eneste trin, der adskiller sig pr. model. Hop til afsnittet Vælg den rigtige AI-model nedenfor for en sammenligning og noter pr. familie.

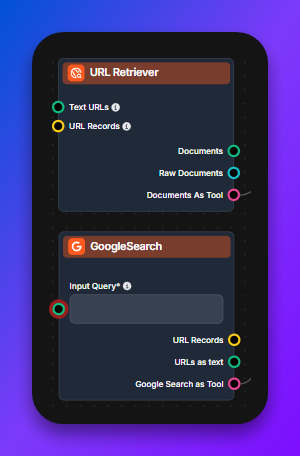

AI Agenten bliver dramatisk mere nyttig, når den kan bruge værktøjer. Almindelige er:

Værktøjer er modeluafhængige. Enhver LLM, du vælger i trin 4, kan bruge ethvert værktøj, du tilslutter.

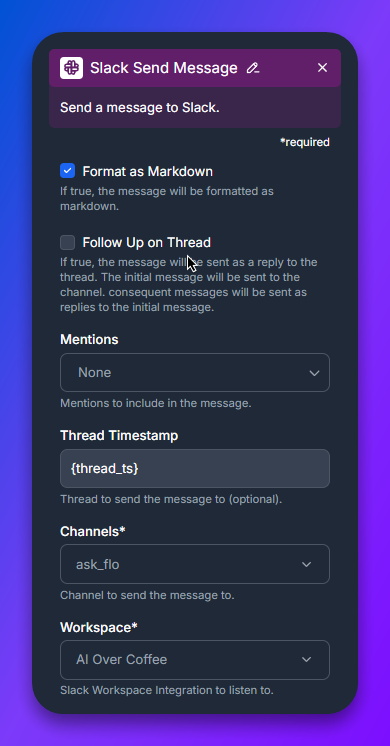

Afslut flowet med en Slack Send Message-komponent, konfigureret til samme kanal og workspace som i trin 2. Gem flowet, åbn Slack, og @-mention botten i din testkanal. Botten bør svare ved hjælp af den model, du valgte i trin 4.

Det er hele opsætningen. At skifte modeller senere er en ét-kliks-ændring i trin 4 — ingen kodeændringer, ingen genopbygning af flowet.

Alle store LLM-familier virker i FlowHunts Slack-flow. Forskellene handler om pris, latenstid, kontekstvindue, ræsonnementdybde og kvalitet af tool-calling. Brug tabellen til at lave en kort liste, og læs derefter det familiespecifikke afsnit for opsætningsnoter.

| Modelfamilie | Bedst til | Latenstid | Pris | Noter |

|---|---|---|---|---|

| Claude (Anthropic) | Lang-kontekst-analyse, omhyggelig ræsonnement, kodegennemgang | Mellem | Mellem–Høj | Stærk til at følge nuancerede instruktioner; fremragende til intern Q&A over dokumenter |

| GPT / o-serien (OpenAI) | Almen brug, bredt værktøjsøkosystem, multimodal | Lav–Mellem | Lav (mini) – Høj (o-serie) | GPT-4o Mini er standard-sweet-spot; o1 / o3 til hård ræsonnement |

| Gemini (Google) | Massive kontekstvinduer, hurtig multimodal, søgegrundet | Lav | Lav–Mellem | 1.5 Pro håndterer 1M+ tokens; godt til hel-dokument Slack-Q&A |

| Grok (xAI) | Realtids- / nyhedsbevidste forespørgsler, X (Twitter)-data, afslappet tone | Lav | Mellem | Bedst når botten skal have aktualitetsbevidsthed |

| Llama (Meta) | Selv-hostede / private deployments, omkostningsfølsomme workloads | Afhænger af host | Lav (selv-hostet) | Åbne vægte — brug når dataresidens betyder noget |

| Mistral | Open-weight, balanceret pris/kvalitet, EU-venlig hosting | Lav | Lav–Mellem | Mistral Large konkurrerer med GPT-4o til lavere pris |

Vælg én at starte med. At skifte modeller i FlowHunt er en ét-kliks-ændring i LLM-komponenten, så det betaler sig ikke at overtænke det indledende valg — lancér med et fornuftigt udgangspunkt, mål kvalitet på reel Slack-trafik, itererer.

Hvert afsnit nedenfor er selvstændigt. Vælg afsnittet for den modelfamilie, du forbinder, og følg dets noter.

Claude er Anthropics familie af LLM’er, velegnet til Slackbots, der håndterer nuanceret intern Q&A, dokumentopsummering, kodegennemgang og omhyggelig instruktionsefterlevelse. For at forbinde Claude til Slack, slip LLM Anthropic-komponenten i trin 4 og vælg varianten:

Til intern-vidensslackbots over Notion eller Confluence er Claude 3.5 Sonnet plus en Document Retriever det mest pålidelige udgangspunkt.

OpenAI’s GPT- og o-serie-modeller er det bredeste valg til Slack — stærk almen ydelse, den mest modne tool-calling og multimodal input (vision, lyd). Slip LLM OpenAI-komponenten i trin 4 og vælg varianten:

For de fleste teams: start med GPT-4o Mini. Opgrader til GPT-4o eller o1 kun på flows, hvor brugerne klager over svarets kvalitet.

Google Gemini er det stærkeste valg, når kontekstvinduet betyder noget — Gemini 1.5 Pro håndterer over 1M tokens, nok til at slippe hele kodebaser eller dokumentsæt ind i en enkelt Slack-forespørgsel. Slip LLM Google-komponenten i trin 4 og vælg varianten:

Hvis din Slackbot skal ræsonnere over hele din vidensbase i en enkelt gennemgang (uden retrieval-trin), er Gemini Pros kontekstvindue det reneste svar.

xAI Grok er indbygget i FlowHunts Slack-flow på samme måde som de andre modeller — slip LLM xAI-komponenten (eller brug LLM OpenAI-komponenten pegende på Grok-endpointet, afhængigt af din FlowHunt-version) og vælg Grok-varianten. Groks kendetegn er realtidsbevidsthed — den har adgang til live information, herunder X (Twitter)-data, hvilket gør den til det bedste valg, når Slackbotten har brug for kontekst om aktuelle begivenheder: nyheder, markedsdata, breaking news. Par den med Google Search Tool for endnu bredere webadgang.

Metas Llama-familie er open-weight-valget — brug det, når dataresidens, selv-hosting eller pris pr. token udelukker hostede API’er. Slip LLM Meta-komponenten i trin 4 og vælg varianten:

Llama er det rigtige svar, når dit sikkerheds- eller compliance-team kræver, at modellen kører på infrastruktur, du kontrollerer, eller når høj beskedvolumen gør hostede API-omkostninger uoverkommelige.

Mistral er den europæiske open-weight-udfordrer — stærke modeller, EU-venlig hosting og god pris-ydelse. Slip LLM Mistral-komponenten i trin 4 og vælg varianten:

Vælg Mistral, når EU-dataresidens betyder noget, eller når du vil have open-weight-fleksibilitet med tættere-på-frontier kvalitet end Llama 3.x i nogle benchmarks.

Tre flow-mønstre dækker de fleste Slack-implementeringer. Byg ethvert af dem oven på opsætningen ovenfor ved at justere AI Agentens værktøjer og prompt:

Disse mønstre lægges rent ovenpå hinanden: et enkelt Slack-flow kan kombinere vidensbase-retrieval, live websøgning og interne API-kald, hvor LLM’en vælger det rette værktøj pr. forespørgsel.

Botten svarer ikke på beskeder. Tjek at “Only Trigger on Mention” matcher, hvordan du tester — hvis det er aktiveret, skal du @-mentione botten. Bekræft, at kanalen i Slack Message Received matcher den kanal, du poster i.

Botten svarer, men svaret er dårligt. Iterer på AI Agentens backstory og goal først — de har større effekt end at skifte model. Hvis kvaliteten stadig halter efter prompt-iterering, opgrader til en stærkere model i LLM-komponenten (Mini → standard → topklasse).

Rettighedsfejl efter Slack-autorisation. Genforbind Slack-integrationen i FlowHunts Integrations-fane og giv rettigheder igen. Slack invaliderer lejlighedsvis tokens efter ændringer i workspace-ejer.

Lange svar bliver afkortet i Slack. Slack har en grænse for tegn pr. besked. Tilføj et efterbehandlingstrin i flowet for at opdele lange svar, eller instruér AI Agenten i dets goal om at holde svarene under 3.000 tegn, når der postes til Slack.

Hele opsætningen — at forbinde Slack, bygge flowet, vælge en model — er et aften-projekt i FlowHunt. Det flow, du bygger i dag, virker med enhver fremtidig model: når GPT-6 eller Claude 5 udkommer, udskifter du LLM-komponenten, og resten af flowet kører videre.

Start med FlowHunts gratis tier , forbind Slack, og lancér en fungerende AI-Slackbot inden frokost.

Arshia er AI Workflow Engineer hos FlowHunt. Med en baggrund inden for datalogi og en passion for AI, specialiserer han sig i at skabe effektive workflows, der integrerer AI-værktøjer i daglige opgaver og øger produktivitet og kreativitet.

FlowHunts no-code flow-builder forbinder Slack med alle store LLM'er — Claude, GPT, Gemini, Grok, Llama, Mistral — gennem ét konsistent flow. Ingen kode, ingen infrastruktur at vedligeholde.

FlowHunts Slack-integration muliggør problemfri AI-samarbejde direkte i dit Slack-arbejdsområde. Bring ethvert Flow ind i Slack, automatiser arbejdsgange, få AI...

FlowHunt 2.6.12 introducerer Slack-integration, intentsklassificering og Gemini-modellen, hvilket forbedrer AI-chatbot funktionalitet, kundeindsigt og team-work...

Integrer FlowHunt med Slack for at automatisere beskeder, udløse arbejdsprocesser og holde dit team opdateret med AI-drevne flows.