Hvad er LLM DeepSeek-komponenten?

LLM DeepSeek-komponenten forbinder DeepSeek-modellerne til dit Flow. Mens Generatorer og Agenter er der, hvor magien sker, gør LLM-komponenter det muligt at skifte og styre den anvendte model.

Husk, at det er valgfrit at forbinde en LLM-komponent. Alle komponenter, der bruger en LLM, leveres med ChatGPT-4o som standard. LLM-komponenterne gør det muligt at ændre modellen og styre modelindstillingerne.

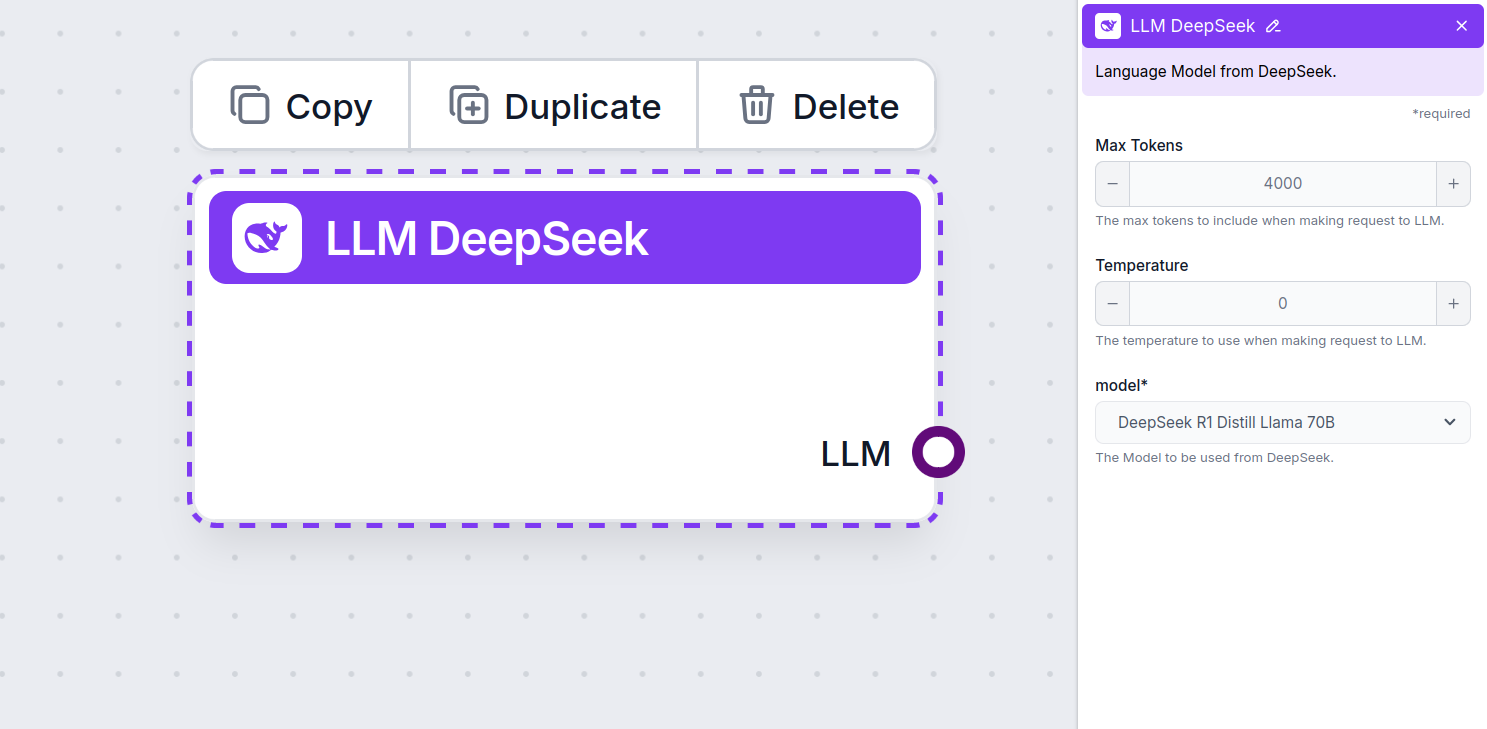

LLM Gemini-komponentindstillinger

Maksimalt antal tokens

Tokens repræsenterer de enkelte tekst-enheder, som modellen behandler og genererer. Token-forbrug varierer mellem modeller, og en enkelt token kan være alt fra ord eller delord til et enkelt tegn. Modeller prissættes normalt i millioner af tokens.

Indstillingen for maksimalt antal tokens begrænser det samlede antal tokens, der kan behandles i en enkelt interaktion eller forespørgsel, hvilket sikrer, at svarene genereres inden for rimelige grænser. Standardgrænsen er 4.000 tokens, hvilket er en optimal størrelse til at opsummere dokumenter og flere kilder for at generere et svar.

Temperatur

Temperatur styrer variationen i svarene og spænder fra 0 til 1.

En temperatur på 0,1 gør svarene meget præcise, men potentielt gentagende og mangelfulde.

En høj temperatur på 1 tillader maksimal kreativitet i svarene, men øger risikoen for irrelevante eller endda hallucinerede svar.

For eksempel anbefales en temperatur mellem 0,2 og 0,5 til en kundeservicebot. Dette niveau holder svarene relevante og i overensstemmelse med scriptet, men tillader naturlig variation i svarene.

Model

Dette er modelvælgeren. Her finder du alle de understøttede DeepSeek-modeller. Vi understøtter alle de nyeste Gemini-modeller:

- DeepSeek R1: Den kinesiske letvægts open source-model, der tog verden med storm i begyndelsen af 2025. Den er i øjeblikket den hurtigste og bedste DeepSeek-model, som uden besvær overgår OpenAI’s o1-model.

Sådan tilføjer du LLM DeepSeek til dit Flow

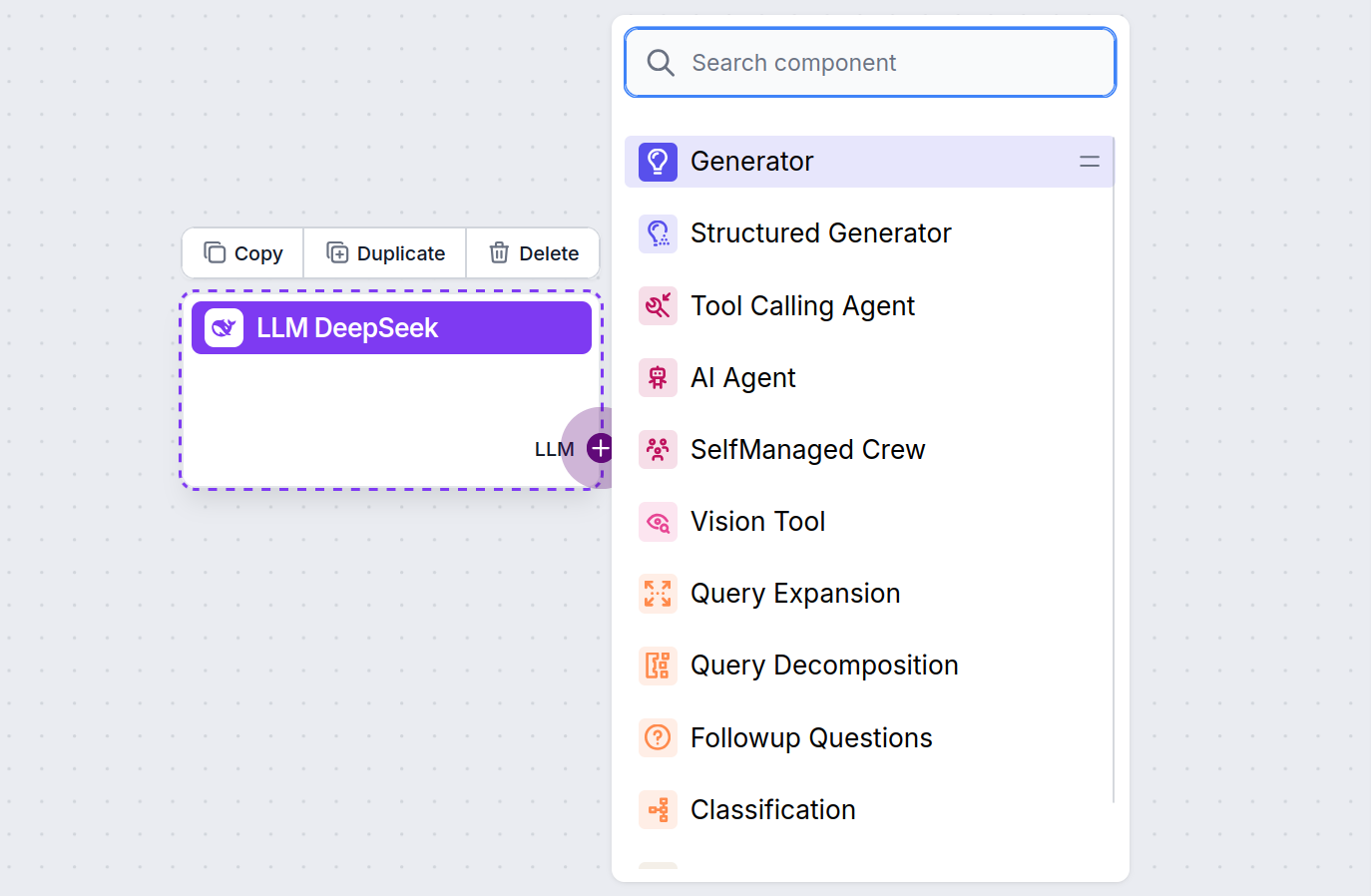

Du vil bemærke, at alle LLM-komponenter kun har et output-håndtag. Input passerer ikke igennem komponenten, da den kun repræsenterer modellen, mens selve genereringen sker i AI-agenter og generatorer.

LLM-håndtaget er altid lilla. LLM-inputhåndtaget findes på alle komponenter, der bruger AI til at generere tekst eller behandle data. Du kan se mulighederne ved at klikke på håndtaget:

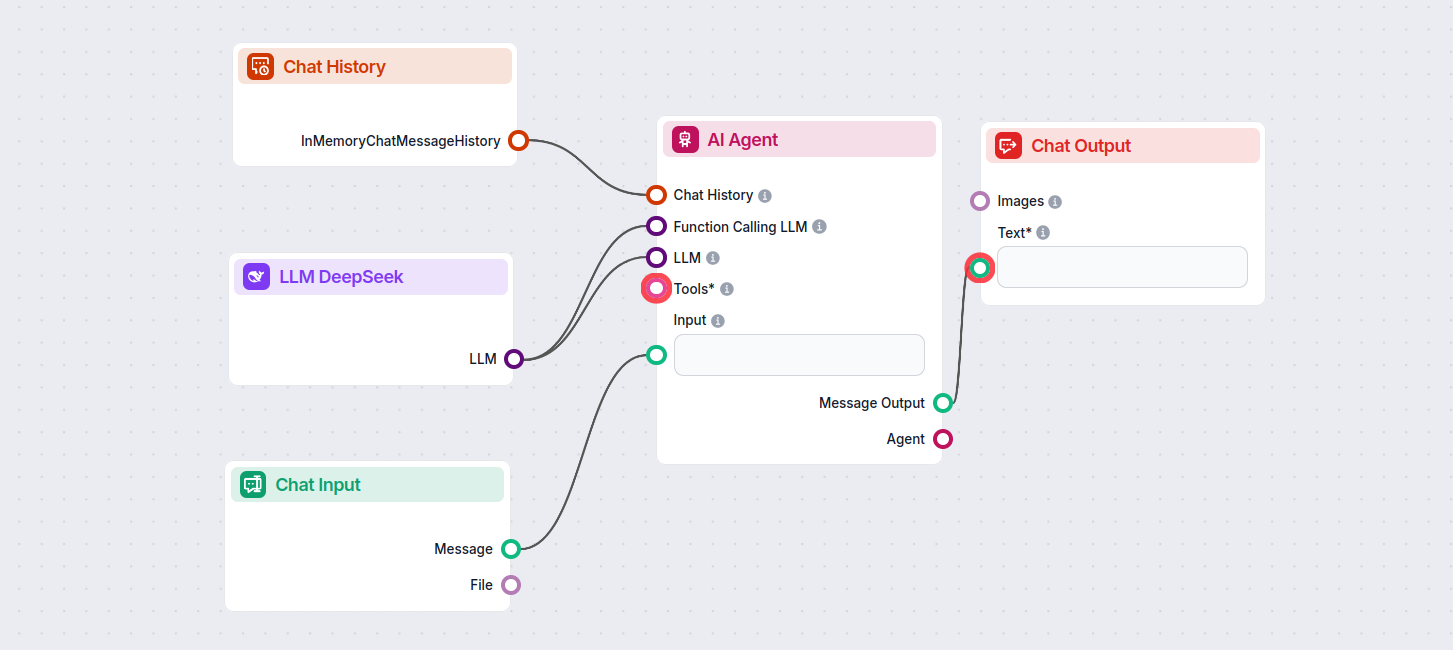

Dette gør det muligt at oprette alle slags værktøjer. Lad os se komponenten i aktion. Her er et simpelt AI Agent chatbot-flow, der bruger DeepSeek R1 til at generere svar. Du kan betragte det som en grundlæggende DeepSeek-chatbot.

Dette simple chatbot-flow inkluderer:

- Chat-input: Repræsenterer den besked, en bruger sender i chatten.

- Chat-historik: Sikrer, at chatbotten kan huske og tage tidligere svar i betragtning.

- Chat-output: Repræsenterer chatbot’ens endelige svar.

- AI-agent: En autonom AI-agent, der genererer svar.

- LLM DeepSeek: Forbindelsen til DeepSeek-genereringsmodellerne.