Konvergens

Konvergens inden for AI refererer til den proces, hvor maskinlærings- og dybdelæringsmodeller opnår en stabil tilstand gennem iterativ læring, hvilket sikrer nø...

Associativ hukommelse gør det muligt for AI-systemer at hente information baseret på inputmønstre og associationer, hvilket understøtter opgaver som mønstergenkendelse og muliggør mere menneskelignende interaktioner.

Associativ hukommelse i kunstig intelligens (AI) refererer til en type hukommelsesmodel, der gør det muligt for systemer at genkalde information baseret på mønstre og associationer frem for eksplicitte adresser eller nøgler. I stedet for at hente data på deres præcise placering, giver associativ hukommelse AI-systemer mulighed for at få adgang til information ved at matche inputmønstre med lagrede mønstre, selv når inputtet er ufuldstændigt eller støjende. Denne egenskab gør associativ hukommelse særlig værdifuld i AI-applikationer, der kræver mønstergenkendelse, datahentning og læring af erfaring.

Associativ hukommelse sammenlignes ofte med, hvordan den menneskelige hjerne genkalder information. Når du tænker på et begreb, udløser det relaterede minder eller idéer. På samme måde gør associativ hukommelse i AI det muligt for systemer at hente lagrede data, der er tættest forbundet med et givet input, hvilket letter mere menneskelignende interaktioner og beslutningsprocesser.

I AI-sammenhæng manifesterer associativ hukommelse sig i forskellige former, herunder indholds-adresserbare hukommelsesnetværk, Hopfield-netværk og bidirektionelle associative hukommelsesmodeller (BAM). Disse modeller er essentielle for opgaver som mønstergenkendelse, maskinlæring og udvikling af intelligent adfærd i AI-agenter, herunder chatbots og automatiseringsværktøjer.

Denne artikel dykker ned i begrebet associativ hukommelse i AI, udforsker hvad det er, hvordan det bruges, og giver eksempler og anvendelsestilfælde for at illustrere dets betydning i moderne AI-applikationer.

Associativ hukommelse er en hukommelsesmodel, der muliggør lagring og hentning af data baseret på indholdet af informationen frem for dens specifikke adresse. I traditionelle computermemorysystemer (som RAM) tilgås data ved at specificere præcise hukommelsesadresser. Til sammenligning gør associativ hukommelse det muligt at hente data ved at matche inputmønstre med lagrede mønstre, hvilket effektivt adresserer hukommelsen via indhold.

I AI er associative hukommelsesmodeller designet til at efterligne den menneskelige hjernes evne til at genkalde information gennem associationer. Det betyder, at når systemet præsenteres for et delvist eller støjende input, kan det hente det fulde eller nærmeste matchende lagrede mønster. Associativ hukommelse er i sin natur indholds-adresserbar og giver robuste og effektive datahentningsmekanismer.

Associativ hukommelse kan bredt klassificeres i to typer:

Indholds-adresserbar hukommelse er en form for associativ hukommelse, hvor datahentning baseres på indhold frem for adresse. CAM-hardwareenheder er designet til at sammenligne input-søgedata med en tabel af lagrede data og returnere adressen, hvor de matchende data findes. I AI anvendes CAM-principper i neurale netværk for at muliggøre associativ læring og hukommelsesfunktioner.

Forståelsen af associativ hukommelse i AI involverer også at udforske de tekniske implementeringer og modeller, der gør det muligt. Nedenfor er nogle af de vigtigste modeller og begreber.

Hopfield-netværk har begrænsninger i forhold til antallet af mønstre, de kan lagre uden fejl. Hukommelseskapaciteten er cirka 0,15 gange antallet af neuroner i netværket. Ud over denne grænse forringes netværkets evne til at hente korrekte mønstre.

Associative hukommelsesmodeller har iboende begrænsninger for, hvor mange mønstre de kan lagre og hente nøjagtigt. Faktorer, der påvirker kapaciteten, omfatter:

Associativ hukommelse forbedrer AI-automatisering](https://www.flowhunt.io#:~:text=AI+automation “Build AI tools and chatbots with FlowHunt’s no-code platform. Explore templates, components, and seamless automation. Book a demo today!”) og [chatbot-funktionalitet ved at muliggøre mere intuitive og effektive datahentnings- og interaktionsmuligheder.

Chatbots med associativ hukommelse kan give mere kontekstuelt relevante og nøjagtige svar ved at:

En kundesupport-chatbot bruger associativ hukommelse til at matche brugerforespørgsler med lagrede løsninger. Hvis en kunde beskriver et problem med stavefejl eller ufuldstændig information, kan chatbotten stadig hente den relevante løsning baseret på mønsterassociationer.

Associativ hukommelse i AI refererer til evnen hos kunstige systemer til at genkalde og relatere information på en måde, der ligner menneskelig hukommelse. Det spiller en afgørende rolle i at forbedre generalisering og tilpasningsevne hos AI-modeller. Flere forskere har udforsket dette begreb og dets anvendelse i AI.

A Brief Survey of Associations Between Meta-Learning and General AI af Huimin Peng (Udgivet: 2021-01-12) – Dette paper gennemgår meta-læringens historie og dens bidrag til generel AI, med vægt på udviklingen af associative hukommelsesmoduler. Meta-læring forbedrer generaliseringsevnen hos AI-modeller, hvilket gør dem anvendelige til forskellige opgaver. Undersøgelsen fremhæver meta-læringens rolle i at formulere generelle AI-algoritmer, som erstatter opgavespecifikke modeller med tilpasningsdygtige systemer. Den diskuterer også forbindelser mellem meta-læring og associativ hukommelse og giver indsigt i, hvordan hukommelsesmoduler kan integreres i AI-systemer for at forbedre ydeevnen. Læs mere.

Shall androids dream of genocides? How generative AI can change the future of memorialization of mass atrocities af Mykola Makhortykh et al. (Udgivet: 2023-05-08) – Selvom dette ikke er direkte fokuseret på associativ hukommelse, undersøger dette paper, hvordan generativ AI ændrer mindepraksis. Det diskuterer de etiske implikationer og potentialet i AI til at skabe nye narrativer, hvilket relaterer til associativ hukommelses rolle i at forbedre AI’s forståelse og fortolkning af historisk indhold. Undersøgelsen rejser spørgsmål om AI’s evne til at skelne mellem menneskeskabt og maskinskabt indhold, hvilket hænger sammen med udfordringerne i at udvikle AI-systemer med associativ hukommelse. Læs mere.

No AI After Auschwitz? Bridging AI and Memory Ethics in the Context of Information Retrieval of Genocide-Related Information af Mykola Makhortykh (Udgivet: 2024-01-23) – Denne forskning undersøger de etiske udfordringer ved brug af AI til informationshentning relateret til kulturarv, herunder folkedrab. Den fremhæver vigtigheden af associativ hukommelse i at kuratere og hente følsom information etisk forsvarligt. Paperet skitserer en ramme inspireret af Belmont-kriterierne for at adressere disse udfordringer og foreslår måder, hvorpå AI-systemer etisk kan håndtere og hente associativ hukommelse relateret til historiske begivenheder. Undersøgelsen giver indsigt i at bygge bro mellem AI-teknologi og mindeetik, hvilket er afgørende for at udvikle ansvarlige AI-systemer. Læs mere.

Associativ hukommelse i AI refererer til en hukommelsesmodel, der gør det muligt for systemer at genkalde information baseret på mønstre og associationer i stedet for eksplicitte adresser. Dette gør det muligt for AI at hente data via mønstermatchning, selv med ufuldstændige eller støjende inputs, på samme måde som menneskelig hukommelse fungerer.

Der findes to hovedtyper: autoassociativ hukommelse, som genkalder et komplet mønster fra et delvist eller støjende input af det samme mønster, og heteroassociativ hukommelse, som forbinder forskellige input- og outputmønstre til opgaver som oversættelse.

Chatbots med associativ hukommelse kan huske tidligere interaktioner, matche mønstre i brugerforespørgsler og rette fejl, hvilket muliggør kontekstuelt relevante og nøjagtige svar selv med ufuldstændige eller fejlagtige inputs.

Fordelene inkluderer fejltolerance, parallel søgning, adaptiv læring og biologisk inspirerede mekanismer. Begrænsningerne omfatter begrænset hukommelseskapacitet, beregningsmæssig kompleksitet og udfordringer ved at skalere til store datasæt.

Smarte chatbots og AI-værktøjer samlet ét sted. Forbind intuitive blokke for at gøre dine idéer til automatiserede Flows.

Konvergens inden for AI refererer til den proces, hvor maskinlærings- og dybdelæringsmodeller opnår en stabil tilstand gennem iterativ læring, hvilket sikrer nø...

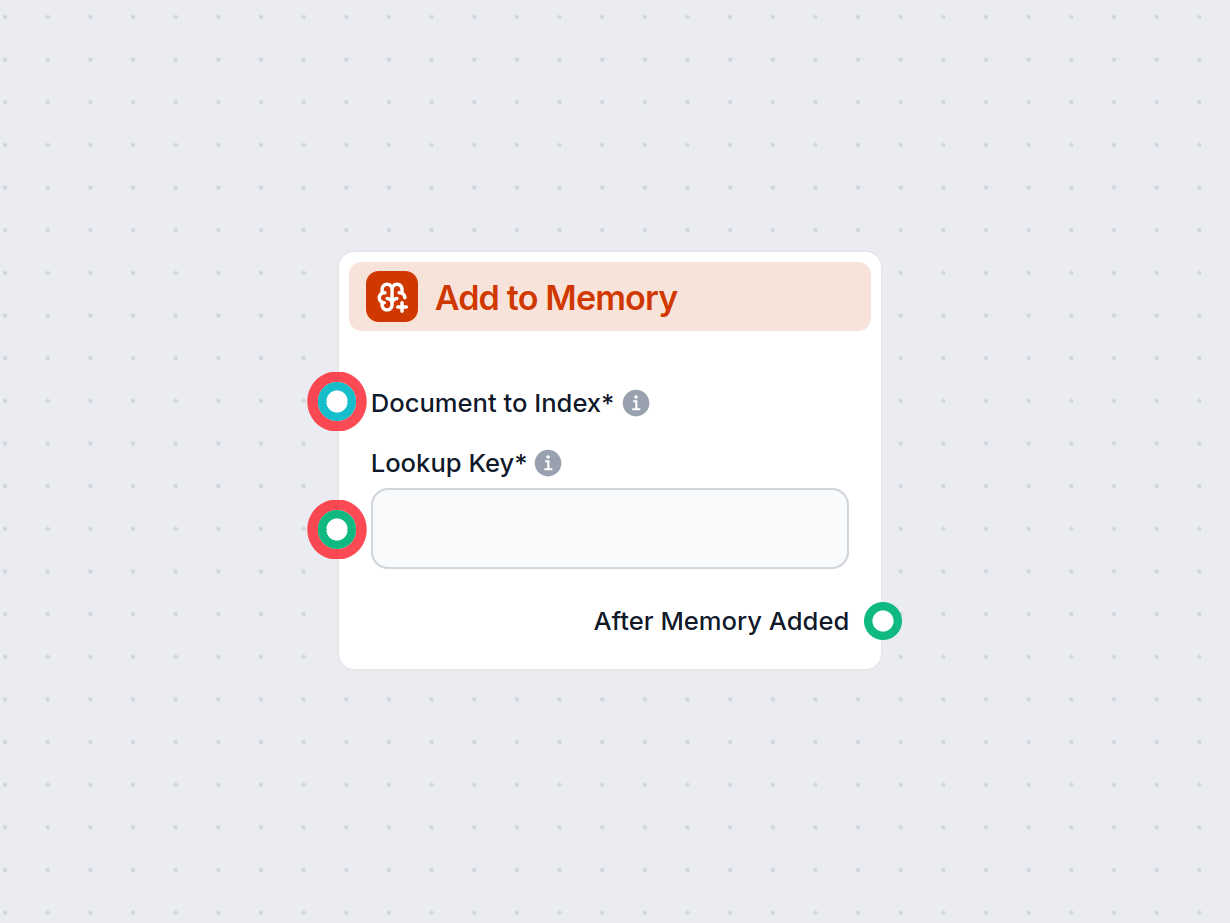

Gem nemt vigtig information i dit workflow med Tilføj til Hukommelse-komponenten. Gem problemfrit data eller dokumenter i langtidshukommelse, kategoriseret med ...

Retrieval Augmented Generation (RAG) er en avanceret AI-ramme, der kombinerer traditionelle informationshentningssystemer med generative store sprogmodeller (LL...