Forespørgselsudvidelse

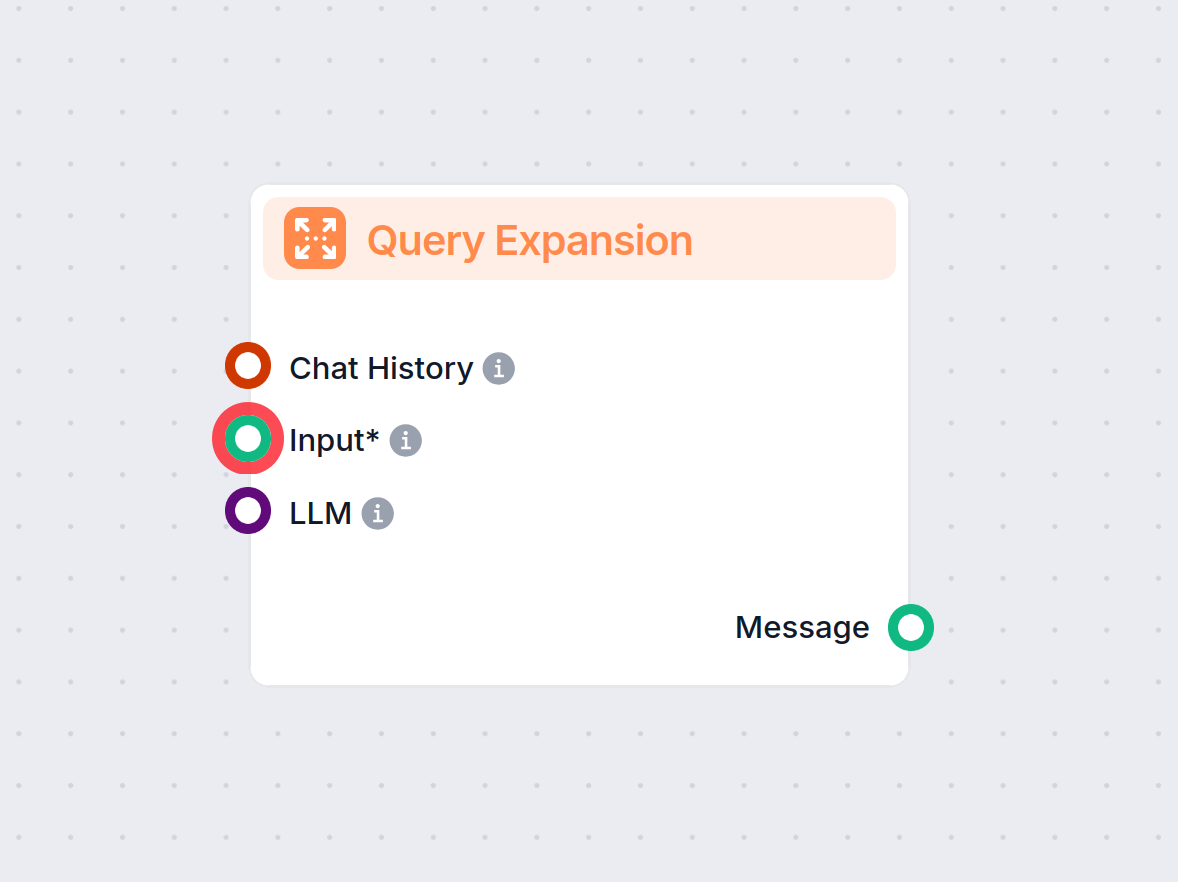

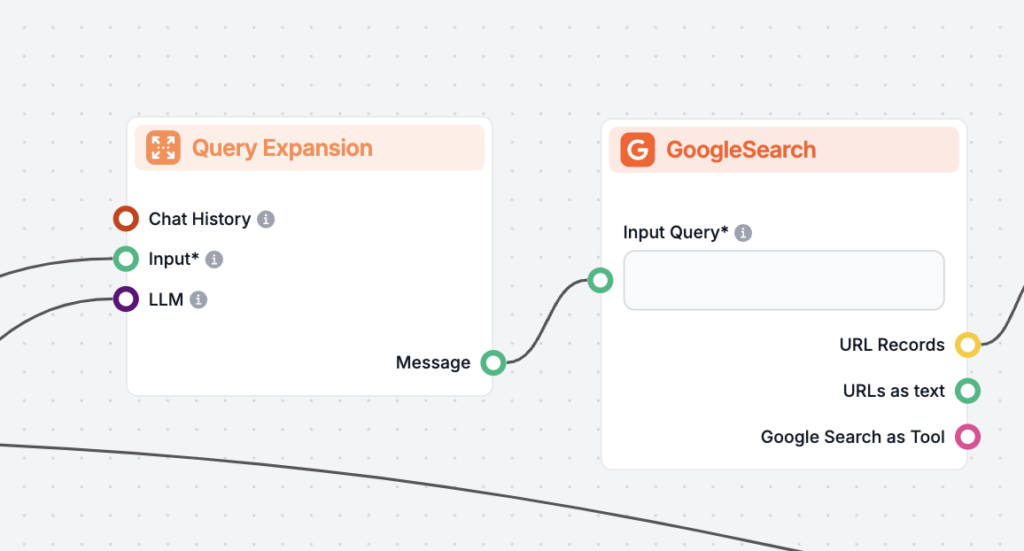

Forespørgselsudvidelse i FlowHunt forbedrer chatbotforståelsen ved at finde synonymer, rette stavefejl og sikre ensartede, nøjagtige svar på brugerforespørgsler...

Forespørgselsudvidelse beriger brugerforespørgsler med yderligere kontekst eller termer, hvilket øger nøjagtighed og svar-kvalitet i AI-systemer som RAG og chatbots.

Forespørgselsudvidelse forbedrer brugerforespørgsler ved at tilføje termer eller kontekst, hvilket optimerer dokumenthentning for præcise svar. I RAG-systemer øger det recall og relevans, hvilket hjælper chatbots og AI med at give præcise svar ved effektivt at håndtere vage eller synonym-forespørgsler.

Forespørgselsudvidelse refererer til processen med at forbedre en brugers oprindelige forespørgsel ved at tilføje yderligere termer eller kontekst, før den sendes til hentningsmekanismen. Denne udvidelse hjælper med at hente mere relevante dokumenter eller information, som derefter bruges til at generere et mere nøjagtigt og kontekstuelt passende svar. Hvis dokumenter søges med alternative forespørgsler og derefter omrangeres, opnår RAG-processen langt mere præcise dokumentresultater i promptens kontekstvindue.

Retrieval-Augmented Generation (RAG) er en AI-arkitektur, der kombinerer hentningsmekanismer med generative modeller for at levere mere nøjagtige og kontekstuelt relevante svar. I RAG-systemer henter en hentningskomponent relevante dokumenter eller datastykker fra en vidensbase baseret på en brugerforespørgsel. Derefter bruger en generativ model (ofte en stor sprogmodel eller LLM) disse hentede informationer til at generere et sammenhængende og informativt svar.

I RAG-systemer afhænger kvaliteten af det genererede svar i høj grad af relevansen af de hentede dokumenter. Hvis hentningskomponenten ikke finder de mest relevante informationer, kan den generative model give suboptimale eller irrelevante svar. Forespørgselsudvidelse adresserer denne udfordring ved at forbedre den oprindelige forespørgsel og øger sandsynligheden for at hente alle relevante dokumenter.

Ved at udvide den oprindelige forespørgsel med relaterede termer, synonymer eller omformuleringer udvider Forespørgselsudvidelse søgeområdet. Dette øger recall for hentningssystemet, hvilket betyder, at det indhenter en højere andel af relevante dokumenter fra vidensbasen. Højere recall giver mere omfattende kontekst for den generative model og forbedrer den samlede kvalitet af RAG-systemets output.

LLMs som GPT-4 kan generere semantisk ensartede forespørgsler eller omformuleringer af den oprindelige forespørgsel. Ved at forstå konteksten og nuancer i sproget kan LLMs producere udvidelser af høj kvalitet, der fanger forskellige måder at stille det samme spørgsmål på.

Eksempel:

I denne tilgang genererer systemet et hypotetisk svar på brugerens forespørgsel med en LLM. Det hypotetiske svar tilføjes derefter til den oprindelige forespørgsel for at give mere kontekst under hentningen.

Proces:

Eksempel:

Denne metode indebærer at generere flere alternative forespørgsler, der dækker forskellige formuleringer eller aspekter af den oprindelige forespørgsel. Hver forespørgsel bruges uafhængigt til at hente dokumenter.

Proces:

Eksempel:

Scenario:

Et AI-system er designet til at besvare spørgsmål baseret på en virksomheds årsrapport. En bruger spørger: “Var der betydelig udskiftning i ledergruppen?”

Implementering:

Fordel:

Ved at give mere kontekst gennem det hypotetiske svar hentes der relevante informationer, som ellers kunne være overset med kun den oprindelige forespørgsel.

Scenario:

En kundeservice-chatbot hjælper brugere med fejlfinding. En bruger skriver: “Mit internet er langsomt.”

Implementering:

Fordel:

Chatbotten dækker et bredere spektrum af mulige problemer og løsninger, hvilket øger chancen for at løse brugerens problem effektivt.

Scenario:

En studerende bruger en AI-assistent til at finde ressourcer om emnet: “Effekter af søvnmangel på kognitive funktioner.”

Implementering:

Fordel:

Den studerende får omfattende information, der dækker forskellige aspekter af emnet, hvilket hjælper til en mere grundig forskning.

Hvis der tilføjes for mange udvidede forespørgsler, kan der hentes irrelevante dokumenter, hvilket mindsker præcisionen.

Afhjælpning:

Ord med flere betydninger kan føre til irrelevante udvidelser.

Afhjælpning:

Generering og behandling af flere udvidede forespørgsler kan være ressourcekrævende.

Afhjælpning:

Sikre, at de udvidede forespørgsler fungerer effektivt sammen med eksisterende hentningsalgoritmer.

Afhjælpning:

Tildeling af vægte til termer i de udvidede forespørgsler for at afspejle deres betydning.

Efter hentning omrangeres dokumenterne for at prioritere relevans.

Eksempel:

Brug en Cross-Encoder efter hentning til at score og omrangere dokumenter ud fra deres relevans i forhold til den oprindelige forespørgsel.

Inddragelse af brugerinteraktioner for at forbedre forespørgselsudvidelse.

Brug af AI og LLMs til forespørgselsudvidelse udnytter avanceret sprogforståelse til at forbedre hentning. Dette gør det muligt for AI-systemer, herunder chatbots og virtuelle assistenter, at levere mere nøjagtige og kontekstuelt relevante svar.

Automatisering af forespørgselsudvidelsen reducerer brugerens behov for at formulere præcise forespørgsler. AI-automatisering håndterer kompleksiteten i baggrunden og forbedrer effektiviteten af informationssøgningen.

Chatbots drager fordel af forespørgselsudvidelse ved bedre at forstå brugerhensigter, især når brugere anvender dagligdags sprog eller ufuldstændige sætninger. Det giver mere tilfredsstillende interaktioner og effektiv problemløsning.

Eksempel:

En chatbot, der hjælper med teknisk support, kan tolke en brugers vage forespørgsel som “Min app virker ikke” ved at udvide den til at inkludere “applikationen crasher”, “softwaren svarer ikke” og “app-fejlmeddelelser”, hvilket fører til hurtigere løsning.

Forskning om Forespørgselsudvidelse til RAG

Forbedring af hentning til RAG-baseret spørgsmål-svar på finansielle dokumenter

Denne artikel undersøger effektiviteten af store sprogmodeller (LLMs) forbedret med Retrieval-Augmented Generation (RAG), især i finansielle dokumentkontekster. Den identificerer, at unøjagtigheder i LLM-output ofte skyldes suboptimal tekstchunk-hentning snarere end selve LLM’erne. Studiet foreslår forbedringer i RAG-processer, herunder avancerede chunking-teknikker og forespørgselsudvidelse, sammen med metadata-annoteringer og omrangeringsalgoritmer. Disse metoder har til formål at forfine teksthentning og dermed forbedre LLM’ers præstation i generering af nøjagtige svar. Læs mere

Forbedring af hentning og håndtering: Et fire-modul-samarbejde for bedre kvalitet og effektivitet i RAG-systemer

Artiklen introducerer en modulær tilgang til at forbedre RAG-systemer med fokus på Query Rewriter-modulet, der skaber søgevenlige forespørgsler for at forbedre videnshentning. Den adresserer problemer med informationsplateauer og tvetydighed i forespørgsler ved at generere flere forespørgsler. Derudover foreslås Knowledge Filter og Memory Knowledge Reservoir for at håndtere irrelevant viden og optimere hentningsressourcer. Disse fremskridt har til formål at øge svarenes kvalitet og effektivitet i RAG-systemer, hvilket er valideret gennem eksperimenter på tværs af QA-datasæt. Få adgang til koden og flere detaljer.

MultiHop-RAG: Benchmarking Retrieval-Augmented Generation for Multi-Hop Queries

Denne forskning fremhæver udfordringer i eksisterende RAG-systemer, når det gælder multi-hop forespørgsler, som kræver ræsonnement på tværs af flere informationsstykker. Den introducerer et nyt datasæt designet til at benchmarke RAG-systemer på multi-hop forespørgsler med henblik på at udvide grænserne for nuværende RAG-kapaciteter. Artiklen diskuterer nødvendige fremskridt for, at RAG-metoder effektivt kan håndtere komplekse forespørgselsstrukturer og forbedre LLM-adoption til praktiske anvendelser.

Forespørgselsudvidelse er processen med at udvide en brugers oprindelige forespørgsel ved at tilføje relaterede termer, synonymer eller kontekst, hvilket hjælper hentningssystemer med at finde mere relevante dokumenter og generere nøjagtige svar, især i AI-drevne applikationer.

I RAG (Retrieval-Augmented Generation) systemer øger Forespørgselsudvidelse recall for hentningskomponenten ved at udvide søgeområdet, så flere relevante dokumenter inddrages i genereringen af præcise svar.

Teknikker inkluderer brug af store sprogmodeller til at generere omformulerede forespørgsler, hypotetisk svargenerering, multi-forespørgselsmetoder, termvægtning og inddragelse af brugerfeedback til løbende forbedring.

Forespørgselsudvidelse forbedrer recall, håndterer vage eller tvetydige forespørgsler, genkender synonymer og forbedrer brugeroplevelsen ved at levere mere nøjagtige og informative svar uden manuel justering af forespørgslen.

Ja, udfordringer inkluderer over-udvidelse (introduktion af irrelevante dokumenter), tvetydighed i termer, krav til computerressourcer og sikring af kompatibilitet med hentningsalgoritmer. Disse kan afhjælpes med kontrolleret generering, relevansfiltrering og effektive modeller.

Se hvordan Forespørgselsudvidelse kan forbedre din AI-chatbots nøjagtighed og optimere informationssøgning. Oplev FlowHunts løsninger til effektiv og automatiseret forespørgselshåndtering.

Forespørgselsudvidelse i FlowHunt forbedrer chatbotforståelsen ved at finde synonymer, rette stavefejl og sikre ensartede, nøjagtige svar på brugerforespørgsler...

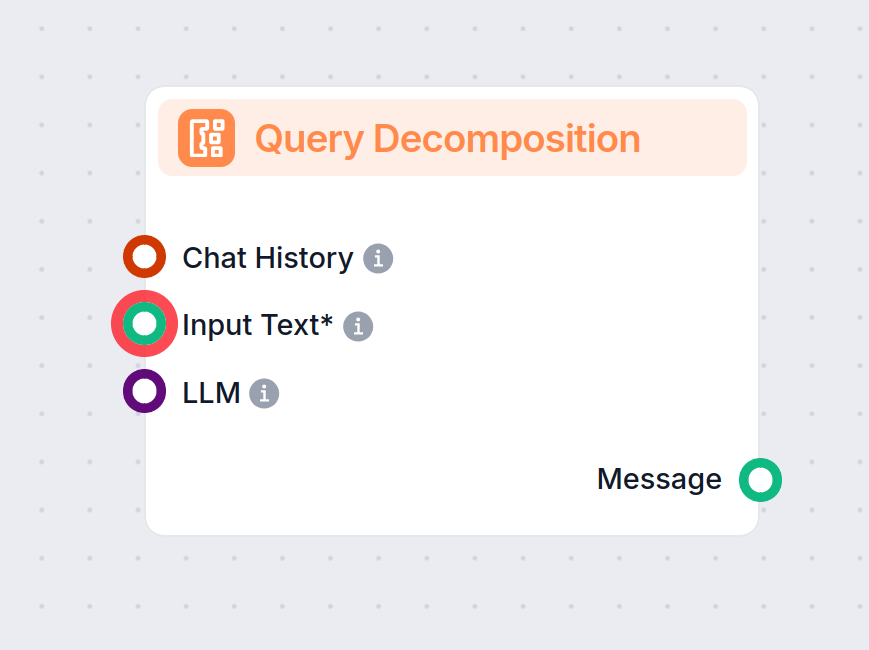

Forespørgselsopdeling i FlowHunt opdeler komplekse forespørgsler i mindre underforespørgsler, hvilket øger AI-svarenes nøjagtighed. Det forenkler input til chat...

Dokument-omrangering er processen med at omarrangere hentede dokumenter baseret på deres relevans for en brugers forespørgsel, og forfiner søgeresultaterne for ...