Forstærkningslæring

Forstærkningslæring (RL) er en underkategori af maskinlæring, der fokuserer på at træne agenter til at træffe sekvenser af beslutninger i et miljø, hvor de lære...

Forstærkningslæring fra menneskelig feedback (RLHF) er en maskinlæringsteknik, der integrerer menneskelig input for at guide træningsprocessen af forstærkningslæringsalgoritmer. I modsætning til traditionel forstærkningslæring, som udelukkende baserer sig på foruddefinerede belønningssignaler, udnytter RLHF menneskelige vurderinger til at forme og forfine AI-modellers adfærd. Denne tilgang sikrer, at AI’en stemmer bedre overens med menneskelige værdier og præferencer, hvilket gør den særligt nyttig i komplekse og subjektive opgaver.

Forstærkningslæring fra menneskelig feedback (RLHF) er en maskinlæringsteknik, der integrerer menneskelig input for at guide træningsprocessen af forstærkningslæringsalgoritmer. I modsætning til traditionel forstærkningslæring, som kun baserer sig på foruddefinerede belønningssignaler, anvender RLHF menneskelige vurderinger til at forme og forfine AI-modellers adfærd. Denne tilgang sikrer, at AI’en stemmer bedre overens med menneskelige værdier og præferencer, hvilket gør den særligt nyttig i komplekse og subjektive opgaver, hvor automatiske signaler ikke er tilstrækkelige.

RLHF er vigtig af flere grunde:

RLHF-processen følger generelt disse trin:

Inden for generativ AI bruges RLHF til at forfine modeller, der skaber tekst, billeder eller andet indhold. For eksempel benytter sprogmodeller som GPT-3 RLHF for at producere mere sammenhængende og kontekstuelt relevant tekst ved at integrere menneskelig feedback på genererede svar.

Robotteknologi kan drage fordel af RLHF ved at inkorporere menneskelig feedback for at forbedre robotters interaktion med omgivelserne. Dette kan føre til mere effektive og sikre robotter, der kan udføre komplekse opgaver i dynamiske miljøer.

RLHF kan forbedre anbefalingssystemer ved at tilpasse dem tættere til brugerens præferencer. Menneskelig feedback hjælper med at finjustere algoritmerne, så anbefalingerne bliver mere relevante og tilfredsstillende for brugeren.

I generativ AI er RLHF afgørende for at forfine modeller, der genererer kreativt indhold som tekst, billeder og musik. Ved at integrere menneskelig feedback kan disse modeller skabe output, der ikke blot er teknisk korrekte, men også æstetisk tiltalende og kontekstuelt passende. Dette er især vigtigt i applikationer som chatbots, indholdsskabelse og kunstneriske projekter, hvor subjektiv kvalitet er altafgørende.

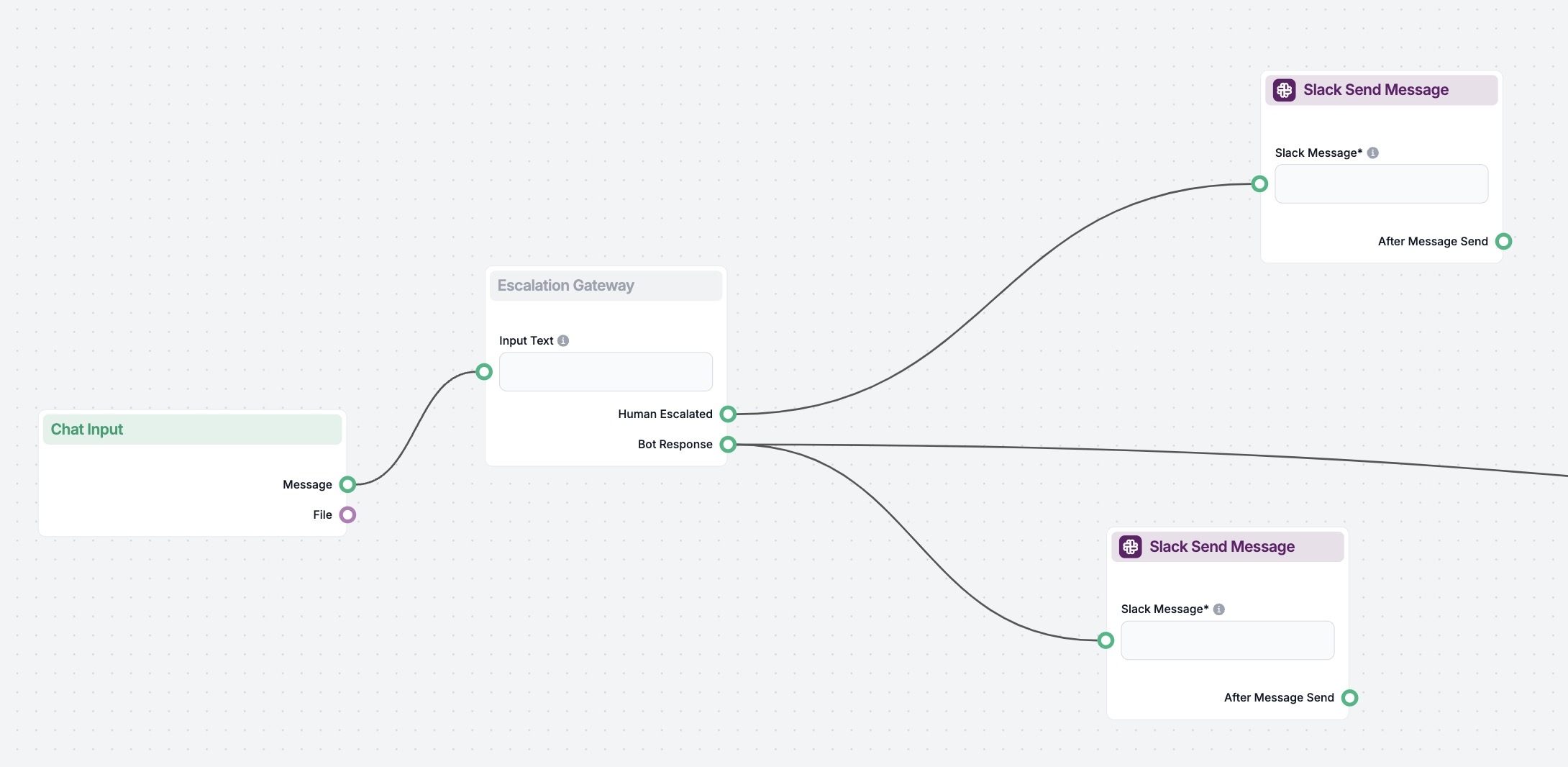

Begynd at bygge AI-løsninger, der stemmer overens med menneskelige værdier, på FlowHunt's platform. Oplev kraften af RLHF i dine projekter.

Forstærkningslæring (RL) er en underkategori af maskinlæring, der fokuserer på at træne agenter til at træffe sekvenser af beslutninger i et miljø, hvor de lære...

Forstærkningslæring (RL) er en metode til at træne maskinlæringsmodeller, hvor en agent lærer at træffe beslutninger ved at udføre handlinger og modtage feedbac...

Opdag vigtigheden og anvendelsen af Human in the Loop (HITL) i AI-chatbots, hvor menneskelig ekspertise forbedrer AI-systemer for øget nøjagtighed, etiske stand...