mcp-local-rag MCP Server

mcp-local-rag MCP Server muliggør privatlivsrespekterende, lokal Retrieval-Augmented Generation (RAG) web-søgning for LLM'er. Den gør det muligt for AI-assisten...

mcp-local-rag MCP Server muliggør privatlivsrespekterende, lokal Retrieval-Augmented Generation (RAG) web-søgning for LLM'er. Den gør det muligt for AI-assisten...

Context Portal (ConPort) er en hukommelsesbank-MCP-server, der styrker AI-assistenter og udviklerværktøjer ved at håndtere struktureret projektkontekst, hvilket...

Integrer FlowHunt med Pinecone vektordatabaser ved hjælp af Pinecone MCP Serveren. Muliggør semantisk søgning, Retrieval-Augmented Generation (RAG) og effektiv ...

RAG Web Browser MCP-serveren udstyrer AI-assistenter og LLM'er med live websøgnings- og indholdsudtrækningsfunktioner, hvilket muliggør retrieval-augmented gene...

Agentset MCP Server er en open source-platform, der muliggør Retrieval-Augmented Generation (RAG) med agentiske funktioner, så AI-assistenter kan forbindes til ...

Inkeep MCP Server forbinder AI-assistenter og udviklerværktøjer med opdateret produktdokumentation administreret i Inkeep, hvilket muliggør direkte, sikker og e...

mcp-rag-local MCP Server giver AI-assistenter semantisk hukommelse, så de kan lagre og hente tekstafsnit baseret på betydning og ikke kun nøgleord. Den bruger O...

Graphlit MCP Server forbinder FlowHunt og andre MCP-klienter til en samlet vidensplatform, hvilket muliggør problemfri indtagelse, aggregering og hentning af do...

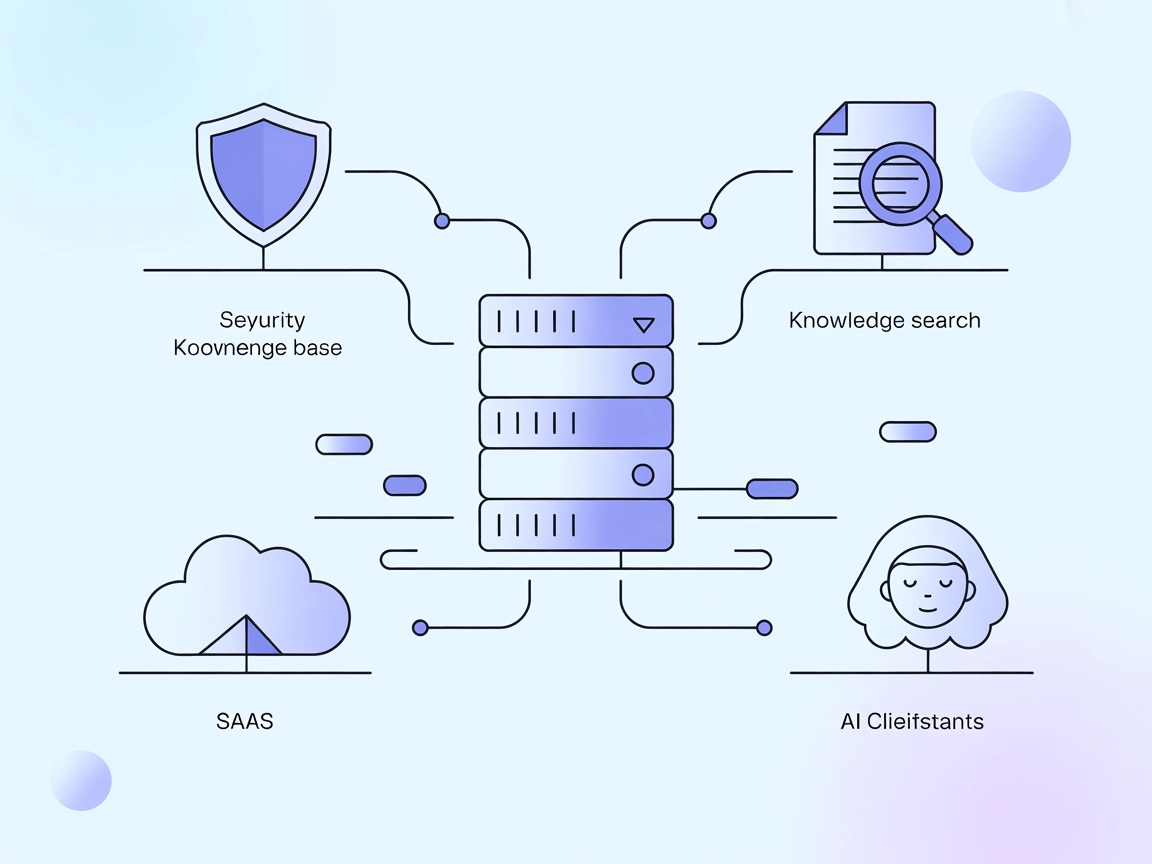

Vectara MCP Server er en open source-bro mellem AI-assistenter og Vectara's Trusted RAG-platform, der muliggør sikker og effektiv Retrieval-Augmented Generation...

Cache Augmented Generation (CAG) er en ny tilgang til at forbedre store sprogmodeller (LLM'er) ved at forudindlæse viden som forudberegnede key-value-cacher, hv...

Dokument-omrangering er processen med at omarrangere hentede dokumenter baseret på deres relevans for en brugers forespørgsel, og forfiner søgeresultaterne for ...

Dokumentbedømmelse i Retrieval-Augmented Generation (RAG) er processen med at evaluere og rangere dokumenter baseret på deres relevans og kvalitet som svar på e...

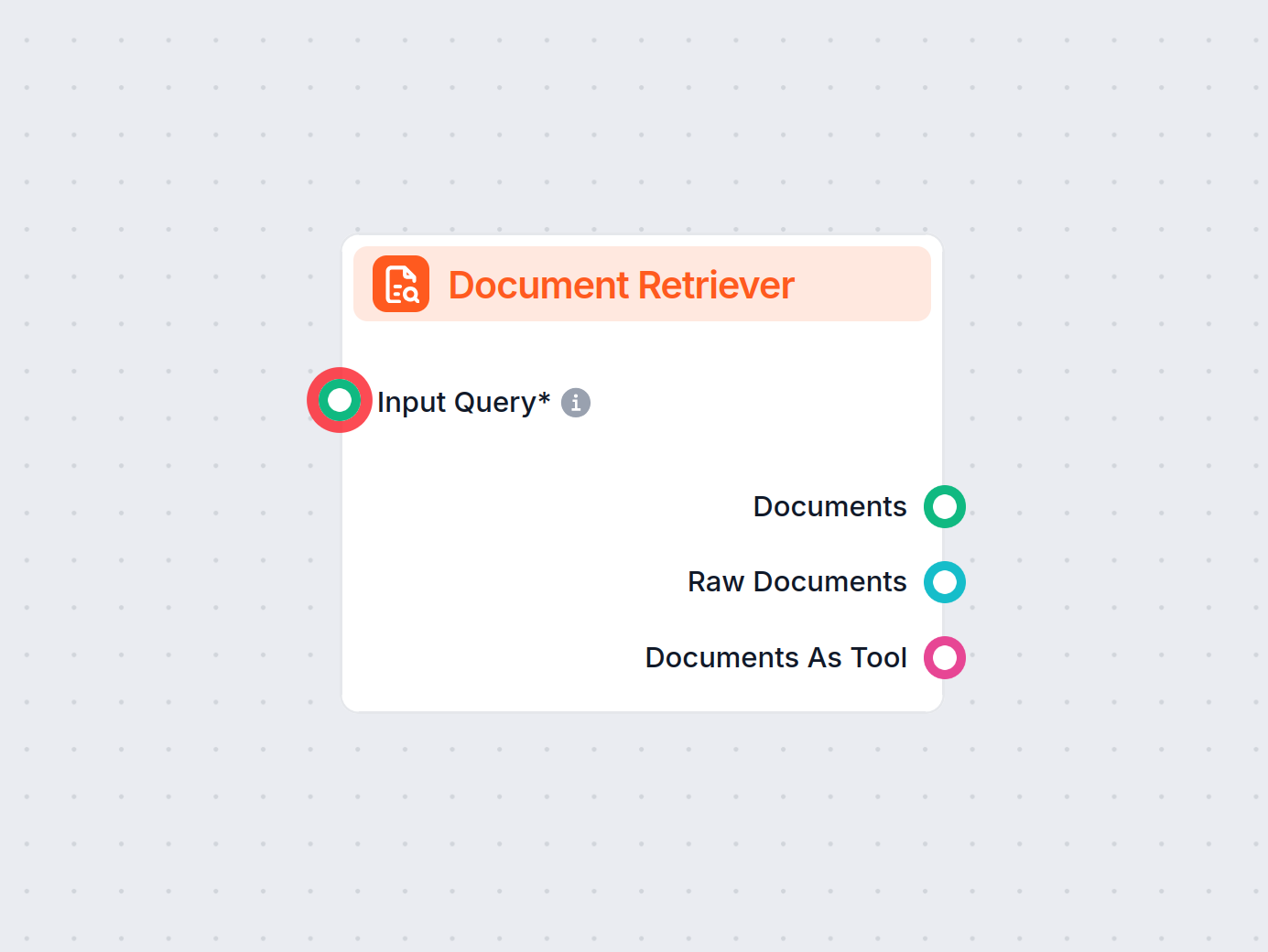

FlowHunt's Dokumenthenter forbedrer AI-nøjagtigheden ved at forbinde generative modeller til dine egne opdaterede dokumenter og URL'er, hvilket sikrer pålidelig...

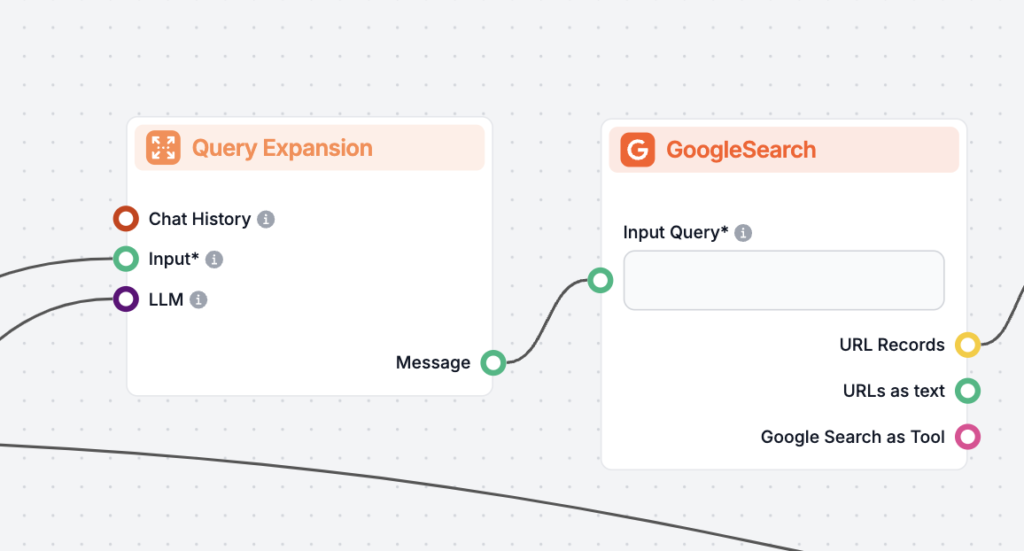

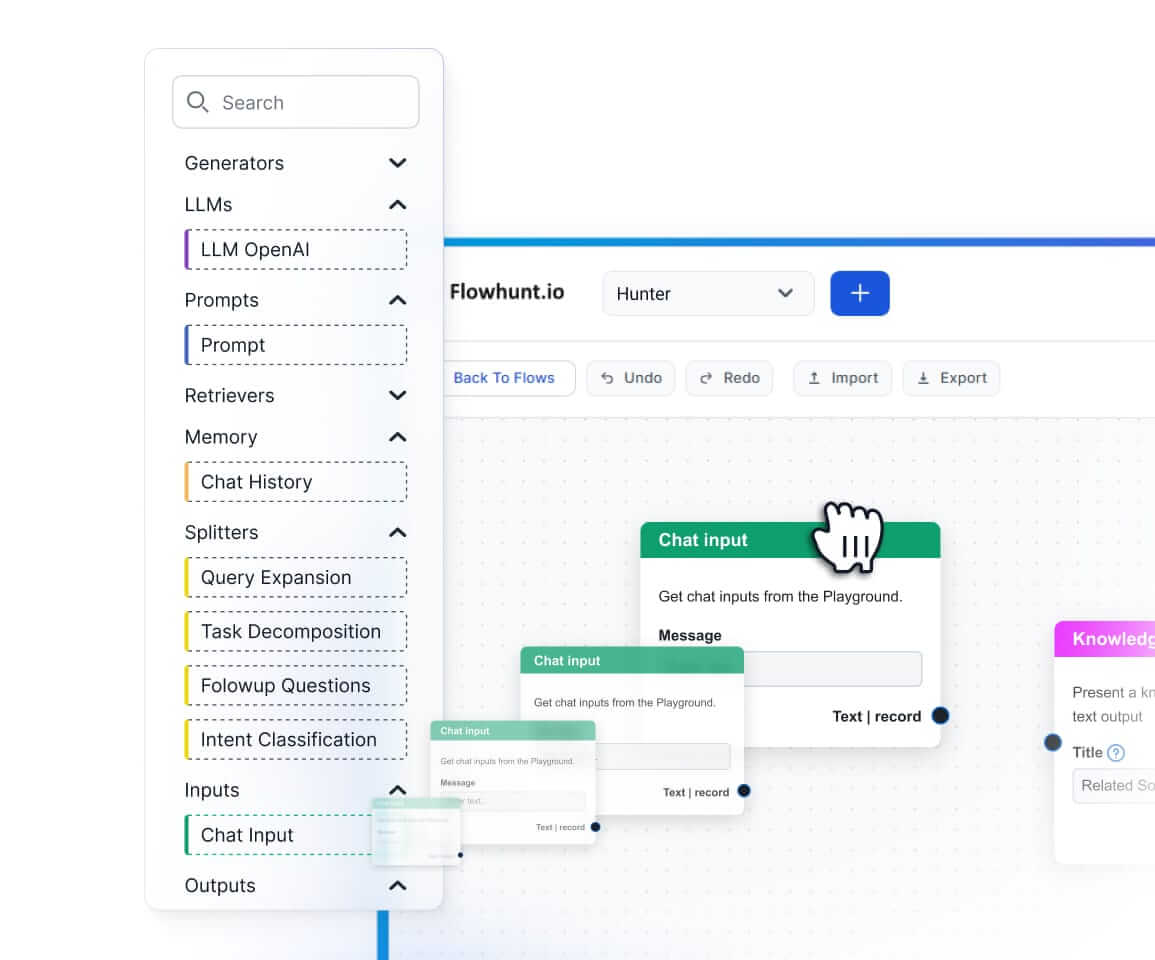

Forespørgselsudvidelse er processen med at forbedre en brugers oprindelige forespørgsel ved at tilføje termer eller kontekst, hvilket forbedrer dokumenthentning...

Forøg AI-nøjagtigheden med RIG! Lær, hvordan du opretter chatbots, der faktatjekker svar ved hjælp af både brugerdefinerede og generelle datakilder for pålideli...

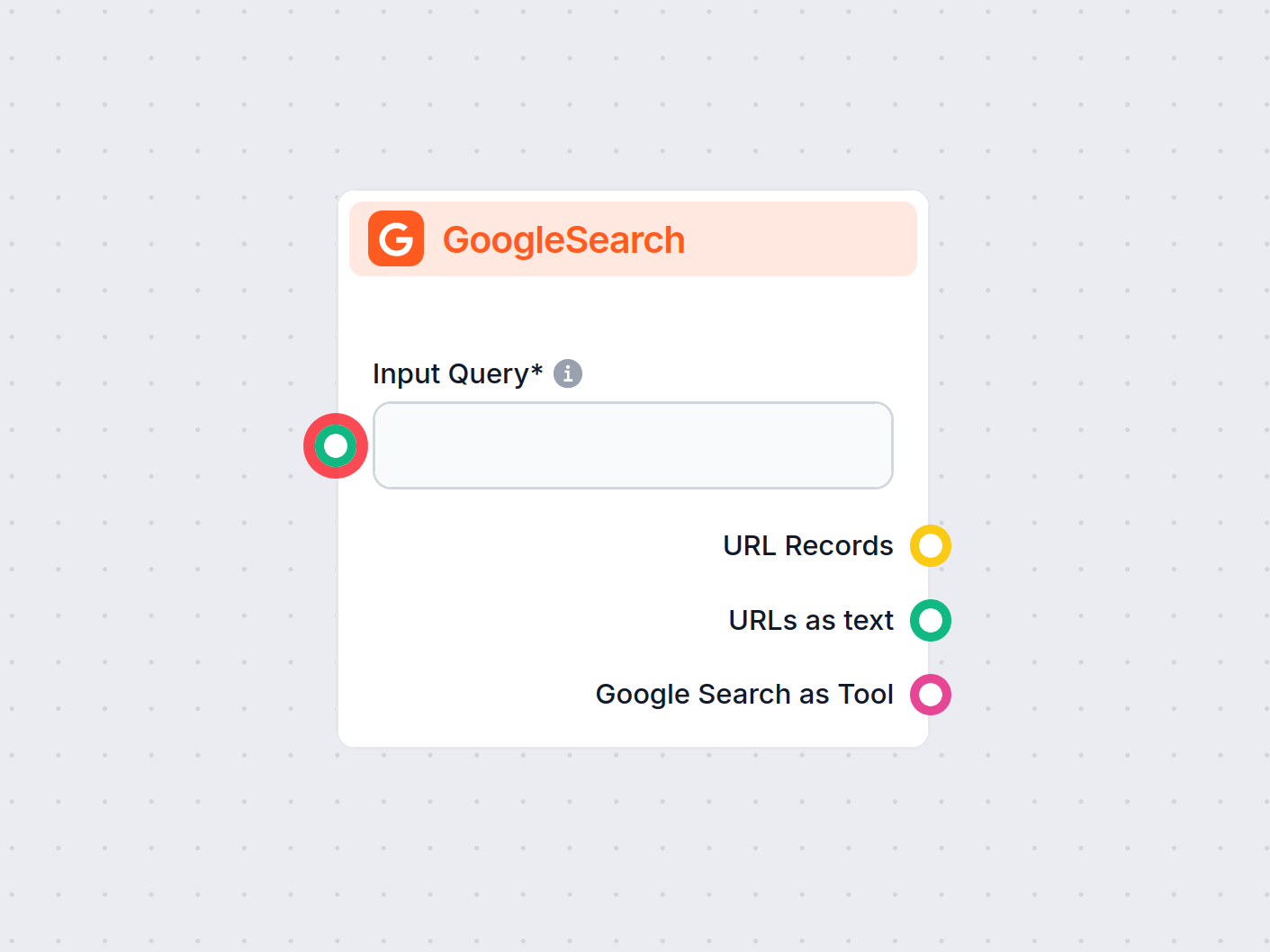

FlowHunts GoogleSearch-komponent forbedrer chatbot-præcisionen ved hjælp af Retrieval-Augmented Generation (RAG) til at få adgang til opdateret viden fra Google...

LazyGraphRAG er en innovativ tilgang til Retrieval-Augmented Generation (RAG), som optimerer effektivitet og reducerer omkostninger i AI-drevet datahentning ved...

Udforsk hvordan OpenAI O1's avancerede ræsonnementsevner og forstærkningslæring overgår GPT4o i RAG-nøjagtighed, med benchmarks og omkostningsanalyse.

Retrieval Augmented Generation (RAG) er en avanceret AI-ramme, der kombinerer traditionelle informationshentningssystemer med generative store sprogmodeller (LL...

Opdag hvad en retrieval pipeline er for chatbots, dens komponenter, anvendelsestilfælde, og hvordan Retrieval-Augmented Generation (RAG) og eksterne datakilder ...

Opdag de vigtigste forskelle mellem Retrieval-Augmented Generation (RAG) og Cache-Augmented Generation (CAG) i AI. Lær, hvordan RAG dynamisk henter realtidsinfo...

Spørgsmål og Svar med Retrieval-Augmented Generation (RAG) kombinerer informationssøgning og generering af naturligt sprog for at forbedre store sprogmodeller (...

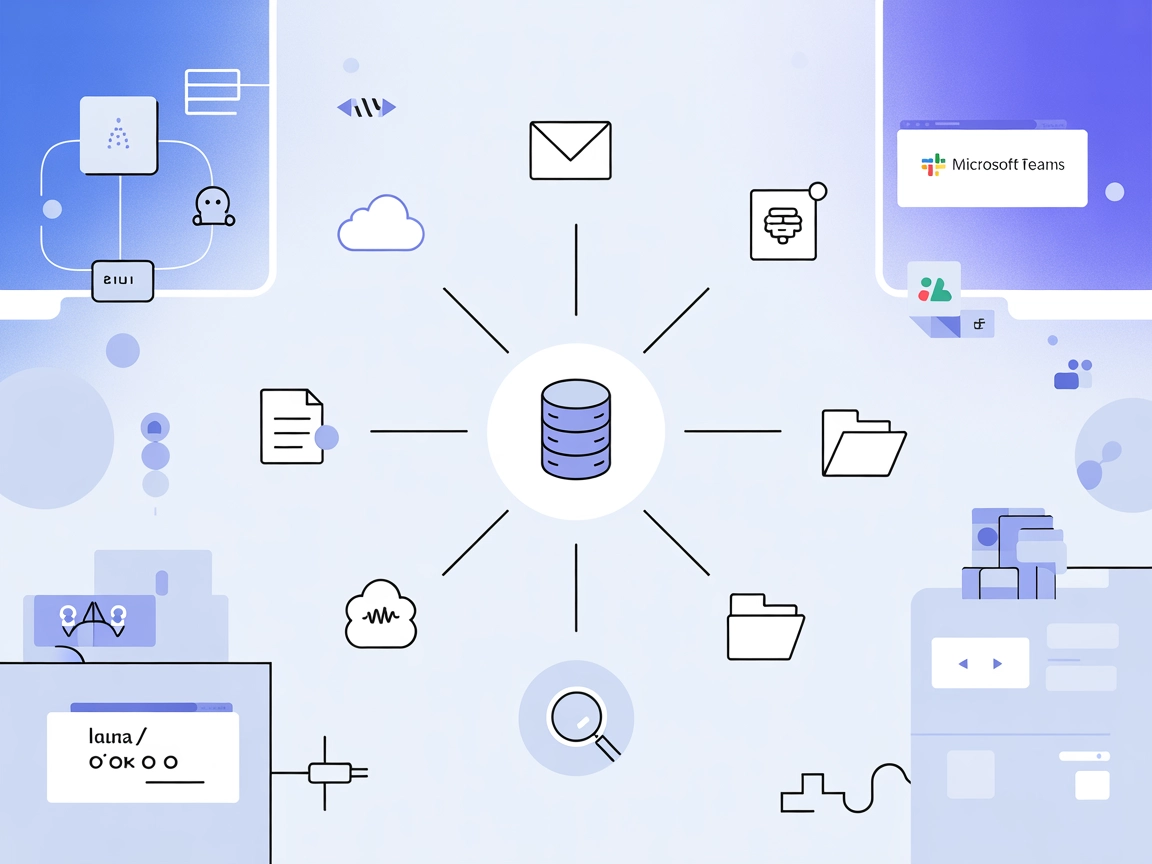

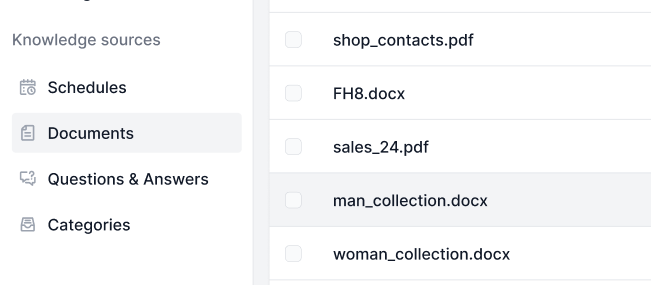

Videnskabskilder gør det nemt at tilpasse AI’en efter dine behov. Oplev alle måderne at forbinde viden med FlowHunt. Forbind nemt hjemmesider, dokumenter og vid...