KI-Agenten unterscheiden sich grundlegend von Chatbots. Ein Chatbot wartet auf Benutzereingaben und reagiert. Ein Agent verfolgt eigenständig Ziele, ruft Tools auf, denkt über Probleme nach und führt Aktionen aus, ohne in jedem Schritt menschlichen Input zu benötigen.

Dieser Unterschied ist wichtig, weil Agenten ganze Workflows automatisieren können. Ein Agent zur Lead-Qualifizierung bewertet Interessenten, reichert ihre Daten an und weist sie Vertriebsmitarbeitern zu – alles ohne menschlichen Eingriff. Ein Agent für Content-Triage kategorisiert Support-Tickets, leitet sie an Spezialisten weiter und eskaliert Randfälle an Menschen.

In diesem Leitfaden lernst du, wie du zuverlässige Agenten konstruierst, sie in Geschäftssysteme integrierst, häufige Fehler verhinderst und ihre Wirkung misst. Wir behandeln reale Muster, die im Produktivbetrieb bei Unternehmen eingesetzt werden, die Lead-Qualifizierung, Dokumentenverarbeitung und Kundensupport in großem Maßstab automatisieren.

Was sind KI-Agenten und wie unterscheiden sie sich von Chatbots?

Definition von KI-Agenten (autonome Systeme, die wahrnehmen, entscheiden, handeln)

Ein KI-Agent ist ein Softwaresystem, das:

- Seine Umgebung wahrnimmt (Eingaben, Tool-Ergebnisse, Speicher liest)

- Über die beste Aktion nachdenkt (nutzt ein LLM zur Planung)

- Handelt, indem es Tools aufruft oder Schritte in Richtung Ziel unternimmt

- Sich basierend auf Feedback und Ergebnissen anpasst

Agenten sind zielorientiert. Du definierst das Ziel („Bewerte und qualifiziere diesen Lead“), und der Agent findet heraus, wie es erreicht wird.

Kernunterschied: Chatbots sind reaktiv; Agenten sind autonom

Chatbots: Nutzer initiiert → Modell antwortet

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

Der Nutzer treibt jede Interaktion an. Der Chatbot ist zustandslos – jede Nachricht ist unabhängig.

Agenten: Zielorientiert, führen Aktionen ohne Nutzer-Input in jedem Schritt aus

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

Der Agent arbeitet auf ein definiertes Ziel hin und trifft autonom mehrere Entscheidungen und Tool-Aufrufe.

Warum Agenten für Workflows wichtig sind

Automatisierung im großen Maßstab (tausende Aufgaben ohne menschlichen Eingriff)

Manuelle Lead-Qualifizierung: 5 Minuten pro Lead × 100 Leads = 500 Stunden/Monat. Kosten: 10.000 $/Monat (bei 20 $/Stunde).

Agentengesteuert: 10 Sekunden pro Lead × 100 Leads = 16 Stunden/Monat. Kosten: 100 $ (Agent-API-Aufrufe). Ersparnis: 99 %.

Agenten vervielfachen die Kapazität deines Teams ohne Einstellungen.

Mehrstufiges Reasoning (komplexe Probleme in Teilaufgaben zerlegen)

Komplexe Aufgaben erfordern mehrere Schritte:

- Lead-Qualifizierung: Bewerten → Anreichern → Zuweisen → Benachrichtigen

- Dokumenten-Triage: Extrahieren → Klassifizieren → Weiterleiten → Archivieren

- Kundensupport: Verstehen → Wissensdatenbank durchsuchen → Antwort generieren → Bei Bedarf weiterleiten

Agenten bewältigen dieses Reasoning automatisch. Du definierst das Ziel; der Agent zerlegt es in Schritte.

Tool-Nutzung (Agenten rufen APIs, Datenbanken, externe Dienste auf)

Agenten sind die „Hände“. Sie rufen APIs auf, um:

- Datenbanken abzufragen

- CRM-Systeme zu aktualisieren

- E-Mails oder Slack-Nachrichten zu senden

- Drittanbieter-Services aufzurufen (Datenanreicherung, Zahlungsabwicklung)

Ein einzelner Agent kann 5–10 Tool-Aufrufe zur Fertigstellung eines Workflows orchestrieren.

Adaptives Verhalten (aus Feedback lernen, Ansatz anpassen)

Agenten können sich im Laufe der Zeit verbessern. Wenn ein Agent Dokumente falsch klassifiziert, gibst du Feedback. Der Agent lernt und passt seine Prompting-Strategie an.

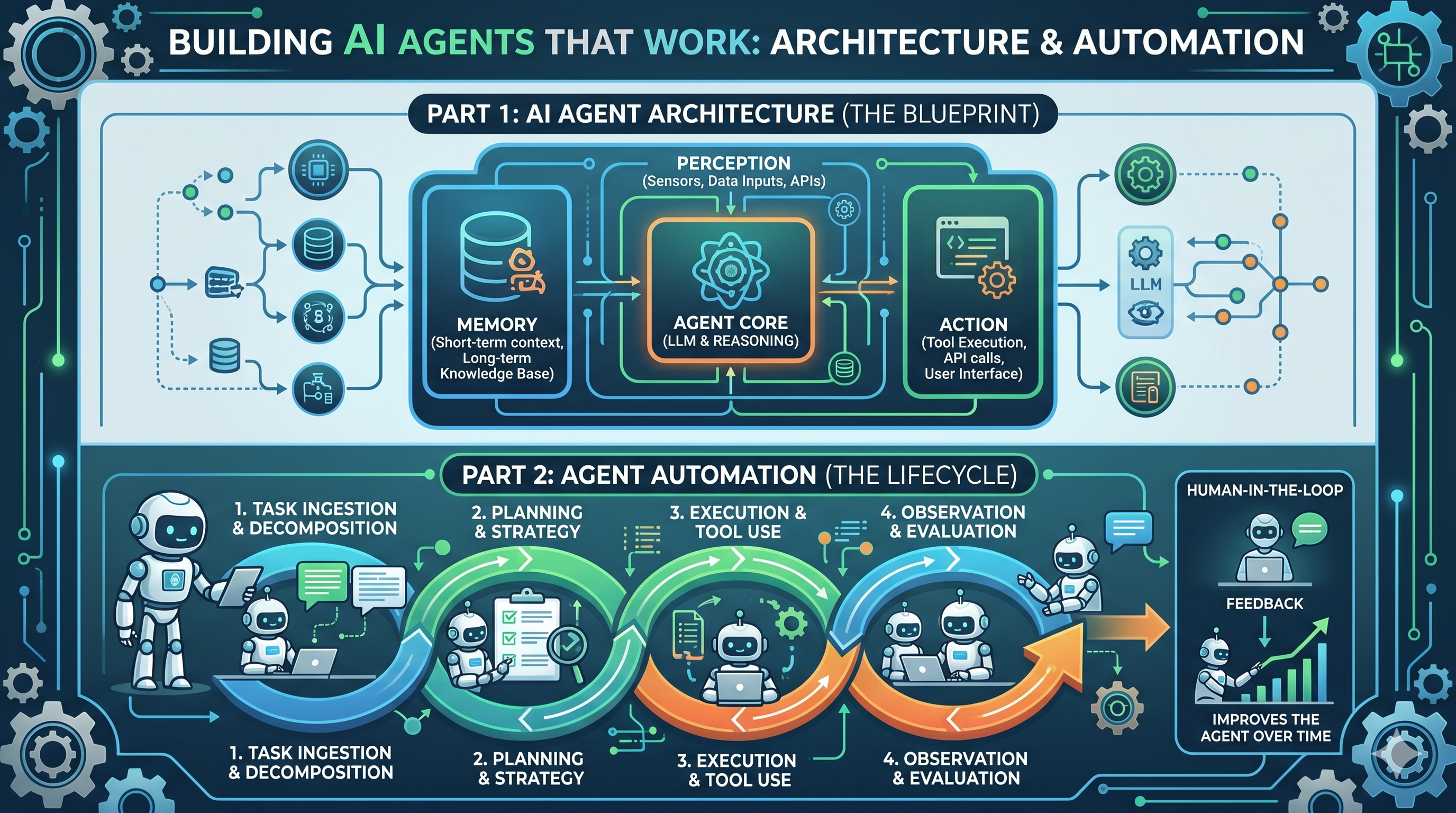

Kernkomponenten eines KI-Agenten (die Agenten-Schleife)

Die Reasoning-Schleife des Agenten (mit Diagrammbeschreibung)

Der Kern jedes Agenten ist eine Schleife:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Beobachtung: Der Agent nimmt den Zustand wahr (Eingabe, Umgebung, Tool-Ergebnisse)

Der Agent liest:

- Initiale Eingabe (Lead-Daten, Dokumententext, Kundenfrage)

- Tool-Ergebnisse aus vorherigen Schritten (API-Antworten, Datenbankabfragen)

- Speicher (Gesprächsverlauf, frühere Entscheidungen, Wissensdatenbank)

- Aktuellen Zustand (was wurde erledigt, was fehlt noch)

Reasoning: Das LLM entscheidet die nächste Aktion (Planung, Tool-Auswahl)

Das LLM erhält einen Prompt wie:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

Das LLM antwortet: „Ich sollte den Lead zuerst anreichern, um Umsatzdaten zu erhalten, dann bewerten, dann zuweisen.“

Aktion: Tool-Aufruf ausführen oder Schritt Richtung Ziel machen

Der Agent führt das gewählte Tool aus:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: Ergebnis bewerten, Strategie bei Bedarf anpassen

Der Agent prüft: War der Tool-Aufruf erfolgreich? Hat er in Richtung Ziel bewegt? Speicher aktualisieren und Schleife fortsetzen.

Schleife: Wiederholen, bis Ziel erreicht oder max. Schritte erreicht

Der Agent wiederholt Beobachtung → Reasoning → Aktion → Feedback, bis:

- Das Ziel erreicht ist („Lead bewertet und zugewiesen“)

- Max. Schritte erreicht (verhindert endlose Schleifen)

- Ein Fehler auftritt (Eskalation an Menschen)

Tool-Integration (die „Hände“ des Agenten)

Tools definieren (Funktionssignaturen, Beschreibungen, Parameter)

Tools sind Funktionen, die der Agent aufrufen kann. Definiere sie klar:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Klare Beschreibungen helfen dem LLM, das richtige Tool zu wählen.

Tool-Aufruf (wie Agenten Tools auswählen und aufrufen)

Das LLM antwortet mit einem Tool-Aufruf:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Dein Agenten-Framework führt das Tool aus und gibt das Ergebnis an das LLM zurück.

Umgang mit Tool-Ergebnissen (Antworten parsen, Fehlerbehebung)

Behandle Erfolg und Fehler:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Wenn ein Tool fehlschlägt, sollte der Agent einen anderen Ansatz versuchen oder an einen Menschen eskalieren.

Speichersysteme (was Agenten sich merken)

Kurzzeitgedächtnis (aktueller Gesprächskontext)

Das Arbeitsgedächtnis des Agenten: aktuelle Eingabe, Tool-Ergebnisse, Reasoning-Schritte. Üblicherweise im Kontextfenster (dem Prompt) gespeichert.

Beispiel: Lead-Qualifizierungsagent erinnert sich an:

- Original-Lead-Daten

- Anreicherungsergebnisse

- Score

- Welcher Vertriebsmitarbeiter zugewiesen wurde

Langzeitgedächtnis (Wissensdatenbank, frühere Interaktionen)

Persistenter Speicher: frühere Entscheidungen, gelernte Muster, Wissensdatenbank.

Anwendungsfälle:

- Wissensdatenbank: Agent ruft relevante Artikel ab, wenn er Kundenfragen beantwortet

- Entscheidungshistorie: Agent lernt, welche Leads konvertiert haben (verbessert Scoring)

- Interaktions-Logs: Agent erinnert sich an frühere Interaktionen mit einem Kunden

Umsetzung mit Vektordatenbanken (Pinecone, Weaviate) für semantische Suche.

Speicherbeschränkungen (Limits des Kontextfensters)

LLMs haben begrenzte Kontextfenster (4K–128K Token). Agenten können sich nicht alles merken. Strategien:

- Zusammenfassung: Alte Gespräche zu Zusammenfassungen komprimieren

- Retrieval-Augmented Generation (RAG): Nur relevanten Speicher bei Bedarf abrufen

- Hierarchischer Speicher: Neuere Interaktionen im Kurzzeitgedächtnis, ältere im Langzeitgedächtnis

Reasoning-Rückgrat (das „Gehirn“)

LLM-Auswahl (GPT-4, Claude, Open-Source-Modelle)

- GPT-4: Bestes Reasoning, bewältigt komplexe Aufgaben. Kosten: 0,03–0,06 $ pro 1K Token.

- Claude 3.5 Sonnet: Starkes Reasoning, langer Kontext (200K Token). Kosten: 0,003–0,015 $ pro 1K Token.

- Open-Source (LLaMA 4): Günstiger (0,01–0,03 $ pro 1M Token), anpassbar, datenschutzfreundlich.

Für die meisten Agenten sind Claude oder Open-Source-Modelle ausreichend und günstiger.

Reasoning-Modi (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-Thought: Agent denkt Schritt für Schritt. „Ich muss anreichern → bewerten → zuweisen.“

- Tree-of-Thought: Agent erforscht mehrere Pfade, wählt den besten. Langsamer, aber genauer bei komplexen Problemen.

- Reflexion: Agent kritisiert eigenen Output, versucht es bei Bedarf erneut. Reduziert Halluzinationen.

Beispiel für Reflexion-Prompt:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Trade-offs: Geschwindigkeit vs. Genauigkeit

- Schnelle Agenten: Einzel-Turn-Reasoning, keine Tool-Validierung. 2–5 Sekunden pro Aufgabe. 85 % Genauigkeit.

- Genaue Agenten: Mehrstufiges Reasoning, Validierung, Reflexion. 10–30 Sekunden pro Aufgabe. 95 % Genauigkeit.

Wähle Geschwindigkeit für Echtzeit (Kundensupport). Wähle Genauigkeit für Entscheidungen mit hohem Risiko (Finanzentscheidungen).

Arten von Agenten und wann man welchen einsetzt

Reaktive Agenten (einfach, schnell, zustandslos)

Funktionsweise (Einzelner Turn: Eingabe → Aktion)

Reaktive Agenten treffen eine einzelne Entscheidung und handeln. Keine mehrstufige Planung.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

Am besten geeignet für: Einfache Tool-Nutzung, API-Aufrufe, Sofortantworten

- Kundenservice-Q&A (Bestellung nachschlagen, Kontostand prüfen)

- Einfache API-Aufrufe (Wetter abrufen, Aktienkurs prüfen)

- Sofortantworten nötig (< 2 Sekunden Latenz)

Beispiel: Kundenservice-Chatbot mit Wissensdatenbank-Abfrage

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latenz: 1–3 Sekunden. Kosten: 0,001–0,01 $ pro Abfrage.

Planende Agenten (zielorientiert, mehrstufiges Reasoning)

Funktionsweise (Ziel in Teilaufgaben zerlegen, Plan ausführen)

Planende Agenten zerlegen komplexe Ziele in Schritte.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

Am besten geeignet für: Komplexe Workflows, Rechercheaufgaben, Datenanalyse

- Lead-Qualifizierung (anreichern → bewerten → zuweisen)

- Dokumentenverarbeitung (extrahieren → klassifizieren → speichern)

- Rechercheaufgaben (suchen → zusammenfassen → zusammenstellen)

Beispiel: Lead-Qualifizierungsagent (bewerten → anreichern → zuweisen)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latenz: 5–15 Sekunden. Kosten: 0,02–0,05 $ pro Lead.

Lernende Agenten (adaptiv, verbessern sich mit der Zeit)

Funktionsweise (Feedback einbeziehen, Verhalten anpassen)

Lernende Agenten werden durch Feedback besser.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

Am besten geeignet für: Langlaufende Prozesse, Personalisierung, Optimierung

- Content-Empfehlung (lernt Nutzerpräferenzen)

- Routing im Kundensupport (lernt, welche Mitarbeiter welche Probleme am besten handhaben)

- Preisoptimierung (lernt, welche Preise am besten konvertieren)

Beispiel: Content-Empfehlungsagent (lernt Nutzerpräferenzen)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Mit der Zeit verbessern sich die Empfehlungen, während der Agent Nutzerpräferenzen lernt.

Hierarchische Agenten (Agenten, die andere Agenten steuern)

Funktionsweise (Supervisor-Agent delegiert an Spezialisten)

Ein Supervisor-Agent koordiniert Spezialisten-Agenten.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

Am besten geeignet für: Unternehmens-Workflows, großflächige Automatisierung

- Content-Erstellung (Recherche → Schreiben → Redigieren → Veröffentlichen)

- Komplexer Kundensupport (Triage → Lösen → Eskalieren)

- Datenverarbeitungs-Pipelines (Extrahieren → Transformieren → Laden)

Beispiel: Content-Erstellungs-Pipeline (Recherche → Schreiben → Redigieren → Veröffentlichen)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Jeder Spezialisten-Agent ist für seine Aufgabe optimiert. Der Supervisor orchestriert.

Top KI-Agent-Tools & Frameworks 2026 (Vergleichstabelle)

Bewertungskriterien

Reasoning-Fähigkeit (Chain-of-Thought, Planung, Reflexion)

Wie ausgefeilt das Denken des Agenten ist. Einfache Agenten nutzen Chain-of-Thought. Komplexe Agenten verwenden Planung und Reflexion.

Tool-Integration (wie einfach lassen sich eigene Tools hinzufügen)

Kannst du APIs, Datenbanken, CRM-Systeme leicht anbinden? Oder brauchst du eigenen Code?

Lernkurve (Einrichtungszeit, Qualität der Dokumentation)

Wie schnell kann ein Entwickler einen funktionierenden Agenten bauen? No-Code-Plattformen sind schneller; Python-Frameworks flexibler.

Preismodell (kostenlos, pro API-Aufruf, Abonnement)

Manche Frameworks sind Open Source (kostenlos). Andere berechnen pro API-Aufruf oder per Abo.

Beste Anwendungsfälle

Worauf ist jedes Tool optimiert?

Vergleichstabelle: Top KI-Agent-Tools & Frameworks (2026)

| Tool | Framework Type | Reasoning Capability | Tool Integration | Learning Curve | Pricing | Best For |

|---|---|---|---|---|---|---|

| n8n | Visual workflow builder | Chain-of-thought | 500+ integrations | Low | Free + paid | Non-technical users, quick setup |

| CrewAI | Python framework | Planning + reflexion | Custom tools (Python) | Medium | Open-source | Developers, complex agents |

| Autogen | Python framework | Multi-agent reasoning | Custom tools | High | Open-source | Research, multi-agent systems |

| LangGraph | Python framework | Planning + state management | LangChain ecosystem | Medium | Open-source | Complex workflows, state tracking |

| FlowHunt | Native platform | Chain-of-thought + planning | Native + API integrations | Low | Subscription | Workflow automation, ease-of-use |

| Lindy.ai | No-code platform | Chain-of-thought | 100+ integrations | Very low | Freemium | Non-technical, quick agents |

| Gumloop | No-code platform | Chain-of-thought | 50+ integrations | Very low | Freemium | Simple automation, templates |

Wichtige Unterschiede:

- No-Code (n8n, FlowHunt, Lindy.ai): Schnell aufzubauen, eingeschränkte Anpassbarkeit. Gut für Standard-Workflows.

- Python-Frameworks (CrewAI, Autogen, LangGraph): Flexibel, mächtig, steilere Lernkurve. Gut für komplexe Logik.

- Open Source (CrewAI, Autogen, LangGraph): Kostenlos, aber du verwaltest die Infrastruktur. Bezahlte Plattformen übernehmen das Hosting.

Wie wählt man das richtige Tool für seinen Anwendungsfall

- Schneller Prototyp (< 1 Woche): Nutze No-Code (FlowHunt, n8n, Lindy.ai)

- Komplexer Agent mit eigener Logik: Nutze Python-Framework (CrewAI, LangGraph)

- Multi-Agenten-System (Agenten koordinieren sich): Nutze Autogen

- Produktions-Workflow-Automatisierung: Nutze FlowHunt (verwaltet, überwacht, skaliert)

Deinen ersten Agenten bauen: Architektur Schritt für Schritt

Ziel und Umfang des Agenten definieren

Welches Problem löst er?

Sei konkret. Schlecht: „Lead-Management automatisieren.“ Gut: „Leads von 0–100 bewerten, mit Firmendaten anreichern, basierend auf Kapazität an Vertriebsmitarbeiter zuweisen.“

Was sind die Erfolgsmetriken?

- Genauigkeit: % richtige Entscheidungen (Ziel: > 90 %)

- Latenz: Zeit zur Erledigung der Aufgabe (Ziel: < 10 Sekunden)

- Kosten: API-Aufrufe pro Aufgabe (Ziel: < 0,05 $)

- Automatisierungsrate: % Aufgaben ohne menschlichen Eingriff (Ziel: > 80 %)

Was sind die Einschränkungen (Latenz, Kosten, Genauigkeit)?

Trade-offs:

- Echtzeit-Workflows: Brauchen < 5 Sekunden Latenz. Nutze schnelle Modelle, weniger Tool-Aufrufe.

- Batch-Workflows: Können 5–30 Minuten tolerieren. Nutze genaueres Reasoning, mehr Tool-Aufrufe.

- Kostensensitiv: Nutze Open-Source-Modelle, weniger API-Aufrufe.

- Genauigkeitskritisch: Nutze teure Modelle (GPT-4), mehrstufige Validierung.

Agenten-Schleife entwerfen

Was wird der Agent beobachten?

Eingabedaten: Lead-Daten, Dokumententext, Kundenfrage, Kontext aus dem Speicher.

Welcher Reasoning-Modus (einfaches Chain-of-Thought vs. Planung)?

- Chain-of-Thought: Schnell, einfach. „Ich mache Schritt 1, dann Schritt 2.“

- Planung: Langsamer, genauer. „Lass mich zuerst alle Schritte planen, dann ausführen.“

Welche Tools braucht er?

Liste die APIs, Datenbanken und Dienste auf, die der Agent aufrufen wird.

Beispiel für Lead-Qualifizierung:

- CRM-API (Lead abrufen/aktualisieren)

- Datenanreicherungs-API (Firmendaten abrufen)

- Scoring-Modell (Lead bewerten)

- Benachrichtigungsdienst (Slack/E-Mail senden)

Woher weiß er, wann er stoppen soll?

Definiere die Erfolgsbedingung. „Stopp, wenn Lead bewertet und zugewiesen.“

Definiere auch maximale Schritte, um endlose Schleifen zu verhindern. „Stopp nach 10 Schritten, unabhängig von allem.“

Implementieren und testen

Pseudocode- oder echtes Code-Beispiel (CrewAI oder FlowHunt)

CrewAI-Beispiel:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Teststrategie (Unit-Tests für Tool-Aufrufe, Integrationstests für Schleifen)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Debugging häufiger Probleme (Endlosschleifen, Halluzinationen, falsche Tools)

- Endlosschleifen: Füge Schritt-Limit hinzu. Logge jeden Schritt. Überwache wiederholte Aktionen.

- Halluzinationen: Füge Validierung hinzu. Prüfe Ausgaben gegen Quelldaten.

- Falsche Tools: Verbessere Tool-Beschreibungen. Füge Tool-Validierung vor Ausführung hinzu.

Reales Beispiel: Lead-Qualifizierungsagent

Ziel: Leads bewerten, Daten anreichern, an Vertriebsteam zuweisen

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Tools: CRM-API, Datenanreicherungsdienst, Scoring-Modell

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Pseudocode-Durchlauf (Lead beobachten → bewerten → anreichern → zuweisen)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Ergebnisse: Genauigkeit, Latenz, Kostenmetriken

- Genauigkeit: 94 % (Lead-Score stimmt mit manueller Prüfung überein)

- Latenz: 8 Sekunden (5 Tool-Aufrufe, 3 LLM-Reasoning-Schritte)

- Kosten: 0,03 $ pro Lead (GPT-4-API-Aufrufe + Anreicherungs-API)

- Durchsatz: 450 Leads/Stunde (einzelne Agenten-Instanz)

- Automatisierungsrate: 87 % (13 % an Menschen zur Prüfung eskaliert)

Agenten in Geschäftssysteme integrieren

API-Integrationsmuster

REST-APIs (am häufigsten)

Die meisten Agenten rufen REST-APIs auf. Nutze einen Standard-HTTP-Client:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (ereignisgesteuerte Agenten-Trigger)

Agenten bei Ereignissen auslösen (neuer Lead, eingehende E-Mail, Formular-Einreichung):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Authentifizierung & Sicherheit (API-Keys, OAuth, Rate-Limiting)

- API-Keys: In Umgebungsvariablen speichern, nicht im Code

- OAuth: Für nutzerorientierte Integrationen (Salesforce, HubSpot)

- Rate-Limiting: API-Limits respektieren. Backoff- und Retry-Logik implementieren

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Datenbank-Integration

Nur-Lesen (Agent fragt Daten ab)

Agent liest Kundendaten, frühere Interaktionen, Wissensdatenbank:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Schreiboperationen (Agent speichert Entscheidungen/Ergebnisse)

Agent schreibt Entscheidungen in Datenbank:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transaktionen & Konsistenz (Datenintegrität sicherstellen)

Nutze Transaktionen für mehrstufige Operationen:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

CRM- & Business-Tool-Integration

Salesforce-, HubSpot-, Pipedrive-Integrationsmuster

Offizielle SDKs nutzen:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Slack-, E-Mail-, Jira-Integration (Agent sendet Benachrichtigungen/Updates)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Authentifizierung & Berechtigungsbereiche

Nutze OAuth-Scopes, um einzuschränken, was Agenten tun dürfen:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Human-in-the-Loop-Workflows

Wann Agenten menschliche Freigabe brauchen

Entscheidungen mit hohem Risiko: Finanztransaktionen, Kundenrückerstattungen, Richtlinienausnahmen.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Eskalationsmuster (Entscheidungen mit hohem Risiko, Randfälle)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Feedback-Schleifen (Menschen korrigieren Agentenfehler)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Häufige Agenten-Fehler und wie man sie verhindert

Endlosschleifen (Agent hängt fest und wiederholt dieselbe Aktion)

Ursache: Schlechte Zieldefinition, Tool macht keinen Fortschritt

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

Prävention: Schritt-Limit, Fortschrittsverfolgung, Tool-Vielfalt

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Wiederherstellung: Timeout, Eskalation an Menschen

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Halluzinationen (Agent erfindet Fakten oder Tool-Ausgaben)

Ursache: Konfabulationsneigung des LLM, schlechte Tool-Beschreibungen

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

Prävention: Retrieval-Augmented Generation (RAG), Tool-Validierung, Faktencheck

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Nutze RAG, um den Agenten in Fakten zu verankern:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Wiederherstellung: Fallback an Menschen, Wiederholung mit anderem Reasoning

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Tool-Missbrauch (Agent ruft falsches Tool oder mit falschen Parametern auf)

Ursache: Mehrdeutige Tool-Beschreibungen, schlechtes Reasoning

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prävention: Klare Tool-Dokumentation, Tool-Nutzungstraining, Validierung vor Ausführung

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Wiederherstellung: Fehlerbehandlung, korrektes Tool vorschlagen, erneut versuchen

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Kostenüberschreitungen (Agent nutzt zu viele API-Aufrufe)

Ursache: Ineffizientes Reasoning, redundante Tool-Aufrufe

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

Prävention: Budget-Limits, Aufruf-Deduplizierung, Caching

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Caching implementieren:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Wiederherstellung: Kostenüberwachung, Throttling, günstigerer Modell-Fallback

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Latenzprobleme (Agent zu langsam für Echtzeit-Nutzung)

Ursache: Mehrere Reasoning-Schritte, langsame Tool-Antworten

Ein Agent mit 5 sequenziellen API-Aufrufen à 1 Sekunde = 5+ Sekunden Latenz.

Prävention: Parallele Tool-Ausführung, Caching, schnellere Modelle

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Schnellere Modelle nutzen:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Wiederherstellung: Timeout, Teilergebnisse zurückgeben, asynchron einreihen

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Agenten-Performance und ROI messen

Wichtige zu verfolgende Metriken

Genauigkeit (% korrekte Entscheidungen/Aktionen)

Vergleiche Agenten-Output mit Ground Truth (menschliche Prüfung, tatsächliche Ergebnisse).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latenz (Zeit zur Erledigung der Aufgabe)

Miss die End-to-End-Zeit von Eingabe bis Ausgabe.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Kosten pro Aufgabe (API-Aufrufe, Compute, menschliche Prüfung)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Nutzerzufriedenheit (bei Human-in-the-Loop)

Befrage Nutzer: „Wie zufrieden bist du mit den Entscheidungen des Agenten?“

Automatisierungsrate (% Aufgaben ohne menschlichen Eingriff)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

ROI-Berechnung

Baseline: Kosten des manuellen Prozesses (Mannstunden × Stundensatz)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agenten-Kosten: Infrastruktur + API-Aufrufe + menschliche Aufsicht

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Amortisationszeit: Wann Agenten-Kosten < manuelle Kosten

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Beispiel: ROI eines Lead-Qualifizierungsagenten

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Kontinuierliche Verbesserung

Metriken im Zeitverlauf überwachen

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

A/B-Test verschiedener Agenten-Konfigurationen

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Feedback zur Verbesserung der Genauigkeit einbeziehen

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Erfolgreiche Agenten skalieren, leistungsschwache einstellen

Überwache den ROI. Wenn ein Agent keinen Mehrwert liefert, stelle ihn ein. Skaliere erfolgreiche Agenten in andere Teams.

Häufig gestellte Fragen

Der FAQ-Abschnitt wird automatisch aus dem Frontmatter generiert und unten angezeigt.

{{ cta-dark-panel heading=“Build Agents Without the Complexity” description=“FlowHunt’s native agent platform handles tool integration, error handling, and monitoring. Start building autonomous workflows in minutes, not weeks.” ctaPrimaryText=“Try FlowHunt Free” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Book a Demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}