Wie KI-Gesichtstausch-Technologie die TikTok-Content-Erstellung revolutioniert

Entdecken Sie, wie KI-gestützte Gesichtstausch-Tools wie Wan 2.2 Animate die TikTok-Videoerstellung transformieren und es Creatorn ermöglichen, virale Inhalte i...

Erfahren Sie, wie Sie mit WAN 2.2 Animate Replace professionelle, KI-animierte Face-Swap-Videos erstellen. Entdecken Sie den vollständigen Workflow, fortgeschrittene Techniken und kreative Anwendungen für Content Creator und Marketer.

Künstliche Intelligenz hat die Art und Weise, wie wir Videoinhalte erstellen und bearbeiten, revolutioniert. Eine der spannendsten Entwicklungen in diesem Bereich ist die Gesichtsersetzungstechnologie. Die Möglichkeit, Gesichter in Videos nahtlos zu tauschen und dabei natürliche Animationen beizubehalten, eröffnet unzählige kreative Möglichkeiten für Content Creator, Marketer und Entertainment-Profis. In diesem umfassenden Leitfaden zeigen wir, wie Sie WAN 2.2 Animate Replace meistern – ein hochmodernes Feature von FlowHunt Photomatic, das professionelle Gesichtsersetzung für jeden zugänglich macht. Egal, ob Sie unterhaltsame Inhalte, personalisierte Marketingvideos oder innovative Social-Media-Materialien erstellen möchten: Das Verständnis dieser Technologie verschafft Ihnen einen deutlichen Wettbewerbsvorteil in der digitalen Content-Landschaft.

Die Gesichtsersetzungstechnologie stellt einen bedeutenden Fortschritt in der Videomanipulation und Content-Erstellung dar. Im Kern nutzt sie fortschrittliche Machine-Learning-Algorithmen, um Gesichtszüge zu erkennen, Bewegungsmuster zu analysieren und ein neues Gesicht in vorhandenes Videomaterial zu integrieren – und dabei alle ursprünglichen Animationen, Mimik und Bewegungen zu erhalten. Der Prozess geht weit über einfaches Überlagern von Bildern hinaus: Es kommen Deep-Learning-Modelle zum Einsatz, die dreidimensionale Gesichtsanatomie, Lichtverhältnisse, Hauttextur und die Bewegung von Gesichtern im Kontext ihrer Umgebung verstehen. Traditionelle Videobearbeitung würde eine manuelle, framegenaue Anpassung erfordern – ein zeitaufwändiger Prozess, der oft unrealistische Ergebnisse liefert. Moderne, KI-gestützte Gesichtsersetzung kann hingegen Tausende von Frames gleichzeitig analysieren und intelligente Entscheidungen darüber treffen, wie das neue Gesicht in den Kontext des Originalvideos eingeblendet wird. In den letzten Jahren hat sich diese Technologie enorm weiterentwickelt – von experimentellen Forschungsprojekten hin zu praxisnahen, benutzerfreundlichen Tools, die Profis und Hobbyisten etwa über FlowHunt Photomatic nutzen können. Die zugrundeliegenden neuronalen Netze wurden mit riesigen Datensätzen von Gesichtern und Videos trainiert, sodass sie die Feinheiten menschlicher Gesichtsanatomie und -bewegung auf eine Weise erfassen, wie es mit herkömmlicher Software unmöglich wäre.

Die Auswirkungen leicht zugänglicher Gesichtsersetzungstechnologie reichen weit über Unterhaltung und virale Videos hinaus. In der heutigen, digital geprägten Welt ist Personalisierung ein entscheidender Faktor für den Marketingerfolg und die Einbindung des Publikums. Marken stellen fest, dass personalisierte Videoinhalte – in denen etwa der Kunde sein eigenes oder ein bekanntes Gesicht in einer Marketingbotschaft sieht – deutlich höhere Engagement-Raten und Conversion-Metriken erzielen als generische Videos. Diese Technologie demokratisiert zudem die Videoproduktion: Kleine Unternehmen und unabhängige Creator können Inhalte produzieren, die früher teure Studios, Profi-Schauspieler und aufwendige Nachbearbeitung erforderten. Die Unterhaltungsbranche erforscht bereits Face Swaps für humorvolle Deepfakes von Prominenten – wobei dies auch wichtige ethische Fragen zu Einwilligung und Authentizität aufwirft. Bildungseinrichtungen nutzen ähnliche Technologien für ansprechendere Lernmaterialien, während Unternehmensschulungen personalisierte Onboarding- und Compliance-Videos ermöglichen. Die schnelle Möglichkeit, Videoinhalte zu variieren – verschiedene Gesichter, Ausdrücke und Szenarien zu testen – beschleunigt den kreativen Prozess und erlaubt Experimente, die sonst zu ressourcenintensiv wären. Außerdem können Creator durch Gesichtsersetzung ortsunabhängig arbeiten, was Produktionskosten und logistische Hürden deutlich senkt. Mit wachsender Verbreitung wird der souveräne Umgang mit dieser Technologie zu einer Schlüsselkompetenz für Creator, Marketer und Videoprofis.

WAN 2.2 Animate Replace ist ein hochmodernes KI-Videogenerierungsmodell, entwickelt von Tongyi Lab, das den neuesten Stand der Technik in Sachen Gesichtsersetzung und Animation repräsentiert. Im Gegensatz zu früheren Face-Swap-Tools überzeugt WAN 2.2 insbesondere durch die Fähigkeit, die Natürlichkeit und Integrität von Animationen während des Gesichtswechsels beizubehalten. Die Bezeichnung “Animate Replace” verdeutlicht, dass dieses Modell speziell für Szenarien optimiert wurde, in denen komplexe Animationen und Bewegungen aus einem Quellvideo übernommen werden sollen – während das Gesicht ersetzt wird. Das Modell benötigt zwei Haupteingaben: ein Referenzbild mit dem gewünschten Gesicht und ein Referenzvideo mit den zu erhaltenden Bewegungen und Animationen. Die KI analysiert beide Eingaben aufwendig, erkennt wichtige Gesichtsmerkmale, versteht die 3D-Struktur des Gesichts im Referenzbild und simuliert, wie sich dieses Gesicht mit den Bewegungen des Referenzvideos verhalten würde. Besonders beeindruckend ist WAN 2.2 durch die Fähigkeit, Beleuchtungsunterschiede, verschiedene Blickwinkel und komplexe Gesichtsausdrücke zu meistern – und dabei fotorealistische Qualität zu liefern. Das Modell wurde darauf trainiert, Lichtreflexionen auf der Haut, Muskelbewegungen unter der Hautoberfläche sowie das nahtlose Einfügen des neuen Gesichts in den Hintergrund und das Umfeld des Originalvideos zu verstehen. Diese Raffinesse sorgt dafür, dass die generierten Videos natürlich und überzeugend wirken – und nicht offensichtlich künstlich oder befremdlich. Die Technologie eignet sich hervorragend für unterhaltsame Inhalte, wie etwa glaubwürdige Face-Swaps von bekannten Popkulturmomenten, ist aber ebenso wertvoll für professionelle Anwendungen, bei denen Authentizität und Qualität entscheidend sind.

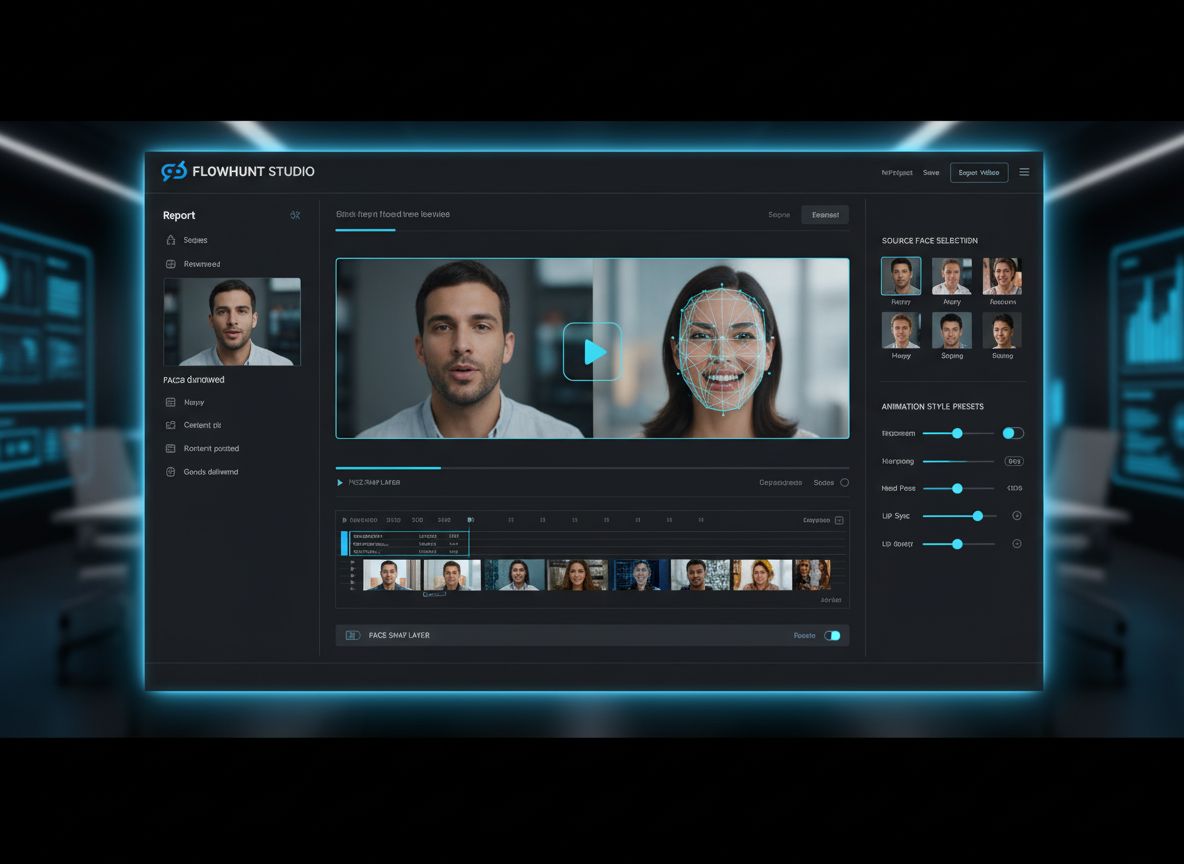

FlowHunt hat WAN 2.2 Animate Replace in die Photomatic KI-Plattform integriert und macht diese leistungsstarke Technologie über eine intuitive, nutzerfreundliche Oberfläche zugänglich. Um zu starten, öffnen Sie das FlowHunt-Dashboard und navigieren Sie zum Bereich Photomatic, der als Zentrale für Foto- und Videogenerierung dient. Dort finden Sie im Bereich “Modelle” eine Übersicht aller verfügbaren KI-Modelle – wählen Sie WAN 2.2 Animate aus. Die Benutzeroberfläche ist auch für technisch weniger versierte Nutzer verständlich gestaltet, mit klaren Beschriftungen und hilfreichen Erklärungen zu jedem Parameter. Das Dashboard bietet zwei Haupteingabebereiche: einen für das Referenzbild und einen für das Referenzvideo. Das Referenzbild sollte das Gesicht enthalten, das Sie im finalen Video verwenden möchten – idealerweise ein Porträt, Headshot oder ein Bild, auf dem das Gesicht gut sichtbar und ausgeleuchtet ist. Das Referenzvideo ist das Ausgangsmaterial, dessen Animationen und Bewegungen übernommen werden. Das kann z.B. ein 8-sekündiger Clip sein, in dem jemand tanzt, eine bestimmte Aktion ausführt oder eine Botschaft übermittelt. Der große Vorteil dieses Workflows ist die Flexibilität – Sie können mit verschiedenen Kombinationen aus Bildern und Videos experimentieren, um völlig neue Inhalte zu schaffen. Die FlowHunt-Oberfläche bietet zudem Optionen zur Anpassung verschiedener Parameter für den Face Swap, sodass Sie das Ergebnis exakt auf Ihre Bedürfnisse abstimmen können. Die komplexen Berechnungen laufen dabei im Hintergrund ab – Sie müssen sich also nicht um technische Details wie GPU-Zuweisung oder Modelloptimierung kümmern.

Ein Face-Swap-Video mit WAN 2.2 Animate Replace über FlowHunt Photomatic zu erstellen, ist ein unkomplizierter Prozess, der in wenigen Minuten abgeschlossen ist. Schritt 1: Bereiten Sie Ihr Referenzbild vor – dieses sollte ein klares, gut ausgeleuchtetes Foto des gewünschten Gesichts sein. Die Bildqualität ist entscheidend; hochauflösende Bilder mit guter Beleuchtung und klar erkennbaren Gesichtszügen liefern die besten Ergebnisse. Idealerweise blickt das Gesicht direkt in die Kamera oder leicht seitlich – so erhält die KI die beste Sicht auf die Gesichtsstruktur. Sobald Sie Ihr Referenzbild haben, wählen oder erstellen Sie Ihr Referenzvideo. Dieses sollte die Bewegungen und Animationen enthalten, die im Endergebnis erhalten bleiben sollen. Das Video kann von wenigen Sekunden bis zu mehreren Minuten lang sein; für den Einstieg empfehlen sich kürzere Videos (8-30 Sekunden). Die Videoqualität sollte mindestens 720p betragen, höhere Auflösungen liefern bessere Resultate. Nachdem Sie Ihre Materialien gesammelt haben, loggen Sie sich ins FlowHunt-Dashboard ein und gehen zu Photomatic. Klicken Sie auf den Bereich Modelle und wählen Sie WAN 2.2 Animate. Sie sehen die Oberfläche mit zwei Upload-Bereichen: einen für das Referenzbild, einen für das Referenzvideo. Laden Sie zuerst Ihr Bild hoch, dann das Video. Das System verarbeitet beide Dateien und zeigt Vorschaubilder zur Bestätigung an. Optional können Sie einen Text-Prompt ergänzen – so geben Sie der KI zusätzliche Hinweise, wie der Face Swap durchgeführt werden soll (z.B. “professionelle Beleuchtung” oder “natürliche Mimik beibehalten”). Nach der Konfiguration klicken Sie auf “Generieren”. Die KI beginnt mit der Verarbeitung, was je nach Videolänge und Auslastung einige Minuten dauert. Ein Fortschrittsbalken zeigt den Status an. Nach Abschluss können Sie das generierte Video direkt in der Oberfläche ansehen und herunterladen.

Erleben Sie, wie FlowHunt Ihre KI-Content- und Videogenerierungs-Workflows automatisiert – von Gesichtsersetzung und Animation bis zu Veröffentlichung und Analyse, alles an einem Ort.

Obwohl der Grund-Workflow zur Erstellung von Face-Swap-Videos einfach ist, gibt es zahlreiche fortgeschrittene Techniken, um die Qualität und Professionalität Ihrer Ergebnisse deutlich zu steigern. Besonders wichtig ist die Bildvorbereitung: Vor dem Hochladen sollten Sie Ihr Referenzbild passend zuschneiden und skalieren. Das Gesicht sollte mindestens 30-40 % der Bildfläche einnehmen, damit die KI genügend Details erkennt. Auch die Beleuchtung ist entscheidend; Aufnahmen bei Tageslicht oder im Studio liefern bessere Ergebnisse als solche mit hartem oder ungleichmäßigem Licht. Bei Bildern mit suboptimaler Beleuchtung empfiehlt sich ggf. eine Bearbeitung von Helligkeit und Kontrast vor dem Upload. Beim Referenzvideo achten Sie auf die Qualität der Animationen – fließende, natürliche Bewegungen sind vorteilhaft, ruckelige oder unstabile Aufnahmen eher weniger. Wenn Sie Smartphone-Videos nutzen, empfiehlt sich die Videostabilisierung. Auch die Bildrate (mind. 24fps) wirkt sich auf die Natürlichkeit des Ergebnisses aus. Zusätzlich können Sie mit verschiedenen Prompts experimentieren, um die KI gezielter zu steuern. Statt das Prompt-Feld leer zu lassen, geben Sie z.B. “cinematisches Licht”, “professionelle Qualität”, “natürliche Hauttöne” oder “Mimik-Intensität beibehalten” an. Diese Hinweise helfen der KI, Ihre kreative Absicht besser umzusetzen. Wenn Sie mehrere Varianten erstellen möchten, lohnt es sich, eine Serie von Referenzbildern mit leichten Variationen (Winkel, Ausdruck, Licht) anzulegen. So generieren Sie schnell mehrere Ergebnisse und wählen das beste aus. Für professionelle Anwendungen empfiehlt sich zudem die Nachbearbeitung im klassischen Videoschnittprogramm. Auch wenn WAN 2.2 Animate Replace hochwertige Videos erzeugt, können Farbkorrektur, Ton und zusätzliche Effekte das Endprodukt auf Broadcast-Niveau heben.

Die Vielseitigkeit der Gesichtsersetzung eröffnet zahlreiche kreative Möglichkeiten in verschiedensten Branchen. Im Entertainment- und Social-Media-Bereich werden Face Swaps für virale Inhalte genutzt – das berühmte Beispiel ist der “Rick Roll”-Remix, bei dem das Gesicht einer Person in das ikonische Rick-Astley-Video eingefügt wird. Solche Inhalte sind extrem teilbar und sorgen auf TikTok, Instagram und YouTube für hohe Reichweiten. Im Marketing nutzen Profis Face Swaps, um personalisierte Videobotschaften in großem Maßstab zu erstellen. So kann z.B. ein Unternehmen Geburtstagsvideos an Tausende Kunden versenden – statt jedes Video einzeln aufzunehmen, wird ein Video aufgenommen und für jeden Kunden das Gesicht per Face Swap eingefügt. Dies sorgt für ein einzigartiges, sehr persönliches Erlebnis und deutlich bessere Engagement-Raten. Bildungseinrichtungen nutzen Face Swaps, um Lernmaterialien ansprechender zu gestalten – etwa indem historische Figuren scheinbar selbst unterrichten. Unternehmensschulungen nutzen die Technologie für personalisierte Onboarding-Videos, in denen neue Mitarbeitende sich selbst in Trainingsszenarien sehen. In der Unterhaltungsbranche werden Face Swaps für humorvolle Deepfakes von Prominenten genutzt – auch hier sind ethische Fragen zu beachten. Immobilienmakler experimentieren mit personalisierten Hausführungen, bei denen sich Interessenten oder ihre Familien selbst im Haus erleben können. Mode- und Kosmetikmarken erstellen virtuelle “Anprobier”-Erlebnisse, bei denen Kunden Produkte am eigenen Gesicht sehen. Auch im Gaming- und VR-Bereich sorgen Face Swaps für immersivere Erlebnisse, wenn Spieler ihr eigenes Gesicht auf Avataren sehen. Diese vielfältigen Anwendungen zeigen: Gesichtsersetzung ist mehr als ein Gag – sie ist ein leistungsstarkes Tool mit echten Business- und Kreativpotenzialen in vielen Branchen.

Um Gesichtsersetzung effektiv zu nutzen, hilft ein Grundverständnis der zugrundeliegenden Technik. WAN 2.2 Animate Replace kombiniert mehrere fortgeschrittene KI-Methoden in einer komplexen Pipeline. Zuerst erfolgt die Gesichtserkennung und Landmark-Erkennung: Die KI analysiert Bild und Video und erkennt zentrale Merkmale wie Augen, Nase, Mund und Kinnlinie. Daraus entsteht eine detaillierte Karte der Gesichtsstruktur. Danach folgt die 3D-Rekonstruktion: Die KI erstellt auf Basis der Landmarken ein dreidimensionales Modell des Gesichts aus dem Referenzbild. Dieses Modell ist entscheidend, da es die Simulation aus verschiedenen Blickwinkeln und unter unterschiedlichen Lichtbedingungen ermöglicht. Im dritten Schritt analysiert die KI das Referenzvideo Frame für Frame, erkennt Bewegungen, Mimikveränderungen und Kopfbewegungen. Diese Bewegungsdaten werden auf das 3D-Gesichtsmodell aus dem Bild übertragen. Im vierten Schritt erfolgt das Rendern und Blending: Das neue Gesicht wird mit den analysierten Bewegungen gerendert und nahtlos ins Originalvideo eingeblendet. Dieser Prozess ist besonders anspruchsvoll, da Licht, Schatten und Interaktion mit der Umgebung realistisch berücksichtigt werden müssen. Abschließend sorgt die Nachbearbeitung für ein natürliches, fotorealistisches Endergebnis. Während des gesamten Prozesses trifft die KI Tausende Mikroentscheidungen zu Sonderfällen, Lichtunterschieden und komplexer Mimik. Daher sind hohe Rechenleistung und einige Minuten Verarbeitungszeit notwendig. Dieses Verständnis erklärt, warum qualitativ hochwertige Eingaben zu besseren Resultaten führen: Je klarer Bild und Video, desto mehr Informationen hat die KI in jeder Pipeline-Stufe zur Verfügung.

Um mit WAN 2.2 Animate Replace dauerhaft hochwertige Ergebnisse zu erzielen, sollten Sie einige bewährte Praktiken befolgen, die aus zahlreichen Tests und Nutzerfeedback entstanden sind. Investieren Sie Zeit in die Vorbereitung Ihrer Referenzmaterialien. Ein hochwertiges Referenzbild lohnt den Aufwand – machen Sie ggf. ein neues Foto mit professioneller Beleuchtung oder bei Tageslicht. Nutzen Sie ein vorhandenes Bild, achten Sie auf Schärfe, gute Ausleuchtung und klare Sichtbarkeit des Gesichts ohne starke Schatten oder Überbelichtung. Ideal ist ein neutrales oder leicht lächelndes Gesicht, da dies eine gute Basis für natürliche Animationen bietet. Beim Referenzvideo sollten Sie Aufnahmen mit klar sichtbarem Gesicht und natürlichen Bewegungen wählen – vermeiden Sie extreme Nahaufnahmen oder ungewöhnliche Winkel, da dies die Gesichtserkennung erschwert. Wenn Sie gezielt ein Video für Face Swaps aufnehmen, machen Sie mehrere Takes zur Auswahl. Achten Sie auf gleichmäßige Lichtverhältnisse im ganzen Video – starke Lichtwechsel verschlechtern die Ergebnisse. Für erste Experimente empfehlen sich kurze Videos (8-30 Sekunden); mit wachsender Erfahrung können Sie längere Inhalte testen. Nutzen Sie immer die Vorschaufunktion vor dem Download, um eventuelle Probleme oder Artefakte frühzeitig zu erkennen. Falls nötig, passen Sie Einstellungen an und generieren Sie das Video erneut. Notieren Sie sich, welche Einstellungen besonders gute Ergebnisse liefern – das hilft Ihnen bei zukünftigen Projekten, gezielt zu optimieren. Haben Sie Geduld mit der Technologie: WAN 2.2 Animate Replace ist sehr leistungsfähig, aber nicht perfekt. Manche Kombinationen aus Bild und Video funktionieren besser als andere – Experimentieren und Iteration sind der Schlüssel zum Erfolg.

Wie bei jeder mächtigen Technologie wirft auch die Gesichtsersetzung wichtige ethische Fragen auf. Am bedeutendsten ist die Einwilligung – das Gesicht einer Person ohne deren Zustimmung in ein Video einzufügen, das sie nie aufgenommen hat, ist sowohl ethisch als auch rechtlich problematisch. Die Technologie selbst ist neutral, kann aber missbraucht werden, um nicht-einvernehmliche Deepfakes oder irreführende Inhalte zu erzeugen. Nutzen Sie Face Swaps daher immer verantwortungsvoll und holen Sie vor Veröffentlichung oder kommerzieller Nutzung stets die ausdrückliche Erlaubnis der betreffenden Person ein. Ein weiterer Aspekt ist die Authentizität und Transparenz: Wenn Sie Face Swaps für Marketing oder professionelle Zwecke einsetzen, sollten Sie offenlegen, dass das Video bearbeitet wurde. Das Publikum über die Echtheit von Inhalten zu täuschen, kann Vertrauen und Glaubwürdigkeit schädigen. Viele Länder erlassen inzwischen Regelungen zu Deepfakes und synthetischen Medien – informieren Sie sich über die rechtliche Lage in Ihrer Region. Berücksichtigen Sie zudem die potenziellen Auswirkungen Ihrer Inhalte: Auch mit Erlaubnis sollten Sie keine Videos erstellen, die für die abgebildeten Personen peinlich, schädlich oder diffamierend sein könnten. Im Unterhaltungsbereich sind humorvolle Face Swaps mit Einwilligung unproblematisch; politische Deepfakes oder Identitätsbetrug sind hingegen klar unethisch und meist illegal. Mit zunehmender Verbreitung und Leistungsfähigkeit der Technologie wächst die Verantwortung jedes Nutzers, sie ethisch und verantwortungsvoll einzusetzen. FlowHunt und andere Plattformen entwickeln zunehmend Schutzmechanismen und Richtlinien, aber letztlich liegt die Verantwortung beim Anwender.

Für Content Creator und Marketingprofis, die Face Swaps regelmäßig nutzen möchten, sind Integration und Automatisierung zentrale Themen. FlowHunt Photomatic ist darauf ausgelegt, sich nahtlos in größere Content-Workflows einzufügen – so kann Gesichtsersetzung als Teil einer umfassenden Produktionspipeline automatisiert werden. Wenn Sie regelmäßig mehrere Face-Swap-Videos erstellen, empfiehlt es sich, Vorlagen und standardisierte Prozesse einzurichten. Beispielsweise können Sie ein Standardvideo mehrfach mit unterschiedlichen Gesichtern kombinieren oder eine Bild-Bibliothek für verschiedene Videos nutzen. Diese Standardisierung beschleunigt die Produktion und sorgt für einheitliche Qualität. Eine weitere Möglichkeit ist die Kombination mit anderen KI-Tools aus FlowHunt: Erstellen Sie z.B. KI-generierte Bilder als Referenz, animieren Sie diese per Face Swap oder kombinieren Sie KI-generierte Videos mit Gesichtsersetzung für personalisierte Inhalte. Im Marketing können Sie Face Swaps in E-Mail-Kampagnen oder personalisierte Videonachrichten integrieren – viele Newsletter-Tools unterstützen mittlerweile dynamischen Videocontent. Diese Personalisierung sorgt für deutlich bessere Engagement- und Conversion-Raten. Arbeiten Sie im Team, empfiehlt sich die Dokumentation bewährter Workflows, Referenzmaterialien und Qualitätsstandards. So stellen Sie konsistente Ergebnisse sicher und ermöglichen effizientes Arbeiten. Organisieren Sie zudem Ihre generierten Videos übersichtlich, um schnellen Zugriff und Wiederverwendung zu gewährleisten. Überwachen Sie die Performance Ihrer Face-Swap-Inhalte: Analysieren Sie Engagement, Conversion und Feedback, um herauszufinden, welche Arten von Face-Swap-Content bei Ihrer Zielgruppe am besten ankommen. Diese Daten helfen, die Content-Strategie gezielt weiterzuentwickeln.

Obwohl WAN 2.2 Animate Replace sehr stabil ist, können gelegentlich Probleme oder suboptimale Ergebnisse auftreten. Die häufigste Ursache ist eine schlechte Gesichtserkennung – meist durch unscharfe, schlecht ausgeleuchtete oder aus ungünstigem Winkel fotografierte Referenzbilder. In diesem Fall hilft meist ein anderes Bild mit klareren Gesichtszügen und besserem Licht. Auch unnatürlich wirkende Animationen oder Mimik sind möglich – häufig, wenn das Referenzvideo extreme Gesichtsausdrücke oder Bewegungen enthält, die sich schlecht übertragen lassen. Versuchen Sie in diesem Fall ein Video mit natürlicheren Bewegungen. Sichtbare Artefakte oder schlechte Übergänge deuten oft auf starke Unterschiede in Licht oder Winkel zwischen Bild und Video hin. Passen Sie ggf. die Beleuchtung im Bild an das Video an. Farb- oder Tonabweichungen lassen sich meist in der Nachbearbeitung im Videoschnittprogramm korrigieren. Sollte die Generierung ungewöhnlich lange dauern oder fehlschlagen, kann dies an temporären Systemproblemen liegen – versuchen Sie es nach einigen Minuten erneut und prüfen Sie Ihre Internetverbindung sowie die Dateiuploads. Beginnen Sie als Einsteiger mit einfachen Kombinationen, bevor Sie komplexe Tests wagen, um die Technik besser zu verstehen. Bei anhaltenden Problemen hilft der FlowHunt-Support gern weiter.

Die Gesichtsersetzung entwickelt sich rasant weiter, und die Zukunft verspricht noch ausgefeiltere und zugänglichere Tools. Aktuelle Forschung konzentriert sich darauf, die Realitätsnähe und Natürlichkeit insbesondere bei schwierigen Fällen wie extremen Winkeln, komplexer Beleuchtung oder schnellen Bewegungen zu verbessern. Zukünftige Modelle werden diese “Edge Cases” noch souveräner meistern. Ein wichtiges Thema ist die Echtzeit-Gesichtsersetzung, die Face Swaps bereits während Live-Streams ermöglicht – das eröffnet neue Möglichkeiten für Live-Entertainment, virtuelle Events und interaktive Erlebnisse. Auch die Effizienz der Modelle wird weiter steigen, sodass Generationen schneller laufen und auch auf weniger leistungsstarken Geräten möglich sind. Zudem wird die Steuerbarkeit weiter zunehmen: Künftige Tools könnten erlauben, genau festzulegen, wie Mimik verändert, Licht angepasst oder Gesichtszüge betont werden sollen. Besonders spannend ist die Kombination mit anderen KI-Technologien: Zusammen mit KI-Sprachsynthese könnten vollsynthetische Videos entstehen, in denen sowohl Gesicht als auch Stimme KI-generiert sind – mit enormen Chancen und ebenso großen ethischen Herausforderungen. Mit zunehmender Reife werden wir mehr Schutzmechanismen und Authentifizierungsverfahren sehen, die Missbrauch verhindern – etwa Blockchain-basierte Systeme zur Echtheitsprüfung von Videos. Schließlich werden sich mit wachsender Verbreitung Standards und Best Practices für den ethischen Umgang etablieren – erste Branchenverbände entwickeln bereits Richtlinien für den verantwortungsvollen Einsatz synthetischer Medien.

WAN 2.2 Animate Replace ist ein bedeutender Fortschritt für KI-gestützte Videogenerierung und macht professionelle Gesichtsersetzung für Creator, Marketer und Profis aus unterschiedlichsten Branchen zugänglich. Über FlowHunt Photomatic steht diese leistungsstarke Technologie in einer intuitiven Oberfläche bereit, die keine technischen Vorkenntnisse erfordert. Egal, ob Sie unterhaltsame Social-Media-Inhalte, personalisierte Marketingvideos, Lehrmaterialien oder professionelle Anwendungen erstellen: Gesichtsersetzung eröffnet ungeahnte kreative Möglichkeiten. Der Schlüssel zum Erfolg liegt im Verständnis der Technologie, in der sorgfältigen Vorbereitung hochwertiger Referenzmaterialien, in der konsequenten Anwendung von Best Practices und im bewussten, verantwortungsvollen Umgang mit der Technologie. Wer sich früh mit diesen Möglichkeiten vertraut macht, verschafft sich einen klaren Vorsprung in Content-Erstellung und Marketing. Probieren Sie WAN 2.2 Animate Replace noch heute mit FlowHunt Photomatic aus – und entdecken Sie, welches kreative Potenzial Gesichtsersetzung für Ihre Projekte entfalten kann.

WAN 2.2 Animate Replace ist ein fortschrittliches KI-Videogenerierungsmodell, das es ermöglicht, ein Gesicht in einem Referenzvideo durch ein Gesicht aus einem Referenzbild zu ersetzen – und dabei die ursprünglichen Animationen und Bewegungen beizubehalten. Es eignet sich hervorragend, um Face-Swap-Videos mit professionellen Ergebnissen zu erstellen.

Der Prozess beinhaltet das Hochladen eines Referenzbilds (mit dem gewünschten Gesicht) und eines Referenzvideos (mit den gewünschten Bewegungen und Animationen). Die KI analysiert beide Eingaben und ersetzt das Gesicht im Video nahtlos durch das Bild-Gesicht, während alle ursprünglichen Animationen erhalten bleiben.

Gesichtsersetzung kann für Unterhaltungsinhalte, personalisierte Videonachrichten, kreative Social-Media-Inhalte, Marketingkampagnen, Lehrdemonstrationen und spaßige virale Videos genutzt werden. Besonders effektiv ist sie, um ansprechende, teilbare Inhalte zu erstellen, die Aufmerksamkeit erregen.

Ja, auf jeden Fall. Die Gesichtsersetzungstechnologie wird zunehmend im professionellen Marketing eingesetzt, um personalisierte Videoinhalte, Testimonials und Werbematerialien zu erstellen. WAN 2.2 Animate Replace in FlowHunt Photomatic bietet die notwendige Qualität und Kontrolle für professionelle Anwendungen.

Die Generierungszeit hängt von Länge und Komplexität des Videos ab, aber die meisten Videos werden innerhalb weniger Minuten verarbeitet. Ein 8-Sekunden-Video wird in der Regel schnell generiert, was schnelle Iteration und Experimente mit verschiedenen Gesichtern und Animationen ermöglicht.

Arshia ist eine AI Workflow Engineerin bei FlowHunt. Mit einem Hintergrund in Informatik und einer Leidenschaft für KI spezialisiert sie sich darauf, effiziente Arbeitsabläufe zu entwickeln, die KI-Tools in alltägliche Aufgaben integrieren und so Produktivität und Kreativität steigern.

Erleben Sie die Leistungsfähigkeit von WAN 2.2 Animate Replace über FlowHunt Photomatic. Erstellen Sie in wenigen Minuten beeindruckende Face-Swap-Videos.

Entdecken Sie, wie KI-gestützte Gesichtstausch-Tools wie Wan 2.2 Animate die TikTok-Videoerstellung transformieren und es Creatorn ermöglichen, virale Inhalte i...

FlowHunt unterstützt jetzt die Video-Generierungsmodelle Wan 2.2 und 2.5 für Text-zu-Video, Bild-zu-Video, Persona-Austausch und Animation. Transformieren Sie I...

Entdecken Sie die bahnbrechenden Möglichkeiten von Sora 2 in der KI-Videogenerierung – von realistischer Charakterwiedergabe bis hin zu Physiksimulation – und e...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.