LLM Meta AI

FlowHunt unterstützt Dutzende von Textgenerierungsmodellen, darunter Metas Llama-Modelle. Erfahren Sie, wie Sie Llama in Ihre KI-Tools und Chatbots integrieren,...

LLM Mistral auf FlowHunt ermöglicht die flexible Integration fortschrittlicher Mistral-KI-Modelle für nahtlose Textgenerierung in Chatbots und KI-Tools.

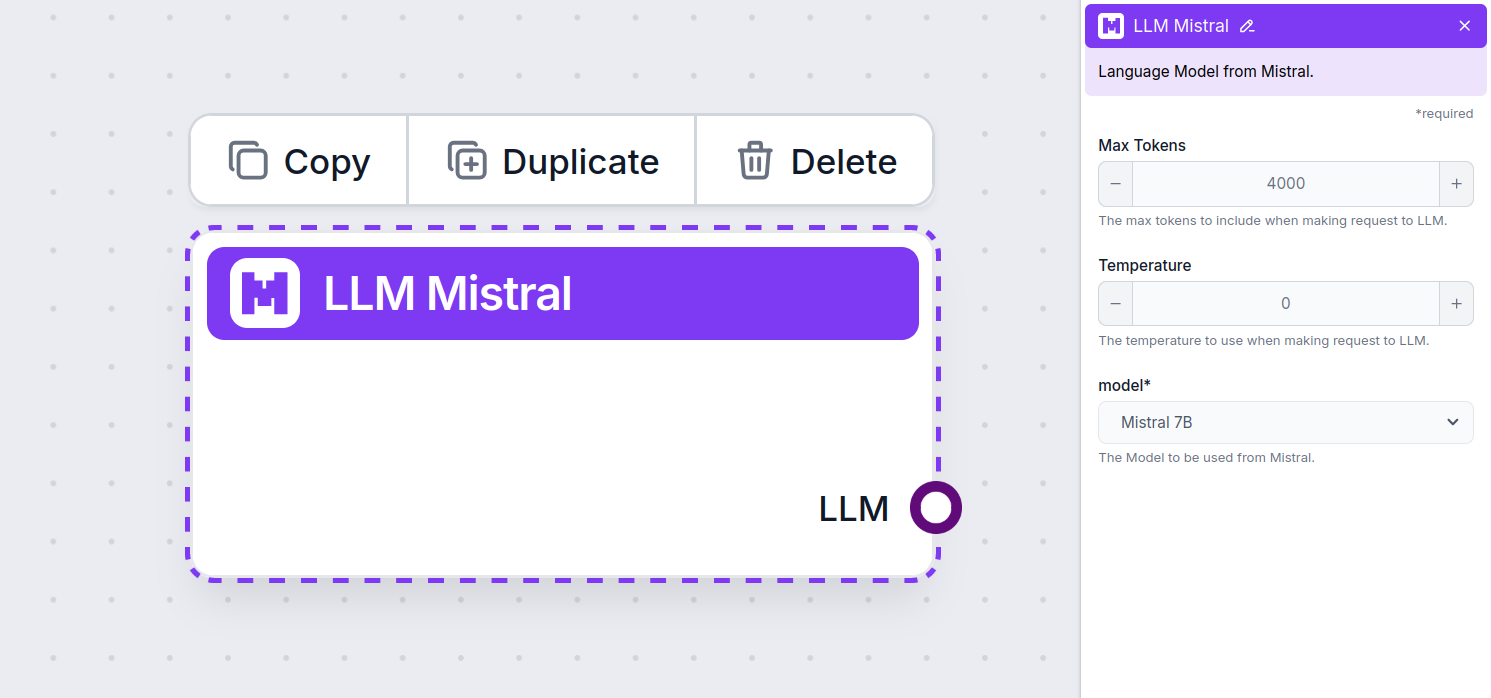

Komponentenbeschreibung

The LLM Mistral component connects the Mistral models to your flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to control the model used. All components come with ChatGPT-4 by default. You can connect this component if you wish to change the model or gain more control over it.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, which is the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported models from Mistral. We currently support the following models:

How To Add The LLM Mistral To Your Flow

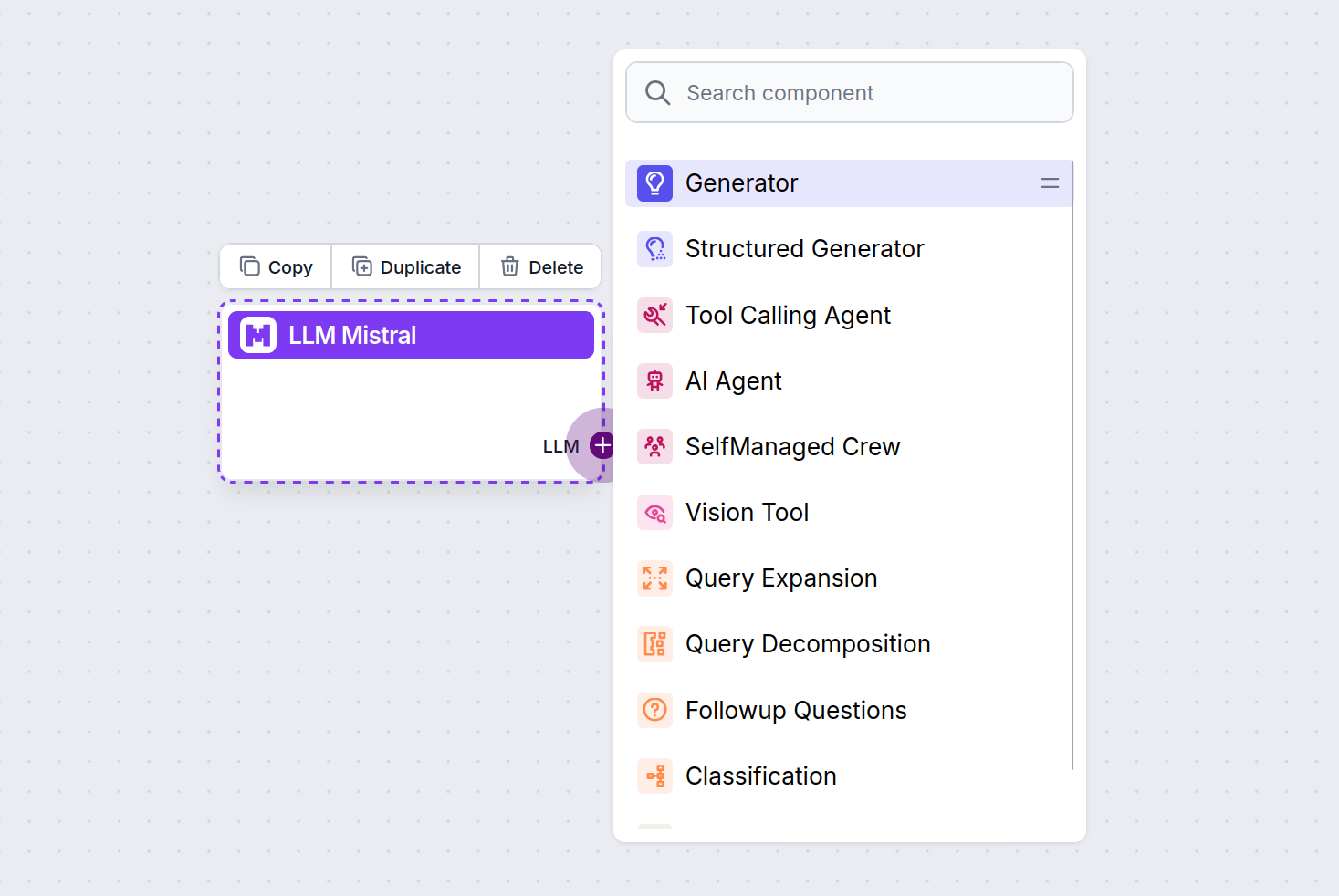

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

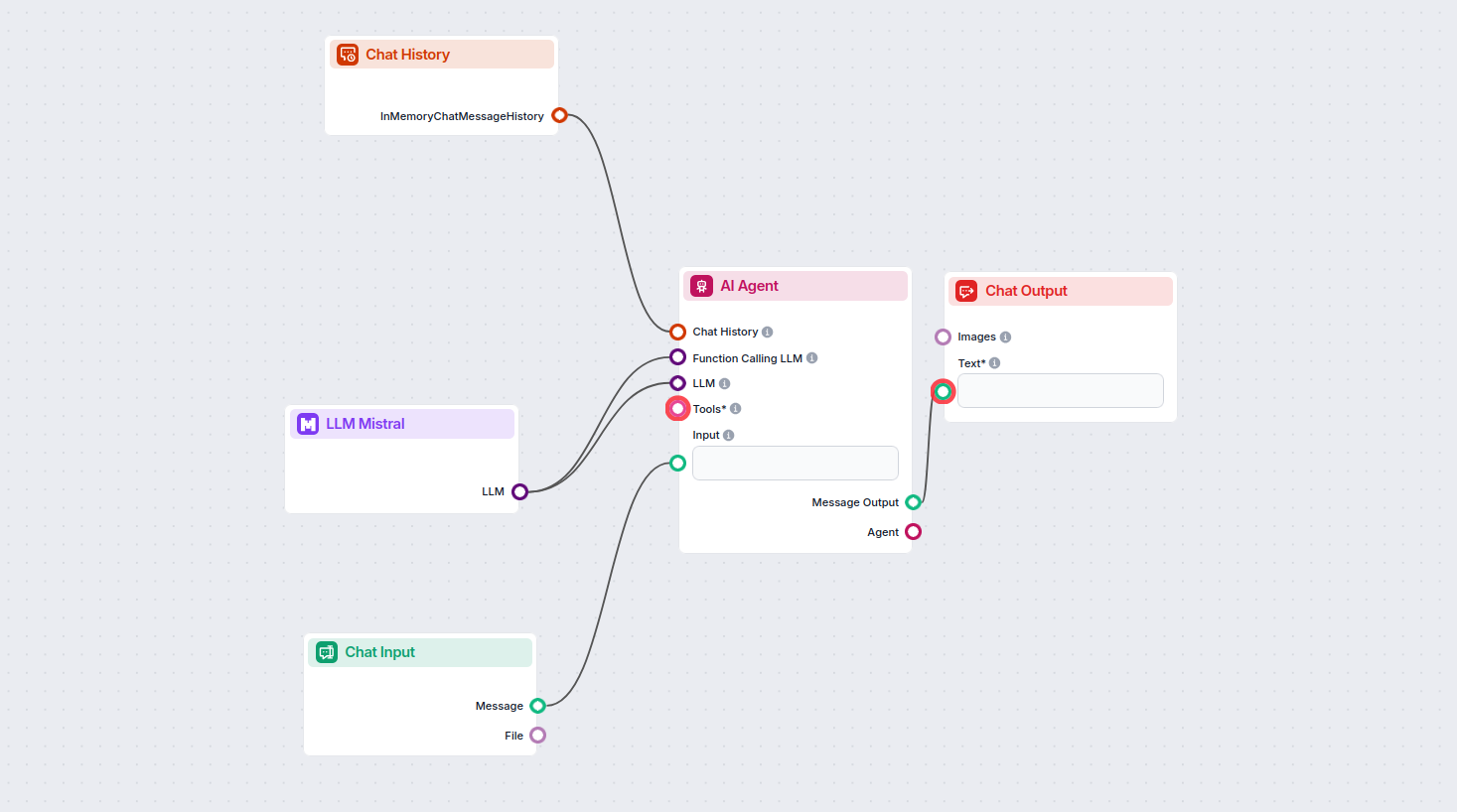

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow that’s using the Mistral 7B model to generate responses. You can think of it as a basic Mistral chatbot.

This simple Chatbot Flow includes:

Die LLM Mistral-Komponente ermöglicht es Ihnen, Mistral-KI-Modelle mit Ihren FlowHunt-Projekten zu verbinden, um fortschrittliche Textgenerierung für Ihre Chatbots und KI-Agenten zu ermöglichen. Sie können Modelle austauschen, Einstellungen steuern und Modelle wie Mistral 7B, Mixtral (8x7B) und Mistral Large integrieren.

FlowHunt unterstützt Mistral 7B, Mixtral (8x7B) und Mistral Large. Jedes Modell bietet unterschiedliche Leistungen und Parameterstufen für verschiedene Anforderungen der Textgenerierung.

Sie können Einstellungen wie maximale Token-Anzahl und Temperatur anpassen sowie zwischen unterstützten Mistral-Modellen wählen, um Antwortlänge, Kreativität und Modellverhalten innerhalb Ihrer Flows zu steuern.

Nein, das Verbinden einer LLM-Komponente ist optional. Standardmäßig verwenden FlowHunt-Komponenten ChatGPT-4o. Nutzen Sie die LLM Mistral-Komponente, wenn Sie mehr Kontrolle wünschen oder ein bestimmtes Mistral-Modell verwenden möchten.

Beginnen Sie damit, intelligentere KI-Chatbots und Tools zu erstellen, indem Sie Mistrals leistungsstarke Sprachmodelle mit der No-Code-Plattform von FlowHunt integrieren.

FlowHunt unterstützt Dutzende von Textgenerierungsmodellen, darunter Metas Llama-Modelle. Erfahren Sie, wie Sie Llama in Ihre KI-Tools und Chatbots integrieren,...

FlowHunt unterstützt Dutzende von Textgenerierungsmodellen, einschließlich der Modelle von xAI. Hier erfahren Sie, wie Sie die xAI-Modelle in Ihren KI-Tools und...

FlowHunt unterstützt Dutzende von KI-Modellen, darunter die revolutionären DeepSeek-Modelle. Hier erfahren Sie, wie Sie DeepSeek in Ihren KI-Tools und Chatbots ...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.