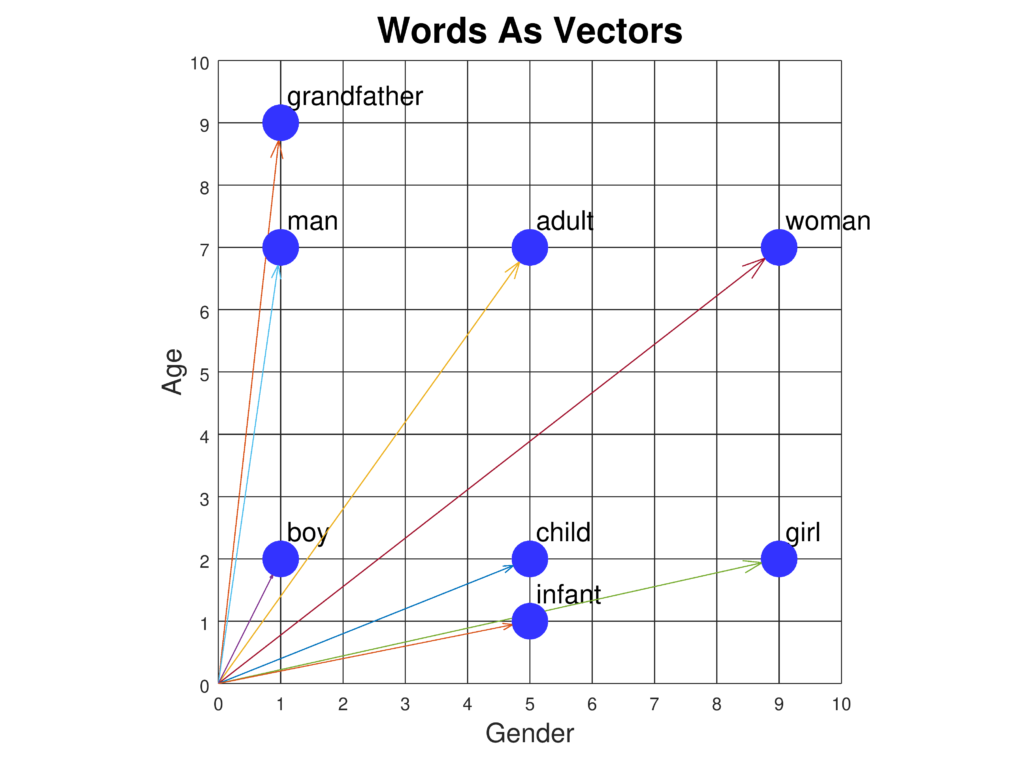

Wort-Embeddings

Wort-Embeddings sind fortschrittliche Darstellungen von Wörtern in einem kontinuierlichen Vektorraum, die semantische und syntaktische Beziehungen für fortgesch...

5 Min. Lesezeit

Word Embeddings

NLP

+3

Wort-Embeddings sind fortschrittliche Darstellungen von Wörtern in einem kontinuierlichen Vektorraum, die semantische und syntaktische Beziehungen für fortgesch...