Aktivierungsfunktionen

Aktivierungsfunktionen sind grundlegend für künstliche neuronale Netzwerke, da sie Nichtlinearität einführen und das Erlernen komplexer Muster ermöglichen. Dies...

Aktivierungsfunktionen sind grundlegend für künstliche neuronale Netzwerke, da sie Nichtlinearität einführen und das Erlernen komplexer Muster ermöglichen. Dies...

AllenNLP ist eine robuste Open-Source-Bibliothek für NLP-Forschung, entwickelt von AI2 auf PyTorch. Sie bietet modulare, erweiterbare Werkzeuge, vortrainierte M...

Die Anomalieerkennung in Bildern identifiziert Muster, die von der Norm abweichen, was für Anwendungen wie industrielle Inspektion und medizinische Bildgebung e...

Backpropagation ist ein Algorithmus zum Trainieren künstlicher neuronaler Netze, indem Gewichte angepasst werden, um den Vorhersagefehler zu minimieren. Erfahre...

Batch-Normalisierung ist eine transformative Technik im Deep Learning, die den Trainingsprozess von neuronalen Netzwerken erheblich verbessert, indem sie intern...

Entdecken Sie BERT (Bidirectional Encoder Representations from Transformers), ein Open-Source-Maschinelles Lern-Framework von Google für die Verarbeitung natürl...

Bidirektionales Long Short-Term Memory (BiLSTM) ist eine fortschrittliche Art von rekurrenter neuronaler Netzwerkarchitektur (RNN), die sequenzielle Daten in Vo...

Erfahren Sie, was Bilderkennung in der KI ist, wofür sie verwendet wird, welche Trends es gibt und wie sie sich von ähnlichen Technologien unterscheidet.

BMXNet ist eine Open-Source-Implementierung von Binären Neuronalen Netzwerken (BNNs) auf Basis von Apache MXNet und ermöglicht eine effiziente KI-Bereitstellung...

Caffe ist ein Open-Source-Deep-Learning-Framework von BVLC, das für Geschwindigkeit und Modularität beim Aufbau von Convolutional Neural Networks (CNNs) optimie...

Chainer ist ein Open-Source-Deep-Learning-Framework, das eine flexible, intuitive und leistungsstarke Plattform für neuronale Netzwerke bietet. Es zeichnet sich...

Computer Vision ist ein Bereich der Künstlichen Intelligenz (KI), der darauf abzielt, Computern das Interpretieren und Verstehen der visuellen Welt zu ermöglich...

Ein Convolutional Neural Network (CNN) ist ein spezieller Typ künstliches neuronales Netzwerk, das für die Verarbeitung von strukturierten Gitterdaten wie Bilde...

DALL-E ist eine Reihe von Text-zu-Bild-Modellen, die von OpenAI entwickelt wurden und mithilfe von Deep Learning digitale Bilder aus textlichen Beschreibungen g...

Ein Deep Belief Network (DBN) ist ein anspruchsvolles generatives Modell, das tiefe Architekturen und Restricted Boltzmann Machines (RBMs) nutzt, um hierarchisc...

Deep Learning ist ein Teilbereich des maschinellen Lernens in der Künstlichen Intelligenz (KI), der die Arbeitsweise des menschlichen Gehirns beim Verarbeiten v...

DL4J, oder DeepLearning4J, ist eine Open-Source, verteilte Deep-Learning-Bibliothek für die Java Virtual Machine (JVM). Als Teil des Eclipse-Ökosystems ermöglic...

Dropout ist eine Regularisierungstechnik in der KI, insbesondere in neuronalen Netzwerken, die Überanpassung bekämpft, indem während des Trainings zufällig Neur...

Ein Einbettungsvektor ist eine dichte numerische Darstellung von Daten in einem mehrdimensionalen Raum und erfasst semantische sowie kontextuelle Beziehungen. E...

Die Feinabstimmung von Modellen passt vortrainierte Modelle für neue Aufgaben durch kleinere Anpassungen an und reduziert so den Bedarf an Daten und Ressourcen....

Die Fréchet-Inception-Distanz (FID) ist eine Metrik zur Bewertung der Qualität von Bildern, die von generativen Modellen, insbesondere GANs, erzeugt werden. FID...

Generative KI bezeichnet eine Kategorie von Algorithmen der künstlichen Intelligenz, die neue Inhalte wie Texte, Bilder, Musik, Code und Videos generieren könne...

Ein Generativer Vortrainierter Transformer (GPT) ist ein KI-Modell, das Deep-Learning-Techniken nutzt, um Texte zu erzeugen, die menschlichem Schreiben sehr ähn...

Der Gradientenabstieg ist ein grundlegender Optimierungsalgorithmus, der in Machine Learning und Deep Learning weit verbreitet ist, um Kosten- oder Verlustfunkt...

Ein Großes Sprachmodell (LLM) ist eine KI, die auf riesigen Textmengen trainiert wurde, um menschliche Sprache zu verstehen, zu generieren und zu verarbeiten. L...

Horovod ist ein robustes, quelloffenes Framework für verteiltes Deep Learning, das eine effiziente Skalierung über mehrere GPUs oder Maschinen hinweg ermöglicht...

Ideogram AI ist eine innovative Bildgenerierungsplattform, die künstliche Intelligenz nutzt, um Textanweisungen in hochwertige Bilder zu verwandeln. Durch den E...

Instanzsegmentierung ist eine Aufgabe des maschinellen Sehens, bei der jedes einzelne Objekt in einem Bild mit pixelgenauer Präzision erkannt und abgegrenzt wir...

Keras ist eine leistungsstarke und benutzerfreundliche Open-Source-API für hochentwickelte neuronale Netzwerke, geschrieben in Python und lauffähig auf TensorFl...

Künstliche Intelligenz (KI) im Gesundheitswesen nutzt fortschrittliche Algorithmen und Technologien wie maschinelles Lernen, NLP und Deep Learning, um komplexe ...

Konvergenz in der KI bezeichnet den Prozess, bei dem Maschinenlern- und Deep-Learning-Modelle durch iteratives Lernen einen stabilen Zustand erreichen, indem si...

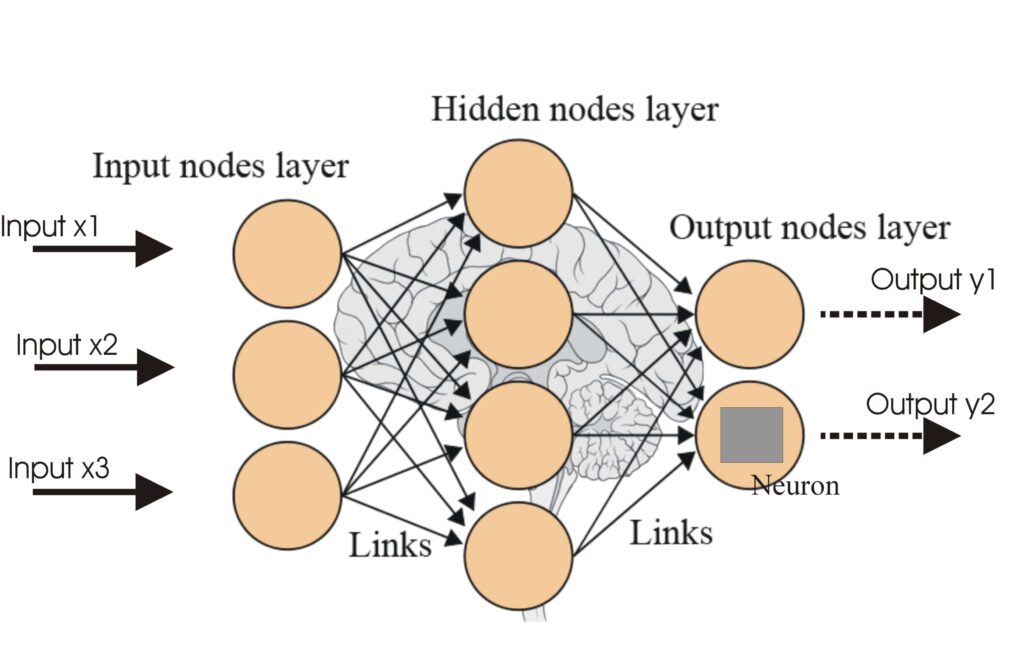

Künstliche Neuronale Netze (ANNs) sind eine Untergruppe von Machine-Learning-Algorithmen, die dem menschlichen Gehirn nachempfunden sind. Diese Rechenmodelle be...

Long Short-Term Memory (LSTM) ist eine spezialisierte Architektur von Rekurrenten Neuronalen Netzwerken (RNN), die darauf ausgelegt ist, langfristige Abhängigke...

Apache MXNet ist ein Open-Source-Deep-Learning-Framework, das für effizientes und flexibles Training sowie die Bereitstellung tiefer neuronaler Netze entwickelt...

Neuromorphes Computing ist ein hochmoderner Ansatz im Bereich des Computer-Engineerings, bei dem sowohl Hard- als auch Softwareelemente nach dem Vorbild des men...

Ein neuronales Netzwerk, oder künstliches neuronales Netzwerk (KNN), ist ein vom menschlichen Gehirn inspiriertes Rechenmodell, das in KI und maschinellem Lerne...

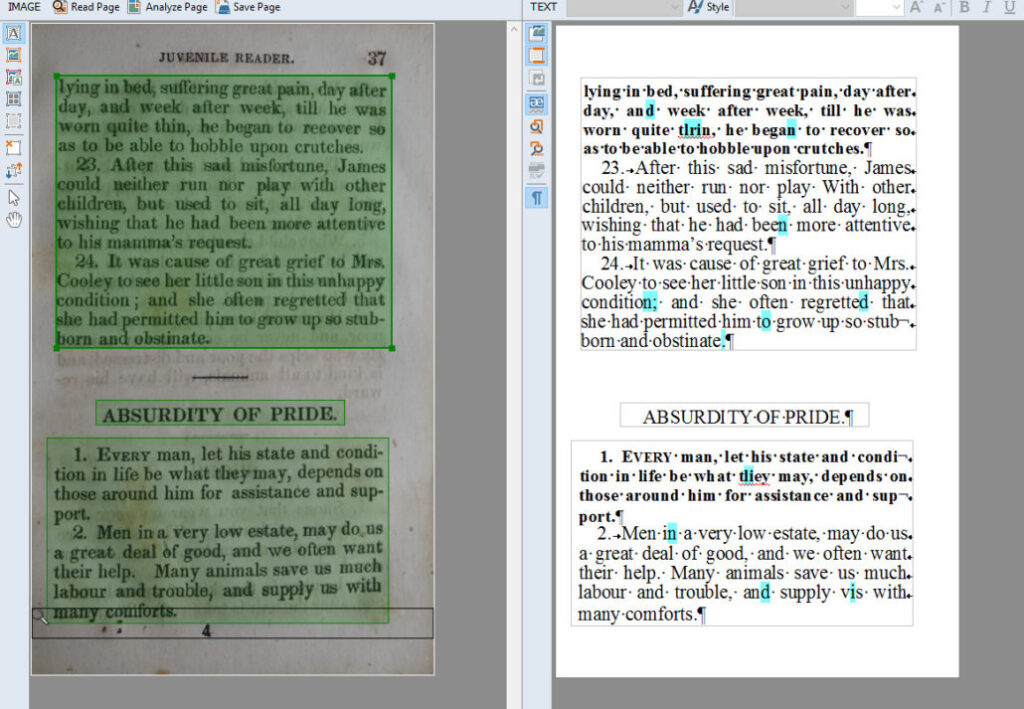

Optische Zeichenerkennung (OCR) ist eine transformative Technologie, die Dokumente wie gescannte Papiere, PDFs oder Bilder in editierbare und durchsuchbare Date...

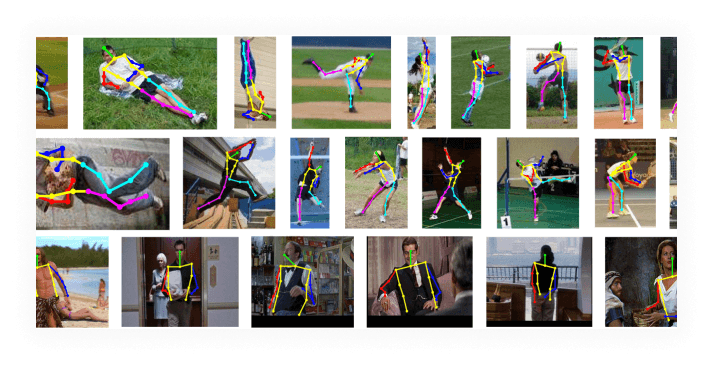

Posenschätzung ist eine Computer-Vision-Technik, die Position und Orientierung einer Person oder eines Objekts in Bildern oder Videos vorhersagt, indem sie Schl...

PyTorch ist ein Open-Source-Framework für maschinelles Lernen, entwickelt von Meta AI, das für seine Flexibilität, dynamische Rechen-Graphen, GPU-Beschleunigung...

Rekurrente neuronale Netzwerke (RNNs) sind eine fortschrittliche Klasse künstlicher neuronaler Netzwerke, die zur Verarbeitung sequentieller Daten entwickelt wu...

Semantische Segmentierung ist eine Computer-Vision-Technik, die Bilder in mehrere Segmente unterteilt, wobei jedem Pixel ein Klassenlabel zugewiesen wird, das e...

Entdecken Sie die Sequenzmodellierung in KI und maschinellem Lernen – sagen Sie Sequenzen in Daten wie Text, Audio und DNA voraus oder generieren Sie sie mithil...

Die Sprachverarbeitung (Natural Language Processing, NLP) ermöglicht es Computern, menschliche Sprache mithilfe von Computerlinguistik, maschinellem Lernen und ...

Stable Diffusion ist ein fortschrittliches Text-zu-Bild-Generierungsmodell, das Deep Learning nutzt, um hochwertige, fotorealistische Bilder aus Textbeschreibun...

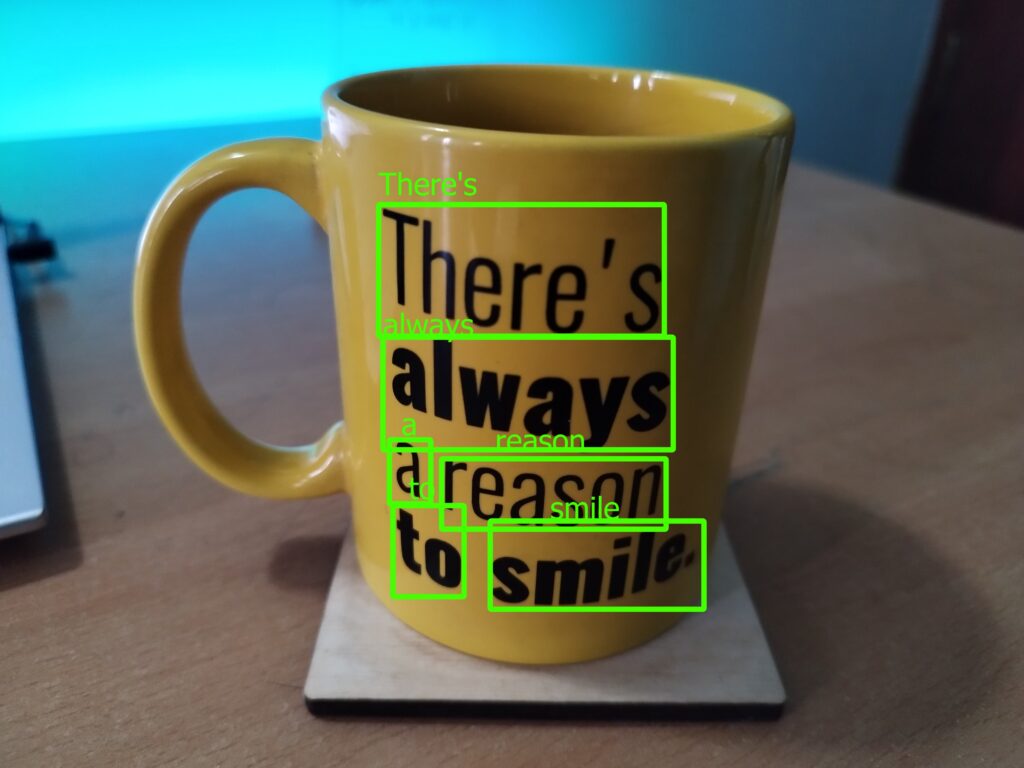

Szenentexterkennung (STR) ist ein spezialisiertes Teilgebiet der optischen Zeichenerkennung (OCR), das sich auf das Erkennen und Interpretieren von Texten in Bi...

TensorFlow ist eine Open-Source-Bibliothek, die vom Google Brain-Team entwickelt wurde und für numerische Berechnungen sowie groß angelegte maschinelle Lernverf...

Torch ist eine Open-Source-Machine-Learning-Bibliothek und ein wissenschaftliches Computing-Framework auf Basis von Lua, optimiert für Deep-Learning- und KI-Auf...

Transfer Learning ist eine fortschrittliche Methode des maschinellen Lernens, die es ermöglicht, Modelle, die für eine Aufgabe trainiert wurden, für eine verwan...

Transferlernen ist eine leistungsstarke KI/ML-Technik, die vortrainierte Modelle an neue Aufgaben anpasst, die Leistung mit begrenzten Daten verbessert und die ...

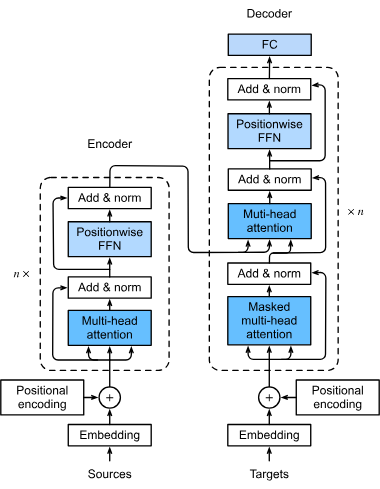

Transformer sind eine revolutionäre neuronale Netzwerkarchitektur, die die künstliche Intelligenz, insbesondere im Bereich der Verarbeitung natürlicher Sprache,...

Verstärkendes Lernen (RL) ist ein Teilgebiet des maschinellen Lernens, das sich auf das Trainieren von Agenten konzentriert, um Entscheidungsfolgen in einer Umg...

Fastai ist eine Deep-Learning-Bibliothek, die auf PyTorch basiert und hochstufige APIs, Transfer Learning und eine geschichtete Architektur bietet, um die Entwi...