Los agentes de IA son fundamentalmente distintos de los chatbots. Un chatbot espera la entrada del usuario y responde. Un agente persigue objetivos de forma autónoma, llamando a herramientas, razonando sobre problemas y tomando acciones sin input humano en cada paso.

Esta distinción es importante porque los agentes pueden automatizar flujos de trabajo completos. Un agente de cualificación de leads puntúa prospectos, enriquece sus datos y los asigna a comerciales, todo sin intervención humana. Un agente de triaje de contenido categoriza tickets de soporte, los deriva a especialistas y escala los casos límite a humanos.

En esta guía aprenderás a diseñar agentes fiables, integrarlos con sistemas empresariales, prevenir fallos comunes y medir su impacto. Cubriremos patrones reales usados en producción en empresas que automatizan la cualificación de leads, el procesamiento de documentos y el soporte al cliente a escala.

Qué son los agentes de IA y en qué se diferencian de los chatbots

Definición de agentes de IA (sistemas autónomos que perciben, deciden y actúan)

Un agente de IA es un sistema de software que:

- Percibe su entorno (lee entrada, resultados de herramientas, memoria)

- Razona sobre la mejor acción (usa un LLM para planificar)

- Actúa llamando a herramientas o dando pasos hacia un objetivo

- Se adapta en función del feedback y los resultados

Los agentes se guían por objetivos. Tú defines el objetivo (“Puntúa y cualifica este lead”) y el agente averigua cómo lograrlo.

Distinción clave: los chatbots son reactivos; los agentes, autónomos

Chatbots: el usuario inicia → el modelo responde

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

El usuario conduce cada interacción. El chatbot es sin estado: cada mensaje es independiente.

Agentes: guiados por objetivos, toman acciones sin input del usuario en cada paso

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

El agente trabaja hacia un objetivo definido, tomando múltiples decisiones y llamadas a herramientas de forma autónoma.

Por qué los agentes son importantes para los flujos de trabajo

Automatización a gran escala (gestiona miles de tareas sin intervención humana)

Cualificación manual de leads: 5 minutos por lead × 100 leads = 500 horas/mes. Coste: 10.000 $/mes (a 20 $/hora).

Con agentes: 10 segundos por lead × 100 leads = 16 horas/mes. Coste: 100 $ (llamadas a API del agente). Ahorro: 99 %.

Los agentes multiplican la capacidad de tu equipo sin contratar.

Razonamiento multi-paso (descomponer problemas complejos en subtareas)

Las tareas complejas requieren varios pasos:

- Cualificación de leads: Puntuar → Enriquecer → Asignar → Notificar

- Triaje de documentos: Extraer → Clasificar → Derivar → Archivar

- Soporte al cliente: Entender → Buscar en base de conocimiento → Generar respuesta → Derivar si es necesario

Los agentes gestionan este razonamiento automáticamente. Tú defines el objetivo; el agente lo divide en pasos.

Uso de herramientas (los agentes llaman a API, bases de datos, servicios externos)

Los agentes son las “manos”. Llaman a API para:

- Consultar bases de datos

- Actualizar sistemas CRM

- Enviar correos o mensajes de Slack

- Llamar a servicios de terceros (enriquecimiento de datos, procesamiento de pagos)

Un único agente puede orquestar 5-10 llamadas a herramientas para completar un flujo de trabajo.

Comportamiento adaptativo (aprende del feedback, ajusta el enfoque)

Los agentes pueden mejorar con el tiempo. Si un agente clasifica mal documentos, tú proporcionas feedback. El agente aprende y ajusta su estrategia de prompting.

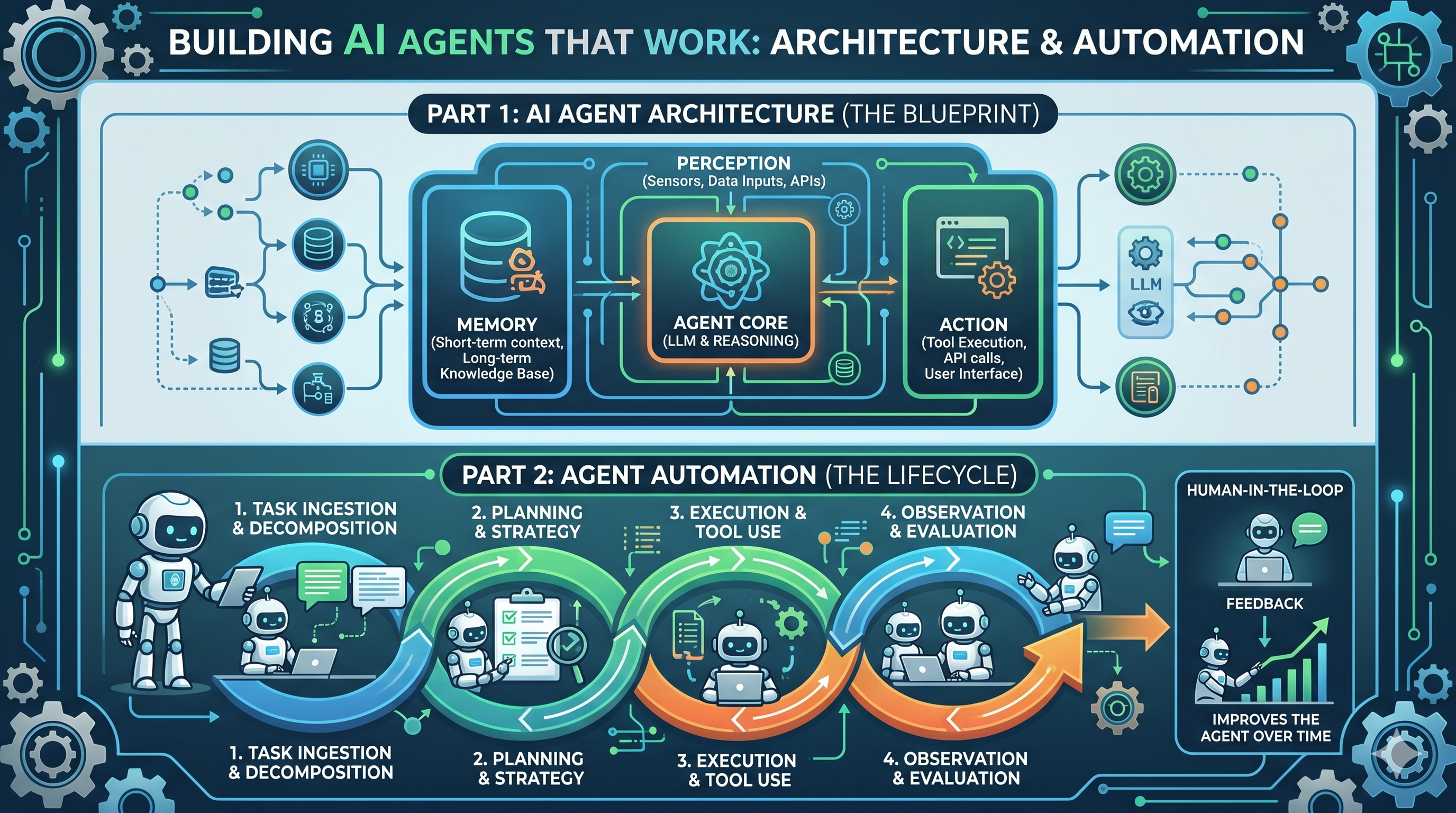

Componentes centrales de un agente de IA (el bucle del agente)

El bucle de razonamiento del agente (con descripción del diagrama)

El núcleo de todo agente es un bucle:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Observación: el agente percibe el estado (entrada, entorno, resultados de herramientas)

El agente lee:

- Entrada inicial (datos del lead, texto del documento, pregunta del cliente)

- Resultados de herramientas de pasos previos (respuestas de API, consultas a BD)

- Memoria (historial de conversación, decisiones pasadas, base de conocimiento)

- Estado actual (qué se ha hecho, qué queda)

Razonamiento: el LLM decide la siguiente acción (planificación, selección de herramienta)

El LLM recibe un prompt como:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

El LLM responde: “Debería enriquecer primero el lead para obtener datos de ingresos, luego puntuar y después asignar.”

Acción: ejecutar la llamada a la herramienta o dar un paso hacia el objetivo

El agente ejecuta la herramienta seleccionada:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: evaluar el resultado, ajustar la estrategia si es necesario

El agente comprueba: ¿tuvo éxito la llamada? ¿Acercó al objetivo? Actualiza la memoria y vuelve al bucle.

Bucle: repetir hasta alcanzar el objetivo o el máximo de pasos

El agente repite observación → razonamiento → acción → feedback hasta que:

- Se alcance el objetivo (“Lead puntuado y asignado”)

- Se alcance el máximo de pasos (para evitar bucles infinitos)

- Ocurra un error (escalar a humano)

Integración de herramientas (las “manos” del agente)

Definir herramientas (firmas de funciones, descripciones, parámetros)

Las herramientas son funciones que el agente puede llamar. Defínelas con claridad:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Descripciones claras ayudan al LLM a elegir la herramienta adecuada.

Llamada a herramientas (cómo los agentes seleccionan e invocan herramientas)

El LLM responde con una llamada a herramienta:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Tu framework de agentes ejecuta la herramienta y devuelve el resultado al LLM.

Manejo de resultados de herramientas (parseo de respuestas, recuperación de errores)

Gestiona el éxito y el fallo:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Si una herramienta falla, el agente debería probar otro enfoque o escalar a un humano.

Sistemas de memoria (qué recuerdan los agentes)

Memoria a corto plazo (contexto actual de la conversación)

Memoria de trabajo del agente: entrada actual, resultados de herramientas, pasos de razonamiento. Normalmente almacenada en la ventana de contexto (el prompt).

Ejemplo: el agente de cualificación de leads recuerda:

- Datos originales del lead

- Resultados de enriquecimiento

- Puntuación

- Qué comercial fue asignado

Memoria a largo plazo (base de conocimiento, interacciones pasadas)

Memoria persistente: decisiones pasadas, patrones aprendidos, base de conocimiento.

Casos de uso:

- Base de conocimiento: el agente recupera artículos relevantes al responder preguntas del cliente

- Historial de decisiones: el agente aprende qué leads convirtieron (mejora la puntuación)

- Logs de interacción: el agente recuerda interacciones previas con un cliente

Implementa con bases de datos vectoriales (Pinecone, Weaviate) para búsqueda semántica.

Limitaciones de memoria (restricciones de la ventana de contexto)

Los LLM tienen ventanas de contexto finitas (4K-128K tokens). Los agentes no pueden recordar todo. Estrategias:

- Resumen: comprimir conversaciones antiguas en resúmenes

- Generación aumentada por recuperación (RAG): recuperar sólo memoria relevante cuando se necesite

- Memoria jerárquica: mantener interacciones recientes en corto plazo, las más antiguas en largo plazo

Columna vertebral del razonamiento (el “cerebro”)

Selección de LLM (GPT-4, Claude, modelos open source)

- GPT-4: mejor razonamiento, maneja tareas complejas. Coste: 0,03-0,06 $ por 1K tokens.

- Claude 3.5 Sonnet: razonamiento sólido, contexto largo (200K tokens). Coste: 0,003-0,015 $ por 1K tokens.

- Open source (LLaMA 4): más barato (0,01-0,03 $ por 1M tokens), personalizable, amigable con la privacidad.

Para la mayoría de agentes, Claude o los modelos open source son suficientes y más baratos.

Modos de razonamiento (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-Thought: el agente piensa paso a paso. “Tengo que enriquecer → puntuar → asignar.”

- Tree-of-Thought: el agente explora varios caminos y elige el mejor. Más lento pero más preciso en problemas complejos.

- Reflexion: el agente critica su propio output y reintenta si hace falta. Reduce alucinaciones.

Ejemplo de prompt con Reflexion:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Compromisos: velocidad vs. precisión

- Agentes rápidos: razonamiento de un solo turno, sin validación de herramientas. 2-5 segundos por tarea. Precisión 85 %.

- Agentes precisos: razonamiento multi-paso, validación, reflexion. 10-30 segundos por tarea. Precisión 95 %.

Elige velocidad para tiempo real (soporte al cliente). Elige precisión para decisiones críticas (financieras).

Tipos de agentes y cuándo usar cada uno

Agentes reactivos (simples, rápidos, sin estado)

Cómo funcionan (un solo turno: entrada → acción)

Los agentes reactivos toman una única decisión y actúan. Sin planificación multi-paso.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

Mejor para: uso simple de herramientas, llamadas a API, respuestas inmediatas

- Preguntas y respuestas de atención al cliente (consultar pedido, saldo)

- Llamadas simples a API (meteo, precio de una acción)

- Se necesitan respuestas inmediatas (latencia < 2 s)

Ejemplo: chatbot de atención al cliente con búsqueda en base de conocimiento

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latencia: 1-3 segundos. Coste: 0,001-0,01 $ por consulta.

Agentes de planificación (guiados por objetivos, razonamiento multi-paso)

Cómo funcionan (descomponer objetivo en subtareas, ejecutar plan)

Los agentes de planificación descomponen objetivos complejos en pasos.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

Mejor para: flujos de trabajo complejos, tareas de investigación, análisis de datos

- Cualificación de leads (enriquecer → puntuar → asignar)

- Procesamiento de documentos (extraer → clasificar → almacenar)

- Investigación (buscar → resumir → compilar)

Ejemplo: agente de cualificación de leads (puntuar → enriquecer → asignar)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latencia: 5-15 segundos. Coste: 0,02-0,05 $ por lead.

Agentes de aprendizaje (adaptativos, mejoran con el tiempo)

Cómo funcionan (incorporan feedback, ajustan su comportamiento)

Los agentes de aprendizaje mejoran con el feedback.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

Mejor para: procesos de larga duración, personalización, optimización

- Recomendación de contenido (aprende preferencias del usuario)

- Enrutamiento de soporte al cliente (aprende qué agentes gestionan mejor qué problemas)

- Optimización de precios (aprende qué precios convierten mejor)

Ejemplo: agente de recomendación de contenido (aprende preferencias del usuario)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Con el tiempo, las recomendaciones mejoran a medida que el agente aprende las preferencias del usuario.

Agentes jerárquicos (agentes que gestionan a otros agentes)

Cómo funcionan (un agente supervisor delega en especialistas)

Un agente supervisor coordina a agentes especialistas.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

Mejor para: flujos de trabajo empresariales, automatización a gran escala

- Creación de contenido (agentes de investigación → escritura → edición → publicación)

- Soporte al cliente complejo (agentes de triaje → resolución → escalado)

- Pipelines de procesamiento de datos (agentes de extracción → transformación → carga)

Ejemplo: pipeline de creación de contenido (investigar → escribir → editar → publicar)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Cada agente especialista está optimizado para su tarea. El supervisor orquesta.

Principales herramientas y frameworks de agentes de IA en 2026 (tabla comparativa)

Criterios de evaluación

Capacidad de razonamiento (Chain-of-Thought, planificación, Reflexion)

Cómo de sofisticado es el pensamiento del agente. Los agentes simples usan chain-of-thought. Los complejos usan planificación y reflexion.

Integración de herramientas (qué tan fácil es añadir herramientas personalizadas)

¿Puedes conectar fácilmente API, bases de datos, CRM? ¿O necesitas código personalizado?

Curva de aprendizaje (tiempo de configuración, calidad de la documentación)

¿Cuán rápido puede un desarrollador poner en marcha un agente funcional? Las plataformas no-code son más rápidas; los frameworks de Python son más flexibles.

Modelo de precios (gratis, por llamada a API, suscripción)

Algunos frameworks son open source (gratis). Otros cobran por llamada a API o por suscripción.

Mejores casos de uso

¿Para qué está optimizada cada herramienta?

Tabla comparativa: principales herramientas y frameworks de agentes de IA (2026)

| Tool | Framework Type | Reasoning Capability | Tool Integration | Learning Curve | Pricing | Best For |

|---|---|---|---|---|---|---|

| n8n | Visual workflow builder | Chain-of-thought | 500+ integrations | Low | Free + paid | Non-technical users, quick setup |

| CrewAI | Python framework | Planning + reflexion | Custom tools (Python) | Medium | Open-source | Developers, complex agents |

| Autogen | Python framework | Multi-agent reasoning | Custom tools | High | Open-source | Research, multi-agent systems |

| LangGraph | Python framework | Planning + state management | LangChain ecosystem | Medium | Open-source | Complex workflows, state tracking |

| FlowHunt | Native platform | Chain-of-thought + planning | Native + API integrations | Low | Subscription | Workflow automation, ease-of-use |

| Lindy.ai | No-code platform | Chain-of-thought | 100+ integrations | Very low | Freemium | Non-technical, quick agents |

| Gumloop | No-code platform | Chain-of-thought | 50+ integrations | Very low | Freemium | Simple automation, templates |

Diferencias clave:

- No-code (n8n, FlowHunt, Lindy.ai): rápidos de construir, personalización limitada. Buenos para flujos estándar.

- Frameworks de Python (CrewAI, Autogen, LangGraph): flexibles, potentes, curva de aprendizaje más pronunciada. Buenos para lógica compleja.

- Open source (CrewAI, Autogen, LangGraph): gratuitos, pero tú gestionas la infraestructura. Las plataformas de pago se encargan del hosting.

Cómo elegir la herramienta adecuada para tu caso de uso

- Prototipo rápido (< 1 semana): usa no-code (FlowHunt, n8n, Lindy.ai)

- Agente complejo con lógica personalizada: usa framework de Python (CrewAI, LangGraph)

- Sistema multi-agente (agentes coordinándose): usa Autogen

- Automatización de flujos en producción: usa FlowHunt (gestionado, monitorizado, escalado)

Construir tu primer agente: arquitectura paso a paso

Define el objetivo y el alcance del agente

¿Qué problema resuelve?

Sé específico. Mal: “Automatizar la gestión de leads.” Bien: “Puntuar leads de 0 a 100, enriquecer con datos de la empresa, asignar a comerciales según capacidad.”

¿Cuáles son las métricas de éxito?

- Precisión: % de decisiones correctas (objetivo: > 90 %)

- Latencia: tiempo para completar la tarea (objetivo: < 10 s)

- Coste: llamadas a API por tarea (objetivo: < 0,05 $)

- Tasa de automatización: % de tareas completadas sin intervención humana (objetivo: > 80 %)

¿Cuáles son las restricciones (latencia, coste, precisión)?

Compromisos:

- Flujos en tiempo real: necesitan < 5 s de latencia. Usa modelos rápidos, menos llamadas a herramientas.

- Flujos por lotes: pueden tolerar 5-30 minutos. Usa razonamiento más preciso, más llamadas a herramientas.

- Sensible al coste: usa modelos open source, menos llamadas a API.

- Crítico en precisión: usa modelos caros (GPT-4), validación multi-paso.

Diseña el bucle del agente

¿Qué observará el agente?

Datos de entrada: datos del lead, texto de documento, pregunta del cliente, contexto de la memoria.

¿Qué modo de razonamiento (chain-of-thought simple vs. planificación)?

- Chain-of-thought: rápido y simple. “Haré el paso 1, luego el paso 2.”

- Planificación: más lento y preciso. “Primero planifico todos los pasos y luego ejecuto.”

¿Qué herramientas necesita?

Lista las API, bases de datos y servicios a los que llamará el agente.

Ejemplo para cualificación de leads:

- API de CRM (obtener/actualizar lead)

- API de enriquecimiento de datos (obtener datos de la empresa)

- Modelo de puntuación (puntuar lead)

- Servicio de notificación (enviar Slack/correo)

¿Cómo sabe cuándo parar?

Define la condición de éxito. “Para cuando el lead esté puntuado y asignado.”

Define también pasos máximos para prevenir bucles infinitos. “Para después de 10 pasos, pase lo que pase.”

Implementa y prueba

Pseudocódigo o ejemplo real de código (CrewAI o FlowHunt)

Ejemplo con CrewAI:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Estrategia de pruebas (tests unitarios para llamadas a herramientas, tests de integración para bucles)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Depuración de problemas comunes (bucles infinitos, alucinaciones, herramientas equivocadas)

- Bucles infinitos: añade límite máximo de pasos. Registra cada paso. Monitoriza acciones repetidas.

- Alucinaciones: añade validación. Comprueba los outputs contra los datos de origen.

- Herramientas equivocadas: mejora las descripciones. Añade validación antes de la ejecución.

Ejemplo real: agente de cualificación de leads

Objetivo: puntuar leads, enriquecer datos, asignar al equipo comercial

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Herramientas: API de CRM, servicio de enriquecimiento de datos, modelo de puntuación

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Recorrido en pseudocódigo (observar lead → puntuar → enriquecer → asignar)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Resultados: métricas de precisión, latencia y coste

- Precisión: 94 % (la puntuación del lead coincide con la revisión manual)

- Latencia: 8 segundos (5 llamadas a herramientas, 3 pasos de razonamiento LLM)

- Coste: 0,03 $ por lead (llamadas API de GPT-4 + API de enriquecimiento)

- Rendimiento: 450 leads/hora (una sola instancia de agente)

- Tasa de automatización: 87 % (13 % escalado a humano para revisión)

Integrar agentes con sistemas empresariales

Patrones de integración de API

API REST (las más comunes)

La mayoría de los agentes llaman a API REST. Usa un cliente HTTP estándar:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (disparadores de agente dirigidos por eventos)

Dispara agentes en eventos (nuevo lead, correo entrante, envío de formulario):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Autenticación y seguridad (API keys, OAuth, rate limiting)

- API keys: almacénalas en variables de entorno, no en el código

- OAuth: para integraciones orientadas al usuario (Salesforce, HubSpot)

- Rate limiting: respeta los límites de API. Implementa backoff y lógica de reintento

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Integración con bases de datos

Solo lectura (el agente consulta datos)

El agente lee datos de clientes, interacciones pasadas, base de conocimiento:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Operaciones de escritura (el agente guarda decisiones/resultados)

El agente escribe decisiones en la base de datos:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transacciones y consistencia (asegurar integridad de datos)

Usa transacciones para operaciones multi-paso:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Integración con CRM y herramientas de negocio

Patrones de integración con Salesforce, HubSpot, Pipedrive

Usa SDK oficiales:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Integración con Slack, correo, Jira (el agente envía notificaciones/actualizaciones)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Autenticación y alcance de permisos

Usa scopes de OAuth para limitar lo que los agentes pueden hacer:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Flujos con humano en el bucle

Cuándo los agentes necesitan aprobación humana

Decisiones de alto riesgo: transacciones financieras, reembolsos a clientes, excepciones de política.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Patrones de escalado (decisiones de alto riesgo, casos límite)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Bucles de retroalimentación (los humanos corrigen los errores del agente)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Fallos comunes de los agentes y cómo prevenirlos

Bucles infinitos (el agente se queda atascado repitiendo la misma acción)

Causa: mala definición del objetivo, herramienta que no avanza

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

Prevención: límite máximo de pasos, seguimiento de progreso, diversidad de herramientas

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Recuperación: timeout, escalado a humano

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Alucinaciones (el agente inventa hechos o outputs de herramientas)

Causa: tendencia del LLM a confabular, descripciones de herramientas deficientes

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

Prevención: generación aumentada por recuperación (RAG), validación de herramientas, verificación de hechos

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Usa RAG para anclar al agente en los hechos:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Recuperación: fallback a humano, reintentar con otro razonamiento

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Uso incorrecto de herramientas (el agente llama a la herramienta equivocada o con parámetros incorrectos)

Causa: descripciones de herramientas ambiguas, razonamiento deficiente

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prevención: documentación clara de herramientas, entrenamiento en uso de herramientas, validación antes de ejecutar

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Recuperación: manejo de errores, sugerir herramienta correcta, reintentar

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Sobrecostes (el agente usa demasiadas llamadas a API)

Causa: razonamiento ineficiente, llamadas redundantes a herramientas

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

Prevención: límites de presupuesto, deduplicación de llamadas, caché

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementa caché:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Recuperación: monitorización de costes, throttling, fallback a modelo más barato

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Problemas de latencia (el agente es demasiado lento para uso en tiempo real)

Causa: múltiples pasos de razonamiento, respuestas lentas de herramientas

Un agente que hace 5 llamadas secuenciales a API de 1 segundo cada una = 5+ segundos de latencia.

Prevención: ejecución paralela de herramientas, caché, modelos más rápidos

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Usa modelos más rápidos:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Recuperación: timeout, devolver resultados parciales, encolar para procesamiento asíncrono

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Medir el rendimiento del agente y el ROI

Métricas clave a monitorizar

Precisión (% de decisiones/acciones correctas)

Compara el output del agente con la verdad de referencia (revisión humana, resultados reales).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latencia (tiempo para completar la tarea)

Mide el tiempo extremo a extremo de entrada a salida.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Coste por tarea (llamadas a API, cómputo, revisión humana)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Satisfacción del usuario (si hay humano en el bucle)

Encuesta a los usuarios: “¿Qué tan satisfecho estás con las decisiones del agente?”

Tasa de automatización (% de tareas completadas sin intervención humana)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Cálculo del ROI

Baseline: coste del proceso manual (horas de persona × tarifa por hora)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Coste del agente: infraestructura + llamadas a API + supervisión humana

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Periodo de retorno: cuando el coste del agente < coste manual

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Ejemplo: ROI de un agente de cualificación de leads

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Mejora continua

Monitoriza métricas a lo largo del tiempo

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

A/B test de diferentes configuraciones del agente

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Incorpora feedback para mejorar la precisión

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Escala los agentes exitosos, retira los que no rinden

Monitoriza el ROI. Si un agente no aporta valor, retíralo. Escala los agentes exitosos a otros equipos.

Preguntas frecuentes

La sección de FAQ se renderiza automáticamente desde el frontmatter y aparece abajo.

{{ cta-dark-panel heading=“Build Agents Without the Complexity” description=“FlowHunt’s native agent platform handles tool integration, error handling, and monitoring. Start building autonomous workflows in minutes, not weeks.” ctaPrimaryText=“Try FlowHunt Free” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Book a Demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}