Servidor Proxy MCP

El Servidor Proxy MCP agrega varios servidores de recursos MCP en un solo servidor HTTP, simplificando las conexiones para asistentes de IA y desarrolladores. P...

Conecta asistentes de IA a herramientas y sistemas a través de diferentes protocolos de transporte MCP usando el servidor MCP mcp-proxy para FlowHunt.

FlowHunt proporciona una capa de seguridad adicional entre tus sistemas internos y las herramientas de IA, dándote control granular sobre qué herramientas son accesibles desde tus servidores MCP. Los servidores MCP alojados en nuestra infraestructura pueden integrarse perfectamente con el chatbot de FlowHunt, así como con plataformas de IA populares como ChatGPT, Claude y varios editores de IA.

El servidor MCP mcp-proxy actúa como un puente entre los transportes MCP Streamable HTTP y stdio, permitiendo la comunicación fluida entre asistentes de IA y diferentes tipos de servidores o clientes del Protocolo de Contexto de Modelo (MCP). Su función principal es traducir entre estos dos protocolos de transporte ampliamente utilizados, permitiendo que herramientas, recursos y flujos de trabajo diseñados para un protocolo sean accesibles desde el otro sin modificaciones. Esto mejora los flujos de desarrollo al hacer posible que los asistentes de IA interactúen con fuentes de datos externas, APIs o servicios que utilizan distintos mecanismos de transporte, permitiendo así tareas como consultas a bases de datos, gestión de archivos o interacciones API a través de sistemas diversos.

No se mencionan plantillas de prompts en el repositorio.

No se describen recursos MCP explícitos en la documentación o el código del repositorio.

No se definen herramientas en la documentación del repositorio ni en el código visible (por ejemplo, no hay funciones explícitas, herramientas ni server.py con definiciones de herramientas presentes).

mcp-proxy o instálalo vía PyPI si está disponible.{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

Asegurando claves API

Puedes asegurar variables de entorno (por ejemplo, claves API) usando env en tu configuración:

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": [],

"env": {

"API_KEY": "${API_KEY}"

},

"inputs": {

"api_key": "${API_KEY}"

}

}

}

}

Uso de MCP en FlowHunt

Para integrar servidores MCP en tu flujo de trabajo de FlowHunt, comienza agregando el componente MCP a tu flujo y conéctalo a tu agente de IA:

Haz clic en el componente MCP para abrir el panel de configuración. En la sección de configuración MCP del sistema, inserta los datos de tu servidor MCP usando este formato JSON:

{

"mcp-proxy": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una vez configurado, el agente de IA podrá usar este MCP como herramienta con acceso a todas sus funciones y capacidades. Recuerda cambiar “mcp-proxy” por el nombre real de tu servidor MCP y reemplazar la URL por la de tu propio servidor MCP.

| Sección | Disponibilidad | Detalles/Notas |

|---|---|---|

| Resumen | ✅ | |

| Lista de prompts | ⛔ | No se encontraron |

| Lista de recursos | ⛔ | No se encontraron |

| Lista de herramientas | ⛔ | No se definieron herramientas explícitas |

| Asegurando claves API | ✅ | Vía env en la configuración |

| Soporte de sampling (menos importante) | ⛔ | Sin mención |

| Soporte de Roots | ⛔ | Sin mención |

En base a lo anterior, mcp-proxy está altamente especializado en la traducción de protocolos pero no proporciona herramientas, prompts o recursos por defecto. Su valor reside en la integración y conectividad, no en la provisión directa de utilidades LLM.

mcp-proxy es una utilidad fundamental para enlazar protocolos de transporte MCP, lo que lo hace sumamente valioso en entornos donde las diferencias de protocolo limitan la interoperabilidad de herramientas IA/LLM. Sin embargo, no ofrece mejoras LLM directas como recursos, prompts o herramientas. Para su caso de uso previsto, es un proyecto robusto y bien soportado. Calificación: 6/10 para utilidad MCP general, 9/10 si necesitas específicamente el enlace de protocolos.

| Tiene LICENSE | ✅ (MIT) |

|---|---|

| Tiene al menos una herramienta | ⛔ |

| Número de forks | 128 |

| Número de estrellas | 1.1k |

El servidor MCP mcp-proxy conecta los transportes MCP Streamable HTTP y stdio, permitiendo la comunicación fluida entre asistentes de IA y una variedad de servidores o clientes MCP. Esto permite que flujos de trabajo y herramientas creados para diferentes protocolos funcionen juntos sin modificaciones.

mcp-proxy es ideal para enlazar protocolos entre diferentes transportes MCP, integrar sistemas heredados con plataformas modernas de IA, mejorar la conectividad en flujos de trabajo de IA y apoyar el desarrollo y prueba multiplataforma.

No, mcp-proxy se centra únicamente en la traducción de protocolos y no proporciona herramientas integradas, plantillas de prompts ni recursos. Su valor radica en habilitar la interoperabilidad y la integración.

Puedes usar variables de entorno dentro de tu configuración del servidor MCP para asegurar las claves API. Por ejemplo, utiliza un bloque 'env' y referencia variables en tu JSON de configuración.

Agrega el componente MCP a tu flujo de FlowHunt, luego configura el servidor MCP mcp-proxy en la configuración MCP del sistema usando el fragmento JSON apropiado. Esto permite que tu agente de IA acceda a todas las capacidades disponibles a través de los protocolos MCP conectados.

Cubre las brechas de tu flujo de trabajo de IA y habilita la interoperabilidad de protocolos sin fricciones con mcp-proxy. Integra sistemas heredados y amplía el alcance de tu IA al instante.

El Servidor Proxy MCP agrega varios servidores de recursos MCP en un solo servidor HTTP, simplificando las conexiones para asistentes de IA y desarrolladores. P...

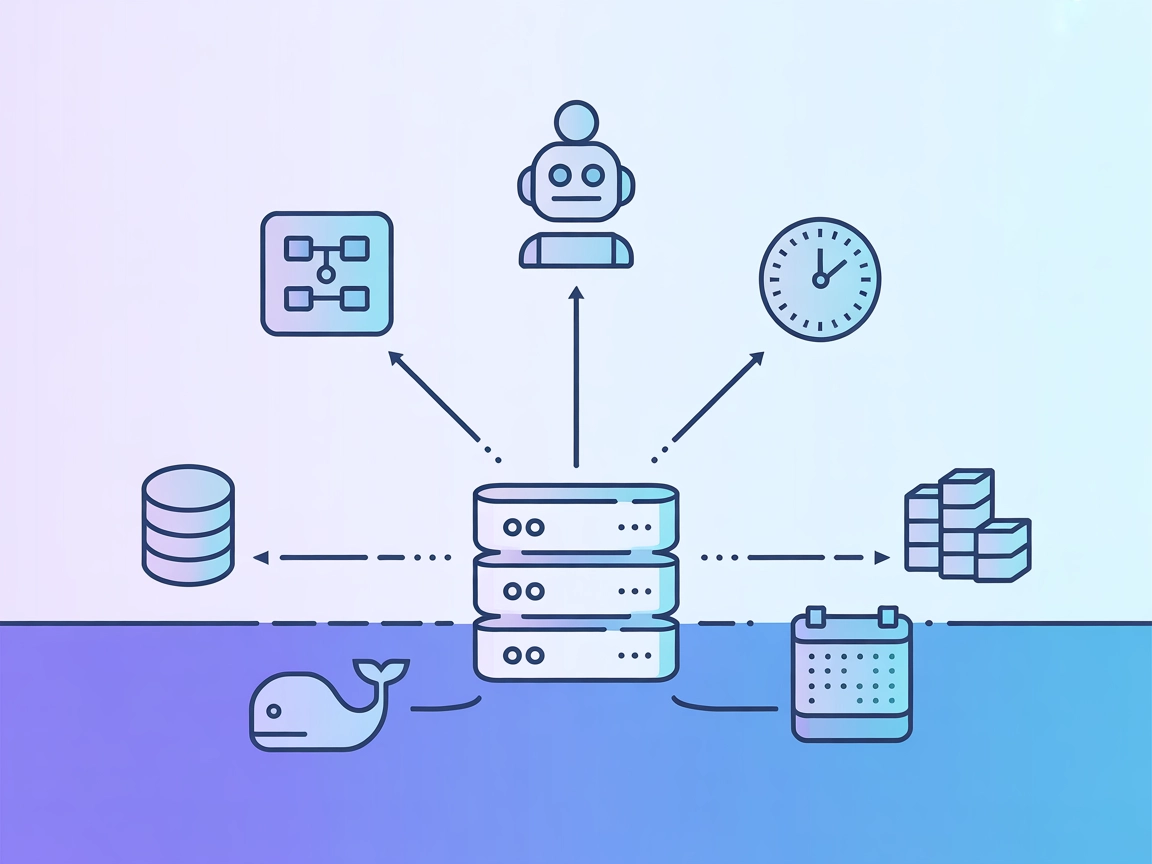

El Servidor Prefect MCP conecta asistentes de IA con la plataforma de orquestación de flujos Prefect, permitiendo la gestión en lenguaje natural de flujos, desp...

El servidor MCP interactive-mcp permite flujos de trabajo de IA fluidos y con intervención humana al conectar agentes de IA con usuarios y sistemas externos. Ad...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.