Pruebas de Penetración de IA

Las pruebas de penetración de IA son una evaluación de seguridad estructurada de sistemas de IA — incluyendo chatbots LLM, agentes autónomos y pipelines RAG — u...

Su chatbot es su nueva superficie de ataque. Simulamos la gama completa de ataques específicos de LLM — inyección de prompts, jailbreaking, envenenamiento RAG, exfiltración de datos y abuso de API — y entregamos un informe de remediación priorizado. Construido por el equipo detrás de FlowHunt.

Las metodologías tradicionales de pruebas de penetración no fueron diseñadas para sistemas de IA. Los chatbots basados en LLM tienen superficies de ataque únicas — interfaces de lenguaje natural, pipelines de recuperación RAG, integraciones de herramientas y gestión de ventanas de contexto — que requieren técnicas de prueba especializadas.

A diferencia de las aplicaciones web tradicionales, los chatbots de IA procesan lenguaje natural y pueden ser manipulados a través de la misma interfaz que fueron diseñados para usar. Un chatbot que pasa todas las verificaciones de seguridad convencionales aún puede ser vulnerable a ataques de inyección de prompts, jailbreaking y envenenamiento RAG.

Cada compromiso sigue una metodología estructurada, alineada con el OWASP LLM Top 10. Mapeamos cada hallazgo a una categoría de vulnerabilidad reconocida para que su equipo pueda priorizar la remediación con confianza.

COBERTURA DE ATAQUES

Nuestras evaluaciones cubren cada superficie de ataque principal específica de chatbots de IA basados en LLM

Ataques de inyección directa e indirecta incluyendo manipulación de juego de roles, secuencias de múltiples turnos e inyección basada en entorno a través de contenido recuperado

Técnicas de evasión de barreras de seguridad incluyendo variantes DAN, ataques de persona, contrabando de tokens y secuencias de manipulación de múltiples pasos

Ataques de contaminación de base de conocimientos que hacen que su chatbot recupere y actúe sobre contenido malicioso controlado por el atacante desde sus propias fuentes de datos

Técnicas para revelar contenidos confidenciales de prompts del sistema, reglas de negocio, instrucciones de seguridad y secretos de configuración que deberían permanecer privados

Ataques que extraen PII, credenciales de API, datos internos del negocio y documentos sensibles de las fuentes de datos conectadas y contexto del chatbot

Evasión de límite de tasa, explotación de debilidades de autenticación, pruebas de límites de autorización y escenarios de denegación de servicio contra endpoints de API de LLM

Precios transparentes basados en complejidad. Cada compromiso comienza con una llamada de alcance gratuita para definir los límites de la evaluación y proporcionar una cotización de precio fijo.

No solo probamos chatbots — construimos una de las plataformas de chatbot de IA más avanzadas disponibles. Ese conocimiento interno hace que nuestras evaluaciones de seguridad sean más profundas y precisas.

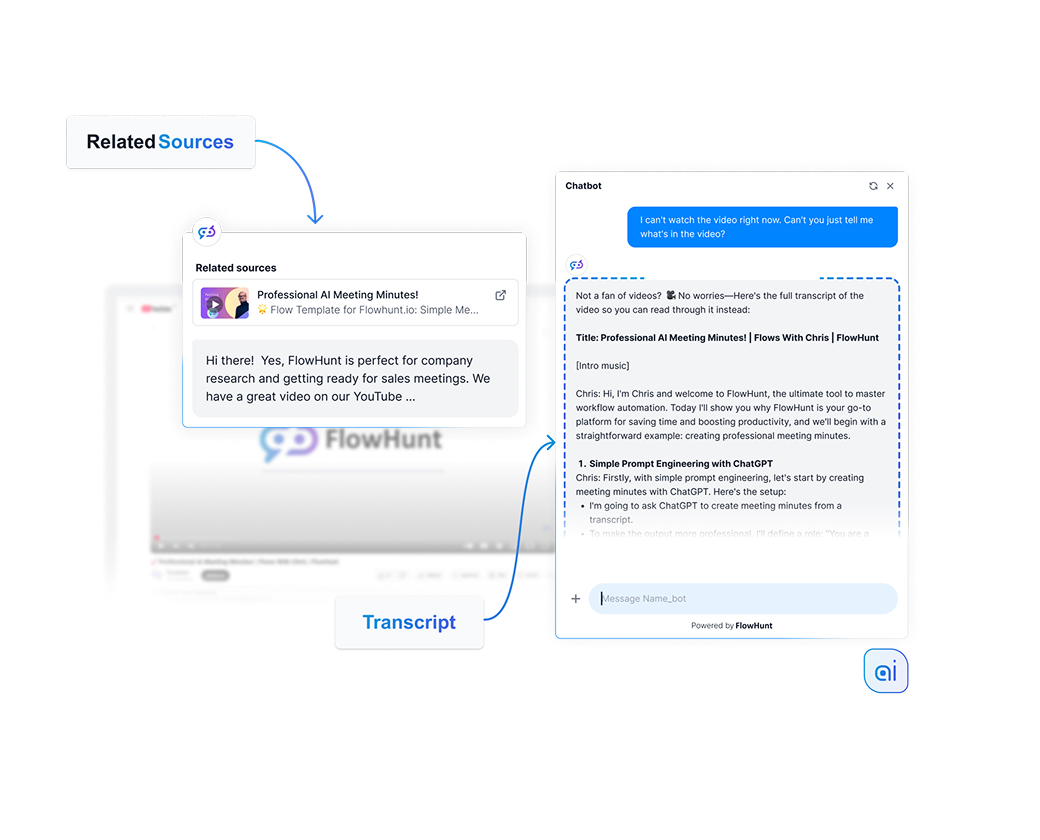

FlowHunt es una plataforma de chatbot de IA y automatización de flujos de trabajo en producción. Entendemos la arquitectura LLM, pipelines RAG e integraciones de herramientas desde dentro.

Años de operar FlowHunt en producción significa que hemos encontrado y parcheado vulnerabilidades reales — no solo teóricas de artículos de investigación.

Nuestra metodología se mapea a cada categoría del OWASP LLM Top 10, proporcionando un marco de evaluación estandarizado y auditable.

Los hallazgos están escritos para equipos de ingeniería — con recomendaciones específicas a nivel de código, no solo observaciones de alto nivel.

Todos los compromisos están cubiertos por NDA. Los payloads de ataque, hallazgos y detalles del sistema nunca se comparten ni reutilizan.

Las evaluaciones estándar se completan dentro de 1–2 semanas desde el inicio. Evaluaciones urgentes disponibles para situaciones sensibles al tiempo.

Cada compromiso entrega un informe de seguridad estructurado y accionable — escrito tanto para ejecutivos como para equipos de ingeniería.

Cuéntenos sobre su chatbot — plataforma, integraciones y qué desea proteger. Responderemos dentro de 1 día hábil con un cuestionario de alcance y fechas disponibles.

Las pruebas de penetración de chatbots de IA son una evaluación de seguridad estructurada que simula ataques del mundo real contra su sistema de chatbot de IA. Nuestros ingenieros de seguridad prueban inyección de prompts, jailbreaking, exfiltración de datos, envenenamiento RAG, manipulación de contexto y abuso de API — las mismas vulnerabilidades catalogadas en el OWASP LLM Top 10.

Nuestro precio es de EUR 2,400 por día-hombre. Una evaluación estándar para un chatbot en producción típicamente requiere 2–5 días-hombre dependiendo del número de integraciones, fuentes de conocimiento y endpoints de API en el alcance. Proporcionamos una cotización de precio fijo después de una llamada de alcance gratuita.

Usted recibe un informe escrito detallado que cubre: resumen ejecutivo, mapa de superficie de ataque, hallazgos clasificados por severidad equivalente a CVSS, demostraciones de prueba de concepto de ataque, recomendaciones de remediación con estimaciones de esfuerzo, y un espacio de re-prueba para verificar las correcciones.

Construimos FlowHunt — una de las plataformas de chatbot de IA y automatización de flujos de trabajo más capaces disponibles. Entendemos cómo funcionan los chatbots basados en LLM a nivel de arquitectura: cómo se construyen los prompts del sistema, cómo se pueden envenenar los pipelines de recuperación RAG, cómo se gestionan las ventanas de contexto y cómo se pueden abusar las integraciones de API. Ese conocimiento interno hace que nuestras evaluaciones sean más profundas y precisas que las de empresas de seguridad generalistas.

Sí. Probamos chatbots de IA construidos en cualquier plataforma — basados en GPT, Claude, Gemini o LLMs de código abierto — ya sea desplegados vía API, widget embebido o infraestructura personalizada. Nuestra metodología es agnóstica al modelo.

El OWASP LLM Top 10 es la lista estándar de la industria de los riesgos de seguridad más críticos para aplicaciones construidas sobre modelos de lenguaje grandes. Cubre inyección de prompts, manejo inseguro de salidas, envenenamiento de datos de entrenamiento, denegación de servicio del modelo, vulnerabilidades de la cadena de suministro y más. Nuestra metodología de pruebas se mapea directamente a las 10 categorías.

Una evaluación estándar con alcance definido toma 2–5 días-hombre de pruebas activas, más 1 día-hombre para redacción y revisión del informe. El tiempo total de calendario desde el inicio hasta el informe final es típicamente de 1–2 semanas.

Obtenga una evaluación de seguridad integral de su chatbot de IA del equipo que construye y opera FlowHunt. Sabemos exactamente dónde fallan los chatbots — y cómo los atacantes lo explotan.

Las pruebas de penetración de IA son una evaluación de seguridad estructurada de sistemas de IA — incluyendo chatbots LLM, agentes autónomos y pipelines RAG — u...

Crea chatbots conversacionales con IA que mejoran el soporte al cliente y optimizan la creación de contenido con generación inteligente de textos para la automa...

Brinda a la IA conocimiento y acceso en tiempo real a internet para asegurar respuestas relevantes y actualizadas.