KNIME

KNIME (Konstanz Information Miner) on tehokas avoimen lähdekoodin data-analytiikka-alusta, joka tarjoaa visuaaliset työnkulut, saumattoman dataintegraation, edi...

Käytännön kokeilu Gemma 4 31B:n hienosäätöstä LoRA:lla Apple Siliconilla urheiluartikkeleiden tuottamiseen, suorassa vertailussa Claude Sonnetiin laadun, nopeuden ja kustannusten osalta.

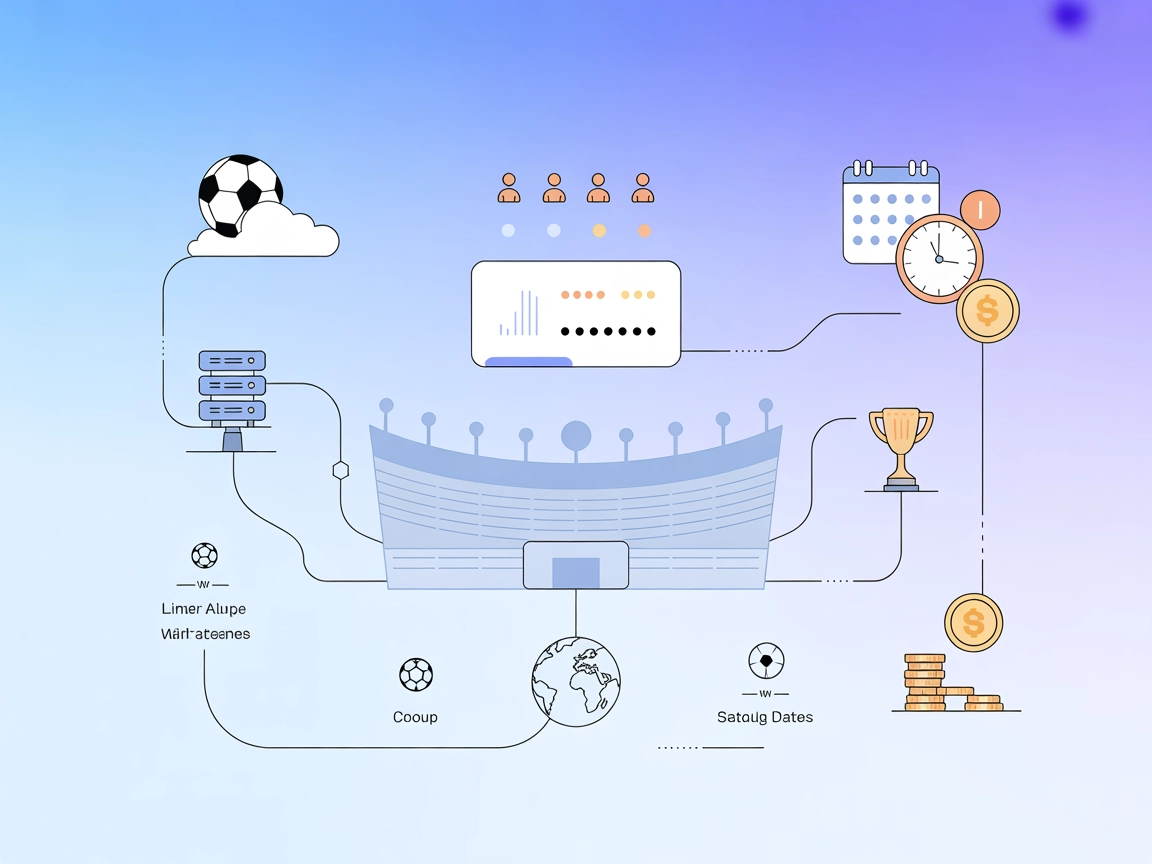

Pyörittämme urheilutietojen alustaa, joka julkaisee otteluraportteja ja liigakierroksia yhdeksässä urheilulajissa. Jokainen artikkeli on tuotettu API-kutsuilla Claude Sonnetille — luotettava, korkealaatuinen, mutta kallis suuressa mittakaavassa. Halusimme tietää: voiko avoimesti saatavilla oleva malli, joka on hienosäädetty omille tiedoillemme, tuottaa verrattavissa olevan laadun omaisia artikkeleita samalla kun se toimii kokonaan paikallisella laitteistolla?

Tämä kirjoitus käy läpi koko kokeilun — tiedon valmistelusta LoRA hienosäätöön suoraan vertailuun — käyttämällä Google:n Gemma 4 31B -mallia, Apple:n MLX-kehystä ja MacBook Pro M3 Max:ia 96 Gt yhtenäisellä muistilla. Puramme myös todellisen taloudellisen tilanteen: milloin mukautetun mallin harjoittelu todella säästää rahaa API-kutsuihin verrattuna?

Gemma 4 on Google:n avoin kielimallien perhe, joka julkaistiin vuonna 2025 Gemma 2 -sarjan seuraajana. Avainsana on avoin — toisin kuin omistajien mallit, kuten GPT-4 tai Claude, Gemma 4:n painot ovat vapaasti saatavilla lataukseen, hienosäätöön ja käyttöönottoon ilman jatkuvia API-maksuja.

Malli on saatavana useissa kokoluokissa. Käytimme 31B-parametrisen ohjeistetun variantin (google/gemma-4-31B-it), joka on hyvä kompromissi kyvykkyyden ja laitteistovaatimusten välillä. Täydellä fp16-tarkkuudella se vaatii noin 62 Gt muistia; 4-bittisellä kvantisoinnilla se puristuu noin 16 Gt:iin, pieneksi tarpeeksi toimia kannettavalla 32 Gt RAM-muistilla.

Mitä tekee Gemma 4:stä erityisen mielenkiintoisen meidän käyttötapauksellemme:

Kompromissi on selvä: luovut API-kutsun plug-and-play-mukavuudesta hallintaa, yksityisyyttä ja dramaattisesti alhaisempia marginaalikustannuksia vastaan suuressa mittakaavassa.

Alustamme tuottaa satoja artikkeleita päivässä jalkapallosta, koripallosta, jäähockeysta, NFL:stä, baseballista, rugbysta, lentopallosta ja kädessä pelattavasta pallosta. Jokainen artikkeli maksaa noin 0,016 dollaria API-kutsuissa Claude Sonnetille. Se kertyy nopeasti — 500 artikkelia päivässä tarkoittaa 240 dollaria kuukaudessa tai 2 880 dollaria vuodessa.

Kustannusten lisäksi halusimme:

Hypoteesi: jos harjoitamme 31B-parametrisen mallin 120:llä Claude Sonnetin kirjoittamalla “täydellisellä” artikkelilla, sen pitäisi oppia rakenne, sävy ja urheilukohtaiset käytännöt tarpeeksi hyvin tuottaakseen artikkeleita itsenäisesti.

Kokeilu kulki viidessä vaiheessa:

Vaihe 1: Harjoitusottelujen valinta — Kaikki ottelut eivät ole hyviä harjoitusesimerkkejä. Rakensimme rikkauspisteytys-järjestelmän, joka suosii tietointensiivisiä otteluita tapahtumilla, tilastoilla ja sarjayhteydellä. Valitsimme 100 ottelun artikkelia ja 20 liigapäivän yhteenvetoa, joissa oli monipuolisuutta tulostyyppien välillä (kotijäännöt, vierasjäännöt, tasapelit, selvät voitot, takaisintuonti). Tämä alkuperäinen kokeilu keskittyi yksinomaan jalkapalloon: 120 harjoitusesimerkkiä yhteensä.

Vaihe 2: Viiteartikeleiden luominen Claude Sonnetilla — Jokaisen ottelun JSON-tiedot muunnettiin strukturoiduksi tekstikysymykseksi ja lähetettiin Claude Sonnetille järjestelmäkysymyksellä, joka määrittelee käännetyn pyramidiartikelirakenteen: otsikko, johdantokappale pisteillä, kronologiset keskeisimmät hetket, tilastoanalyysi, liigakonteksti ja lyhyt katsaus eteenpäin. Jokainen artikkeli maksoi noin 0,016 dollaria. Koko 120 artikkelin tietojoukko maksoi alle 2 dollaria.

Vaihe 3: Tietojoukon muotoilu — Artikkelit muunnettiin Gemman chat-muotoon (<start_of_turn>user / <start_of_turn>model) ja jaettiin 90/10:ksi 115 harjoitus- ja 13 validointiesimerkkiin.

Vaihe 4: Hienosäätö LoRA:lla MLX:ssä — Tässä Apple Silicon ansaitsee paikkansa. Koko 31B-malli mahtuu M3 Max:n yhtenäiseen muistiin. Käytimme LoRA:ta pienien harjoitettavien matriisien lisäämiseen 16 kerrokseen, mikä lisäsi vain 16,3 miljoonaa harjoitettavaa parametria — 0,053 % kokonaismäärästä.

| Parametri | Arvo |

|---|---|

| Perusmalli | google/gemma-4-31B-it |

| Harjoitettavat parametrit | 16,3M (0,053 % 31B:stä) |

| Harjoitusesimerkit | 115 |

| Aikakaudet | 3 |

| Kokonaistoistelut | 345 |

| Erän koko | 1 |

| Oppimisprosentti | 1e-4 |

| Huippumuistin käyttö | 76,4 GB |

| Harjoitusaika | ~2,5 tuntia |

Validointihäviö laski 6,614:stä 1,224:ään 345 iteraatiossa, jossa jyrkin parannus tapahtui ensimmäisen 100 askeleen aikana.

Vaihe 5: Kvantisointi — Käytimme 4-bittistä kvantisointi MLX:llä, pakkasimme mallin 62 Gt:stä ~16 Gt:iin. Tämä teki päättelystä 2,6 kertaa nopeampaa samalla kun säilytimme hyväksyttävän laadun.

Vertasimme viittä artikkelia, jotka luotiin identtisistä ottelutiedoista kaikissa kolmessa kokoonpanossa.

| Kokoonpano | Keskimääräiset sanat | Keskimääräinen aika | Laatu |

|---|---|---|---|

| Claude Sonnet (API) | 402 | ~2s | Paras narratiivinen virtaus, nolla hallusinaatioita |

| Gemma 4 31B fp16 + LoRA | 391 | 207s | Vahva rakenne, satunnainen toistaminen |

| Gemma 4 31B 4-bit + LoRA | 425 | 80s | Hyvä rakenne, satunnainen pienempi faktallinen virhe |

Missä hienosäädetty Gemma 4 loistaa:

Missä Sonnet johtaa edelleen:

Oliko LoRA-harjoittelu sen arvoinen? Ehdottomasti. Ilman LoRA:ta perus-Gemma 4 -malli tuottaa lähtöä, joka on täynnä sisäisiä ajattelun tunnuksia (<|channel>thought), markdown-muotoilua ja yleistä urheilukirjoitusta. Hienosäädetty malli tuottaa puhdasta, tuotantokelpoista tekstiä omalla toimituksellisella tyylillämme. Koko LoRA-harjoittelu maksoi 2 dollaria API-kutsuissa ja 2,5 tuntia laskentaa.

MacBook Pro M3 Max palveli tarkoitustaan kehitys- ja kokeilualustana. Se osoitti, että 31B-mallin hienosäätö ja päättely on teknisesti mahdollista Apple Siliconilla. Mutta emme koskaan ottaisi tuotantokuormia käyttöön paikallisella kannettavalla.

Todelliselle tuotantokäyttöönotolle pilvipalvelun GPU-instanssi on oikea valinta. Tässä on mitä realistinen käyttöönotto näyttää AWS:lla.

Kvantisoitu 4-bittinen Gemma 4 -malli (16 Gt) sopii mukavasti yhteen A10G GPU:hun. Päättelynopeus A10G:lla on huomattavasti nopeampi kuin Apple Silicon — noin 15 sekuntia per artikkeli vs. 80 sekuntia M3 Max:lla.

| Mittari | Arvo |

|---|---|

| Instanssin tyyppi | g5.xlarge |

| GPU | NVIDIA A10G (24 Gt VRAM) |

| On-demand-hinta | 1,006 $/h |

| Spot-hinta (tyypillinen) | ~0,40 $/h |

| Päättelynopeus | ~15 sekuntia/artikkeli |

| Läpimenoluku | ~240 artikkelia/tunti |

| Kustannus per artikkeli (on-demand) | 0,0042 dollaria |

| Kustannus per artikkeli (spot) | 0,0017 dollaria |

| Lähestymistapa | Kustannus/artikkeli | Päivittäinen kustannus | Kuukausittainen kustannus | Vuotuinen kustannus |

|---|---|---|---|---|

| Claude Sonnet API | 0,016 dollaria | 8,00 dollaria | 240 dollaria | 2 880 dollaria |

| AWS g5.xlarge (on-demand) | 0,0042 dollaria | 2,10 dollaria | 63 dollaria | 756 dollaria |

| AWS g5.xlarge (spot) | 0,0017 dollaria | 0,85 dollaria | 25,50 dollaria | 306 dollaria |

| Paikallinen M3 Max (sähkö) | 0,0007 dollaria | 0,35 dollaria | 10,50 dollaria | 126 dollaria |

GPU:n etu on selvä: 74 % kustannusten vähennys on-demand-instansseissa, 89 % spot-instansseissa, Sonnet API -kutsuihin verrattuna — generointinopeuksilla vain 7-8 kertaa hitaammin kuin API-kutsu M3 Max:lla 40 kertaa hitaamman sijaan.

Paikallisella M3 Max:lla on alhaisin marginaalikustannus (0,0007 dollaria/artikkeli sähköstä) mutta korkein alkuinvestointi. Noin 45 artikkelissa tunnissa (4-bittinen kvantisoitu), yksittäinen M3 Max tuottaa noin 1 080 artikkelia päivässä 24/7:llä käytettynä.

| Kustannustekijä | Arvo |

|---|---|

| Laitteiston kustannus | ~4 000 dollaria (MacBook Pro M3 Max 96 Gt) |

| Virrankulutus | ~200 W kuormituksen alaisena |

| Sähkön kustannus | ~0,72 dollaria/päivä (24 h jatkuvaa) |

| Läpimenoluku | ~1 080 artikkelia/päivä |

| Kannattavuus Sonnetiin verrattuna | ~260 000 artikkelia (~8 kuukautta 500/päivällä) |

Milloin paikallinen on järkevä? Yrityksille, jotka tarvitsevat 100 % tietosuojaa ja eivät voi käyttää pilvipalvelun malleja — olipa se sääntelyvaatimuksista, sopimuksista tai arkaluontoisten alueiden toiminnasta johtuen — paikallinen käyttöönotto poistaa kaikki ulkoiset tiedonsiirrot. Ottelutiedot, mallin painot ja luotu sisältö eivät koskaan poistu yrityksen tiloista. Tämä ei ole kustannusoptimointia; se on vaatimuksenmukaisuus ja hallinta. Teollisuudet, kuten puolustus, terveydenhuolto, rahoitus ja laki, saattavat pitää tätä ainoana hyväksyttävänä käyttöönottomallina.

Kriittinen kysymys: millä volyymilla hienosäätöön sijoittaminen kannattaa Claude Sonnetin käyttämiseen nähden kaikessa?

| Kohde | Kustannus |

|---|---|

| Harjoitustiedon luominen (120 artikkelia Sonnetin kautta) | 2 dollaria |

| Koko 9-urheilu-harjoitustieto (960 artikkelia) | 16 dollaria |

| Kehittäjän aika putkilinjalle (~20 tuntia) | ~500 dollaria |

| AWS GPU-aika harjoitteluun (valinnainen) | ~5 dollaria |

| Kokonaiset kertaluonteiset kustannukset | ~523 dollaria |

Säästöt per artikkeli riippuvat käyttöönottotavastasi:

| Käyttöönotto | Kustannus/artikkeli | Säästöt Sonnetiin verrattuna | Kannattavuus (artikkelit) | Kannattavuus 500/päivällä |

|---|---|---|---|---|

| AWS on-demand | 0,0042 dollaria | 0,0118 dollaria | ~44 300 | ~89 päivää (~3 kuukautta) |

| AWS spot | 0,0017 dollaria | 0,0143 dollaria | ~36 600 | ~73 päivää (~2,5 kuukautta) |

| Paikallinen M3 Max | 0,0007 dollaria | 0,0153 dollaria | ~34 200 | ~68 päivää (~2 kuukautta) |

Jos jätämme kehittäjän ajan pois (käsittelemme sitä oppimiskokemuksen uponneet kustannuksina) ja laskemme vain kovia infrastruktuurikustannuksia (21 dollaria):

| Käyttöönotto | Kannattavuus (artikkelit) | Kannattavuus 500/päivällä |

|---|---|---|

| AWS on-demand | ~1 780 | 3,5 päivää |

| AWS spot | ~1 470 | 3 päivää |

| Paikallinen M3 Max | ~1 370 | 2,7 päivää |

Matematiikka on suoraviivainen: jos tuotat yli ~1 500 artikkelia, mukautettu malli maksaa itsensä takaisin pelkillä kovilla kustannuksilla. Kehittäjän ajan lisääminen siirtää kannattavuuden noin 35 000-45 000 artikkeliin tai noin 2,5-3 kuukauteen 500 artikkelissa päivässä.

Suuressa mittakaavassa (500+ artikkelia/päivä), vuotuiset säästöt ovat huomattavat:

| Lähestymistapa | Vuotuinen kustannus | Vuotuiset säästöt Sonnetiin verrattuna |

|---|---|---|

| Claude Sonnet | 2 880 dollaria | — |

| AWS g5 on-demand | 756 dollaria + 523 dollaria kertaluonteiset = 1 279 dollaria (vuosi 1) | 1 601 dollaria |

| AWS g5 spot | 306 dollaria + 523 dollaria kertaluonteiset = 829 dollaria (vuosi 1) | 2 051 dollaria |

| Paikallinen M3 Max | 126 dollaria + 4 523 dollaria (laitteisto + asennus) = 4 649 dollaria (vuosi 1) | -1 769 dollaria (vuosi 1), +2 754 dollaria (vuosi 2+) |

Käytännöllisin lähestymistapa on hybridi: käytä hienosäädettävää Gemma 4 -mallia rutiiniselle sisällölle (suurin osa volyymista) ja varaa Claude Sonnet:

Tämä antaa sinulle itsepalvelun päättelyn kustannushyödyt 80-90 % volyymistasi samalla kun säilytät Sonnetin ylivoimaisen laadun saatavilla olevan reunatapauksiin, jotka todella merkitsevät.

LoRA on huomattavan tehokas tyylien siirtämiseen. Vain 115 harjoitusesimerkillä malli oppi tarkalleen artikkelin muodon, sävyn ja urheilukohtaiset käytännöt. Käännetyn pyramidin rakenne, aktiivinen verbiä käyttävä tyyli ja dataan perustuva lähestymistapa kaikki siirtyivät puhtaasti.

Apple Silicon on elinkelpoisesti harjoittelualusta 31B-malleille. M3 Max käsitteli koko mallin gradienttien tarkistuspisteillä, huipulla 76,4 Gt. Harjoittelu valmistui 2,5 tunnissa — tarpeeksi nopeasti hypeparametrien iteroimiseen yhden työpäivän sisällä.

Strukturoidulla tulotiedolla on valtava merkitys. Tiedon muotoilijan laatu vaikuttaa suoraan artikkelien laatuun. Kattavaan tiedonpoistoon sijoittaminen tuottaa tuloksia sekä API- että itsepalvelupolulla.

Tuotantokäyttöönotto kuuluu pilveen (useimmille tiimeille). M3 Max osoitti konseptin. AWS GPU-instanssit toimittavat tuotantokuormille vaadittavan nopeuden ja luotettavuuden 74-89 % alhaisemmilla kustannuksilla kuin API-kutsut. Paikalliset koneet jäävät oikeaksi valinnaksi vain silloin, kun tietosuojan vaatimukset sulkevat pois kaiken ulkoisen infrastruktuurin.

Kannattavuusmatemaatika suosii mukautettuja malleja kohtuullisessa mittakaavassa. Jokainen tiimi, joka tuottaa yli ~1 500 artikkelia, palauttaa hienosäätöön sijoittamisen kovat kustannukset lähes välittömästi. Todellinen kysymys ei ole, säästävätkö mukautetut mallit rahaa — vaan onko tiimillä tekniikan kapasiteetti rakentaa ja ylläpitää putkilinjaa.

Gemma 4 31B:n hienosäätö tuotti sisällöntuotajan, joka vastaa Claude Sonnettia otsikon laadun, artikkelirakenteen ja faktallisen tarkkuuden suhteen — samalla kun vähensi per-artikkelin kustannuksia 74-89 % pilviinfrastruktuurissa ja mahdollisti täysin yksityisen, paikan päällä olevan käyttönoton organisaatioille, jotka sitä vaativat.

M3 Max MacBook palveli puhtaasti testipenkkinä tälle kokeelle. Todellinen tuotantokäyttöönotto toimisi AWS GPU -instansseilla (g5.xlarge A10G:llä), missä kvantisoitu malli tuottaa artikkeleita noin 15 sekunnissa 0,0042 dollarin hinnalla — verrattuna 0,016 dollariin Sonnet API -kutsussa.

Yrityksille, jotka tarvitsevat täydellisen tietosuojan ja eivät voi käyttää pilvipalvelun tekoälypalveluja, kvantisoitu malli paikallisessa koneessa on laillinen vaihtoehto. Noin 45 artikkelia tunnissa yksittäinen työasema käsittelee kohtuullisia volyymeja ilman ulkoista tiedonsiirtoa. Laitteiston investointi maksaa itsensä takaisin noin 8 kuukaudessa API-kustannuksiin verrattuna.

Taloustiede on selvä: 500 artikkelia päivässä, mukautettu hienosäädetty malli AWS spot-instansseissa säästää yli 2 000 dollaria vuodessa Claude Sonnet API -kutsuihin verrattuna. Kannattavuus saavutetaan alle 3 kuukaudessa. Tiimeille, jotka jo tuottavat sisältöä suuressa mittakaavassa, avoimen painojen mallien, LoRA hienosäätöjen ja hyödykkeiden GPU-laitteistojen yhdistelmä edustaa uskottavaa, kustannustehokasta vaihtoehtoa omistajien API:ille.

Rakennettu FlowHunt :lla. Täydellinen putkilinja — tiedon valmistelusta hienosäätöön päättelyyn — on saatavana osana urheilutietojen alustamme työkalusarjaa.

Viktor Zeman on QualityUnitin osakas. Jopa 20 vuoden yrityksen johtamisen jälkeen hän on ensisijaisesti ohjelmistoinsinööri, joka on erikoistunut tekoälyyn, ohjelmalliseen hakukoneoptimointiin ja taustajärjestelmien kehittämiseen. Hän on osallistunut lukuisiin projekteihin, kuten LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab ja moniin muihin.

KNIME (Konstanz Information Miner) on tehokas avoimen lähdekoodin data-analytiikka-alusta, joka tarjoaa visuaaliset työnkulut, saumattoman dataintegraation, edi...

Gemini Flash 2.0 asettaa uudet standardit tekoälylle parannetulla suorituskyvyllä, nopeudella ja multimodaalisilla kyvyillä. Tutustu sen mahdollisuuksiin tosiel...

Integroi FlowHunt avoimen lähdekoodin Soccerdata MCP Serverin kanssa tuodaksesi reaaliaikaiset jalkapallo-ottelutiedot, live-tulokset, kokoonpanot, ottelutapaht...