Parhaat AI-agenttien rakentajat 2026: Kattava opas autonomisiin älyalustoihin

Tutustu vuoden 2026 parhaisiin AI-agenttien rakennusalustoihin, aina koodittomista ratkaisuista yritystason kehyksiin. Selvitä, mitkä työkalut sopivat parhaiten...

Karsii multi-agent-hypeä. Vuoden 2026 alan konsensus, 15-kertainen tokenikustannus, neljä prompt-mallia ja 45 minuutin FlowHunt-tutoriaali, joka hyödyntää konsensusmallia.

Multi-agent AI -järjestelmä on AI-agenttien verkosto, joka työskentelee yhdessä ratkaistakseen ongelman. Mutta arkkitehtuuri, joka todella otetaan käyttöön vuonna 2026, on kapeampi kuin muotisana antaa ymmärtää: yksi orchestrator omistaa koko keskustelukontekstin ja luo ohimeneviä eristettyjä subagentteja, jotka palauttavat vain tiivistetyn yhteenvedon. Anthropic, Cognition, OpenAI, AutoGen-via-Microsoft Agent Framework ja LangChain ovat kaikki päätyneet tähän malliin. Peer collaboration -tyyliset “GroupChat”-suunnitelmat — joissa työntekijät keskustelevat suoraan keskenään — ovat hiljaa menettäneet jalansijaa.

Tämä artikkeli tekee kolme asiaa. Ensinnäkin se selittää orchestrator + subagent -mallin ja sen, miksi ala konvergoitui sen ympärille. Toiseksi se käy läpi kustannusten todellisuuden: Anthropicin mittaaman ~15× tokenipreemion ja vuoden 2026 julkaisut, jotka osoittavat single-agent-järjestelmien yltävän multi-agent-järjestelmien tasolle tai voittavan ne samalla tokenibudjetilla. Kolmanneksi se näyttää, miten konsensusmalli rakennetaan FlowHuntissa ilman koodin kirjoittamista.

Todellisuudessa vain kaksi arkkitehtuuria kannattaa vertailla, ja suurin osa markkinointimateriaalista sekoittaa ne keskenään.

Peer collaboration. Useat agentit ajavat samanaikaisesti ja kommunikoivat jaetun väylän kautta. Ne voivat kysyä toisiltaan kysymyksiä, siirtää tehtäviä ja herätellä toisiaan. Supervisor välittää viestejä mutta ei omista ainoaa kontekstia. AutoGen GroupChat, CrewAI hierarchical ja kaikki “tiimi agentteja striimissä” -tyyppiset suunnitelmat kuuluvat tähän. Hinta on todellinen: jokainen herääminen lukee koko transkription uudelleen, järjestelmäprompt kuljettaa pitkää koordinaatioprotokollaa jokaisella kutsulla ja kommunikaatiosuhteet skaalautuvat O(n²).

Orchestrator + eristetyt subagentit. Yksi agentti omistaa koko kontekstin. Se luo ohimeneviä subagentteja suorittamaan eristettyjä osatehtäviä. Jokainen subagentti ajaa omassa tuoreessa kontekstinikkunassaan oman järjestelmäpromptin kanssa, suorittaa tehtävänsä ja palauttaa yhden yhteenvetomerkkijonon. Peer-to-peer-kanavaa tai jaettua muuttuvaa tilaa ei ole. Anthropicin research multi-agent system, Claude Coden Task-työkalu, OpenAI:n agents-as-tools ja Cognitionin maaliskuun 2026 Managed Devins käyttävät kaikki tätä mallia.

Jälkimmäinen malli on teknisesti multi-agent, mutta sen koordinaatiokustannus on rajattu. Peer-väylää ei ole, joten ei myöskään kvadraattista kommunikaatioräjähdystä eikä transkription uudelleentoiston veroa.

Polarisoitunut vuoden 2025 keskustelu on käytännössä romahtanut.

Cognitionin Don’t Build Multi-Agents (kesäkuu 2025) oli jyrkin julkilausuttu kanta multi-agent-suunnittelua vastaan — vain yksisäikeinen, erillinen kompressio-LLM kontekstinhallintaan. Yhdeksän kuukautta myöhemmin, maaliskuussa 2026, Cognition julkaisi Devin can now Manage Devins : koordinaattorin, joka rajaa työn, antaa kunkin osan managed Devinille, joka ajaa omassa eristetyssä virtuaalikoneessaan, ja kokoaa tulokset yhteen. Perustelu — “konteksti kasaantuu, fokus heikkenee ja kunkin osatehtävän laatu kärsii” — on sama eristysargumentti, jonka Anthropic esitti vuonna 2025. Artikkeli ei vedä aiempaa esseetä takaisin nimeltä, mutta arkkitehtoninen myönnytys on yksiselitteinen.

Anthropicin asema liikkui samalla aikavälillä vastakkaiseen suuntaan — kohti irrotettuja “aivot/kädet”-arkkitehtuureja sen sijaan, että fan-outia laajennettaisiin. Huhtikuun 2026 Managed Agents -artikkeli ja kolmen agentin harness full-stack-kehitykseen korostavat role-scoped-subagentteja ennen peer-tiimejä.

OpenAI:n 15. huhtikuuta 2026 Agents SDK -päivitys teki sisäkkäisestä handoff-historiasta opt-in-oletuksen — vähentäen agenttien välistä kontekstivuotoa. AutoGen yhdistettiin Microsoft Agent Framework 1.0:aan; peer GroupChat ei ole enää lippulaiva. LangChain suosittelee nyt supervisor-as-tool-mallia ennen supervisor-kirjastoa.

Viisi toimittajaa, yksi suunta. Peer GroupChat on hiipumassa.

Eniten lainattu luku Anthropicin kesäkuun 2025 engineering-artikkelista:

“Sisäinen analyysi osoittaa, että agentit käyttävät tyypillisesti noin 4× enemmän tokeneita kuin chat-vuorovaikutukset, ja multi-agent-järjestelmät käyttävät noin 15× enemmän tokeneita kuin chatit.”

Ja diagnostinen lisäys:

“Pelkkä tokenien kulutus selittää 80 % vaihtelusta BrowseComp-suorituskyvyssä.”

Vuoden 2026 akateeminen kirjallisuus työntää samaa johtopäätöstä vielä kovempaa. Tran & Kiela (arXiv 2604.02460 , huhtikuu 2026, Stanford / Contextual AI) testasivat Qwen3:a, DeepSeek-R1-Distill-Llamaa ja Gemini 2.5:ta ja raportoivat: “kiinteällä reasoning-token-budjetilla ja täydellisellä kontekstin hyödyntämisellä single-agent-järjestelmät ovat informatiivisesti tehokkaampia… single-agent-järjestelmät yltävät johdonmukaisesti multi-agent-järjestelmien tasolle tai voittavat ne multi-hop reasoning -tehtävissä, kun reasoning-tokenien määrä pidetään vakiona.” Teoreettinen alaraja on data-processing-epäyhtälö: tiedon välittäminen useamman agentin läpi voi vain hävittää, ei koskaan lisätä.

Xu et al.:n OneFlow -artikkeli (tammikuu 2026) päätyy samaan johtopäätökseen seitsemän benchmarkin yli, ja KV-cachen uudelleenkäyttö nostetaan tehokkuusedun lähteeksi.

Tämä ei tarkoita, että multi-agent on aina väärin. Se tarkoittaa, että todistustaakka on multi-agentilla, ei yksinkertaisemmalla suunnittelulla.

Vuoden 2026 todisteet konvergoituvat kapeaan tapausjoukkoon.

Paralleelisoitava lukupainotteinen työ. Anthropicin 2025 -järjestelmä fan-outaa subagentit itsenäisille tutkimusosakyselyille. AORCHESTRA (arXiv 2602.03786

, helmikuu 2026) mallintaa jokaisen subagentin 4-tuplena (INSTRUCTION, CONTEXT, TOOLS, MODEL), jonka orchestrator luo tarpeen mukaan, ja raportoi +16,28 % suhteellisen parannuksen vahvinta baselinea vastaan GAIA-, SWE-Bench- ja Terminal-Bench-testeissä Gemini-3-Flashilla. AdaptOrch (2602.16873

) raportoi +12–23 % staattisiin yhden topologian baselineihin verrattuna käyttäen identtisiä taustamallit — voitto tulee topologian reitityksestä, ei peer collaborationista.

Kapean toimialan luotettavuus. Drammehin incident-response-artikkeli (2511.15755 v2 , tammikuu 2026) ajoi 348 kontrolloitua koetta ja raportoi 100 % toimintakelpoisten suositusten osuuden vs. 1,7 % single-agentilla, 80× toimintaspesifisyyden ja 140× ratkaisutarkkuuden, sekä “nollavaihtelun laadussa kaikkien kokeiden välillä.” Toimiala on kapea ja työ paralleelinen; orchestrator-malli voittaa selkeästi.

Erilliset työkalu- tai konteksti-toimialat, joissa handoff toimii turvarajana — esimerkiksi billing-agentti, jonka ei aidosti pitäisi nähdä engineering-työkaluja.

Sekventiaaliselle tehtävien suoritukselle, jaettua tilaa koskeville agenteille tai mille tahansa, joka näyttää siltä kuin “tee nämä vaiheet järjestyksessä harkinnan kanssa” — nämä ehdot eivät päde. Kirjallisuus suosittelee yksittäistä agenttia, jolla on kurinalainen kontekstinhallinta.

Kun olet päättänyt, että multi-agent on oikea valinta, prompt-rakenne on standardisoidumpi kuin suurin osa markkinointimateriaalista antaa ymmärtää. Jokainen tutkittu suuri toteutus — Claude Code, Anthropic Research, OpenAI Agents SDK, CrewAI, AutoGen, LangGraph, AOrchestra — käyttää samaa mallia, jota prompt-rakentamisen kirjallisuudessa kutsutaan nimellä P2: omistettu järjestelmäprompt subagentille plus strukturoitu task brief, joka toimitetaan ensimmäisenä käyttäjäviestinä.

Anthropicin 2025 -artikkeli on selkein siitä, mitä briefiin kuuluu:

“Jokainen subagentti tarvitsee tavoitteen, output-formaatin, ohjeet käytettävistä työkaluista ja lähteistä sekä selkeät tehtävän rajat.”

He ovat myös avoimia siitä, miltä epäonnistuminen näyttää, jos tämä jätetään tekemättä:

“Aloitimme antamalla lead-agentin antaa yksinkertaisia, lyhyitä ohjeita kuten ’tutki puolijohdepula’, mutta huomasimme, että nämä ohjeet olivat usein riittävän epämääräisiä, että subagentit tulkitsivat tehtävän väärin tai suorittivat täsmälleen samat haut.”

Konsensuksesta nousee kolme sääntöä:

Neljäs sääntö, joka usein unohtuu: välitä työntekijän tuloste suoraan käyttäjälle, kun supervisorin ainoa jäljellä oleva tehtävä on toimittaa se. LangChainin 2025 benchmark mittasi noin 50 % swarm-vs-supervisor-suorituskyvyn parannuksesta tulevan tästä yhdestä muutoksesta. Round-trip “supervisor lukee työntekijän tulosteen, parafrasoi käyttäjälle, parafrasoi käyttäjän vastauksen seuraavalle työntekijälle” on puhdasta hukkaa.

Nämä ilmenevät tuotantoretrospektiiveissä, LangChainin benchmarkissa ja Cogentin Multi-Agent Orchestration Failure Playbook for 2026 -dokumentissa. Ne ovat syy, miksi ala siirtyi.

| Epäonnistumismoodi | Miltä se näyttää |

|---|---|

| Koko transkription uudelleentoisto jokaisella heräämisellä | Jokainen agentti syö koko keskustelun uudelleen jokaisella vuorolla. Lineaarinen vuoroissa × agenteissa. |

| Järjestelmäpromptin paisuminen koordinaatioprotokollasta | Jokainen agentti kuljettaa protokollan kuvauksen, roolilistan ja signaalisanaston jokaisella kutsulla. |

| Supervisorin “käännös”-round-trip | Supervisor lukee työntekijän tulosteen, parafrasoi käyttäjälle, parafrasoi käyttäjän vastauksen seuraavalle työntekijälle. ~50 % vältettävissä olevasta kustannuksesta. |

| Ristiriitaiset implisiittiset oletukset | Paralleelisesti toimivat työntekijät tekevät hienovaraisia esteettisiä tai arkkitehtonisia päätöksiä, jotka eivät sovi yhteen. Cognitionin 2025 keskeinen väite. |

| Koordinaatioreunojen räjähdys | n agenttia kommunikoi O(n²) reunan yli. 5. agentin lisääminen kaksinkertaistaa viestigraafin. |

| HITL/keskeytys-ylikuorma | Pysäytys ja jatkaminen laskuttaa koko keskeytystä edeltävän transkription uudelleen. |

| Ennenaikainen konsensus / “herding” | Peer-agentit konvergoituvat itsevarmaan-mutta-väärään vastaukseen, koska kunkin agentin varmuus nostaa muiden varmuutta. Uusi vuoden 2026 löydös (Tian et al., 2025; vahvistettu 2026). |

Hyödyllinen diagnoosi: jos pystyt nimeämään kolme seitsemästä omassa käyttöönotossasi, maksat multi-agent-veroa arkkitehtuurista, jota kirjallisuus ei suosittele. Korjaus on harvoin “revi agenttitiimi pois” — se on historian tiivistäminen, staattisen prompt-prefiksin välimuistitus, yhteenvetojen palauttaminen transkriptioiden sijaan ja työntekijän tulosteen välittäminen suoraan käyttäjälle.

Vuoden 2026 aidosti uusi kehitys on infrastruktuuritason koordinaatioprimitiivit, ei framework-mallit.

Agent2Agent (A2A) -protokolla liittyi MCP:n rinnalle Linux Foundation AI & Agents Foundationin (AAIF) alle joulukuussa 2025, perustajatuella OpenAI:lta, Anthropicilta, Googlelta, Microsoftilta, AWS:ltä ja Blockilta. A2A kohdistuu eksplisiittisesti “agenttien väliseen kommunikaatioon, tehtävien delegointiin ja kollaboratiiviseen orkestrointiin hajautetuissa multi-agent-työnkuluissa.” Helmikuuhun 2026 mennessä MCP oli ylittänyt noin 97 miljoonaa kuukausittaista SDK-latausta.

Kaksi tutkimusvaiheen primitiiviä on seurannan arvoisia. KVCOMM (NeurIPS 2025) demonstroi yli 70 % KV-cachen uudelleenkäyttöä ja ~7,8× nopeutuksen viiden agentin asetelmassa jakamalla KV-tilaa tokenien sijaan. Phase-Scheduled Multi-Agent Systems (PSMAS, helmikuu 2026) raportoi 34,8 % tokenivähennyksen käsittelemällä agentin aktivointia jatkuvana ohjauksena jaetun huomion yli sen sijaan, että se olisi diskreetti RPC.

Nämä primitiivit kiertävät orchestrator-vs-peer-dikotomian muuttamalla sitä, mitä “konteksti” edes tarkoittaa agenttien välillä. Ne eivät ole vielä tuotantovalmiita rakennuspalikoita, mutta ne ovat oikea asia seurata — ja ne vahvistavat yleisen suunnan: kustannuksia vähennetään älykkäämmällä koordinoinnilla infrastruktuurikerroksessa, ei monimutkaisemmilla peer-suunnitelmilla framework-kerroksessa.

Sinun ei tarvitse olla ohjelmistoinsinööri rakentaaksesi orchestrator + subagent -mallin. FlowHuntin visuaalinen rakentaja kartoittuu siististi subagentin sopimukseen: orchestrator-solmu omistaa keskustelun, työntekijäsolmut ajavat omilla järjestelmäpromptillaan, ja yhteydet kuljettavat strukturoidun briefin ulos ja yhteenvedon takaisin.

Alla on 45 minuutin läpikäynti content research -putkesta käyttäen konsensusmallia.

Kirjaudu FlowHuntiin ja klikkaa Create New Workflow. Nimeä se Content Research Pipeline. Aseta trigger arvoon Manual. Työnkulussa on kolme roolia: orchestrator, joka omistaa käyttäjän pyynnön, research-subagentti (paralleelisoitava luku) ja fact-check-subagentti (paralleelisoitava luku). Molemmat subagentit palauttavat yhteenvetoja.

Lisää Google Search -solmu. Konfiguroi se ottamaan aihe inputiksi, palauttamaan top 5 -tulokset, sulkemaan pois mainokset ja tuottamaan URL, otsikko, snippet ja päivämäärä.

Lisää OpenAI-solmu downstreamiin. Tämä on subagentin “järjestelmäpromptin” paikka. Anna sille omistettu, fokusoitunut prompt:

Olet research-subagentti. Annetuista hakutuloksista

poimi tosiasialliset väitteet lähde-URL:eilla ja julkaisupäivämäärillä.

Tuota JSON-lista objekteista {claim, url, date}.

Rajat: älä syntetisoi, älä tiivistä, älä kommentoi.

Tämä on P2-malli: omistettu subagentti-prompt, kapeasti rajattu. Yhdistä Google Search → OpenAI Extraction.

Lisää Text Synthesis -solmu. Sen tehtävä on järjestää research-subagentin tuloste strukturoiduksi ääriviivaksi — yksi osio per teema, jokainen lähteiden väitteiden tukema.

Lisää OpenAI-solmu artikkelin draftaamiseen. Anna sille fokusoitunut prompt: ääriviiva sisään, draft ulos. Yhdistä Synthesis → OpenAI Generation.

Lisää AI Agent -solmu, joka on konfiguroitu fact-checkeriksi. Strukturoitu brief näyttää Anthropicin reseptiltä — tavoite, formaatti, työkalut, rajat:

Tavoite: validoi jokainen tosiasiallinen väite draft-artikkelissa.

Output-formaatti: kommentoitu draft verifiointistatuksella per väite

(verified | unverified | contradicted) ja luottamuspisteytyksellä 0–1.

Työkalut: knowledge base lookup, web search.

Rajat: älä kirjoita artikkelia uudelleen. Merkitse, älä korjaa.

Lisää Markdown-formatter lopulliseksi tulostussolmuksi. Yhdistä Fact-Checker → Markdown.

Research subagent → Synthesis → Fact-Check subagent → Output. Jokainen yhteys kuljettaa edellisen vaiheen tulosteen seuraavan vaiheen strukturoituna briefinä.

Tämä on sekventiaalinen eikä fan-out, mikä on tässä asianmukaista — synteesi tarvitsee tutkimustulosteen, ja fact-check tarvitsee synteesin. Jos haluaisit skaalata kymmeneen paralleeliseen tutkimusalakyselyyn, korvaisit yksittäisen tutkimussolmun fan-outilla: orchestrator luo N subagenttia paralleelisesti, kukin ottaa yhden alakyselyn strukturoidusta briefistä, kukin palauttaa oman yhteenvetonsa, ja orchestrator yhdistää ne ennen synteesiin siirtämistä.

Klikkaa Run Workflow. Anna aihe kuten “Mitä on kvanttilaskenta?”. Odota ~45–60 sekuntia päästä päähän. Seuraa solmukohtaisia tulosteita FlowHuntin UI:ssa nähdäksesi, mitä kukin subagentti sai briefinään ja mitä se palautti.

Kun olet vahvistanut, ota käyttöön webhookiin, aikatauluun tai manuaaliseen triggeriin. Konfiguroi tulostuksen kohde (sähköposti, Slack, Google Drive, tietokanta). Ota käyttöön rooliperusteinen lokitus — Anthropicin “80 % vaihtelusta on tokenien kulutusta” -löydös tekee rooliperusteisesta token-telemetriasta minkä tahansa hienosäädön edellytyksen.

Lyhyt lista asioista, joita vuosien 2025–2026 kirjallisuus eksplisiittisesti suosittelee välttämään:

Nämä ovat käyttötapauksia, joissa orchestrator + subagent -malli ansaitsee preemionsa.

Research-subagentti kysyy API:ita, akateemisia tietokantoja ja sisäisiä dokumentteja ja palauttaa strukturoidun yhteenvedon lähteistä. Synteesivaihe järjestää löydökset ääriviivaksi. Fact-check-subagentti validoi väitteet luottamuspisteytyksellä. Tuotantotiimit raportoivat ~70 % vähennyksen fact-checkingiin käytetyssä ajassa ja 40 % nousun sisällön tuotannossa — luvut ovat yhdenmukaisia paralleelisoitavan luvun sweet spotin kanssa.

Data-enrichment-subagentti vetää profiilidataa CRM:stä, Clearbitistä/Apollosta, LinkedInistä ja verkkosivukäyttäytymisestä — aidosti paralleeleja lukuja itsenäisistä lähteistä. Scoring-subagentti vertaa ICP:hen ja antaa pisteytyksen. Routing-subagentti ohjaa korkeasti pisteytetyt liidit oikealle myyjälle alueen ja kuormituksen mukaan. Raportoitu: 35 % nousu konversioasteessa, 50 % vähennys liidien käsittelyajassa.

First-line-subagentti poimii tikettityypin ja tunnesävyn ja yrittää knowledge base -ratkaisua. Eskalaatio-subagentti arvioi lopputuloksen ja reitittää oikealle erikoisasiantuntijalle. Handoff-subagentti paketoi kontekstin ihmistä varten. Orchestrator-malli palvelee tässä erillisten toimialojen kriteeriä: billing, tech support ja valitukset käyttävät eri työkaluja ja eri datapääsyä.

Paralleeliset collection-subagentit — uutiskaapija, talousagentti, social-sentiment-agentti, kilpailijasivustojen monitori — ajavat aitoa fan-outia. Analyysi-subagentti vastaanottaa neljä yhteenvetoa ja tunnistaa trendejä. Report-subagentti draftaa johtotason tiivistelmän. Tämä on lähin analogia Anthropicin 2025 research multi-agent systemille ja AORCHESTRA:n 2026 lukujen vahvimmin tukema käyttötapaus.

AI:n tulevaisuus ei ole yksi superälykäs malli, eikä se ole peer collaboration -parvi. Se on yksi koordinaattori, joka omistaa kontekstin, ja pieni joukko kurinalaisia, eristettyjä työntekijöitä, jotka palauttavat yhteenvetoja. Tämä on malli, jota tutkimus tukee, ja tämä on malli, jonka FlowHunt on rakennettu tekemään helpoksi.

{{ cta-dark-panel heading=“Rakenna ensimmäinen Multi-Agent AI -järjestelmäsi tänään” description=“FlowHuntin no-code-työnkulkurakentaja tekee orchestrator + subagent -mallin luomisesta, testaamisesta ja käyttöönotosta helppoa. Aloita ilmaisella tilillä ja rakenna ensimmäinen 3-agentin putkesi alle tunnissa.” ctaPrimaryText=“Kokeile FlowHuntia ilmaiseksi” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Varaa demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#3b82f6” gradientEndColor="#8b5cf6” gradientId=“multi-agent-cta” }}

Yasha on lahjakas ohjelmistokehittäjä, joka on erikoistunut Pythoniin, Javaan ja koneoppimiseen. Yasha kirjoittaa teknisiä artikkeleita tekoälystä, prompt engineeringistä ja chatbot-kehityksestä.

FlowHuntin no-code-työnkulkurakentaja tekee useiden AI-agenttien luomisesta ja orkestroinnista helppoa. Aloita monimutkaisten tehtävien automatisointi minuuteissa — koodausta ei tarvita.

Tutustu vuoden 2026 parhaisiin AI-agenttien rakennusalustoihin, aina koodittomista ratkaisuista yritystason kehyksiin. Selvitä, mitkä työkalut sopivat parhaiten...

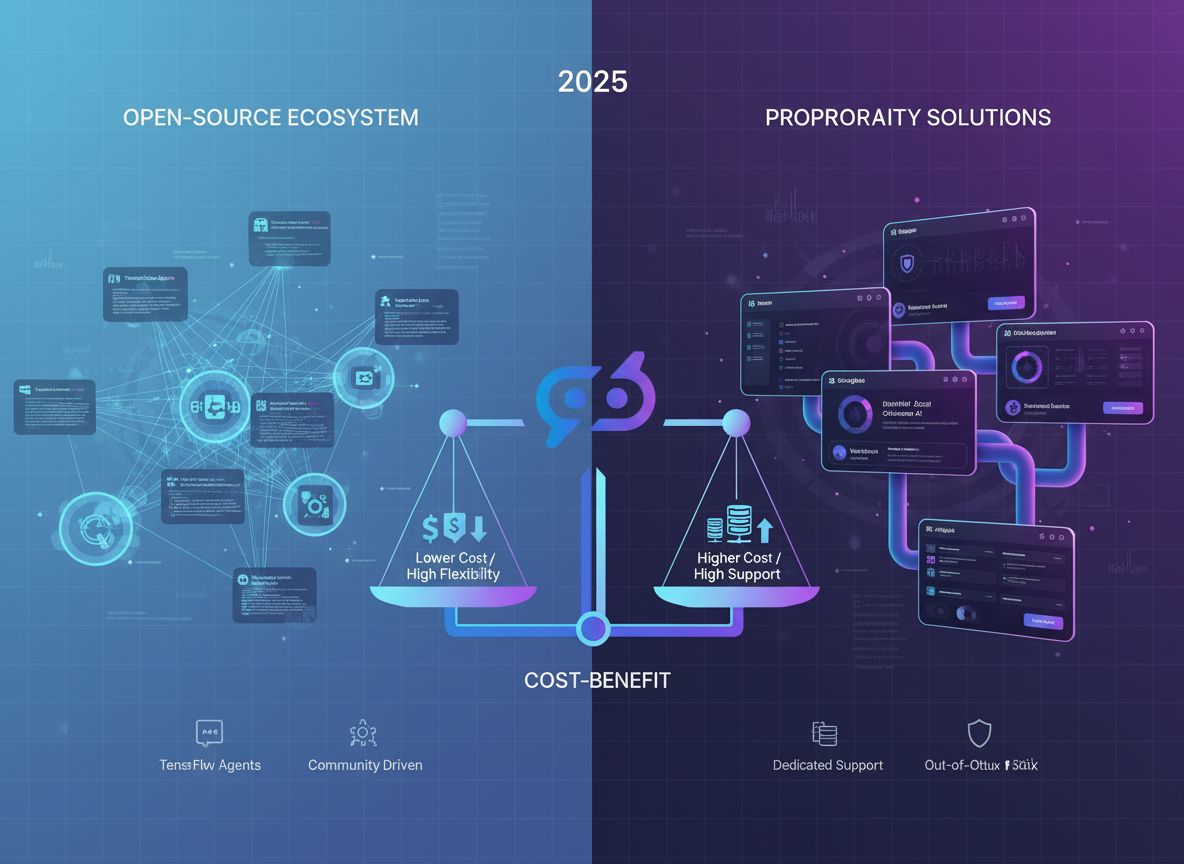

Kattava analyysi avoimen lähdekoodin ja suljetuista AI-agenttialustoista vuonna 2025 – tarkastelussa kustannukset, joustavuus, suorituskyky ja ROI, jotta organi...

Tutustu Crew.ai- ja Langchain-multi-agenttikehyksiin. Crew.ai loistaa yhteistyössä ja tehtävien jaossa, mikä tekee siitä ihanteellisen monimutkaisiin simulaatio...