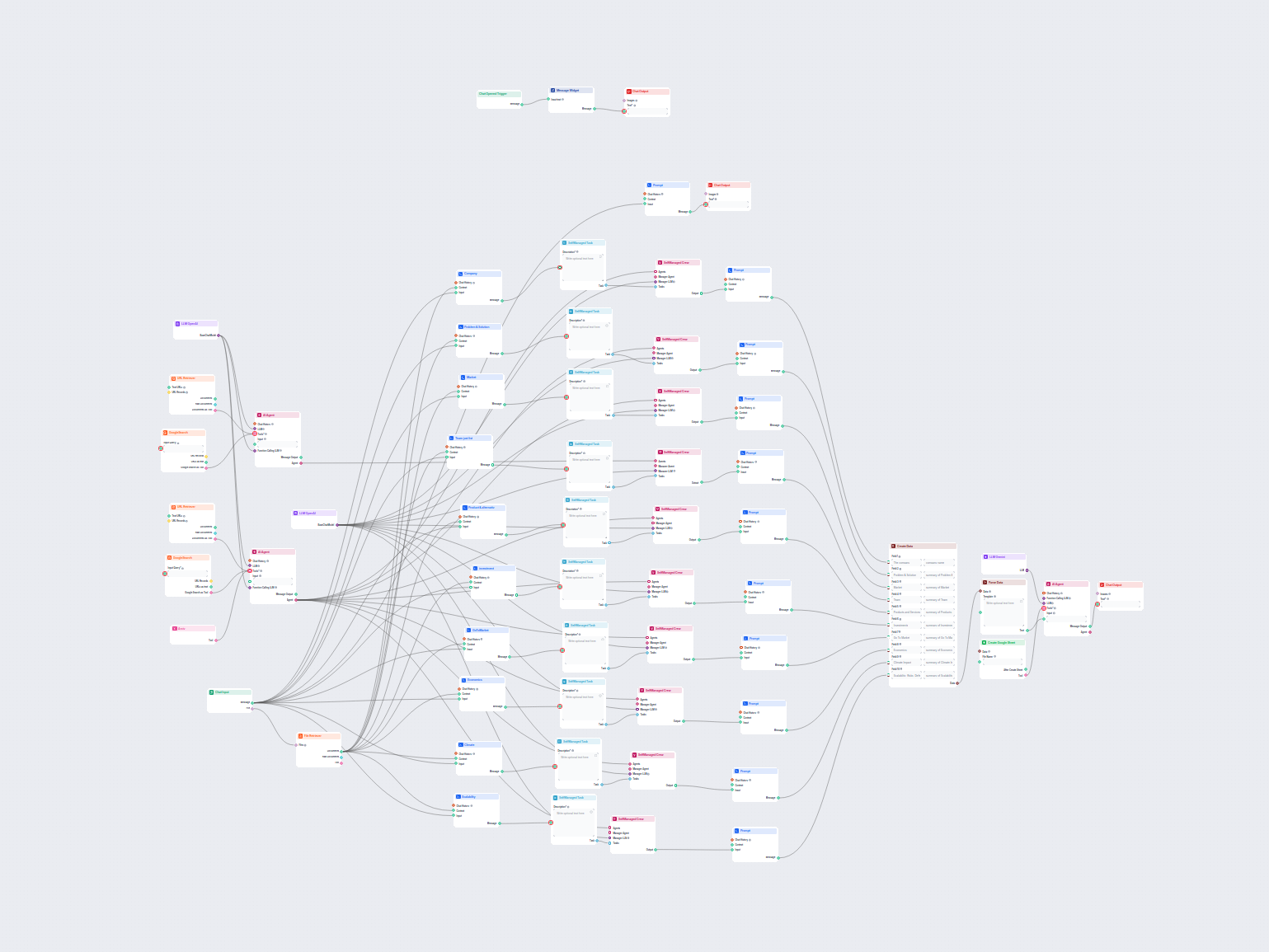

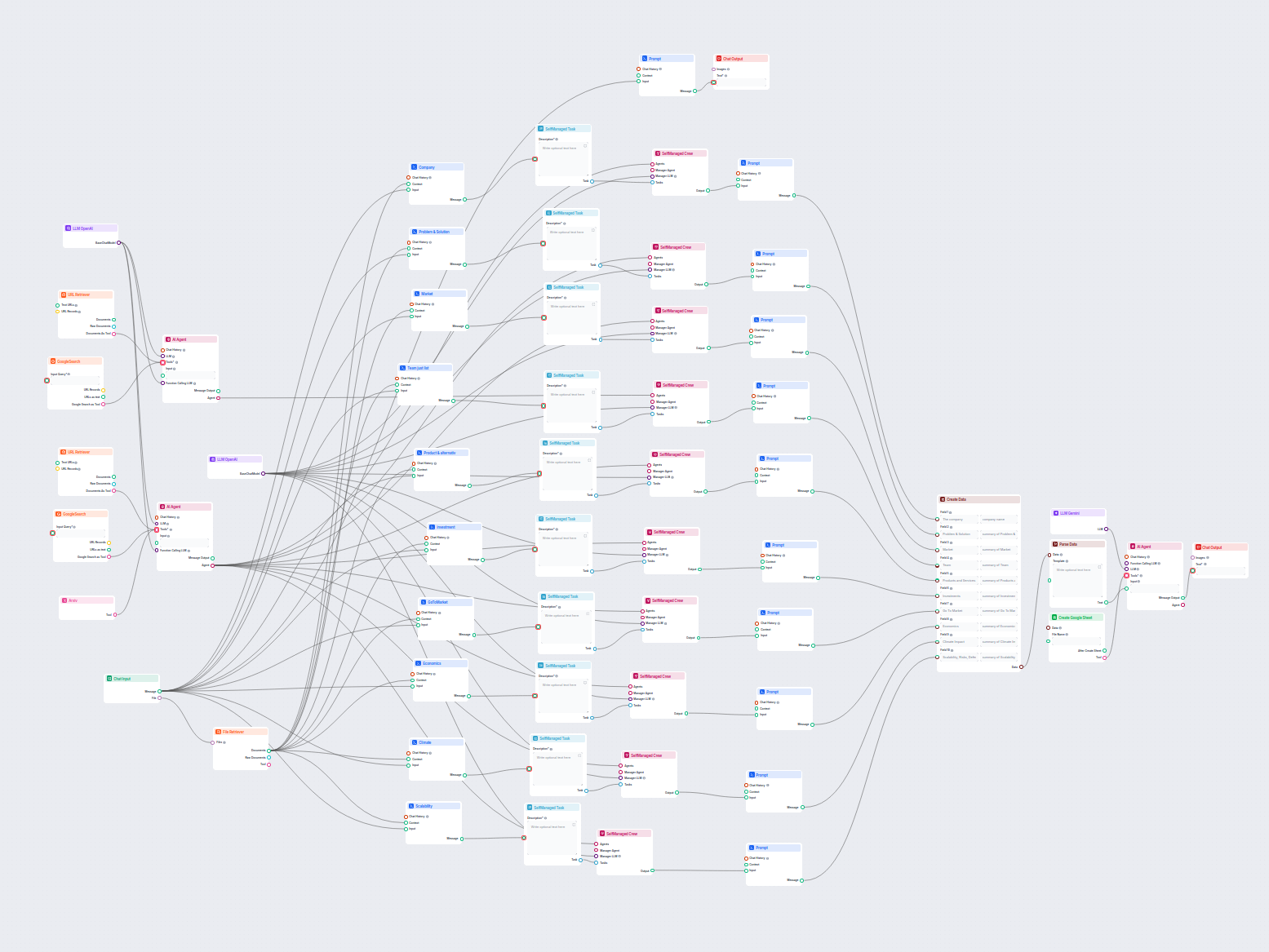

AI-yritysanalyysi Google Sheetsiin

Tämä tekoälyllä toimiva työnkulku tuottaa kattavan, dataan perustuvan yritysanalyysin. Se kerää tietoa yrityksen taustasta, markkinatilanteesta, tiimistä, tuott...

Hyödynnä Googlen Gemini-mallien voima FlowHuntissa – vaihda tekoälymalleja, säädä asetuksia ja rakenna älykkäämpiä tekoälychatbotteja helposti.

Komponentin kuvaus

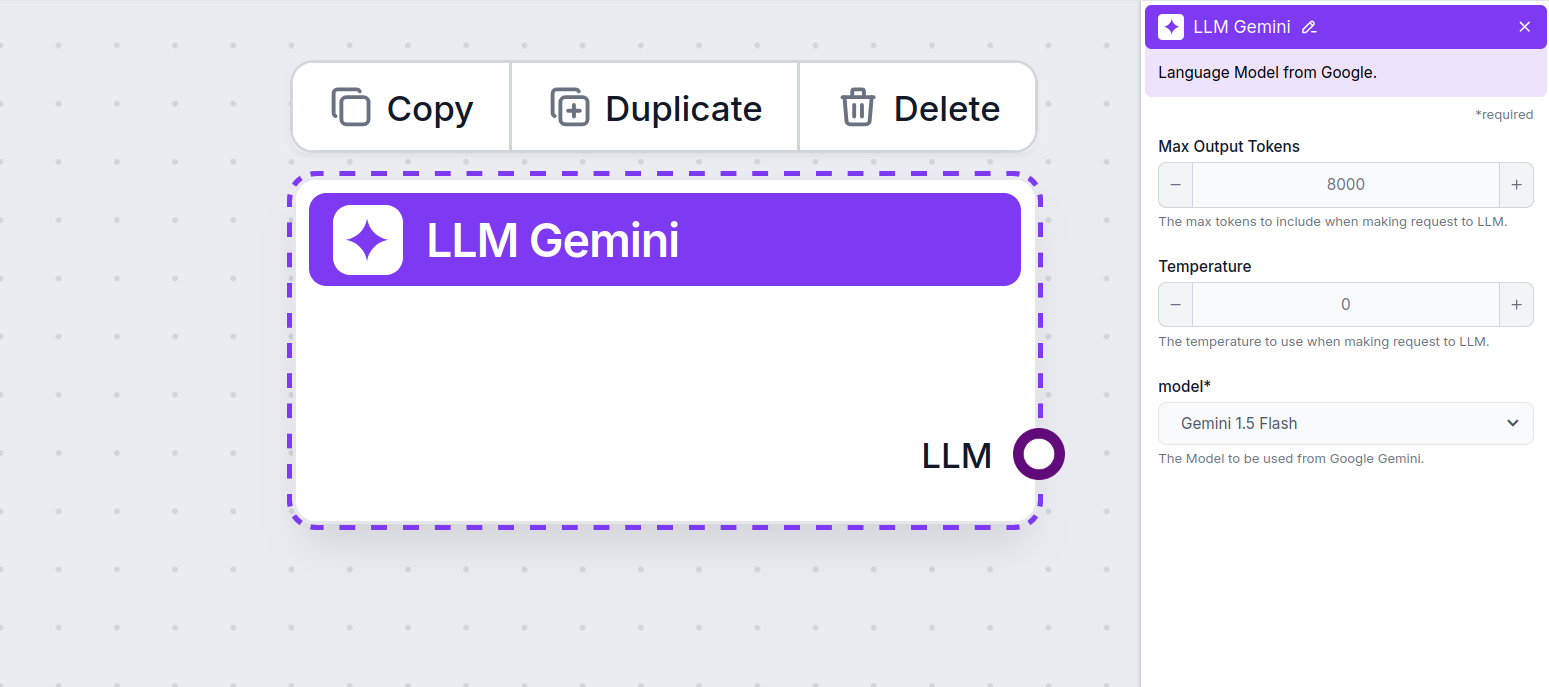

LLM Gemini -komponentti yhdistää Googlen Gemini-mallit omaan virtaasi. Vaikka varsinaiset Generaattorit ja Agentit tekevät varsinaisen työn, LLM-komponenttien avulla voit hallita käytettävää mallia. Kaikissa komponenteissa on oletuksena ChatGPT-4. Voit liittää tämän komponentin, jos haluat vaihtaa mallia tai saada siihen lisää säätömahdollisuuksia.

Muista, että LLM-komponentin liittäminen on valinnaista. Kaikissa komponenteissa, jotka käyttävät LLM:ää, on oletuksena ChatGPT-4o. LLM-komponentit mahdollistavat mallin vaihtamisen ja malliasetusten hallinnan.

Tokenit edustavat yksittäisiä tekstin osia, joita malli käsittelee ja tuottaa. Tokenin koko vaihtelee mallista riippuen; yksi token voi olla sana, sanan osa tai yksittäinen merkki. Mallien hinnoittelu perustuu usein miljooniin tokeneihin.

Max tokens -asetus rajoittaa kerralla käsiteltävien tokenien kokonaismäärää, mikä varmistaa, että vastausten pituus pysyy järkevissä rajoissa. Oletusraja on 4000 tokenia, mikä on ihanteellinen esimerkiksi dokumenttien ja useiden lähteiden tiivistämiseen.

Temperature ohjaa vastausten vaihtelua ja luovuutta, arvo 0–1.

0,1:n temperature tekee vastauksista hyvin täsmällisiä, mutta mahdollisesti toistavia ja köyhiä.

Korkea temperature, 1, sallii maksimaalisen luovuuden, mutta samalla kasvaa riski epäolennaisista tai harhaisista vastauksista.

Esimerkiksi asiakaspalvelubotin suositeltu temperature on 0,2–0,5. Tällä alueella vastaukset pysyvät relevantteina ja käsikirjoituksessa, mutta sallivat myös luonnollisen vaihtelun.

Tässä valitset käytettävän mallin. Täältä löydät kaikki tuetut Googlen Gemini-mallit. Tuemme kaikkia uusimpia Gemini-malleja:

Huomaat, että kaikissa LLM-komponenteissa on vain ulostuloliitäntä. Syöte ei kulje komponentin läpi, sillä komponentti edustaa vain mallia – varsinainen generointi tapahtuu tekoälyagenteissa ja generaattoreissa.

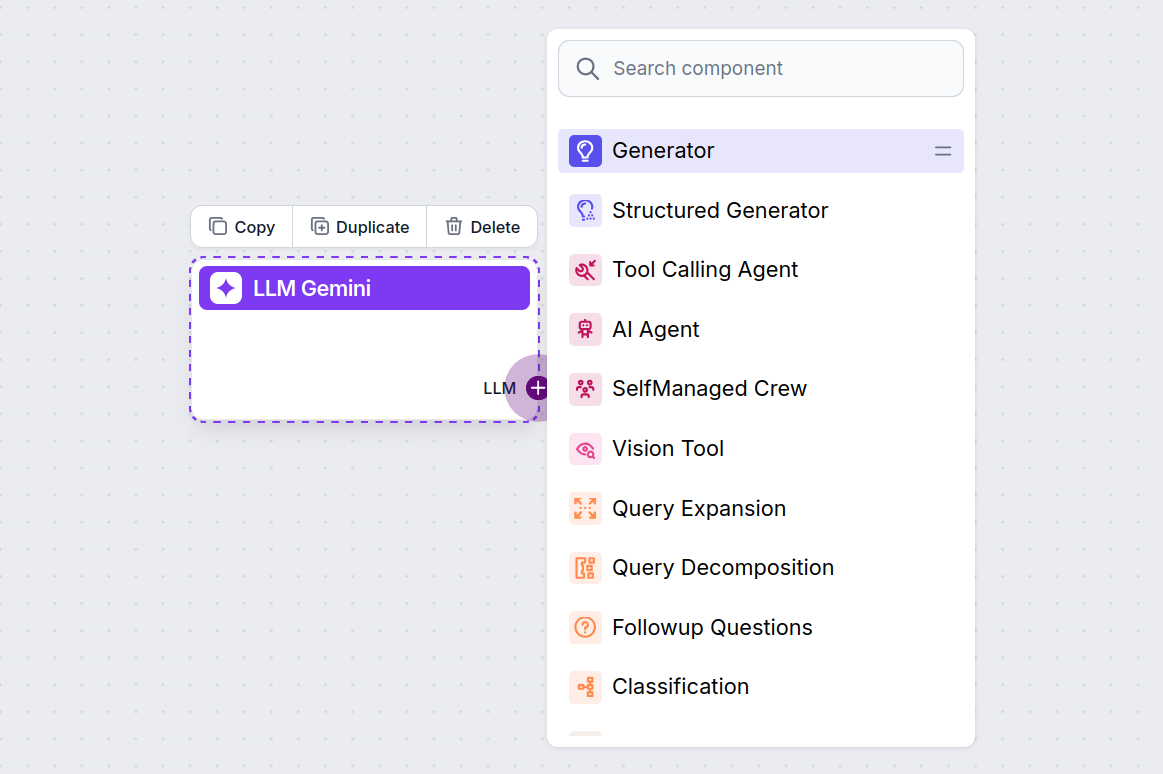

LLM-liitäntä on aina violetti. LLM-syöttöliitäntä löytyy kaikista komponenteista, jotka käyttävät tekoälyä tekstin tuottamiseen tai datan käsittelyyn. Vaihtoehdot näet klikkaamalla liitäntää:

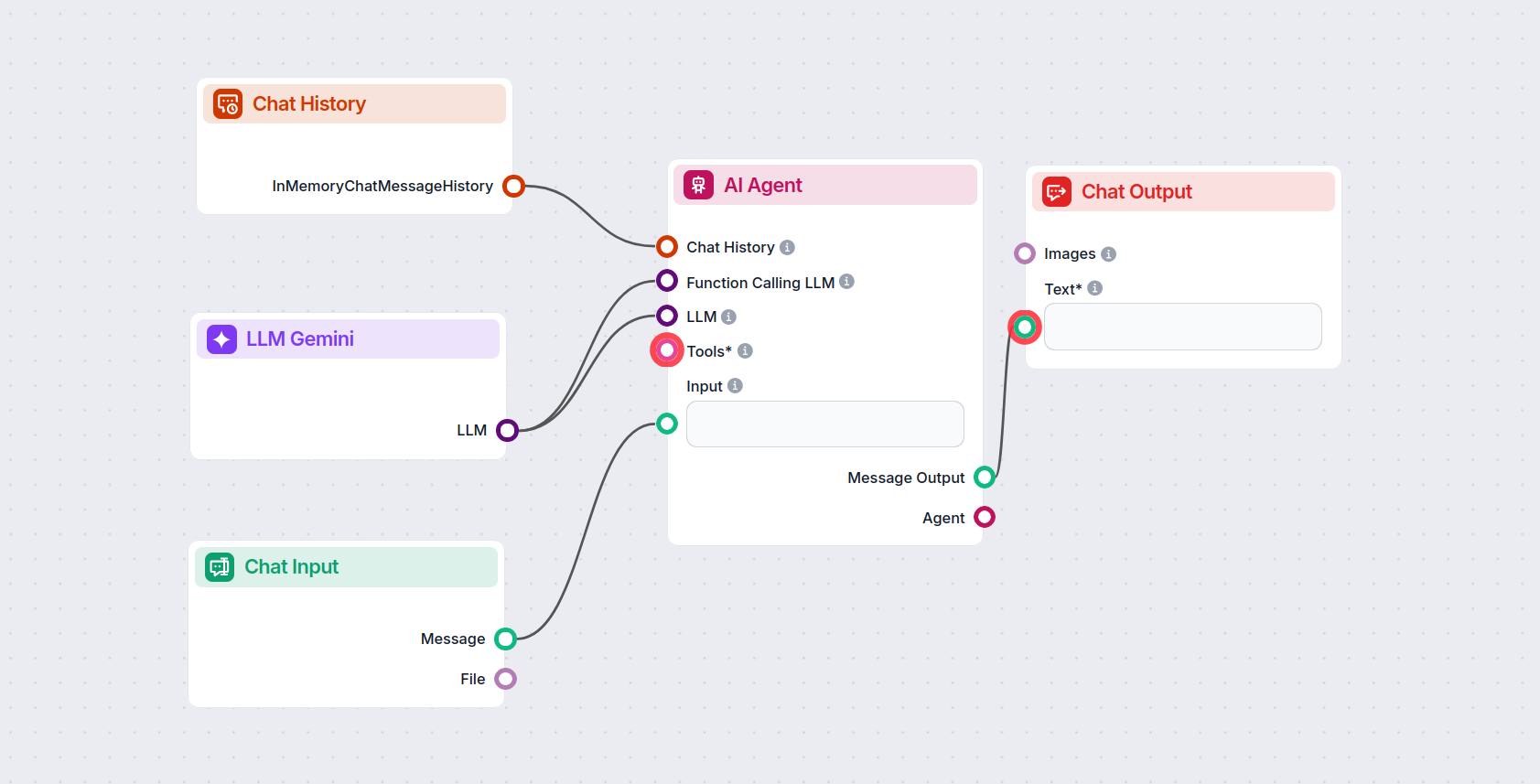

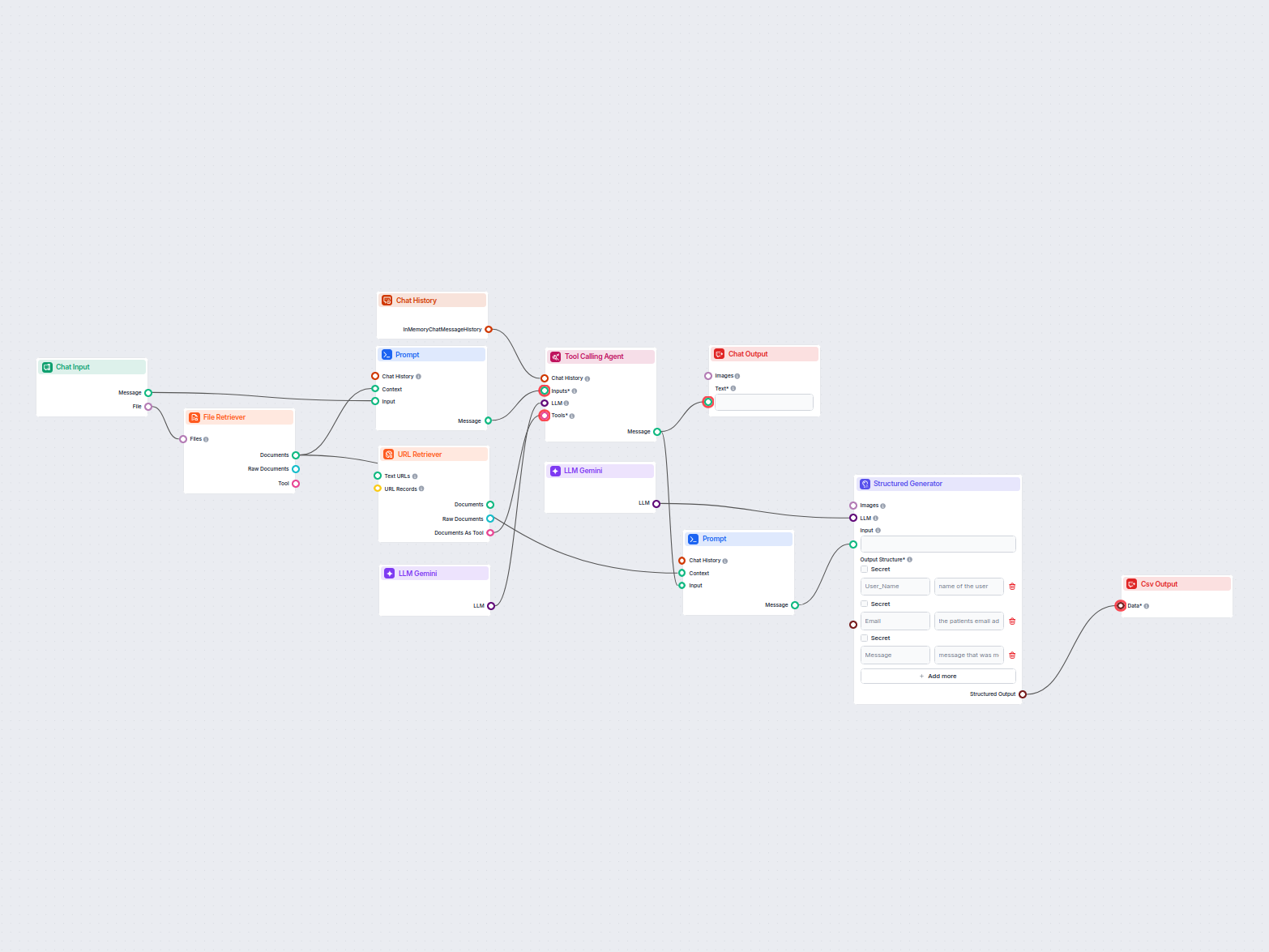

Näin voit rakentaa erilaisia työkaluja. Katsotaanpa komponenttia käytännössä. Tässä on yksinkertainen tekoälyagentti-chatbotin virta, joka käyttää Gemini 2.0 Flash Experimental -mallia vastausten generointiin. Voit ajatella tätä perus Gemini-chatbotina.

Tämä yksinkertainen chatbot-virta sisältää:

Auttaaksemme sinua pääsemään nopeasti alkuun, olemme valmistaneet useita esimerkkiflow-malleja, jotka osoittavat, kuinka käyttää LLM Gemini-komponenttia tehokkaasti. Nämä mallit esittelevät erilaisia käyttötapauksia ja parhaita käytäntöjä, helpottaen sinun ymmärtämistäsi ja komponentin toteuttamista omissa projekteissasi.

Tämä tekoälyllä toimiva työnkulku tuottaa kattavan, dataan perustuvan yritysanalyysin. Se kerää tietoa yrityksen taustasta, markkinatilanteesta, tiimistä, tuott...

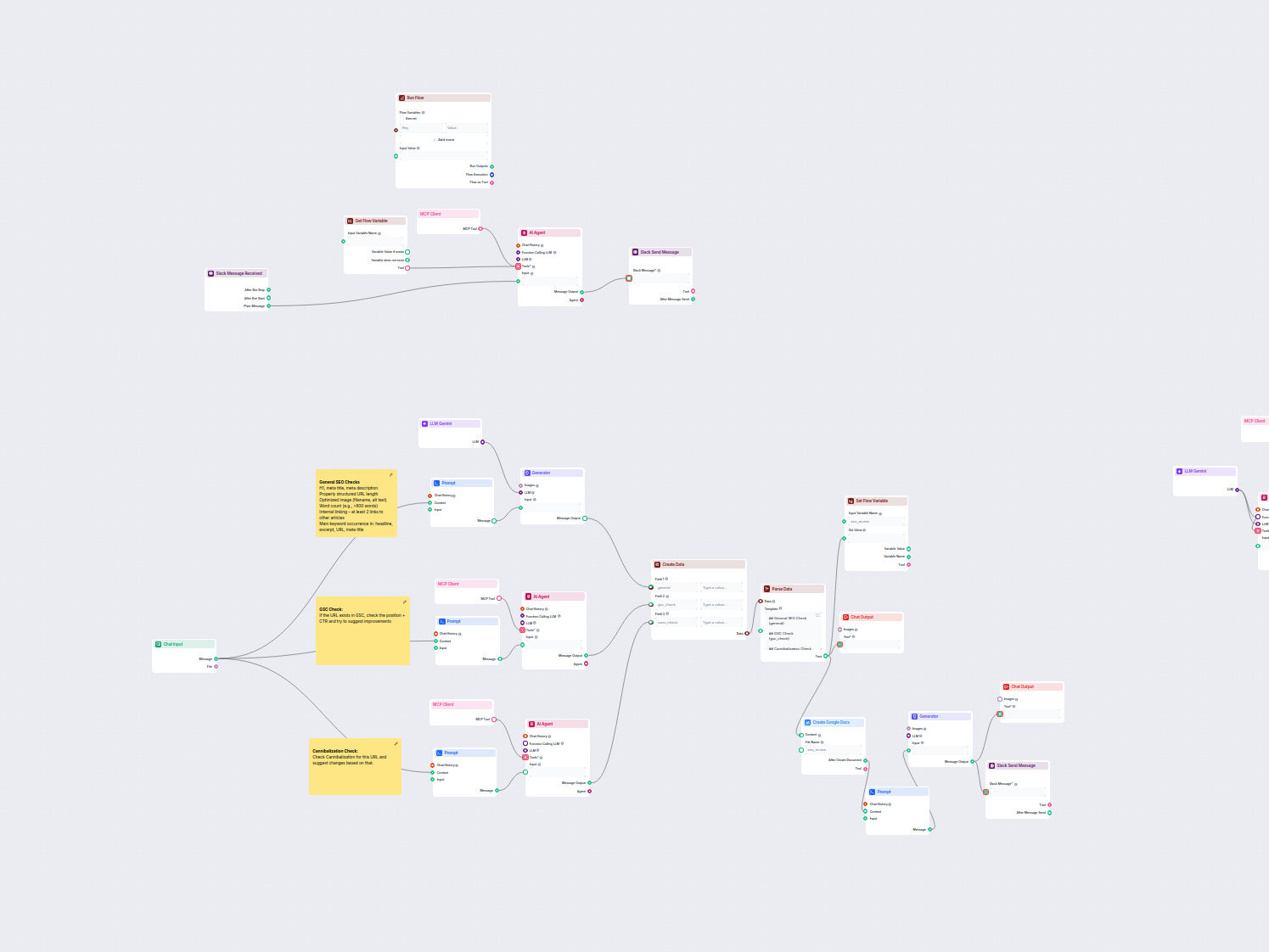

Tämä työnkulku automatisoi verkkosivujen SEO-tarkastuksen ja auditointiprosessin. Se analysoi sivun sisällön hakukoneoptimoinnin parhaiden käytäntöjen mukaisest...

Tämä työnkulku poimii ja järjestää sähköposteista ja liitetiedostoista tärkeimmät tiedot, hyödyntää tekoälyä datan käsittelyyn ja jäsentämiseen sekä tuottaa tul...

Tämä tekoälytyönkulku analysoi minkä tahansa yrityksen perusteellisesti tutkimalla julkisia tietoja ja dokumentteja kattaen markkinat, tiimin, tuotteet, investo...

LLM Gemini yhdistää Googlen Gemini-mallit FlowHuntin tekoälyvirtoihin, jolloin voit valita uusimmista Gemini-versioista tekstin generointiin ja mukauttaa niiden toimintaa.

FlowHunt tukee Gemini 2.0 Flash Experimental, Gemini 1.5 Flash, Gemini 1.5 Flash-8B ja Gemini 1.5 Pro -malleja – jokainen tarjoaa omat ominaisuutensa tekstin, kuvien, äänen ja videon syötteisiin.

Max Tokens rajoittaa vastausten enimmäispituutta, kun taas Temperature määrittää luovuuden – matalammat arvot antavat täsmällisempiä vastauksia, korkeammat lisäävät vaihtelua. Molemmat voidaan asettaa mallikohtaisesti FlowHuntissa.

Ei, LLM-komponenttien käyttö on valinnaista. Kaikki tekoälyvirrat käyttävät oletuksena ChatGPT-4o:ta, mutta lisäämällä LLM Gemini voit vaihtaa Googlen malleihin ja hienosäätää niiden asetuksia.

Aloita kehittyneiden tekoälychatbottien ja -työkalujen rakentaminen Geminillä ja muilla huippumalleilla – kaikki yhdessä hallintapaneelissa. Vaihda malleja, mukauta asetuksia ja tehosta työnkulkuasi.

FlowHunt tukee kymmeniä tekoälymalleja, mukaan lukien mullistavat DeepSeek-mallit. Näin käytät DeepSeekia AI-työkaluissasi ja chatbotissasi.

FlowHunt tukee kymmeniä tekoälytekstimalleja, mukaan lukien Mistralin mallit. Näin voit käyttää Mistralia tekoälytyökaluissasi ja chatboteissasi.

FlowHunt tukee kymmeniä tekstinluontimalleja, mukaan lukien xAI:n mallit. Näin voit käyttää xAI-malleja AI-työkaluissasi ja chatboteissasi.