Bidirektionaalinen LSTM

Bidirektionaalinen pitkän aikavälin muisti (BiLSTM) on edistynyt toistuvien neuroverkkojen (RNN) arkkitehtuuri, joka käsittelee sekventiaalista dataa sekä eteen...

LSTM-verkot ovat kehittyneitä RNN-arkkitehtuureja, jotka ratkaisevat katoavan gradientin ongelman ja mahdollistavat tehokkaan oppimisen pitkän aikavälin riippuvuuksista jaksollisessa datassa.

Pitkän aikavälin muisti (LSTM) on toistuvien neuroverkkojen (RNN) erityisluokka, joka on taitava oppimaan pitkän aikavälin riippuvuuksia jaksollisessa datassa. Alun perin Hochreiterin ja Schmidhuberin kehittämä vuonna 1997, LSTM-verkot suunniteltiin ratkaisemaan perinteisten RNN:ien rajoituksia, erityisesti katoavan gradientin ongelmaa. Tämä ongelma estää usein RNN:iä oppimasta tehokkaasti pitkän aikavälin riippuvuuksia, sillä gradientit heikkenevät eksponentiaalisesti. LSTM:t käyttävät hienostunutta arkkitehtuuria, jossa on muistiyksiköitä ja porttimekanismeja, joiden avulla ne pystyvät säilyttämään ja hyödyntämään tietoa pitkien aikavälien yli. Tämä tekee niistä erityisen sopivia tehtäviin, joissa konteksti on ratkaisevaa, kuten kieltenkäännöksessä ja aikasarjojen ennustamisessa.

Muistiyksikkö on LSTM-yksikön kulmakivi, ja se toimii dynaamisena tietovarastona ajan yli. Jokainen LSTM-solmu sisältää tilan, jota kutsutaan solutilaksi, ja se toimii kanavana, jonka kautta tieto virtaa. Tiedon kulkua säätelee tarkasti kolme porttia: syöte-, unohtamis- ja ulostuloportti. Nämä portit varmistavat, että solutilaan jää olennainen tieto ja tarpeeton tieto poistetaan.

Jokaisen portin toiminta on ratkaisevaa LSTM:n kyvylle torjua katoavan gradientin ongelmaa, sillä ne yhdessä hallitsevat tiedon kulkua ja säilyttämistä, varmistaen pitkän aikavälin riippuvuuksien säilymisen.

LSTM-verkkojen arkkitehtuuri koostuu sarjasta LSTM-solmuja, jotka on kytketty toisiinsa ketjumaisesti, mikä mahdollistaa koko jaksollisen datan käsittelyn yksittäisten datapisteiden sijaan. Tämä ketjurakenne on keskeinen sekä lyhyen että pitkän aikavälin riippuvuuksien havaitsemisessa datassa. Toisin kuin perinteiset RNN:t, LSTM:t sisältävät takaisinkytkentöjä, joiden ansiosta ne pystyvät käsittelemään jaksollista dataa tehokkaasti. Arkkitehtuuriin kuuluu muistiyksiköiden käyttö, joita portit säätelevät mahdollistaen tiedon valikoivan säilyttämisen ja poistamisen, mikä parantaa verkon kykyä oppia ajallisista jaksoista.

LSTM:t käyvät läpi syöte-, unohtamis- ja ulostuloportit jokaisella aikastepillä, jolloin ne voivat tehokkaasti hallita tiedonkulkua verkossa. Prosessi etenee näin:

Tämä porttimekanismi on olennainen LSTM:ille, sillä sen avulla ne pystyvät ratkaisemaan perinteisiä RNN:iä vaivaavan katoavan gradientin ongelman. Hallitsemalla tiedon kulkua ja säilyttämistä LSTM:t pystyvät säilyttämään olennaisen kontekstin pitkillä jaksoilla, mikä tekee niistä erityisen tehokkaita jaksollisen datan tehtävissä.

LSTM:illä on laajat sovellukset useilla alueilla niiden kyvyn ansiosta käsitellä jaksollista dataa, jossa on pitkän aikavälin riippuvuuksia. Keskeisiä sovelluksia ovat:

Vaikka LSTM:t ovat tehokkaita, ne ovat laskennallisesti raskaita ja vaativat tarkkaa hyperparametrien säätöä. Ne voivat ylisovittaa helposti erityisesti pienillä aineistoilla, ja niiden monimutkainen arkkitehtuuri voi olla haastava toteuttaa ja tulkita.

Suorituskyvyn parantamiseksi ja monimutkaisuuden vähentämiseksi on kehitetty useita LSTM-muunnelmia:

Tekoälyn ja automaation alalla LSTM:t ovat keskeisessä asemassa älykkäiden chatbotien ja puheavustajien kehittämisessä. Nämä järjestelmät, joita LSTM:t ohjaavat, kykenevät ymmärtämään ja tuottamaan ihmismäisiä vastauksia, mikä parantaa asiakaskokemusta tarjoamalla sujuvaa ja responsiivista palvelua. LSTM:ien integrointi automaattisiin järjestelmiin mahdollistaa yrityksille entistä tarkemmat ja kontekstuaalisemmat vuorovaikutukset, mikä parantaa käyttäjäkokemusta.

Pitkän aikavälin muisti (LSTM) neuroverkoissa

Pitkän aikavälin muisti (LSTM) -verkot ovat toistuvien neuroverkkojen (RNN) arkkitehtuuri, joka on suunniteltu ratkaisemaan katoavan gradientin ongelmaa, jota esiintyy perinteisiä RNN:iä koulutettaessa. Tämä tekee LSTM:stä erityisen sopivan oppimaan jaksollisista datoista, kuten aikasarjoista tai luonnollisen kielen käsittelyn tehtävistä, joissa pitkän aikavälin riippuvuudet ovat ratkaisevia.

Weizhi Wangin ym. artikkeli “Augmenting Language Models with Long-Term Memory” esittelee viitekehyksen, jossa kielimalleja laajennetaan pitkän aikavälin muistilla. Työssä osoitetaan, miten pitkäaikainen muisti voidaan integroida olemassa oleviin malleihin, jolloin ne kykenevät hyödyntämään pidempiä konteksteja – samaan tapaan kuin LSTM:t mahdollistavat pitkän aikavälin riippuvuuksien hallinnan kielitehtävissä. Lue lisää.

Pier Francesco Procaccin ja Tomaso Asten artikkelissa “Portfolio Optimization with Sparse Multivariate Modelling” tutkitaan monimuuttujamallinnusta rahoitusmarkkinoilla ja käsitellään useita virhelähteitä monimutkaisten järjestelmien mallintamisessa. Vaikka artikkeli ei keskity suoraan LSTM:iin, se korostaa epästationaarisuuden hallinnan ja parametrien optimoinnin tärkeyttä, jotka ovat relevantteja myös LSTM-arkkitehtuurien suunnittelussa rahoitusdata-analyysiin. Lue lisää.

Ho Kei Chengin ja Alexander G. Schwingin “XMem: Long-Term Video Object Segmentation with an Atkinson-Shiffrin Memory Model” esittelee video-objektien segmentointiarkkitehtuurin, joka perustuu Atkinson-Shiffrinin muistimalliin ja hyödyntää useita muistivarastoja. Tutkimus liittyy LSTM:iin siinä, että se korostaa tehokkaan muistinhallinnan tärkeyttä pitkissä videojaksoissa, aivan kuten LSTM:t hallitsevat pitkän aikavälin riippuvuuksia jaksodatan käsittelyssä. Lue lisää.

LSTM (Pitkän aikavälin muisti) -verkko on toistuvan neuroverkon (RNN) arkkitehtuuri, joka kykenee oppimaan pitkän aikavälin riippuvuuksia jaksollisessa datassa käyttämällä muistiyksiköitä ja porttimekanismeja hallitakseen tiedon kulkua ja säilyttämistä.

LSTM-verkkoja käytetään laajalti luonnollisen kielen käsittelyssä, puheentunnistuksessa, aikasarjojen ennustamisessa, poikkeavuuksien havaitsemisessa, suosittelujärjestelmissä ja videoanalyysissä niiden kyvyn ansiosta säilyttää konteksti pitkillä jaksolla.

LSTM:t käyttävät muistiyksiköitä sekä kolmenlaisia portteja (syöte-, unohtamis- ja ulostuloportti) säädelläkseen tiedonkulkua, mikä mahdollistaa tiedon säilyttämisen ja hyödyntämisen pitkien aikavälien yli ja vähentää perinteisille RNN:ille ominaista katoavan gradientin ongelmaa.

Yleisiä LSTM-muunnelmia ovat kaksisuuntaiset LSTM:t, portilliset toistoyksiköt (GRU) sekä LSTM:t peephole-yhteyksillä. Näissä arkkitehtuurimuutoksissa pyritään parantamaan suorituskykyä tai tehokkuutta eri tehtävissä.

LSTM:t on suunniteltu jaksolliselle datalle ja ne ovat erinomaisia ajallisten riippuvuuksien oppimisessa, kun taas CNN:t on optimoitu spatiaaliseen dataan, kuten kuviin. Molemmat arkkitehtuurit sopivat parhaiten omiin datamuotoihinsa ja tehtäviinsä.

Hyödynnä pitkän aikavälin muistin (LSTM) verkkojen voimaa parantaaksesi tekoälysovelluksiasi. Tutustu FlowHuntin AI-työkaluihin ja rakenna älykkäitä ratkaisuja jaksollisen datan tehtäviin.

Bidirektionaalinen pitkän aikavälin muisti (BiLSTM) on edistynyt toistuvien neuroverkkojen (RNN) arkkitehtuuri, joka käsittelee sekventiaalista dataa sekä eteen...

Suuri kielimalli (LLM) on tekoäly, jota on koulutettu valtavilla tekstiaineistoilla ymmärtämään, tuottamaan ja käsittelemään ihmiskieltä. LLM:t hyödyntävät syvä...

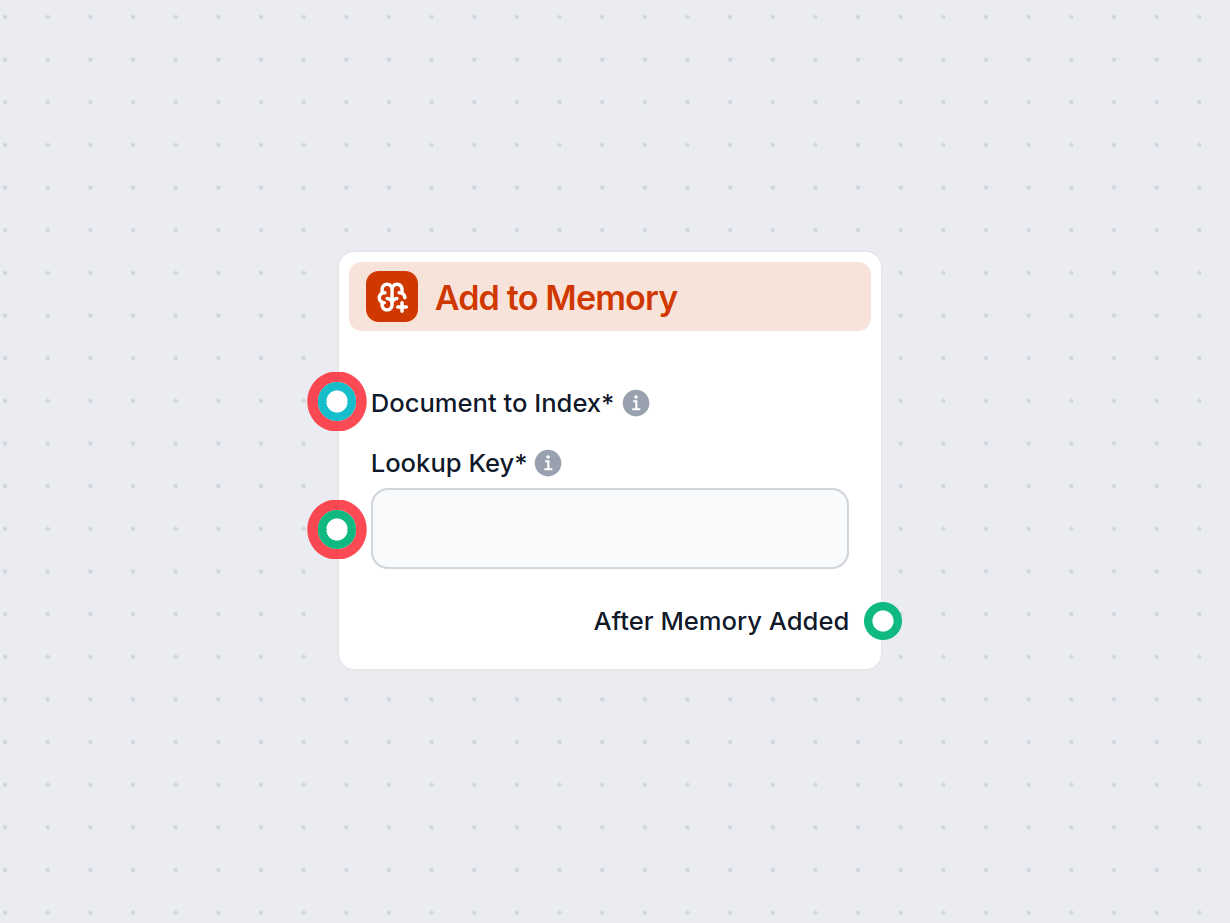

Tallenna helposti tärkeää tietoa työnkulkuusi Lisää muistiin -komponentilla. Tallenna vaivattomasti dataa tai dokumentteja pitkäaikaiseen muistiin, luokiteltuna...