Transformerit

Transformerit ovat mullistava neuroverkkorakenne, joka on muuttanut tekoälyä erityisesti luonnollisen kielen käsittelyssä. Vuonna 2017 julkaistussa artikkelissa...

Transformerit ovat neuroverkkoja, jotka käyttävät attention-mekanismeja käsitelläkseen tehokkaasti sekventiaalista dataa, loistaen NLP:ssä, puheentunnistuksessa, genomiikassa ja muissa sovelluksissa.

Transformer-malli on neuroverkkotyyppi, joka on erityisesti suunniteltu käsittelemään sekventiaalista dataa, kuten tekstiä, puhetta tai aikasarjatietoa. Toisin kuin perinteiset mallit, kuten Recurrent Neural Networks (RNN) ja Convolutional Neural Networks (CNN), transformerit hyödyntävät niin kutsuttua “attention”- tai “self-attention”-mekanismia punnitakseen syötteen eri osien merkitystä. Tämän ansiosta malli pystyy havaitsemaan pitkän kantaman riippuvuuksia ja suhteita tiedossa, mikä tekee siitä poikkeuksellisen tehokkaan monenlaisiin käyttökohteisiin.

Transformer-mallin ytimessä on attention-mekanismi, jonka avulla malli voi keskittyä eri osiin syötesevensistä tehdessään ennusteita. Tämä mekanismi arvioi jokaisen syötteen osan merkityksellisyyttä, mahdollistaen monimutkaisten kuvioiden ja riippuvuuksien tunnistamisen, jotka perinteiset mallit saattavat jättää huomaamatta.

Self-attention on erityinen attention-mekanismin muoto, jota käytetään transformereissa. Se mahdollistaa koko syötesevenssin huomioimisen samanaikaisesti sen sijaan, että sitä käsiteltäisiin yksi osa kerrallaan. Tämä rinnakkaiskäsittely paitsi parantaa laskennallista tehokkuutta, myös vahvistaa mallin kykyä ymmärtää datan monimutkaisia suhteita.

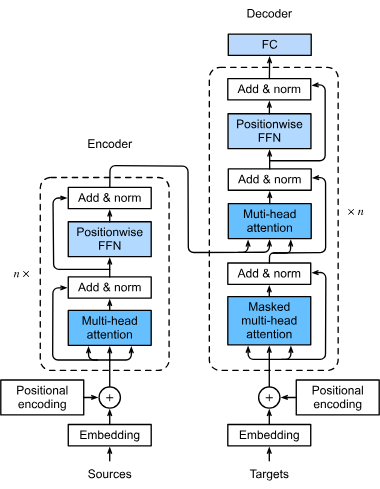

Tyypillinen transformer-malli koostuu encoderista ja decoderista:

Sekä encoder että decoder rakentuvat useista self-attention- ja syöttö-kohde -neuroverkkojen kerroksista, jotka on pinottu päällekkäin syvän ja tehokkaan mallin luomiseksi.

Transformerit ovat modernin NLP:n selkäranka. Niitä käytetään esimerkiksi:

Transformerit mahdollistavat reaaliaikaisen puheen kääntämisen ja litteroinnin, mikä tekee kokouksista ja luokkahuoneista saavutettavampia moninaisille ja kuulorajoitteisille osallistujille.

Analysoimalla geenien ja proteiinien sekvenssejä transformerit nopeuttavat lääkesuunnittelun ja yksilöllisen lääketieteen kehitystä.

Transformerit pystyvät tunnistamaan kuvioita ja poikkeavuuksia suurista tietomassoista, mikä tekee niistä arvokkaita petosten tunnistuksessa ja personoitujen suositusten tuottamisessa verkkokauppa- ja suoratoistopalveluissa.

Transformerit hyötyvät hyveellisestä kehityksestä: kun niitä käytetään erilaisissa sovelluksissa, ne tuottavat valtavia määriä dataa, jota voidaan käyttää entistä tarkempien ja tehokkaampien mallien kouluttamiseen. Tämä datan tuottamisen ja mallien parantamisen sykli vie tekoälyn kehitystä eteenpäin, mistä onkin alettu puhua “transformer-AI:n aikakautena”.

Toisin kuin RNN:t, jotka käsittelevät dataa järjestyksessä osa kerrallaan, transformerit käsittelevät koko sekvenssin kerralla, mikä mahdollistaa suuremman rinnakkaisuuden ja tehokkuuden.

CNN:t ovat erinomaisia kuvadatan käsittelyssä, mutta transformerit loistavat sekventiaalisen datan käsittelyssä ja tarjoavat monipuolisemman ja tehokkaamman arkkitehtuurin laajempaan käyttöön.

Transformer-malli on neuroverkkorakenne, joka on suunniteltu käsittelemään sekventiaalista dataa käyttäen attention-mekanismia, mikä mahdollistaa datan sisäisten suhteiden ja riippuvuuksien tehokkaan tunnistamisen.

Toisin kuin RNN:t, jotka käsittelevät dataa yksi kerrallaan, transformerit käsittelevät koko syötesekvenssin samanaikaisesti, mikä tekee niistä tehokkaampia. CNN:t taas soveltuvat hyvin kuvadataan, mutta transformerit loistavat sekventiaalisen datan, kuten tekstin ja puheen, käsittelyssä.

Transformereita käytetään laajasti luonnollisen kielen käsittelyssä, puheentunnistuksessa ja -synteesissä, genomiikassa, lääkekehityksessä, petosten tunnistuksessa sekä suositusjärjestelmissä niiden kyvyn ansiosta käsitellä monimutkaista sekventiaalista dataa.

Kokeile FlowHuntia luodaksesi räätälöityjä AI-chatbotteja ja -työkaluja hyödyntäen kehittyneitä malleja, kuten transformereita, liiketoimintasi tarpeisiin.

Transformerit ovat mullistava neuroverkkorakenne, joka on muuttanut tekoälyä erityisesti luonnollisen kielen käsittelyssä. Vuonna 2017 julkaistussa artikkelissa...

Generatiivinen esikoulutettu muuntaja (GPT) on tekoälymalli, joka hyödyntää syväoppimistekniikoita tuottaakseen tekstiä, joka muistuttaa läheisesti ihmisen kirj...

Tekstintuotanto suurilla kielimalleilla (LLM) tarkoittaa koneoppimismallien kehittynyttä käyttöä ihmismäisen tekstin tuottamiseen annetuista kehotteista. Tutust...