Les agents IA sont fondamentalement différents des chatbots. Un chatbot attend une entrée utilisateur et répond. Un agent poursuit des objectifs de manière autonome, en appelant des outils, en raisonnant sur des problèmes et en prenant des mesures sans intervention humaine à chaque étape.

Cette distinction est importante car les agents peuvent automatiser des workflows entiers. Un agent de qualification de leads note les prospects, enrichit leurs données et les affecte aux commerciaux — le tout sans intervention humaine. Un agent de triage de contenu catégorise les tickets de support, les dirige vers des spécialistes et escalade les cas limites aux humains.

Dans ce guide, vous apprendrez à architecturer des agents fiables, à les intégrer aux systèmes métier, à prévenir les échecs courants et à mesurer leur impact. Nous couvrirons des modèles réels utilisés en production dans des entreprises qui automatisent la qualification de leads, le traitement de documents et le support client à grande échelle.

Que sont les agents IA et en quoi diffèrent-ils des chatbots ?

Définition des agents IA (systèmes autonomes qui perçoivent, décident, agissent)

Un agent IA est un système logiciel qui :

- Perçoit son environnement (lit les entrées, les résultats d’outils, la mémoire)

- Raisonne sur la meilleure action (utilise un LLM pour planifier)

- Agit en appelant des outils ou en prenant des mesures vers un objectif

- S’adapte selon les retours et résultats

Les agents sont axés sur les objectifs. Vous définissez l’objectif (« Noter et qualifier ce lead »), et l’agent trouve comment y parvenir.

Distinction clé : les chatbots sont réactifs ; les agents sont autonomes

Chatbots : l’utilisateur initie → le modèle répond

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

L’utilisateur dirige chaque interaction. Le chatbot est sans état — chaque message est indépendant.

Agents : axés sur les objectifs, prennent des mesures sans intervention utilisateur à chaque étape

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

L’agent travaille vers un objectif défini, prenant plusieurs décisions et appels d’outils de manière autonome.

Pourquoi les agents sont importants pour les workflows

Automatisation à grande échelle (gérer des milliers de tâches sans intervention humaine)

Qualification manuelle de leads : 5 minutes par lead × 100 leads = 500 heures/mois. Coût : 10 000 $/mois (à 20 $/heure).

Pilotée par agent : 10 secondes par lead × 100 leads = 16 heures/mois. Coût : 100 $ (appels API de l’agent). Économies : 99 %.

Les agents multiplient la capacité de votre équipe sans embauche.

Raisonnement multi-étapes (décomposer des problèmes complexes en sous-tâches)

Les tâches complexes nécessitent plusieurs étapes :

- Qualification de leads : Noter → Enrichir → Affecter → Notifier

- Triage de documents : Extraire → Classer → Diriger → Archiver

- Support client : Comprendre → Rechercher dans la base de connaissances → Générer une réponse → Diriger si nécessaire

Les agents gèrent ce raisonnement automatiquement. Vous définissez l’objectif ; l’agent le décompose en étapes.

Utilisation d’outils (les agents appellent des API, bases de données, services externes)

Les agents sont des « mains ». Ils appellent des API pour :

- Interroger des bases de données

- Mettre à jour des systèmes CRM

- Envoyer des emails ou messages Slack

- Appeler des services tiers (enrichissement de données, traitement de paiements)

Un seul agent peut orchestrer 5 à 10 appels d’outils pour compléter un workflow.

Comportement adaptatif (apprendre des retours, ajuster l’approche)

Les agents peuvent s’améliorer avec le temps. Si un agent classe mal des documents, vous fournissez des retours. L’agent apprend et ajuste sa stratégie de prompts.

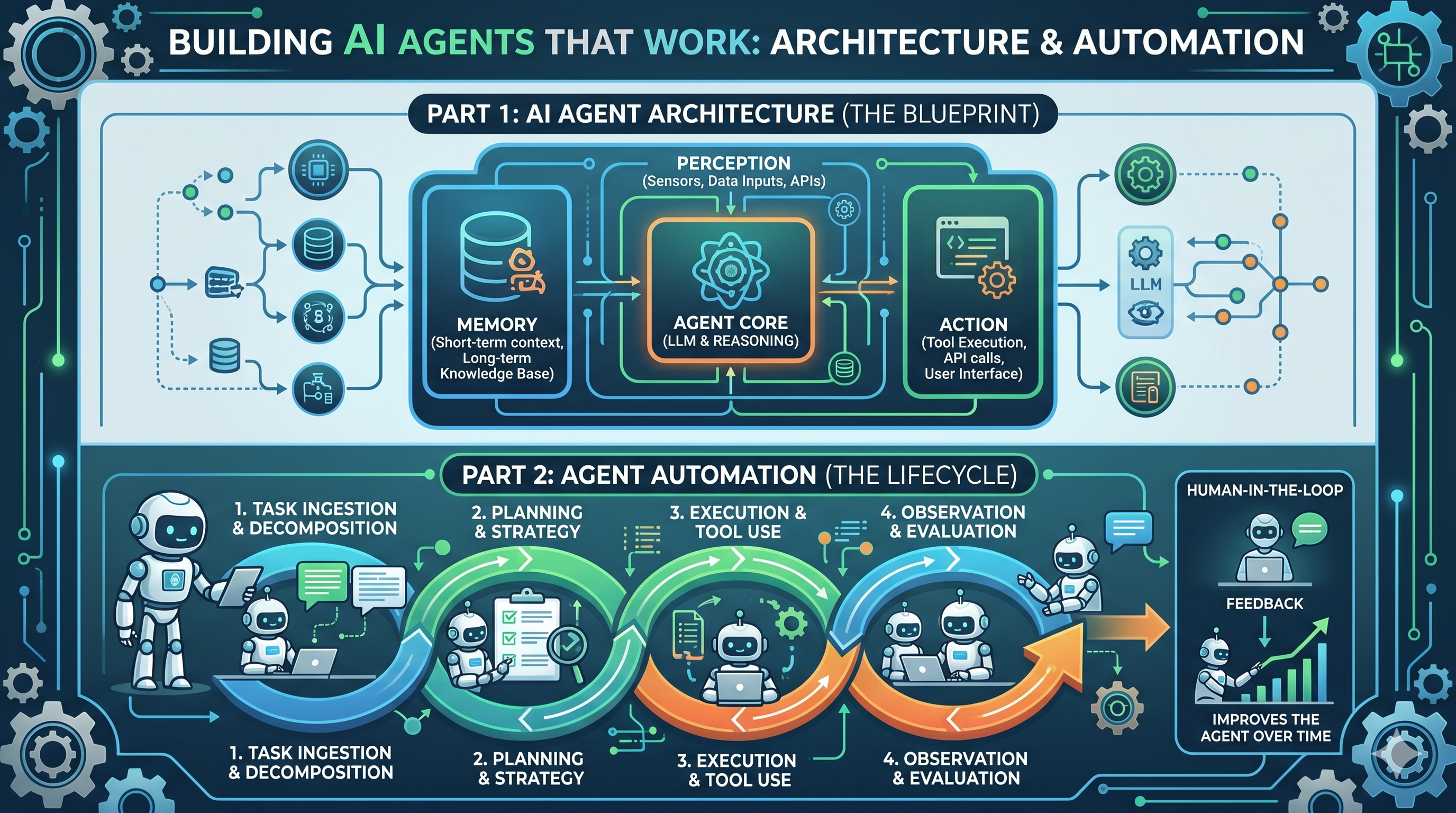

Composants essentiels d’un agent IA (la boucle d’agent)

La boucle de raisonnement de l’agent (avec description du diagramme)

Le cœur de chaque agent est une boucle :

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Observation : l’agent perçoit l’état (entrée, environnement, résultats d’outils)

L’agent lit :

- L’entrée initiale (données de lead, texte de document, question client)

- Les résultats des outils des étapes précédentes (réponses API, requêtes BDD)

- La mémoire (historique de conversation, décisions passées, base de connaissances)

- L’état actuel (ce qui a été fait, ce qui reste)

Raisonnement : le LLM décide de l’action suivante (planification, sélection d’outils)

Le LLM reçoit un prompt comme :

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

Le LLM répond : « Je dois d’abord enrichir le lead pour obtenir les données de chiffre d’affaires, puis noter, puis affecter. »

Action : exécuter l’appel d’outil ou avancer vers l’objectif

L’agent exécute l’outil sélectionné :

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Rétroaction : évaluer le résultat, ajuster la stratégie si nécessaire

L’agent vérifie : l’appel d’outil a-t-il réussi ? A-t-il progressé vers l’objectif ? Mettre à jour la mémoire et boucler.

Boucle : répéter jusqu’à ce que l’objectif soit atteint ou que le nombre max d’étapes soit atteint

L’agent répète observation → raisonnement → action → rétroaction jusqu’à ce que :

- L’objectif soit atteint (« Lead noté et affecté »)

- Le nombre maximum d’étapes soit atteint (empêche les boucles infinies)

- Une erreur se produise (escalade vers un humain)

Intégration d’outils (les « mains » de l’agent)

Définir des outils (signatures de fonctions, descriptions, paramètres)

Les outils sont des fonctions que l’agent peut appeler. Définissez-les clairement :

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Des descriptions claires aident le LLM à choisir le bon outil.

Appel d’outils (comment les agents sélectionnent et invoquent les outils)

Le LLM répond avec un appel d’outil :

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Votre framework d’agent exécute l’outil et transmet le résultat au LLM.

Gestion des résultats d’outils (analyse des réponses, récupération d’erreurs)

Gérez à la fois le succès et l’échec :

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Si un outil échoue, l’agent doit essayer une approche différente ou escalader vers un humain.

Systèmes de mémoire (ce que les agents se souviennent)

Mémoire à court terme (contexte de conversation actuel)

La mémoire de travail de l’agent : entrée actuelle, résultats d’outils, étapes de raisonnement. Généralement stockée dans la fenêtre de contexte (le prompt).

Exemple : un agent de qualification de leads se souvient :

- Des données initiales du lead

- Des résultats d’enrichissement

- Du score

- Du commercial affecté

Mémoire à long terme (base de connaissances, interactions passées)

Mémoire persistante : décisions passées, modèles appris, base de connaissances.

Cas d’usage :

- Base de connaissances : l’agent récupère des articles pertinents pour répondre aux questions clients

- Historique de décisions : l’agent apprend quels leads ont converti (améliore la notation)

- Journaux d’interactions : l’agent se souvient des interactions passées avec un client

Implémentez avec des bases de données vectorielles (Pinecone, Weaviate) pour la recherche sémantique.

Limites de mémoire (contraintes de fenêtre de contexte)

Les LLM ont des fenêtres de contexte finies (4K-128K tokens). Les agents ne peuvent pas tout se souvenir. Stratégies :

- Résumé : compresser les anciennes conversations en résumés

- Génération augmentée par récupération (RAG) : récupérer uniquement la mémoire pertinente au besoin

- Mémoire hiérarchique : garder les interactions récentes en mémoire court terme, les plus anciennes en long terme

Colonne vertébrale du raisonnement (le « cerveau »)

Sélection du LLM (GPT-4, Claude, modèles open-source)

- GPT-4 : meilleur raisonnement, gère les tâches complexes. Coût : 0,03–0,06 $ pour 1K tokens.

- Claude 3.5 Sonnet : raisonnement solide, contexte long (200K tokens). Coût : 0,003–0,015 $ pour 1K tokens.

- Open-source (LLaMA 4) : moins cher (0,01–0,03 $ pour 1M tokens), personnalisable, respectueux de la vie privée.

Pour la plupart des agents, Claude ou les modèles open-source sont suffisants et moins chers.

Modes de raisonnement (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought : l’agent pense étape par étape. « Je dois enrichir → noter → affecter. »

- Tree-of-thought : l’agent explore plusieurs chemins, choisit le meilleur. Plus lent mais plus précis pour les problèmes complexes.

- Reflexion : l’agent critique sa propre sortie, réessaie si nécessaire. Réduit les hallucinations.

Exemple de prompt reflexion :

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Compromis : vitesse vs. précision

- Agents rapides : raisonnement en un seul tour, pas de validation d’outil. 2–5 secondes par tâche. 85 % de précision.

- Agents précis : raisonnement multi-étapes, validation, reflexion. 10–30 secondes par tâche. 95 % de précision.

Choisissez la vitesse pour le temps réel (support client). Choisissez la précision pour les enjeux importants (décisions financières).

Types d’agents et quand utiliser chacun

Agents réactifs (simples, rapides, sans état)

Comment ils fonctionnent (un seul tour : entrée → action)

Les agents réactifs prennent une seule décision et agissent. Pas de planification multi-étapes.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

Idéaux pour : utilisation simple d’outils, appels API, réponses immédiates

- Q&A service client (rechercher une commande, vérifier un solde)

- Appels API simples (obtenir la météo, vérifier un cours de bourse)

- Réponses immédiates nécessaires (< 2 secondes de latence)

Exemple : chatbot de service client avec recherche en base de connaissances

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latence : 1–3 secondes. Coût : 0,001–0,01 $ par requête.

Agents de planification (axés objectifs, raisonnement multi-étapes)

Comment ils fonctionnent (décomposent l’objectif en sous-tâches, exécutent le plan)

Les agents de planification décomposent des objectifs complexes en étapes.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

Idéaux pour : workflows complexes, tâches de recherche, analyse de données

- Qualification de leads (enrichir → noter → affecter)

- Traitement de documents (extraire → classer → stocker)

- Tâches de recherche (chercher → résumer → compiler)

Exemple : agent de qualification de leads (noter → enrichir → affecter)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latence : 5–15 secondes. Coût : 0,02–0,05 $ par lead.

Agents apprenants (adaptatifs, s’améliorent avec le temps)

Comment ils fonctionnent (intègrent les retours, ajustent le comportement)

Les agents apprenants s’améliorent avec les retours.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

Idéaux pour : processus de longue durée, personnalisation, optimisation

- Recommandation de contenu (apprend les préférences utilisateur)

- Routage du support client (apprend quels agents gèrent mieux quels problèmes)

- Optimisation tarifaire (apprend quels prix convertissent mieux)

Exemple : agent de recommandation de contenu (apprend les préférences utilisateur)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Avec le temps, les recommandations s’améliorent à mesure que l’agent apprend les préférences utilisateur.

Agents hiérarchiques (agents gérant d’autres agents)

Comment ils fonctionnent (agent superviseur délègue à des spécialistes)

Un agent superviseur coordonne des agents spécialistes.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

Idéaux pour : workflows d’entreprise, automatisation à grande échelle

- Création de contenu (agents de recherche → rédaction → édition → publication)

- Support client complexe (agents de triage → résolution → escalade)

- Pipelines de traitement de données (agents d’extraction → transformation → chargement)

Exemple : pipeline de création de contenu (recherche → rédaction → édition → publication)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Chaque agent spécialiste est optimisé pour sa tâche. Le superviseur orchestre.

Meilleurs outils et frameworks d’agents IA en 2026 (tableau comparatif)

Critères d’évaluation

Capacité de raisonnement (Chain-of-Thought, planification, Reflexion)

À quel point la pensée de l’agent est sophistiquée. Les agents simples utilisent chain-of-thought. Les agents complexes utilisent planification et reflexion.

Intégration d’outils (facilité d’ajout d’outils personnalisés)

Pouvez-vous facilement connecter API, bases de données, systèmes CRM ? Ou avez-vous besoin de code personnalisé ?

Courbe d’apprentissage (temps de configuration, qualité de la documentation)

À quelle vitesse un développeur peut obtenir un agent fonctionnel ? Les plateformes no-code sont plus rapides ; les frameworks Python plus flexibles.

Modèle tarifaire (gratuit, par appel API, abonnement)

Certains frameworks sont open-source (gratuits). D’autres facturent par appel API ou par abonnement.

Meilleurs cas d’usage

Pour quoi chaque outil est-il optimisé ?

Tableau comparatif : meilleurs outils et frameworks d’agents IA (2026)

| Outil | Type de framework | Capacité de raisonnement | Intégration d’outils | Courbe d’apprentissage | Tarification | Idéal pour |

|---|---|---|---|---|---|---|

| n8n | Constructeur de workflow visuel | Chain-of-thought | 500+ intégrations | Faible | Gratuit + payant | Utilisateurs non techniques, mise en place rapide |

| CrewAI | Framework Python | Planification + reflexion | Outils personnalisés (Python) | Moyenne | Open-source | Développeurs, agents complexes |

| Autogen | Framework Python | Raisonnement multi-agents | Outils personnalisés | Élevée | Open-source | Recherche, systèmes multi-agents |

| LangGraph | Framework Python | Planification + gestion d’état | Écosystème LangChain | Moyenne | Open-source | Workflows complexes, suivi d’état |

| FlowHunt | Plateforme native | Chain-of-thought + planification | Natif + intégrations API | Faible | Abonnement | Automatisation de workflow, facilité d’utilisation |

| Lindy.ai | Plateforme no-code | Chain-of-thought | 100+ intégrations | Très faible | Freemium | Non technique, agents rapides |

| Gumloop | Plateforme no-code | Chain-of-thought | 50+ intégrations | Très faible | Freemium | Automatisation simple, modèles |

Différences clés :

- No-code (n8n, FlowHunt, Lindy.ai) : rapide à construire, personnalisation limitée. Bon pour les workflows standards.

- Frameworks Python (CrewAI, Autogen, LangGraph) : flexible, puissant, courbe d’apprentissage plus raide. Bon pour la logique complexe.

- Open-source (CrewAI, Autogen, LangGraph) : gratuit, mais vous gérez l’infrastructure. Les plateformes payantes gèrent l’hébergement.

Comment choisir le bon outil pour votre cas d’usage

- Prototype rapide (< 1 semaine) : utilisez no-code (FlowHunt, n8n, Lindy.ai)

- Agent complexe avec logique personnalisée : utilisez un framework Python (CrewAI, LangGraph)

- Système multi-agents (agents coordonnant) : utilisez Autogen

- Automatisation de workflow en production : utilisez FlowHunt (géré, surveillé, mis à l’échelle)

Construire votre premier agent : architecture étape par étape

Définir l’objectif et le périmètre de l’agent

Quel problème résout-il ?

Soyez précis. Mauvais : « Automatiser la gestion des leads. » Bon : « Noter les leads de 0 à 100, enrichir avec les données d’entreprise, affecter aux commerciaux selon la capacité. »

Quelles sont les métriques de succès ?

- Précision : % de décisions correctes (objectif : > 90 %)

- Latence : temps d’accomplissement (objectif : < 10 secondes)

- Coût : appels API par tâche (objectif : < 0,05 $)

- Taux d’automatisation : % de tâches accomplies sans intervention humaine (objectif : > 80 %)

Quelles sont les contraintes (latence, coût, précision) ?

Compromis :

- Workflows en temps réel : besoin d’une latence < 5 secondes. Utilisez des modèles rapides, moins d’appels d’outils.

- Workflows en batch : peuvent tolérer 5–30 minutes. Utilisez un raisonnement plus précis, plus d’appels d’outils.

- Sensible aux coûts : utilisez des modèles open-source, moins d’appels API.

- Précision critique : utilisez des modèles chers (GPT-4), validation multi-étapes.

Concevoir la boucle de l’agent

Que va observer l’agent ?

Données d’entrée : données de lead, texte de document, question client, contexte de mémoire.

Quel mode de raisonnement (chain-of-thought simple vs. planification) ?

- Chain-of-thought : rapide, simple. « Je fais l’étape 1, puis l’étape 2. »

- Planification : plus lent, plus précis. « Je planifie toutes les étapes d’abord, puis j’exécute. »

De quels outils a-t-il besoin ?

Listez les API, bases de données, services que l’agent appellera.

Exemple pour qualification de leads :

- API CRM (obtenir/mettre à jour lead)

- API d’enrichissement de données (obtenir données d’entreprise)

- Modèle de notation (noter le lead)

- Service de notification (envoyer Slack/email)

Comment sait-il quand arrêter ?

Définissez la condition de succès. « Arrêter lorsque le lead est noté et affecté. »

Définissez également les étapes maximum pour prévenir les boucles infinies. « Arrêter après 10 étapes, quel que soit le résultat. »

Implémenter et tester

Pseudocode ou exemple de code réel (CrewAI ou FlowHunt)

Exemple CrewAI :

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Stratégie de test (tests unitaires pour les appels d’outils, tests d’intégration pour les boucles)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Déboguer les problèmes courants (boucles infinies, hallucinations, mauvais outils)

- Boucles infinies : ajoutez une limite d’étapes max. Journalisez chaque étape. Surveillez les actions répétées.

- Hallucinations : ajoutez une validation. Vérifiez les faits contre les données sources.

- Mauvais outils : améliorez les descriptions des outils. Ajoutez une validation d’outil avant exécution.

Exemple réel : agent de qualification de leads

Objectif : noter les leads, enrichir les données, affecter à l’équipe commerciale

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Outils : API CRM, service d’enrichissement de données, modèle de notation

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Parcours du pseudocode (observer lead → noter → enrichir → affecter)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Résultats : métriques de précision, latence, coût

- Précision : 94 % (le score du lead correspond à la revue manuelle)

- Latence : 8 secondes (5 appels d’outils, 3 étapes de raisonnement LLM)

- Coût : 0,03 $ par lead (appels API GPT-4 + API d’enrichissement)

- Débit : 450 leads/heure (instance unique d’agent)

- Taux d’automatisation : 87 % (13 % escaladés vers un humain pour revue)

Intégration des agents avec les systèmes métier

Modèles d’intégration API

API REST (les plus courantes)

La plupart des agents appellent des API REST. Utilisez un client HTTP standard :

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (déclencheurs d’agents événementiels)

Déclenchez des agents sur événements (nouveau lead, email entrant, soumission de formulaire) :

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Authentification et sécurité (clés API, OAuth, limitation de débit)

- Clés API : stockez dans les variables d’environnement, pas dans le code

- OAuth : pour les intégrations orientées utilisateur (Salesforce, HubSpot)

- Limitation de débit : respectez les limites API. Implémentez la logique de backoff et réessai

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Intégration avec les bases de données

Lecture seule (l’agent interroge les données)

L’agent lit les données client, interactions passées, base de connaissances :

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Opérations d’écriture (l’agent stocke les décisions/résultats)

L’agent écrit les décisions dans la base de données :

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transactions et cohérence (assurer l’intégrité des données)

Utilisez les transactions pour les opérations multi-étapes :

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Intégration CRM et outils métier

Modèles d’intégration Salesforce, HubSpot, Pipedrive

Utilisez les SDK officiels :

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Intégration Slack, email, Jira (l’agent envoie notifications/mises à jour)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Authentification et périmètre de permissions

Utilisez les scopes OAuth pour limiter ce que les agents peuvent faire :

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Workflows human-in-the-loop

Quand les agents ont besoin d’approbation humaine

Décisions à haut risque : transactions financières, remboursements clients, exceptions à la politique.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Modèles d’escalade (décisions à haut risque, cas limites)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Boucles de rétroaction (les humains corrigent les erreurs d’agent)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Échecs courants des agents et comment les prévenir

Boucles infinies (l’agent reste bloqué en répétant la même action)

Cause : mauvaise définition d’objectif, outil qui ne progresse pas

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

Prévention : limite d’étapes max, suivi de progression, diversité d’outils

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Récupération : timeout, escalade vers humain

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Hallucinations (l’agent invente des faits ou sorties d’outils)

Cause : tendance du LLM à confabuler, mauvaises descriptions d’outils

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

Prévention : génération augmentée par récupération (RAG), validation d’outils, vérification des faits

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Utilisez RAG pour ancrer l’agent dans les faits :

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Récupération : repli vers humain, réessayer avec raisonnement différent

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Utilisation abusive d’outils (l’agent appelle le mauvais outil ou avec mauvais paramètres)

Cause : descriptions d’outils ambiguës, mauvais raisonnement

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prévention : docs d’outils claires, entraînement à l’utilisation d’outils, validation avant exécution

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Récupération : gestion d’erreurs, suggérer le bon outil, réessayer

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Dépassements de coûts (l’agent utilise trop d’appels API)

Cause : raisonnement inefficace, appels d’outils redondants

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

Prévention : limites de budget, déduplication d’appels, mise en cache

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implémentez la mise en cache :

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Récupération : surveillance des coûts, limitation, repli sur modèle moins cher

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Problèmes de latence (agent trop lent pour l’usage en temps réel)

Cause : multiples étapes de raisonnement, réponses d’outils lentes

Un agent effectuant 5 appels API séquentiels à 1 seconde chacun = latence de 5+ secondes.

Prévention : exécution parallèle d’outils, mise en cache, modèles plus rapides

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Utilisez des modèles plus rapides :

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Récupération : timeout, retourner résultats partiels, mettre en file d’attente pour async

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Mesurer la performance et le ROI des agents

Métriques clés à suivre

Précision (% de décisions/actions correctes)

Comparez la sortie de l’agent à la vérité terrain (revue humaine, résultats réels).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latence (temps pour accomplir la tâche)

Mesurez le temps de bout en bout de l’entrée à la sortie.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Coût par tâche (appels API, calcul, revue humaine)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Satisfaction utilisateur (si human-in-the-loop)

Enquêtez auprès des utilisateurs : « Quelle est votre satisfaction avec les décisions de l’agent ? »

Taux d’automatisation (% de tâches accomplies sans intervention humaine)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Calcul du ROI

Référence : coût du processus manuel (heures humaines × tarif horaire)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Coût de l’agent : infrastructure + appels API + supervision humaine

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Période de retour : quand coût d’agent < coût manuel

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Exemple : ROI d’un agent de qualification de leads

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Amélioration continue

Surveiller les métriques dans le temps

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

Tester A/B différentes configurations d’agents

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Intégrer les retours pour améliorer la précision

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Mettre à l’échelle les agents réussis, retirer ceux sous-performants

Surveillez le ROI. Si un agent n’apporte pas de valeur, retirez-le. Mettez à l’échelle les agents réussis vers d’autres équipes.

Questions fréquemment posées

La section FAQ est générée automatiquement à partir du frontmatter et apparaît ci-dessous.

{{ cta-dark-panel heading=“Construisez des agents sans la complexité” description=“La plateforme native d’agents FlowHunt gère l’intégration des outils, la gestion des erreurs et la surveillance. Commencez à construire des workflows autonomes en quelques minutes, pas en semaines.” ctaPrimaryText=“Essayer FlowHunt gratuitement” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Réserver une démo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}