Red Teaming IA vs Tests de Pénétration Traditionnels : Différences Clés

Le red teaming IA et les tests de pénétration traditionnels abordent différents aspects de la sécurité de l'IA. Ce guide explique les différences clés, quand ut...

Le red teaming IA est un exercice de sécurité adverse structuré où des spécialistes sondent systématiquement les systèmes d’IA — chatbots LLM, agents et pipelines — en utilisant des techniques d’attaque réalistes pour identifier les vulnérabilités avant que des acteurs malveillants ne le fassent.

Le red teaming IA applique le concept militaire d’exercices adverses “équipe rouge contre équipe bleue” à l’évaluation de la sécurité des systèmes d’intelligence artificielle. Une équipe rouge de spécialistes adopte l’état d’esprit et les techniques des attaquants, sondant un système d’IA dans le but de trouver des vulnérabilités exploitables, des violations de politiques et des modes de défaillance.

Le terme “red teaming” trouve son origine dans la stratégie militaire — désignant un groupe chargé de remettre en question les hypothèses et de simuler le comportement de l’adversaire. En cybersécurité, les équipes rouges effectuent des tests adverses des systèmes et des organisations. Le red teaming IA étend cette pratique aux caractéristiques uniques des systèmes basés sur les LLM.

Suite à des incidents très médiatisés impliquant la manipulation de chatbots, le jailbreaking et l’exfiltration de données, des organisations telles que Microsoft, Google, OpenAI et le gouvernement américain ont investi massivement dans le red teaming IA en tant que pratique de sûreté et de sécurité.

Bien que liés, le red teaming IA et les tests d’intrusion traditionnels traitent des modèles de menace différents :

| Aspect | Red Teaming IA | Tests d’Intrusion Traditionnels |

|---|---|---|

| Interface principale | Langage naturel | Protocoles réseau/application |

| Vecteurs d’attaque | Injection de prompt, jailbreaking, manipulation de modèle | Injection SQL, XSS, contournement d’authentification |

| Modes de défaillance | Violations de politiques, hallucinations, dérive comportementale | Corruption de mémoire, escalade de privilèges |

| Outils | Prompts personnalisés, ensembles de données adverses | Outils d’analyse, frameworks d’exploitation |

| Expertise requise | Architecture LLM + sécurité | Sécurité réseau/web |

| Résultats | Découvertes comportementales + vulnérabilités techniques | Vulnérabilités techniques |

La plupart des déploiements d’IA d’entreprise bénéficient des deux : tests d’intrusion traditionnels pour la sécurité de l’infrastructure et des API, red teaming IA pour les vulnérabilités spécifiques aux LLM.

Le red teaming structuré utilise des bibliothèques d’attaques organisées alignées sur des cadres comme le OWASP LLM Top 10 ou MITRE ATLAS. Chaque catégorie est testée de manière exhaustive, garantissant que la couverture ne dépend pas de la créativité individuelle.

Un red teaming efficace n’est pas une seule passe. Les attaques réussies sont raffinées et intensifiées pour sonder si les atténuations sont efficaces. Les attaques échouées sont analysées pour comprendre quelles défenses les ont empêchées.

Les outils automatisés peuvent tester des milliers de variations de prompts à grande échelle. Mais les attaques les plus sophistiquées — manipulation multi-tours, ingénierie sociale spécifique au contexte, combinaisons de techniques nouvelles — nécessitent un jugement humain et de la créativité.

Les exercices de red teaming doivent être fondés sur une modélisation réaliste des menaces : qui sont les attaquants probables (utilisateurs curieux, concurrents, initiés malveillants), quelles sont leurs motivations, et à quoi ressemblerait une attaque réussie du point de vue de l’impact commercial ?

Pour les organisations déployant l’IA à grande échelle, un programme continu de red teaming comprend :

Le red teaming IA est un exercice de sécurité adverse où des spécialistes jouent le rôle d'attaquants et sondent systématiquement un système d'IA à la recherche de vulnérabilités, de violations de politiques et de modes de défaillance. L'objectif est d'identifier les faiblesses avant que de véritables attaquants ne le fassent — puis de les corriger.

Les tests d'intrusion traditionnels se concentrent sur les vulnérabilités techniques des logiciels et de l'infrastructure. Le red teaming IA ajoute des vecteurs d'attaque en langage naturel — injection de prompt, jailbreaking, ingénierie sociale du modèle — et traite les modes de défaillance spécifiques à l'IA comme les hallucinations, la dépendance excessive et le contournement de politiques. Les deux disciplines sont complémentaires.

Le red teaming IA est plus efficace lorsqu'il est effectué par des spécialistes qui comprennent à la fois l'architecture IA/LLM et les techniques de sécurité offensive. Les équipes internes ont un contexte précieux mais peuvent avoir des angles morts ; les équipes rouges externes apportent de nouvelles perspectives et des connaissances d'attaque actuelles.

Nos exercices de red team IA utilisent les techniques d'attaque actuelles pour trouver les vulnérabilités de votre chatbot avant que les attaquants ne le fassent — et fournissent une feuille de route de remédiation claire.

Le red teaming IA et les tests de pénétration traditionnels abordent différents aspects de la sécurité de l'IA. Ce guide explique les différences clés, quand ut...

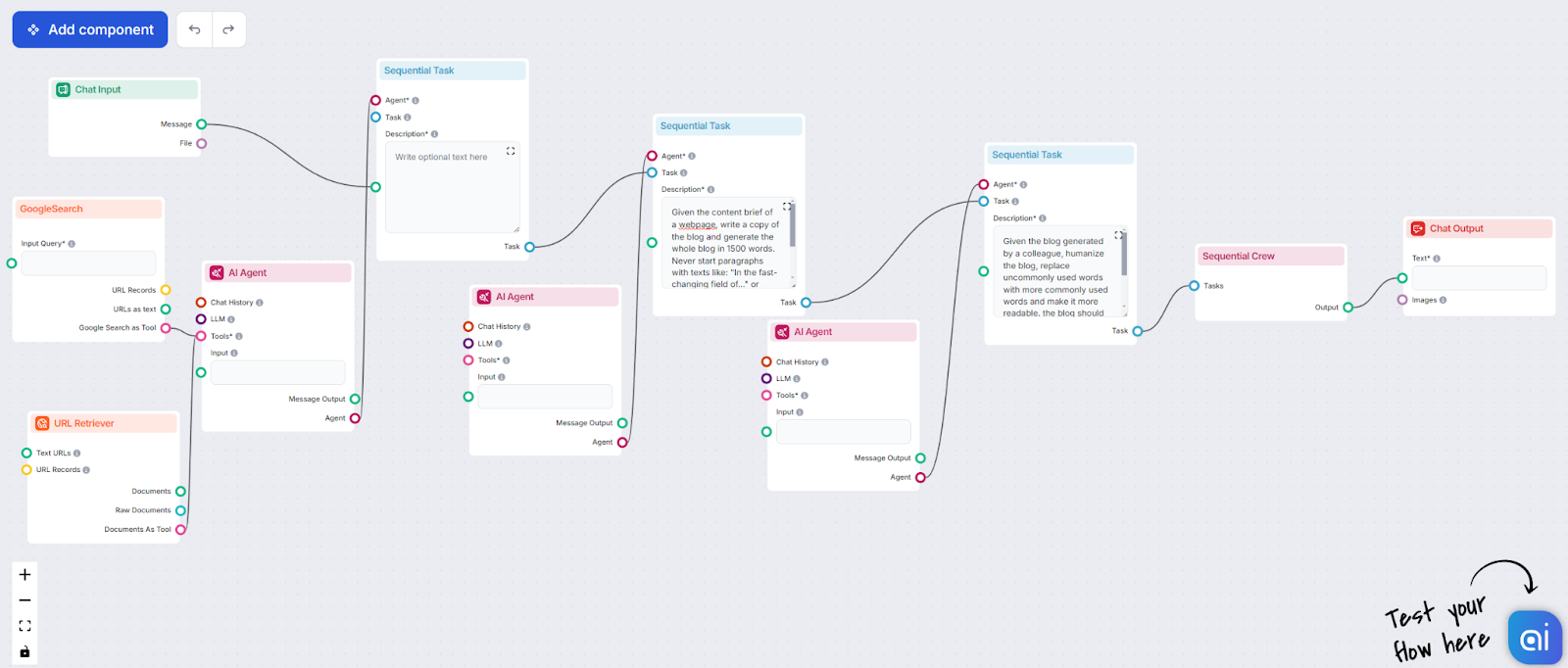

Laissez des équipes entières de collègues IA gérer des tâches complexes. Découvrez comment créer des équipes d’agents avec le composant Équipe Séquentielle dans...

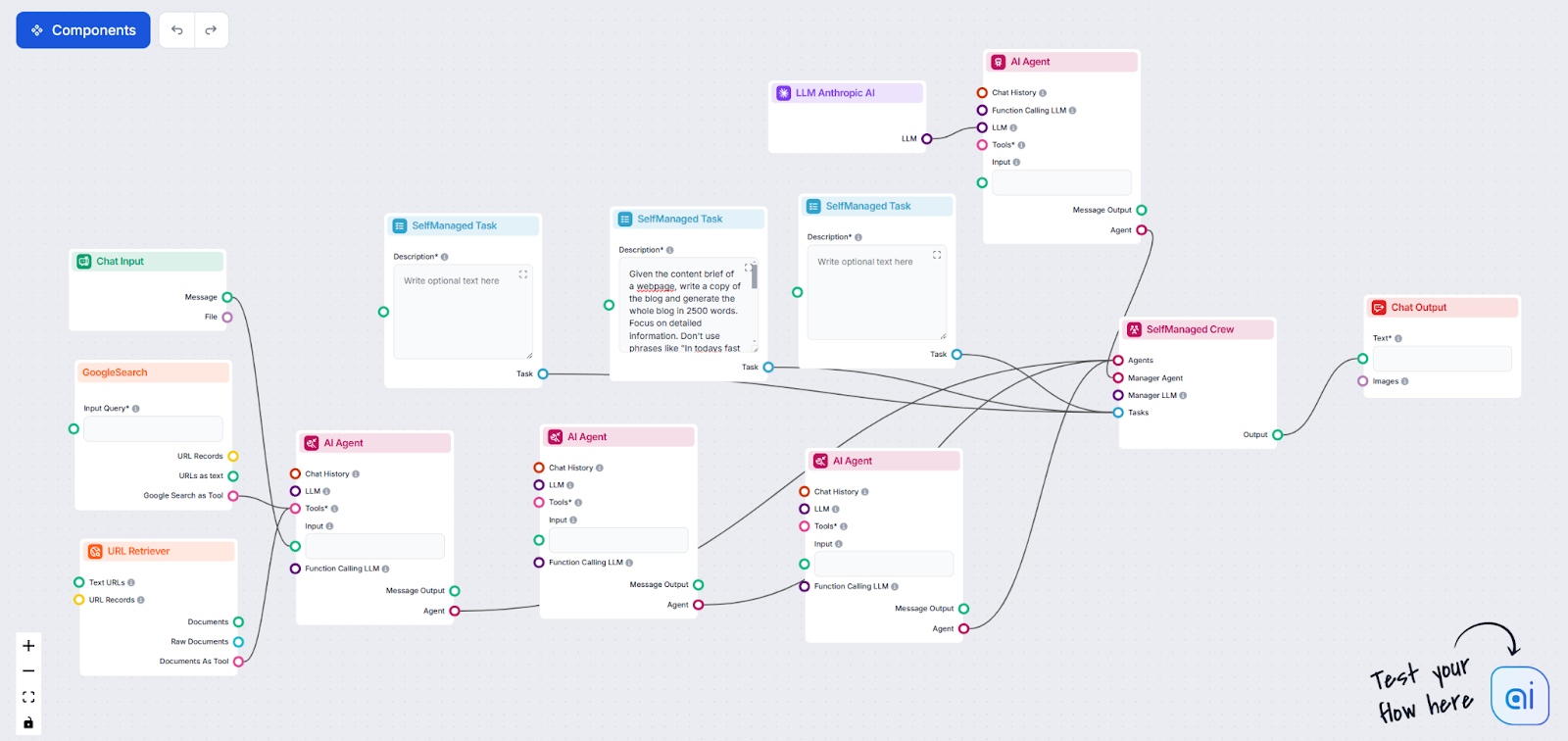

Laissez des équipes de collègues IA gérer des tâches complexes. Découvrez comment le composant Équipe Autogérée de FlowHunt permet aux agents IA de collaborer c...