Gli agenti AI sono fondamentalmente diversi dai chatbot. Un chatbot attende l’input dell’utente e risponde. Un agente persegue obiettivi in modo autonomo, chiamando strumenti, ragionando sui problemi e intraprendendo azioni senza input umano ad ogni passo.

Questa distinzione è importante perché gli agenti possono automatizzare interi flussi di lavoro. Un agente per la qualificazione dei lead valuta i prospect, arricchisce i loro dati e li assegna ai rappresentanti commerciali — il tutto senza intervento umano. Un agente di triage dei contenuti categorizza i ticket di supporto, li instrada agli specialisti ed escala i casi limite agli umani.

In questa guida, imparerai come progettare agenti affidabili, integrarli con i sistemi aziendali, prevenire i guasti comuni e misurarne l’impatto. Copriremo pattern reali utilizzati in produzione in aziende che automatizzano la qualificazione dei lead, l’elaborazione di documenti e il supporto clienti su larga scala.

Cosa sono gli agenti AI e in cosa differiscono dai chatbot?

Definizione di agenti AI (sistemi autonomi che percepiscono, decidono, agiscono)

Un agente AI è un sistema software che:

- Percepisce il proprio ambiente (legge input, risultati degli strumenti, memoria)

- Ragiona sull’azione migliore (usa un LLM per pianificare)

- Agisce chiamando strumenti o intraprendendo passi verso un obiettivo

- Si adatta in base al feedback e ai risultati

Gli agenti sono orientati agli obiettivi. Definisci l’obiettivo (“Valuta e qualifica questo lead”), e l’agente capisce come raggiungerlo.

Distinzione chiave: i chatbot sono reattivi; gli agenti sono autonomi

Chatbot: l’utente inizia → il modello risponde

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

L’utente guida ogni interazione. Il chatbot è stateless — ogni messaggio è indipendente.

Agenti: orientati agli obiettivi, intraprendono azioni senza input utente ad ogni passo

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

L’agente lavora verso un obiettivo definito, prendendo più decisioni e chiamate a strumenti in modo autonomo.

Perché gli agenti sono importanti per i flussi di lavoro

Automazione su larga scala (gestire migliaia di attività senza intervento umano)

Qualificazione manuale dei lead: 5 minuti per lead × 100 lead = 500 ore/mese. Costo: 10.000 $/mese (a 20 $/ora).

Guidata dall’agente: 10 secondi per lead × 100 lead = 16 ore/mese. Costo: 100 $ (chiamate API dell’agente). Risparmio: 99%.

Gli agenti moltiplicano la capacità del tuo team senza assumere.

Ragionamento multi-step (scomporre problemi complessi in sotto-task)

Le attività complesse richiedono più passaggi:

- Qualificazione lead: Valuta → Arricchisci → Assegna → Notifica

- Triage documenti: Estrai → Classifica → Instrada → Archivia

- Supporto clienti: Comprendi → Cerca knowledge base → Genera risposta → Instrada se necessario

Gli agenti gestiscono questo ragionamento automaticamente. Tu definisci l’obiettivo; l’agente lo scompone in passaggi.

Uso di strumenti (gli agenti chiamano API, database, servizi esterni)

Gli agenti sono “mani”. Chiamano API per:

- Interrogare database

- Aggiornare sistemi CRM

- Inviare email o messaggi Slack

- Chiamare servizi di terze parti (arricchimento dati, elaborazione pagamenti)

Un singolo agente può orchestrare 5-10 chiamate a strumenti per completare un flusso di lavoro.

Comportamento adattivo (imparare dal feedback, aggiustare l’approccio)

Gli agenti possono migliorare nel tempo. Se un agente classifica male i documenti, fornisci feedback. L’agente impara e aggiusta la sua strategia di prompting.

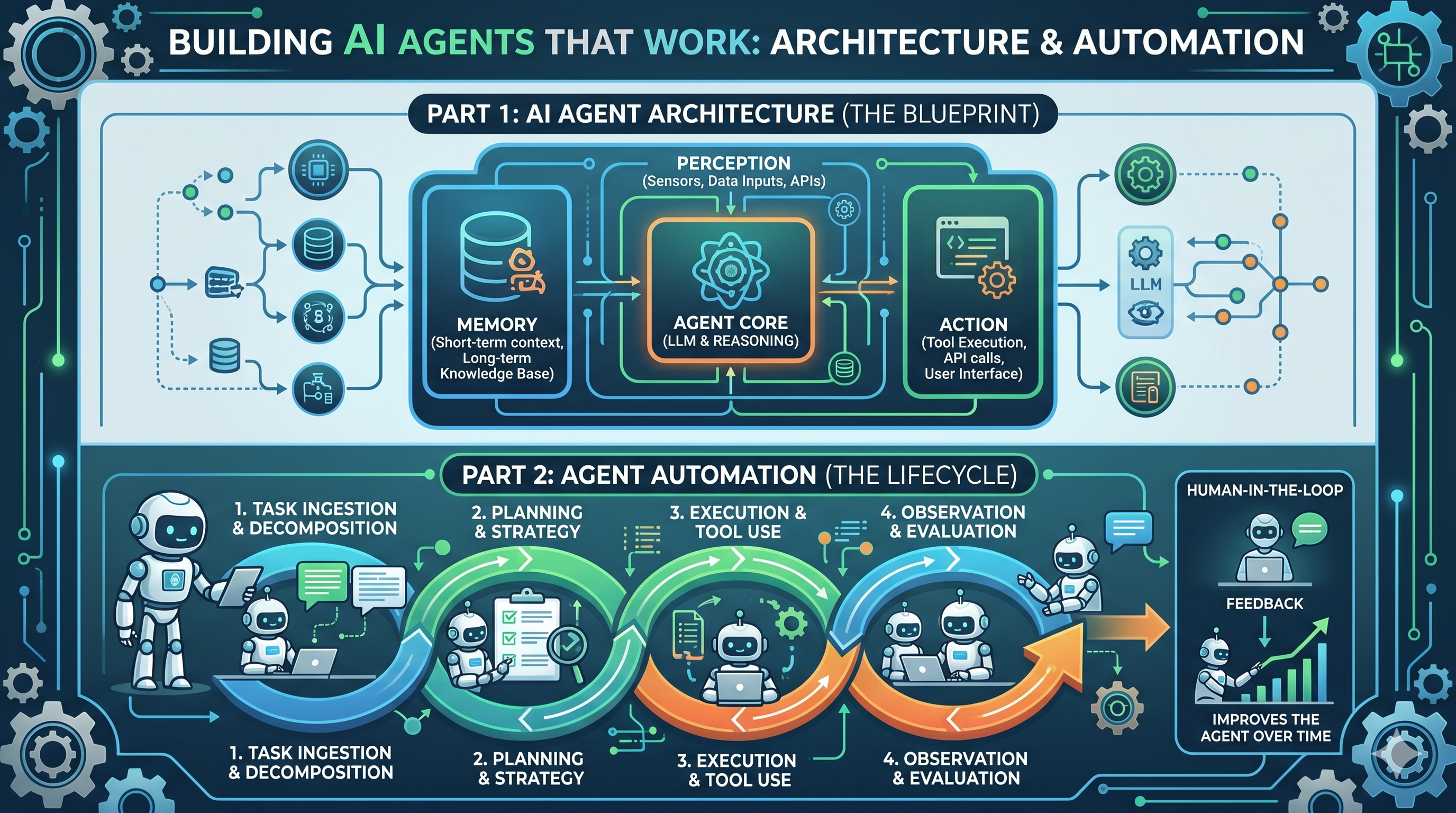

Componenti principali di un agente AI (il loop dell’agente)

Il loop di ragionamento dell’agente (con descrizione del diagramma)

Il nucleo di ogni agente è un loop:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Osservazione: l’agente percepisce lo stato (input, ambiente, risultati degli strumenti)

L’agente legge:

- Input iniziale (dati del lead, testo del documento, domanda del cliente)

- Risultati degli strumenti dai passaggi precedenti (risposte API, query sul database)

- Memoria (cronologia conversazione, decisioni passate, knowledge base)

- Stato attuale (cosa è stato fatto, cosa resta)

Ragionamento: l’LLM decide l’azione successiva (pianificazione, selezione strumenti)

L’LLM riceve un prompt come:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

L’LLM risponde: “Dovrei prima arricchire il lead per ottenere i dati di fatturato, poi valutare, poi assegnare.”

Azione: esegui la chiamata allo strumento o avanza verso l’obiettivo

L’agente esegue lo strumento selezionato:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: valuta il risultato, aggiusta la strategia se necessario

L’agente controlla: la chiamata allo strumento è riuscita? Ha avvicinato all’obiettivo? Aggiorna memoria e continua il loop.

Loop: ripeti finché l’obiettivo non è raggiunto o si raggiungono i passi massimi

L’agente ripete osservazione → ragionamento → azione → feedback finché:

- L’obiettivo è raggiunto (“Lead valutato e assegnato”)

- Passi massimi raggiunti (previene loop infiniti)

- Si verifica un errore (escalare a un umano)

Integrazione degli strumenti (le “mani” dell’agente)

Definire gli strumenti (firme di funzioni, descrizioni, parametri)

Gli strumenti sono funzioni che l’agente può chiamare. Definiscili chiaramente:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Descrizioni chiare aiutano l’LLM a scegliere lo strumento giusto.

Chiamata agli strumenti (come gli agenti selezionano e invocano gli strumenti)

L’LLM risponde con una chiamata allo strumento:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Il tuo framework di agenti esegue lo strumento e restituisce il risultato all’LLM.

Gestione dei risultati degli strumenti (parsing delle risposte, recupero da errori)

Gestisci sia il successo che il fallimento:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Se uno strumento fallisce, l’agente dovrebbe provare un approccio diverso o escalare a un umano.

Sistemi di memoria (cosa ricordano gli agenti)

Memoria a breve termine (contesto della conversazione corrente)

La memoria di lavoro dell’agente: input corrente, risultati degli strumenti, passi di ragionamento. Solitamente memorizzata nella finestra di contesto (il prompt).

Esempio: un agente di qualificazione lead ricorda:

- Dati originali del lead

- Risultati di arricchimento

- Punteggio

- Quale rappresentante commerciale è stato assegnato

Memoria a lungo termine (knowledge base, interazioni passate)

Memoria persistente: decisioni passate, pattern appresi, knowledge base.

Casi d’uso:

- Knowledge base: l’agente recupera articoli rilevanti quando risponde alle domande dei clienti

- Storia delle decisioni: l’agente impara quali lead hanno convertito (migliora la valutazione)

- Log delle interazioni: l’agente ricorda interazioni passate con un cliente

Implementa con database vettoriali (Pinecone, Weaviate) per la ricerca semantica.

Limitazioni della memoria (vincoli della finestra di contesto)

Gli LLM hanno finestre di contesto finite (4K-128K token). Gli agenti non possono ricordare tutto. Strategie:

- Riassunto: comprimi le vecchie conversazioni in riassunti

- Generazione aumentata dal recupero (RAG): recupera solo la memoria rilevante al bisogno

- Memoria gerarchica: mantieni le interazioni recenti a breve termine, quelle più vecchie a lungo termine

Colonna vertebrale del ragionamento (il “cervello”)

Selezione dell’LLM (GPT-4, Claude, modelli open-source)

- GPT-4: migliore ragionamento, gestisce compiti complessi. Costo: 0,03-0,06 $ per 1K token.

- Claude 3.5 Sonnet: ragionamento forte, contesto lungo (200K token). Costo: 0,003-0,015 $ per 1K token.

- Open-source (LLaMA 4): più economico (0,01-0,03 $ per 1M token), personalizzabile, rispettoso della privacy.

Per la maggior parte degli agenti, Claude o i modelli open-source sono sufficienti e più economici.

Modalità di ragionamento (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought: l’agente pensa passo dopo passo. “Devo arricchire → valutare → assegnare.”

- Tree-of-thought: l’agente esplora più percorsi, sceglie il migliore. Più lento ma più accurato per problemi complessi.

- Reflexion: l’agente critica il proprio output, riprova se necessario. Riduce le allucinazioni.

Esempio di prompt reflexion:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Compromessi: velocità vs. accuratezza

- Agenti veloci: ragionamento a turno singolo, nessuna validazione degli strumenti. 2-5 secondi per attività. 85% di accuratezza.

- Agenti accurati: ragionamento multi-step, validazione, reflexion. 10-30 secondi per attività. 95% di accuratezza.

Scegli la velocità per il tempo reale (supporto clienti). Scegli l’accuratezza per alta posta in gioco (decisioni finanziarie).

Tipi di agenti e quando usare ciascuno

Agenti reattivi (semplici, veloci, stateless)

Come funzionano (turno singolo: input → azione)

Gli agenti reattivi prendono una singola decisione e agiscono. Nessuna pianificazione multi-step.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

Migliori per: uso semplice di strumenti, chiamate API, risposte immediate

- Q&A servizio clienti (cercare ordine, controllare saldo)

- Chiamate API semplici (ottenere meteo, controllare prezzo delle azioni)

- Risposte immediate necessarie (< 2 secondi di latenza)

Esempio: chatbot del servizio clienti con ricerca in knowledge base

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latenza: 1-3 secondi. Costo: 0,001-0,01 $ per query.

Agenti di pianificazione (orientati agli obiettivi, ragionamento multi-step)

Come funzionano (scompongono l’obiettivo in sotto-task, eseguono il piano)

Gli agenti di pianificazione scompongono obiettivi complessi in passaggi.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

Migliori per: flussi di lavoro complessi, compiti di ricerca, analisi dati

- Qualificazione lead (arricchisci → valuta → assegna)

- Elaborazione documenti (estrai → classifica → archivia)

- Compiti di ricerca (cerca → riassumi → compila)

Esempio: agente di qualificazione lead (valuta → arricchisci → assegna)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latenza: 5-15 secondi. Costo: 0,02-0,05 $ per lead.

Agenti che apprendono (adattivi, migliorano nel tempo)

Come funzionano (incorporano feedback, aggiustano il comportamento)

Gli agenti che apprendono migliorano con il feedback.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

Migliori per: processi di lunga durata, personalizzazione, ottimizzazione

- Raccomandazione di contenuti (impara le preferenze dell’utente)

- Instradamento del supporto clienti (impara quali agenti gestiscono meglio quali problemi)

- Ottimizzazione dei prezzi (impara quali prezzi convertono meglio)

Esempio: agente di raccomandazione di contenuti (impara le preferenze dell’utente)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Nel tempo, le raccomandazioni migliorano mentre l’agente impara le preferenze dell’utente.

Agenti gerarchici (agenti che gestiscono altri agenti)

Come funzionano (l’agente supervisore delega a specialisti)

Un agente supervisore coordina agenti specialisti.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

Migliori per: flussi di lavoro aziendali, automazione su larga scala

- Creazione di contenuti (agenti di ricerca → scrittura → editing → pubblicazione)

- Supporto clienti complesso (agenti di triage → risoluzione → escalation)

- Pipeline di elaborazione dati (agenti di estrazione → trasformazione → caricamento)

Esempio: pipeline di creazione di contenuti (ricerca → scrittura → editing → pubblicazione)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Ogni agente specialista è ottimizzato per il suo compito. Il supervisore orchestra.

I migliori strumenti e framework per agenti AI nel 2026 (tabella di confronto)

Criteri di valutazione

Capacità di ragionamento (Chain-of-Thought, pianificazione, Reflexion)

Quanto è sofisticato il pensiero dell’agente. Gli agenti semplici usano chain-of-thought. Gli agenti complessi usano pianificazione e reflexion.

Integrazione degli strumenti (quanto è facile aggiungere strumenti personalizzati)

Puoi collegare facilmente API, database, sistemi CRM? O hai bisogno di codice personalizzato?

Curva di apprendimento (tempo di configurazione, qualità della documentazione)

Quanto velocemente uno sviluppatore può ottenere un agente funzionante? Le piattaforme no-code sono più veloci; i framework Python più flessibili.

Modello di pricing (gratuito, per chiamata API, abbonamento)

Alcuni framework sono open-source (gratuiti). Altri fanno pagare per chiamata API o abbonamento.

Migliori casi d’uso

Per cosa è ottimizzato ciascuno strumento?

Tabella di confronto: migliori strumenti e framework per agenti AI (2026)

| Strumento | Tipo di framework | Capacità di ragionamento | Integrazione strumenti | Curva di apprendimento | Prezzi | Migliore per |

|---|---|---|---|---|---|---|

| n8n | Costruttore visivo di flussi | Chain-of-thought | 500+ integrazioni | Bassa | Gratuito + a pagamento | Utenti non tecnici, configurazione rapida |

| CrewAI | Framework Python | Pianificazione + reflexion | Strumenti personalizzati (Python) | Media | Open-source | Sviluppatori, agenti complessi |

| Autogen | Framework Python | Ragionamento multi-agente | Strumenti personalizzati | Alta | Open-source | Ricerca, sistemi multi-agente |

| LangGraph | Framework Python | Pianificazione + gestione stato | Ecosistema LangChain | Media | Open-source | Flussi complessi, tracciamento stato |

| FlowHunt | Piattaforma nativa | Chain-of-thought + pianificazione | Nativo + integrazioni API | Bassa | Abbonamento | Automazione flussi, facilità d’uso |

| Lindy.ai | Piattaforma no-code | Chain-of-thought | 100+ integrazioni | Molto bassa | Freemium | Non tecnico, agenti rapidi |

| Gumloop | Piattaforma no-code | Chain-of-thought | 50+ integrazioni | Molto bassa | Freemium | Automazione semplice, template |

Differenze chiave:

- No-code (n8n, FlowHunt, Lindy.ai): veloce da costruire, personalizzazione limitata. Buono per flussi standard.

- Framework Python (CrewAI, Autogen, LangGraph): flessibile, potente, curva di apprendimento più ripida. Buono per logica complessa.

- Open-source (CrewAI, Autogen, LangGraph): gratuito, ma gestisci l’infrastruttura. Le piattaforme a pagamento gestiscono l’hosting.

Come scegliere lo strumento giusto per il tuo caso d’uso

- Prototipo rapido (< 1 settimana): usa no-code (FlowHunt, n8n, Lindy.ai)

- Agente complesso con logica personalizzata: usa un framework Python (CrewAI, LangGraph)

- Sistema multi-agente (agenti coordinati): usa Autogen

- Automazione di flussi in produzione: usa FlowHunt (gestito, monitorato, scalato)

Costruire il tuo primo agente: architettura passo-passo

Definisci l’obiettivo e l’ambito dell’agente

Quale problema risolve?

Sii specifico. Cattivo: “Automatizza la gestione dei lead.” Buono: “Valuta i lead da 0 a 100, arricchisci con dati aziendali, assegna ai rappresentanti commerciali in base alla capacità.”

Quali sono le metriche di successo?

- Accuratezza: % di decisioni corrette (target: > 90%)

- Latenza: tempo per completare il compito (target: < 10 secondi)

- Costo: chiamate API per compito (target: < 0,05 $)

- Tasso di automazione: % di compiti completati senza intervento umano (target: > 80%)

Quali sono i vincoli (latenza, costo, accuratezza)?

Compromessi:

- Flussi in tempo reale: necessitano di latenza < 5 secondi. Usa modelli veloci, meno chiamate a strumenti.

- Flussi in batch: possono tollerare 5-30 minuti. Usa ragionamento più accurato, più chiamate a strumenti.

- Sensibili al costo: usa modelli open-source, meno chiamate API.

- Critici per l’accuratezza: usa modelli costosi (GPT-4), validazione multi-step.

Progetta il loop dell’agente

Cosa osserverà l’agente?

Dati di input: dati del lead, testo del documento, domanda del cliente, contesto dalla memoria.

Quale modalità di ragionamento (chain-of-thought semplice vs. pianificazione)?

- Chain-of-thought: veloce, semplice. “Farò il passo 1, poi il passo 2.”

- Pianificazione: più lento, più accurato. “Pianifico prima tutti i passi, poi eseguo.”

Di quali strumenti ha bisogno?

Elenca le API, database, servizi che l’agente chiamerà.

Esempio per la qualificazione dei lead:

- API CRM (ottieni/aggiorna lead)

- API di arricchimento dati (ottieni dati aziendali)

- Modello di valutazione (valuta lead)

- Servizio di notifica (invia Slack/email)

Come sa quando fermarsi?

Definisci la condizione di successo. “Fermati quando il lead è valutato e assegnato.”

Definisci anche i passi massimi per prevenire loop infiniti. “Fermati dopo 10 passi, indipendentemente.”

Implementa e testa

Pseudocodice o esempio di codice reale (CrewAI o FlowHunt)

Esempio CrewAI:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Strategia di test (test unitari per chiamate a strumenti, test di integrazione per loop)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Debug di problemi comuni (loop infiniti, allucinazioni, strumenti sbagliati)

- Loop infiniti: aggiungi limite di passi massimi. Logga ogni passo. Monitora azioni ripetute.

- Allucinazioni: aggiungi validazione. Verifica i fatti con i dati di origine.

- Strumenti sbagliati: migliora le descrizioni degli strumenti. Aggiungi validazione dello strumento prima dell’esecuzione.

Esempio reale: agente di qualificazione dei lead

Obiettivo: valuta i lead, arricchisci i dati, assegna al team commerciale

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Strumenti: API CRM, servizio di arricchimento dati, modello di valutazione

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Walkthrough dello pseudocodice (osserva lead → valuta → arricchisci → assegna)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Risultati: metriche di accuratezza, latenza, costo

- Accuratezza: 94% (il punteggio del lead corrisponde alla revisione manuale)

- Latenza: 8 secondi (5 chiamate a strumenti, 3 passi di ragionamento LLM)

- Costo: 0,03 $ per lead (chiamate API GPT-4 + API di arricchimento)

- Throughput: 450 lead/ora (singola istanza di agente)

- Tasso di automazione: 87% (13% escalato a un umano per revisione)

Integrazione degli agenti con i sistemi aziendali

Pattern di integrazione API

API REST (le più comuni)

La maggior parte degli agenti chiama API REST. Usa un client HTTP standard:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhook (trigger di agenti basati su eventi)

Attiva agenti su eventi (nuovo lead, email in arrivo, invio modulo):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Autenticazione e sicurezza (chiavi API, OAuth, rate limiting)

- Chiavi API: memorizza nelle variabili d’ambiente, non nel codice

- OAuth: per integrazioni rivolte all’utente (Salesforce, HubSpot)

- Rate limiting: rispetta i limiti API. Implementa logica di backoff e retry

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Integrazione con il database

Sola lettura (l’agente interroga i dati)

L’agente legge dati dei clienti, interazioni passate, knowledge base:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Operazioni di scrittura (l’agente memorizza decisioni/risultati)

L’agente scrive decisioni nel database:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transazioni e coerenza (assicurare l’integrità dei dati)

Usa transazioni per operazioni multi-step:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Integrazione CRM e strumenti aziendali

Pattern di integrazione Salesforce, HubSpot, Pipedrive

Usa SDK ufficiali:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Integrazione Slack, email, Jira (l’agente invia notifiche/aggiornamenti)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Autenticazione e definizione dei permessi

Usa gli scope OAuth per limitare ciò che gli agenti possono fare:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Flussi di lavoro human-in-the-loop

Quando gli agenti necessitano di approvazione umana

Decisioni ad alto rischio: transazioni finanziarie, rimborsi ai clienti, eccezioni alla policy.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Pattern di escalation (decisioni ad alto rischio, casi limite)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Cicli di feedback (gli umani correggono gli errori dell’agente)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Guasti comuni degli agenti e come prevenirli

Loop infiniti (l’agente si blocca ripetendo la stessa azione)

Causa: definizione degli obiettivi scarsa, strumento che non fa progressi

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

Prevenzione: limite di passi massimi, tracciamento del progresso, diversità degli strumenti

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Recupero: timeout, escalation a un umano

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Allucinazioni (l’agente inventa fatti o output degli strumenti)

Causa: tendenza dell’LLM a confabulare, descrizioni scarse degli strumenti

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

Prevenzione: Retrieval-Augmented Generation (RAG), validazione degli strumenti, fact-checking

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Usa RAG per ancorare l’agente ai fatti:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Recupero: fallback a un umano, riprova con ragionamento diverso

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Uso improprio degli strumenti (l’agente chiama lo strumento sbagliato o con parametri sbagliati)

Causa: descrizioni ambigue degli strumenti, ragionamento scarso

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prevenzione: documentazione chiara degli strumenti, training sull’uso degli strumenti, validazione prima dell’esecuzione

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Recupero: gestione errori, suggerire lo strumento corretto, riprovare

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Sforamenti di costo (l’agente usa troppe chiamate API)

Causa: ragionamento inefficiente, chiamate ridondanti agli strumenti

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

Prevenzione: limiti di budget, deduplicazione delle chiamate, caching

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementa il caching:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Recupero: monitoraggio dei costi, throttling, fallback a modelli più economici

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Problemi di latenza (agente troppo lento per l’uso in tempo reale)

Causa: più passi di ragionamento, risposte lente degli strumenti

Un agente che effettua 5 chiamate API sequenziali di 1 secondo ciascuna = 5+ secondi di latenza.

Prevenzione: esecuzione parallela degli strumenti, caching, modelli più veloci

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Usa modelli più veloci:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Recupero: timeout, restituire risultati parziali, mettere in coda per async

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Misurare le performance e il ROI dell’agente

Metriche chiave da monitorare

Accuratezza (% di decisioni/azioni corrette)

Confronta l’output dell’agente con la verità di riferimento (revisione umana, risultati effettivi).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latenza (tempo per completare il compito)

Misura il tempo end-to-end dall’input all’output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Costo per compito (chiamate API, calcolo, revisione umana)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Soddisfazione utente (se human-in-the-loop)

Sondaggio agli utenti: “Quanto sei soddisfatto delle decisioni dell’agente?”

Tasso di automazione (% di compiti completati senza intervento umano)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Calcolo del ROI

Baseline: costo del processo manuale (ore umane × tariffa oraria)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Costo dell’agente: infrastruttura + chiamate API + supervisione umana

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Periodo di payback: quando il costo dell’agente < costo manuale

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Esempio: ROI dell’agente di qualificazione dei lead

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Miglioramento continuo

Monitora le metriche nel tempo

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

A/B test di diverse configurazioni di agenti

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Incorpora il feedback per migliorare l’accuratezza

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Scala gli agenti di successo, ritira quelli poco performanti

Monitora il ROI. Se un agente non sta fornendo valore, ritiralo. Scala gli agenti di successo ad altri team.

Domande frequenti

La sezione FAQ è generata automaticamente dal frontmatter e appare sotto.

{{ cta-dark-panel heading=“Costruisci agenti senza la complessità” description=“La piattaforma nativa di agenti di FlowHunt gestisce integrazione degli strumenti, gestione degli errori e monitoraggio. Inizia a costruire flussi di lavoro autonomi in pochi minuti, non settimane.” ctaPrimaryText=“Prova FlowHunt gratis” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Prenota una demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}