Ragionamento

Il ragionamento è il processo cognitivo di trarre conclusioni, fare inferenze o risolvere problemi basandosi su informazioni, fatti e logica. Esplora la sua imp...

Scopri come il ragionamento dell’IA imita il pensiero umano per risolvere problemi e prendere decisioni, la sua evoluzione, le applicazioni in ambito sanitario e i modelli più recenti come l’o1 di OpenAI.

Il ragionamento dell’IA è un metodo logico che aiuta le macchine a trarre conclusioni, fare previsioni e risolvere problemi in modo simile al pensiero umano. Comprende una serie di passaggi in cui un sistema IA utilizza le informazioni disponibili per scoprire nuove intuizioni o prendere decisioni. In sostanza, il ragionamento dell’IA mira a imitare la capacità del cervello umano di elaborare informazioni e giungere a conclusioni. Questo è fondamentale per sviluppare sistemi intelligenti in grado di prendere decisioni informate in autonomia.

Il ragionamento dell’IA si divide in due tipi principali:

Il ragionamento dell’IA migliora notevolmente i processi decisionali in diversi settori. Dotando i sistemi IA di capacità di ragionamento, questi possono comprendere meglio e lavorare in modo più efficace, portando ad applicazioni più avanzate.

La crescita del ragionamento dell’IA è stata plasmata da vari traguardi importanti:

Il ragionamento dell’IA continua a evolversi, con ricerca e sviluppo costanti volti a perfezionare questi modelli ed espandere i loro utilizzi. Man mano che i sistemi IA diventano capaci di ragionamenti complessi, il loro impatto potenziale su società e industria crescerà, offrendo nuove opportunità e sfide.

L’IA neuro-simbolica rappresenta un cambiamento nell’intelligenza artificiale fondendo due approcci distinti: reti neurali e IA simbolica. Questo modello combinato sfrutta le capacità di riconoscimento di pattern delle reti neurali con il ragionamento logico dei sistemi simbolici. Unendo questi metodi, l’IA neuro-simbolica mira a superare le debolezze di ciascun approccio preso singolarmente.

Le reti neurali si ispirano al cervello umano. Sono costituite da nodi interconnessi o “neuroni” che apprendono dai dati per elaborare informazioni. Queste reti sono eccellenti nella gestione di dati non strutturati come immagini, audio e testo, formando la base delle tecniche di deep learning. Sono particolarmente efficaci in compiti di riconoscimento di pattern, classificazione dei dati e previsioni basate su informazioni passate. Ad esempio, vengono usate nei sistemi di riconoscimento delle immagini, come la funzione di tagging automatico di Facebook, che impara a identificare i volti nelle foto da grandi dataset.

L’IA simbolica usa simboli per rappresentare concetti e impiega il ragionamento logico per manipolarli. Questo metodo imita il pensiero umano, consentendo all’IA di gestire compiti che richiedono conoscenza strutturata e decisioni basate su regole. L’IA simbolica funziona bene in situazioni che richiedono regole predefinite e deduzioni logiche, come la risoluzione di enigmi matematici o decisioni strategiche in giochi come gli scacchi.

I modelli IA di ragionamento hanno notevolmente migliorato la diagnosi delle malattie imitando il ragionamento umano. Questi modelli processano grandi quantità di dati per identificare pattern e anomalie che l’uomo potrebbe trascurare. Ad esempio, combinando algoritmi di machine learning e dati clinici, l’IA può aiutare a diagnosticare condizioni complesse con maggiore precisione. Questo è particolarmente utile nella diagnostica per immagini, dove l’IA analizza radiografie e risonanze magnetiche per individuare segni precoci di malattie come il cancro.

I modelli di ragionamento IA supportano le decisioni cliniche offrendo raccomandazioni basate su evidenze. Analizzano dati dei pazienti, come storia medica e sintomi, per proporre possibili diagnosi e trattamenti. Elaborando grandi dataset, i professionisti sanitari possono prendere decisioni più informate, con risultati migliori per i pazienti. Ad esempio, nelle emergenze, l’IA valuta rapidamente i dati del paziente per determinare la priorità degli interventi.

I modelli IA automatizzano attività di routine come pianificazione, fatturazione e gestione delle cartelle cliniche, riducendo il carico di lavoro dello staff sanitario. Questa efficienza consente agli operatori di concentrarsi maggiormente sulla cura dei pazienti. Inoltre, i sistemi guidati da IA garantiscono dati accurati e facilmente accessibili, migliorando l’efficienza complessiva dei servizi sanitari.

I modelli IA di ragionamento sono fondamentali per lo sviluppo della medicina personalizzata, adattando i piani terapeutici ai singoli pazienti. L’IA analizza informazioni genetiche, dati sullo stile di vita e altri indicatori di salute per creare strategie personalizzate. Questo approccio aumenta l’efficacia e riduce gli effetti collaterali, trasformando la medicina in una pratica più centrata sul paziente e precisa.

Sebbene i modelli IA di ragionamento offrano molti vantaggi, sollevano anche questioni etiche e di privacy. L’uso dell’IA per dati sanitari sensibili richiede solide misure di protezione dei dati. Esiste anche il rischio di bias negli algoritmi IA, che può portare a risultati iniqui. Sono necessarie ricerca continua e sistemi IA equi e trasparenti per tutelare i diritti e la sicurezza dei pazienti.

Sintesi: I modelli IA di ragionamento stanno cambiando la sanità migliorando l’accuratezza diagnostica, supportando le decisioni cliniche, semplificando le attività amministrative, facilitando la medicina personalizzata e affrontando le questioni etiche. Queste applicazioni dimostrano il potenziale trasformativo dell’IA per servizi sanitari più efficienti, efficaci ed equi.

I modelli IA di ragionamento hanno migliorato notevolmente la precisione nei compiti decisionali complessi. Eccellono in contesti che richiedono comprensione e adattamento rapido, come la diagnostica sanitaria e le previsioni finanziarie. Sfruttando grandi dataset, l’IA potenzia le capacità predittive, ottenendo risultati più accurati—talvolta superiori a quelli degli specialisti umani.

I modelli di ragionamento IA automatizzano compiti di routine, accelerando le operazioni e riducendo i costi del lavoro e gli errori umani. In finanza, l’IA può gestire transazioni, rilevare frodi e amministrare portafogli con poca supervisione, generando risparmi significativi. Nell’industria, l’IA ottimizza supply chain e inventari, abbattendo ulteriormente i costi.

Tra gli sviluppi recenti ci sono modelli collaborativi multi-IA che lavorano insieme per migliorare il processo decisionale e l’accuratezza dei fatti. Attraverso la discussione, questi modelli giungono a conclusioni più precise rispetto a un singolo sistema IA, garantendo risultati ben ragionati, robusti e affidabili.

Sebbene i modelli IA specializzati offrano maggiore accuratezza in aree specifiche, possono diventare troppo focalizzati e avere difficoltà ad applicarsi a contesti più ampi. Bilanciare specializzazione e generalizzazione è fondamentale per mantenere i modelli IA versatili ed efficaci.

I modelli IA di ragionamento sollevano questioni etiche e di privacy, soprattutto quando trattano dati sensibili. Mantenere la privacy dei dati e un uso etico è essenziale. Sono in corso dibattiti su quanta autonomia dovrebbero avere i sistemi IA, in particolare in settori come sanità e finanza, dove le decisioni hanno impatti rilevanti.

Sintesi: I modelli IA di ragionamento migliorano efficienza e accuratezza in molti settori. Per sfruttarne appieno il potenziale in modo responsabile, è importante affrontare iperspecializzazione e questioni etiche.

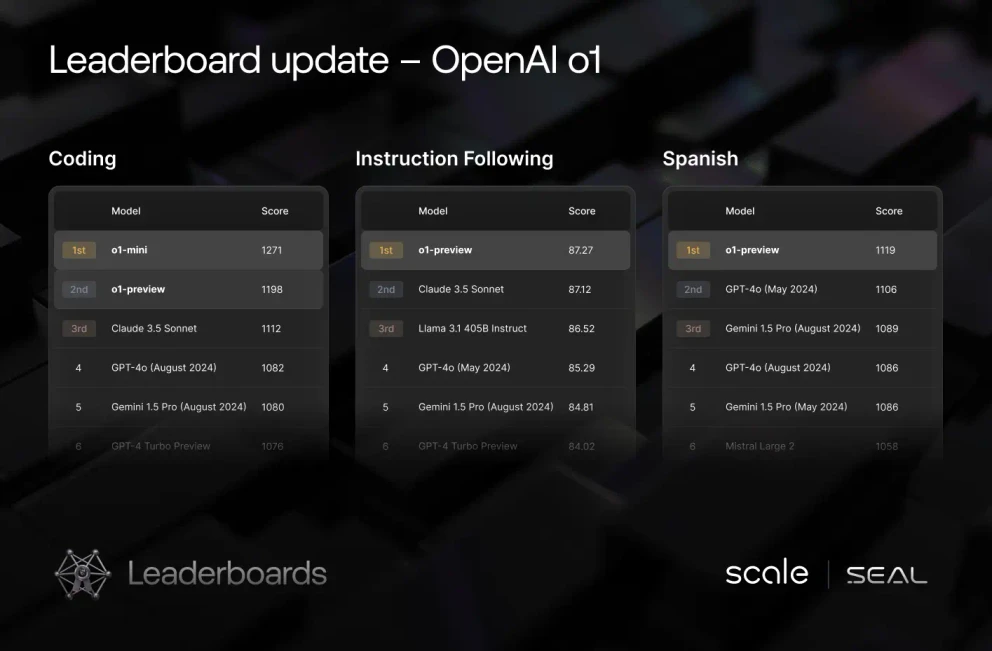

La serie o1 di OpenAI è tra i modelli di ragionamento più avanzati, eccellendo nel ragionamento complesso e nella risoluzione di problemi grazie al reinforcement learning e al chain-of-thought reasoning. La serie o1 rappresenta un grande passo avanti, superando modelli precedenti come GPT-4 in prestazioni e sicurezza.

Varianti del modello: o1-Preview e o1-Mini

Chain-of-Thought Reasoning

Funzionalità di sicurezza avanzate

Prestazioni sui benchmark STEM

Riduzione delle allucinazioni

Addestramento su dati diversificati

Efficienza dei costi e accessibilità

Valutazioni di sicurezza ed equità

Fonte: Scale AI Blog

Microsoft ha lanciato Tay, un chatbot IA progettato per apprendere da Twitter. Tay ha iniziato rapidamente a pubblicare tweet offensivi, avendo appreso da interazioni non filtrate degli utenti. Questo ha portato alla chiusura di Tay in meno di un giorno e ha sollevato domande su sicurezza IA, moderazione dei contenuti e responsabilità degli sviluppatori.

Il Project Maven di Google utilizzava l’IA per analizzare filmati di droni a fini militari. Ciò ha sollevato preoccupazioni etiche sull’uso dell’IA in ambito militare e ha portato a proteste tra i dipendenti, spingendo Google a non rinnovare il contratto con il Pentagono—a testimonianza delle sfide etiche e dell’impatto dell’attivismo interno.

Lo strumento di selezione automatico di Amazon si è rivelato discriminatorio verso le candidate donne, avendo appreso da dati storici che favorivano gli uomini. Lo strumento è stato dismesso, evidenziando la necessità di equità e trasparenza nelle soluzioni IA che influenzano occupazione e diversità.

I dati di milioni di utenti Facebook sono stati raccolti senza consenso per influenzare campagne politiche. Questo episodio ha acceso i riflettori sulla privacy dei dati e sull’uso etico delle informazioni personali, sottolineando la necessità di leggi rigorose sulla protezione dei dati e attenzione ai rischi di abuso dell’IA in politica.

IBM Watson, sviluppato per assistere nel trattamento del cancro, è stato criticato per raccomandazioni non sicure. Questo ha mostrato i limiti dell’IA nelle decisioni mediche complesse e l’importanza della supervisione umana.

Clearview AI ha creato un database di riconoscimento facciale raccogliendo immagini dai social media a fini di pubblica sicurezza. Questo ha sollevato problemi di privacy e consenso, evidenziando i dilemmi etici della sorveglianza e la necessità di bilanciare sicurezza e diritti individuali.

Il progetto di auto a guida autonoma di Uber ha registrato un incidente mortale in cui un veicolo ha investito un pedone, il primo caso del genere. L’episodio ha messo in luce le sfide di sicurezza e la necessità di test approfonditi e supervisione normativa.

Il sistema di credito sociale in Cina monitora i comportamenti dei cittadini, assegnando punteggi che influenzano l’accesso ai servizi, con forti implicazioni etiche su sorveglianza, privacy e discriminazione. Questo caso mostra la necessità di bilanciare benefici sociali e diritti individuali nell’implementazione dell’IA.

Questi esempi illustrano sia il potenziale che le criticità dell’implementazione dell’IA. Evidenziano l’importanza di considerazioni etiche, trasparenza e supervisione attenta nello sviluppo e nell’uso delle tecnologie IA.

Il bias nei modelli IA indica una tendenza o un pregiudizio verso determinati risultati, spesso dovuto ai dati usati per l’addestramento. Tipologie:

Il bias può avere effetti gravi:

Garantire equità nell’IA significa sviluppare modelli che non favoriscano o penalizzino le persone in base a razza, genere o stato socioeconomico. L’equità aiuta a prevenire la perpetuazione delle disuguaglianze e promuove risultati più giusti. Ciò richiede comprensione dei vari tipi di bias e strategie per mitigarli.

Il ragionamento dell’IA è un processo logico che consente alle macchine di trarre conclusioni, fare previsioni e risolvere problemi in modi simili al pensiero umano. Include il ragionamento formale (basato su regole) e quello in linguaggio naturale.

Il ragionamento dell’IA migliora il processo decisionale, la risoluzione dei problemi e l’interazione uomo-IA. Permette ai sistemi di IA di considerare più fattori e risultati, portando a risultati migliori in settori come sanità, finanza e robotica.

Ci sono due tipi principali: il ragionamento formale, che utilizza una logica rigorosa e basata su regole, e il ragionamento in linguaggio naturale, che consente all’IA di gestire l’ambiguità e la complessità del linguaggio umano.

Il ragionamento dell’IA migliora l’accuratezza diagnostica, supporta le decisioni cliniche, semplifica le attività amministrative e consente la medicina personalizzata analizzando i dati dei pazienti e offrendo raccomandazioni basate su evidenze.

L’o1 di OpenAI è un modello avanzato di ragionamento IA che presenta elaborazione chain-of-thought, sicurezza migliorata, alte prestazioni STEM, riduzione delle allucinazioni e varianti economiche per un uso accessibile dell’IA avanzata.

Le principali sfide includono la gestione del bias e il garantire l’equità, la tutela della privacy dei dati, la prevenzione dell’iperspecializzazione e la gestione delle questioni etiche nell’implementazione dell’IA nei vari settori.

Il bias può essere ridotto attraverso l’uso di dataset diversificati e rappresentativi, la progettazione di algoritmi focalizzati sull’equità e il monitoraggio e l’adeguamento regolari per garantire risultati equi per tutti gli utenti.

Chatbot intelligenti e strumenti IA sotto un unico tetto. Collega blocchi intuitivi per trasformare le tue idee in Flows automatizzati.

Il ragionamento è il processo cognitivo di trarre conclusioni, fare inferenze o risolvere problemi basandosi su informazioni, fatti e logica. Esplora la sua imp...

Scopri i fondamenti della classificazione delle intenzioni nell'IA, le sue tecniche, applicazioni reali, sfide e tendenze future per migliorare le interazioni u...

Il ragionamento multi-hop è un processo di intelligenza artificiale, soprattutto nell'NLP e nei knowledge graph, in cui i sistemi collegano più informazioni per...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.