Il Decennio degli Agenti AI: Karpathy sulla Timeline dell'AGI

Esplora la prospettiva sfumata di Andrej Karpathy sulle tempistiche dell’AGI, sugli agenti AI e sul motivo per cui il prossimo decennio sarà cruciale per lo svi...

Dario Amodei, CEO di Anthropic, si unisce a Lex Fridman per discutere il futuro dell’IA, incluse le leggi di scaling, le tempistiche dell’AGI, la sicurezza, l’interpretabilità e la regolamentazione.

Lo scaling è importante per rendere i modelli di IA più efficaci e capaci. La Legge di Scaling è l’idea che aumentare la dimensione dei modelli, aggiungendo più parametri, migliori le prestazioni dell’IA. Amodei discute di come lo scaling influenzi le capacità dei modelli, sottolineando che quelli più grandi dimostrano migliori abilità di apprendimento e ragionamento. L’argomento evidenzia la necessità di bilanciare la dimensione con l’efficienza delle reti neurali, potenzialmente dando luogo a importanti progressi nelle applicazioni IA.

Amodei prevede che l’IA possa raggiungere l’intelligenza a livello umano entro il 2026-2027. Questa previsione si basa sulle tendenze attuali della potenza di calcolo, dell’accesso ai dati e del rapido progresso della tecnologia IA. Le sue riflessioni riguardano non solo le tappe tecnologiche per raggiungere questo livello di intelligenza, ma anche le questioni etiche e filosofiche che ne derivano.

Una delle principali sfide è la concentrazione del potere dell’IA in poche entità forti. Amodei avverte che ciò può portare a un accesso diseguale alla tecnologia e a possibili abusi, aggravando le disuguaglianze globali e minacciando la democrazia. Per affrontare questo aspetto, è necessaria una distribuzione equa dei progressi dell’IA, così che tutti possano beneficiarne e nessuna singola entità monopolizzi la tecnologia.

È fondamentale comprendere come funziona l’IA internamente, nota come interpretabilità meccanicistica, per implementarla in modo sicuro. Amodei sottolinea la necessità di capire come l’IA prenda decisioni e faccia previsioni. Migliorando trasparenza e interpretabilità, i ricercatori possono prevedere meglio i comportamenti dell’IA, individuare bias e ridurre i rischi, specialmente man mano che questi sistemi diventano più autonomi in settori importanti come sanità, finanza e sicurezza nazionale.

La gerarchia dei modelli è una parte fondamentale dell’approccio IA di Anthropic. Amodei descrive come diverse dimensioni di modelli servano applicazioni differenti: dai modelli più piccoli per compiti quotidiani a quelli più grandi per esigenze specializzate. Questa strategia strutturata consente un uso adattabile dell’IA in numerosi ambiti, garantendo soluzioni adatte alle diverse esigenze industriali e sociali.

Il framework RSP di Anthropic evidenzia la loro dedizione alla sicurezza dell’IA tramite uno scaling responsabile. Questo framework include passaggi sistematici per scalare i modelli IA, assicurando che l’aumento delle capacità vada di pari passo con un uso sicuro, etico e socialmente responsabile. Con questo approccio, Anthropic mira ad affrontare le sfide etiche nello sviluppo dell’IA, promuovendo un progresso attento e innovativo.

Regolamentare l’IA è fondamentale per orientarne lo sviluppo verso obiettivi positivi e sicuri. Amodei sostiene quadri giuridici completi per governare le tecnologie IA, enfatizzando regolamenti che stabiliscano standard di sicurezza chiari e supervisione. Questo approccio proattivo mira a prevenire abusi dell’IA promuovendo al contempo progressi tecnologici che tutelino l’interesse pubblico e il benessere collettivo.

La discussione tocca anche i limiti posti dall’attuale potenza di calcolo e dalla disponibilità di dati, che potrebbero ostacolare i futuri sviluppi dell’IA. Superare questi ostacoli richiede l’esplorazione di nuovi metodi di calcolo, come il quantum computing, per sostenere le prossime evoluzioni dell’IA. Trovare soluzioni sostenibili e scalabili per la gestione dei dati è inoltre essenziale per superare le barriere, tutelando al contempo la privacy.

Le leggi di scaling dell’IA si riferiscono alla tendenza secondo cui l’aumento della dimensione e dei parametri dei modelli IA porta a migliori prestazioni. Dario Amodei sottolinea che i modelli più grandi generalmente mostrano migliori capacità di apprendimento e ragionamento, ma resta fondamentale bilanciare la dimensione con l’efficienza.

Dario Amodei prevede che l’IA potrebbe raggiungere l’intelligenza a livello umano tra il 2026 e il 2027, basandosi sulle tendenze della potenza di calcolo, dell’accesso ai dati e del rapido progresso tecnologico.

L’interpretabilità meccanicistica è cruciale perché aiuta i ricercatori a comprendere come i modelli IA prendano decisioni e facciano previsioni. Questa trasparenza consente di prevedere meglio il comportamento dell’IA, individuare bias e ridurre i rischi man mano che l’IA diventa più autonoma in settori critici.

Le principali sfide includono la concentrazione del potere dell’IA in poche entità, il possibile uso improprio, le disuguaglianze globali e le minacce alla democrazia. Garantire una distribuzione equa e una crescita responsabile delle tecnologie IA è fondamentale per mitigare queste sfide.

Dario Amodei sostiene quadri giuridici e regolamentari completi per stabilire standard di sicurezza chiari e una supervisione nello sviluppo dell’IA, con l’obiettivo di prevenire abusi proteggendo l’interesse pubblico e favorendo un progresso tecnologico responsabile.

Viktor Zeman è co-proprietario di QualityUnit. Anche dopo 20 anni alla guida dell'azienda, rimane principalmente un ingegnere del software, specializzato in IA, SEO programmatica e sviluppo backend. Ha contribuito a numerosi progetti, tra cui LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab e molti altri.

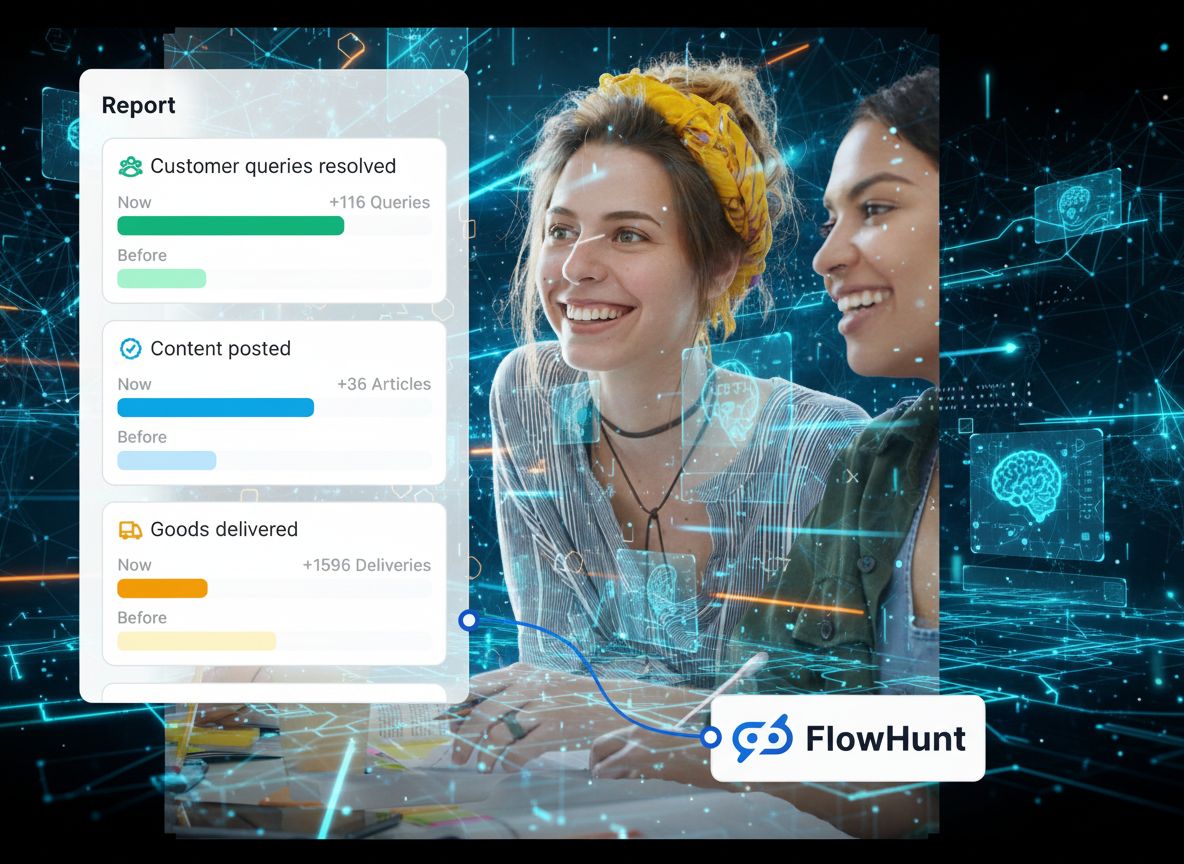

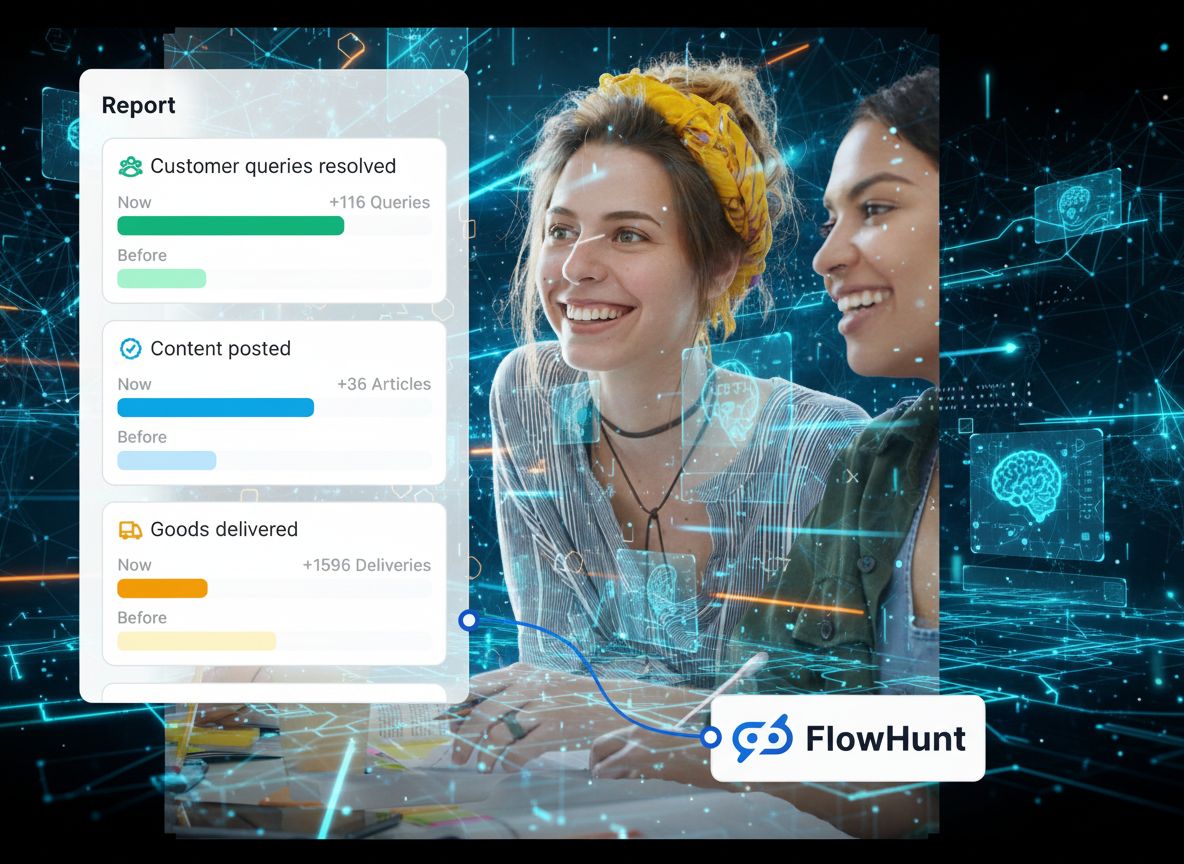

Scopri come puoi usare FlowHunt per creare chatbot e strumenti IA personalizzati. Inizia subito a creare Flows automatizzati senza sforzo.

Esplora la prospettiva sfumata di Andrej Karpathy sulle tempistiche dell’AGI, sugli agenti AI e sul motivo per cui il prossimo decennio sarà cruciale per lo svi...

Scopri come un minuscolo modello da 7 milioni di parametri supera Gemini, DeepSeek e Claude usando ragionamento ricorsivo e deep supervision. Approfondisci l'ap...

Esplora le preoccupazioni di Jack Clark, co-fondatore di Anthropic, sulla sicurezza dell'IA, la consapevolezza situazionale nei grandi modelli linguistici e il ...