One-Shot Prompting: Insegnare agli LLM a Creare Embed di YouTube

Scopri come FlowHunt ha utilizzato il one-shot prompting per insegnare agli LLM a trovare e incorporare video YouTube rilevanti in WordPress. Questa tecnica gar...

Un prompt è il testo di input che guida la risposta di un LLM; chiarezza, specificità e tecniche come few-shot o chain-of-thought migliorano la qualità dell’output AI.

I prompt svolgono un ruolo cruciale nel funzionamento dei LLM. Sono il principale meccanismo attraverso cui gli utenti interagiscono con questi modelli. Formulando in modo efficace le tue domande o istruzioni, puoi influenzare in modo significativo la qualità e la pertinenza delle risposte generate dal LLM. Prompt ben costruiti sono essenziali per sfruttare appieno il potenziale dei LLM, sia in ambito aziendale, nella creazione di contenuti o per scopi di ricerca.

I prompt vengono utilizzati in vari modi per guidare l’output di un LLM. Ecco alcuni approcci comuni:

Creare prompt efficaci richiede chiarezza e specificità. Ecco alcuni suggerimenti:

I ricercatori hanno scoperto che fornire esempi (few-shot prompting) o includere passaggi di ragionamento dettagliati (chain-of-thought prompting) può migliorare significativamente le prestazioni del modello. Ad esempio:

Strutturare il prompt in modo significativo può guidare il LLM a generare risposte più accurate e pertinenti. Ad esempio, se il compito riguarda il servizio clienti, puoi iniziare con un messaggio di sistema: “Sei un agente AI amichevole che può fornire assistenza al cliente riguardo al suo ultimo ordine.”

Un prompt è il testo di input fornito a un large language model (LLM) per guidarne la risposta. Può essere una domanda, un’istruzione o un contesto che aiuta il modello a generare un output pertinente.

Lo zero-shot prompting assegna al modello un compito senza esempi. Il one-shot include un esempio, mentre il few-shot fornisce molteplici esempi per guidare l’output dell’LLM.

Usa un linguaggio chiaro e specifico, fornisci il contesto rilevante e formula istruzioni positive. Includere esempi o ragionamenti passo-passo può migliorare la qualità delle risposte.

Il chain-of-thought prompting consiste nell’includere passaggi di ragionamento dettagliati all’interno del prompt per guidare l’LLM verso risposte accurate e ragionate.

Chatbot intelligenti e strumenti AI sotto lo stesso tetto. Collega blocchi intuitivi per trasformare le tue idee in Flussi automatizzati.

Scopri come FlowHunt ha utilizzato il one-shot prompting per insegnare agli LLM a trovare e incorporare video YouTube rilevanti in WordPress. Questa tecnica gar...

Un metaprompt nell'intelligenza artificiale è un'istruzione di alto livello progettata per generare o migliorare altri prompt per grandi modelli linguistici (LL...

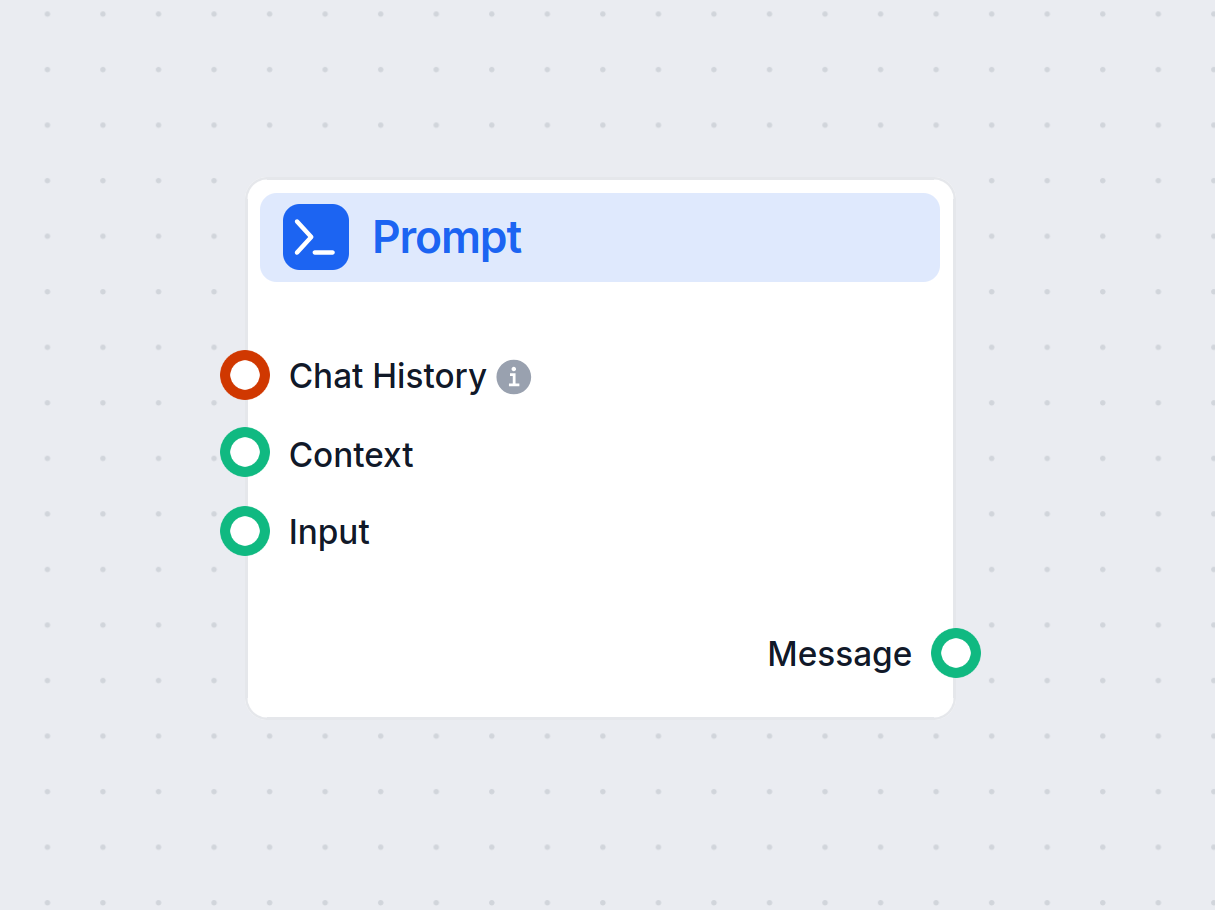

Scopri come il componente Prompt di FlowHunt ti permette di definire il ruolo e il comportamento del tuo bot AI, assicurando risposte pertinenti e personalizzat...