Slack連携

FlowHuntのSlack連携は、Slackワークスペース内でシームレスなAIコラボレーションを可能にします。あらゆるFlowをSlackに持ち込み、ワークフローの自動化、リアルタイムAIアシスタンスの提供、カスタマーサービスチャットの監視、生産性の向上など、チームが既に使っている場所で実現できます。...

FlowHuntのノーコードフロービルダーを使って、任意のLLM(Claude、GPT、Gemini、Grok、Llama、Mistral)をSlackに接続できます。セットアップはどのモデルでも同じ。ユースケースに合うモデルを選ぶだけで、数分でリリース可能です。

これまでSlackにAIアシスタントを追加するには、ベンダーを選び、連携コードを書き、6か月後により優れたモデルが登場するたびにすべてを再構築する必要がありました。FlowHuntを使えば、連携とモデルが切り離されます。Slackフローを一度構築すれば、あとは好きなLLM(Claude、GPT、Gemini、Grok、Llama、Mistral)を差し込むだけ。残りの部分に手を加えることなく、いつでも入れ替えられます。

このガイドでは、セットアップ全体を順を追って説明します。前半はどのモデルでも共通です。後半では、ユースケース別にどのモデルを選ぶべきかを、各LLMファミリー固有の注意点とともに解説します。お使いのスタックに合うセクションへ飛ぶか、ゼロから始める場合は最初から最後まで読み進めてください。

Slackはチームが質問をする場所です。そこに常駐するAIエージェントは、別のチャットツール、ダッシュボード、ナレッジベースに切り替えることなく、即座に答えを返します。一般的な活用例:

ボットはSlack内に住むため、定着は自動的です。新しいツールを学ぶ必要は誰にもありません。

セットアップは選択したAIモデルに関係なく同一です。モデルはステップ4で選択し、それ以外はすべて同じです。

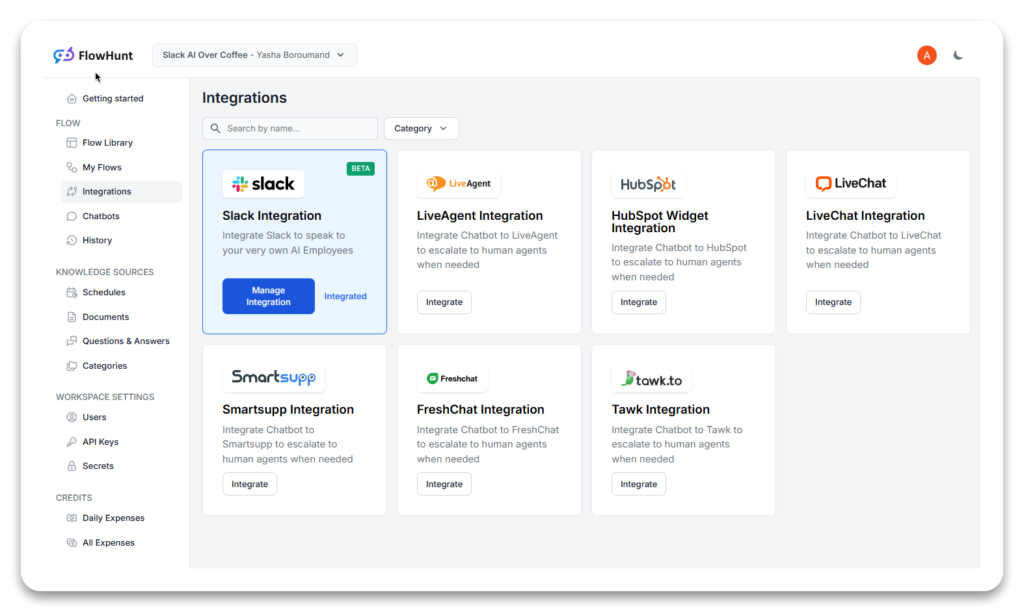

FlowHunt アカウントにログインし、Integrationsタブを開きます。Slackを選択し、Connectをクリックして、SlackのOAuth画面でアプリを承認します。FlowHuntが要求する読み書きの権限を付与してください。これによりボットがメッセージを受信し、ワークスペース内で返信を投稿できるようになります。

ワークスペースのURLは、SlackデスクトップまたはWebアプリの左上に表示されています。FlowHuntに尋ねられたらそこからコピーしてください。承認が完了すると、Slackは接続され、任意のフローで使用できる状態になります。

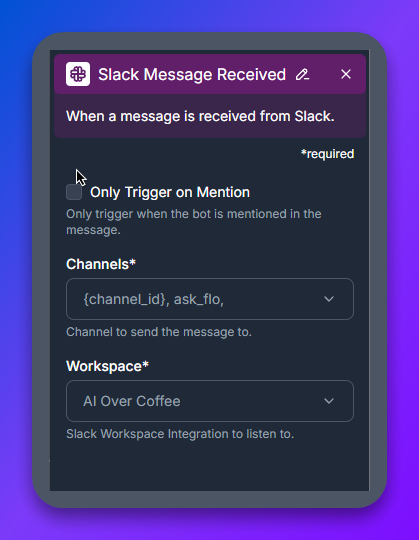

FlowHuntのフロービルダーで、Slack Message Receivedコンポーネントをキャンバスにドロップします。このブロックが受信Slackメッセージをリッスンし、フローの残りをトリガーします。

2つの設定を構成します:

#ai-assistantチャンネルが最もすっきりした構成です。

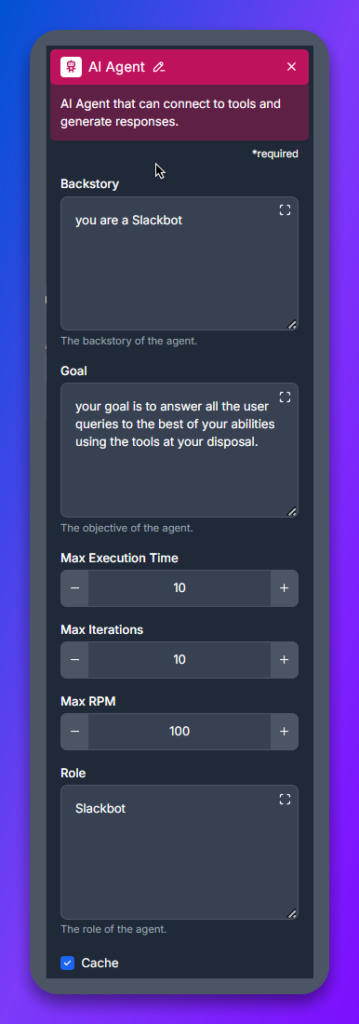

AI Agentブロックはボットの推論層です。ユーザーのメッセージを受け取り、使用するツールを判断し、応答を生成します。

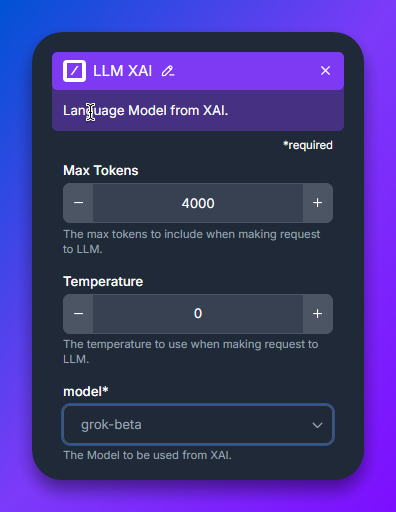

LLMコンポーネントをAI Agentに接続します。ここでボットを動かすAIモデルを選びます。FlowHuntにはプロバイダーごとに別々のLLMコンポーネント(LLM OpenAI、LLM Anthropic、LLM Google、LLM Meta、LLM Mistral、LLM xAI)が用意されており、各コンポーネント内で具体的なモデルバリアントを選択します。

これがモデルごとに異なる唯一のステップです。比較とファミリー別のメモについては、下の適切なAIモデルを選ぶ セクションをご覧ください。

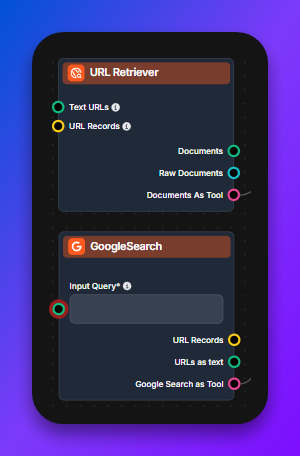

AI Agentはツールを使えるようになると劇的に有用になります。よく使われるもの:

ツールはモデル非依存です。ステップ4で選択したどのLLMでも、配線したどのツールでも使用できます。

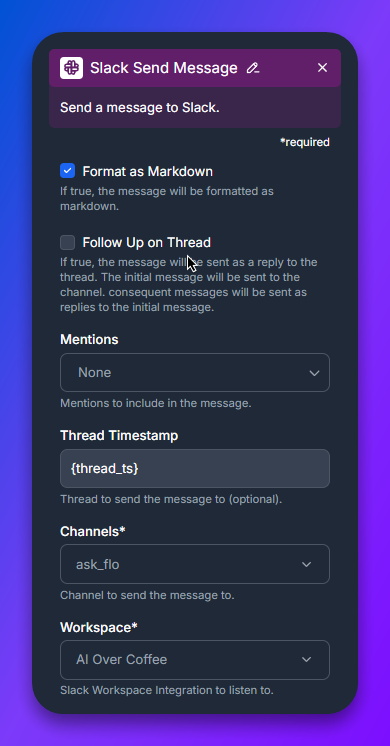

フローをSlack Send Messageコンポーネントで締めくくり、ステップ2と同じチャンネルとワークスペースに設定します。フローを保存し、Slackを開き、テストチャンネルでボットに@メンションします。ボットはステップ4で選択したモデルを使って応答するはずです。

これでセットアップは完了です。後からモデルを切り替えるのはステップ4でのワンクリック変更のみ。コード編集も、フローの再構築も不要です。

すべての主要LLMファミリーがFlowHuntのSlackフローで動作します。違いはコスト、レイテンシ、コンテキストウィンドウ、推論の深さ、ツール呼び出しの品質に集約されます。表で候補を絞り込んだ上で、ファミリー別のセクションでセットアップのメモを読んでください。

| モデルファミリー | 得意分野 | レイテンシ | コスト | メモ |

|---|---|---|---|---|

| Claude (Anthropic) | ロングコンテキスト分析、慎重な推論、コードレビュー | 中 | 中〜高 | ニュアンスのある指示への追従が強い。文書ベースの社内Q&Aに最適 |

| GPT / oシリーズ (OpenAI) | 汎用、広範なツールエコシステム、マルチモーダル | 低〜中 | 低(mini)〜高(oシリーズ) | GPT-4o Miniがデフォルトのスイートスポット。難しい推論にはo1/o3 |

| Gemini (Google) | 巨大なコンテキストウィンドウ、高速マルチモーダル、検索グラウンディング | 低 | 低〜中 | 1.5 Proは100万トークン以上を処理。文書全体のSlack Q&Aに最適 |

| Grok (xAI) | リアルタイム/ニュース対応クエリ、X(Twitter)データ、カジュアルなトーン | 低 | 中 | ボットに最新情報の認識が必要な場合に最適 |

| Llama (Meta) | セルフホスト/プライベートデプロイ、コスト重視のワークロード | ホストに依存 | 低(セルフホスト) | オープンウェイト — データレジデンシーが重要な場合に |

| Mistral | オープンウェイト、バランスの取れたコスト/品質、EU向けホスティング | 低 | 低〜中 | Mistral LargeはGPT-4oに低コストで対抗 |

まずは1つを選んで始めてください。FlowHuntでのモデル切り替えはLLMコンポーネントでのワンクリック変更なので、初期選択を考えすぎる必要はありません。妥当なデフォルトでリリースし、実際のSlackトラフィックで品質を測定し、反復しましょう。

以下の各セクションは独立しています。接続するモデルファミリーのセクションを選び、そのメモに従ってください。

ClaudeはAnthropicのLLMファミリーで、ニュアンスのある社内Q&A、文書要約、コードレビュー、慎重な指示追従を扱うSlackbotに適しています。ClaudeをSlackに接続するには、ステップ4でLLM Anthropicコンポーネントをドロップし、バリアントを選びます:

NotionやConfluence上の社内ナレッジSlackbotには、Claude 3.5 Sonnet+Document Retrieverが最も信頼できる出発点です。

OpenAIのGPTおよびoシリーズモデルはSlack向けの最も幅広い選択肢です。強力な汎用性能、最も成熟したツール呼び出し、マルチモーダル入力(ビジョン、オーディオ)を備えます。ステップ4でLLM OpenAIコンポーネントをドロップし、バリアントを選びます:

ほとんどのチームはGPT-4o Miniから始めましょう。ユーザーが回答品質に不満を感じるフローのみ、GPT-4oやo1に格上げします。

Google Geminiはコンテキストウィンドウが重要な場合の最強の選択肢です。Gemini 1.5 Proは100万トークン以上を処理でき、コードベース全体や文書セットを単一のSlackクエリに投入するのに十分です。ステップ4でLLM Googleコンポーネントをドロップし、バリアントを選びます:

Slackbotがナレッジベース全体を1パスで推論する必要がある(リトリーバルステップなし)場合、Gemini Proのコンテキストウィンドウが最もすっきりした答えです。

xAI Grokは他のモデルと同じ方法でFlowHuntのSlackフローに組み込まれます。LLM xAIコンポーネント(またはFlowHuntのバージョンによっては、Grokエンドポイントを指すLLM OpenAIコンポーネント)をドロップし、Grokバリアントを選びます。Grokの特徴はリアルタイム認識です。X(Twitter)データを含むライブ情報にアクセスでき、Slackbotがニュース、市場データ、最新動向などの時事的なコンテキストを必要とする場合に最良の選択です。Google Search Toolと組み合わせれば、さらに広範なWebアクセスが可能になります。

MetaのLlamaファミリーはオープンウェイトの選択肢です。データレジデンシー、セルフホスト、トークン単価がホスト型APIを排除する場合に使用します。ステップ4でLLM Metaコンポーネントをドロップし、バリアントを選びます:

Llamaは、セキュリティやコンプライアンスチームが自社管理のインフラ上でモデルを実行することを要求する場合、またはメッセージ量が多くホスト型APIのコストが過大な場合の正解です。

Mistralは欧州のオープンウェイトの対抗馬です。強力なモデル、EU向けホスティング、優れたコストパフォーマンスを備えます。ステップ4でLLM Mistralコンポーネントをドロップし、バリアントを選びます:

EUデータレジデンシーが重要な場合、または一部のベンチマークでLlama 3.xよりフロンティアに近い品質のオープンウェイトの柔軟性が欲しい場合にMistralを選んでください。

3つのフローパターンでほとんどのSlackデプロイメントをカバーできます。AI Agentのツールとプロンプトを調整するだけで、上記のセットアップの上にいずれも構築できます:

これらのパターンはきれいに重ねられます。1つのSlackフローでナレッジベース検索、ライブWeb検索、社内API呼び出しを組み合わせ、LLMがクエリごとに適切なツールを選ぶことができます。

ボットがメッセージに応答しない。 「Only Trigger on Mention」がテスト方法と一致しているか確認してください。有効な場合はボットを@メンションする必要があります。Slack Message Receivedのチャンネルが、投稿しているチャンネルと一致するか確認してください。

ボットは応答するが回答の質が低い。 まずAI AgentのbackstoryとGoalを反復してください。モデル切り替えよりもインパクトがあります。プロンプト反復後も品質が改善しない場合は、LLMコンポーネントでより強力なモデルに昇格させてください(Mini → 標準 → トップティア)。

Slack認証後の権限エラー。 FlowHuntのIntegrationsタブでSlack連携を再接続し、権限を再付与してください。Slackはワークスペースオーナー変更後にトークンを無効化することがあります。

長い返信がSlackで切り詰められる。 Slackにはメッセージごとの文字数制限があります。フロー内に長い応答を分割するポストプロセッシングステップを追加するか、AI AgentのGoalで「Slackに投稿する際は3,000文字以内に収める」よう指示してください。

セットアップ全体(Slackの接続、フロー構築、モデル選択)はFlowHuntで一晩のプロジェクトです。今日構築したフローは将来のどのモデルでも動作します。GPT-6やClaude 5が登場したら、LLMコンポーネントを差し替えるだけで残りのフローはそのまま稼働し続けます。

FlowHuntの無料プラン で始めて、Slackを接続し、ランチ前に動くAI Slackbotをリリースしましょう。

アルシアはFlowHuntのAIワークフローエンジニアです。コンピュータサイエンスのバックグラウンドとAIへの情熱を持ち、AIツールを日常業務に統合して効率的なワークフローを作り出し、生産性と創造性を高めることを専門としています。

FlowHuntのノーコードフロービルダーは、Slackをすべての主要LLM(Claude、GPT、Gemini、Grok、Llama、Mistral)に統一されたフローで接続します。コード不要、インフラ管理不要。

FlowHuntのSlack連携は、Slackワークスペース内でシームレスなAIコラボレーションを可能にします。あらゆるFlowをSlackに持ち込み、ワークフローの自動化、リアルタイムAIアシスタンスの提供、カスタマーサービスチャットの監視、生産性の向上など、チームが既に使っている場所で実現できます。...

FlowHuntをSlackと連携し、メッセージの自動化やワークフローのトリガー、AIによるフローでチームの情報共有を効率化しましょう。...

FlowHunt 2.6.12では、Slack連携、インテント分類、Geminiモデルを導入し、AIチャットボットの機能や顧客インサイト、チームのワークフローを強化しました。...