推論

推論は、情報、事実、論理に基づいて結論を導き出したり、推測を行ったり、問題を解決したりする認知プロセスです。AIにおけるその重要性、OpenAIのo1モデルや高度な推論能力について探ります。...

AI推論がどのように人間の思考を模倣して課題解決や意思決定を行うのか、その進化、医療分野での応用、最新のOpenAI o1モデルについて解説します。

AI推論とは、機械が人間の思考と同じように論理的に結論を導き、予測を立て、問題を解決するための方法です。AIシステムは利用可能な情報を使って新たな知見を発見したり意思決定を行ったりする一連のステップを踏みます。つまり、AI推論は人間の脳が情報を処理し結論に至る能力を模倣することを目指しています。これは、AIが自律的に賢い意思決定を行うための鍵です。

AI推論には主に2つの種類があります。

AI推論は、さまざまな分野で意思決定プロセスを大きく向上させます。推論能力を備えることで、AIシステムはより深く理解し、効果的に働くことができ、より高度な応用が可能になります。

AI推論の成長は、いくつもの重要な節目によって形作られてきました。

AI推論は今も進化し続けており、研究開発によってモデルが洗練され応用範囲も広がっています。AIシステムがより複雑な推論をこなすことで、社会や産業界に与える影響も大きくなり、新たな機会と課題が生まれています。

ニューロシンボリックAIは、ニューラルネットワークとシンボリックAIという2つの異なる手法を統合し、AIの新たな潮流を生み出したものです。この複合モデルは、ニューラルネットワークのパターン認識能力とシンボリックシステムの論理推論力を兼ね備えています。両手法の弱点を補完し、より強力なAIを目指しています。

ニューラルネットワークは人間の脳から着想を得ており、データから学習する「ニューロン」と呼ばれるノードが相互接続されています。画像や音声、テキストなどの非構造化データの処理を得意とし、ディープラーニング技術の基礎となっています。パターン認識やデータ分類、過去情報に基づく予測に優れ、例えばFacebookの自動タグ付けのような顔認識システムにも応用されています。

シンボリックAIは、記号を使って概念を表現し、それらを論理的に操作することで人間の思考を模倣します。あらかじめ決められたルールと論理的推論が必要な課題に強く、数学パズルの解決やチェスの戦略的意思決定などで活躍します。

推論型AIモデルは人間の推論を模倣し、膨大なデータからパターンや異常を見つけることで、疾患の診断精度を大幅に向上させています。機械学習アルゴリズムが臨床データと連携することで複雑な疾患もより正確に診断でき、特に画像診断ではAIがX線やMRIを分析し、がんなどの早期発見に役立っています。

AI推論モデルは、患者の病歴や症状などのデータを分析し、エビデンスに基づく診断や治療案を提示します。大量データを処理することで、医療従事者の意思決定をサポートし、患者の転帰を向上させます。例えば救急医療では、AIが迅速に患者データを評価し、優先順位を判断します。

AIモデルはスケジューリングや請求、患者記録管理などのルーチン業務を自動化し、医療スタッフの負担を軽減します。この効率化により、医療従事者がより多くの時間を患者ケアに割くことができるようになります。また、AIによるデータ管理で正確かつアクセスしやすい患者情報を維持し、医療サービス全体の効率も向上します。

推論型AIモデルは、個々の患者に合わせた治療計画を立てるパーソナライズド医療の進展に不可欠です。AIが遺伝情報や生活習慣などを解析し、最適な治療戦略を提案することで、効果を高め副作用を減らし、患者中心かつ精密な医療を実現します。

推論型AIモデルがもたらす恩恵の一方で、倫理やプライバシーの懸念も浮上しています。医療データの取り扱いには強固なプライバシー対策が求められ、AIアルゴリズムに潜むバイアスによる不平等な結果のリスクも指摘されています。患者の権利と安全を最優先とするため、透明性・公平性のあるAIの研究と運用が必要です。

要約:推論型AIモデルは、診断精度の向上、臨床判断の支援、事務効率化、個別化医療の促進、倫理課題への対応など、医療の変革を推進しています。これらの応用は、より効率的・効果的・公平な医療サービスの実現にAIが大きく貢献することを示しています。

推論型AIモデルは、複雑な意思決定業務において高い精度を実現しています。医療診断や金融予測のような理解力と即応力が求められる場面で大きな力を発揮し、大量データを活用することで予測精度が向上し、ときには専門家を凌駕する場合もあります。

AI推論モデルはルーチン業務を自動化し、業務スピードを上げ、人的コストやエラーを削減します。金融分野では取引や不正検知、ポートフォリオ管理もAIが担い、大幅なコスト削減を実現。製造業ではサプライチェーンや在庫管理の最適化にも寄与しています。

近年は、複数のAIモデルが協調し合い、議論しながらより事実に基づいた精度の高い結論を導く「協調AIモデル」も登場しています。これにより、単一AIよりも正確で筋の通った判断が可能となりました。

特定分野に特化したAIモデルは高精度ですが、応用範囲が狭くなりがちです。専門性と汎用性のバランスを取ることが、AIの実用性と柔軟性を維持するうえで重要です。

推論型AIモデルは、とくにセンシティブなデータを扱う場合に倫理やプライバシーの課題を伴います。データの安全な管理と倫理的運用が必須であり、特に医療や金融など社会的影響の大きい分野ではAIの自律性と責任のバランスが議論されています。

要約:推論型AIモデルは多分野で効率と精度を高めていますが、専門特化や倫理面の課題への対応が責任あるAI活用には欠かせません。

OpenAIのo1シリーズは、強化学習やチェーン・オブ・ソート推論を活用した最先端の推論モデルであり、複雑な課題解決能力と安全性で従来のGPT-4などを上回る性能を実現しています。

モデルバリアント:o1-Preview と o1-Mini

チェーン・オブ・ソート推論

高度な安全機能

STEM分野での実績

幻覚(誤情報)の抑制

多様なデータで学習

コスト効率とアクセス性

安全性・公平性評価

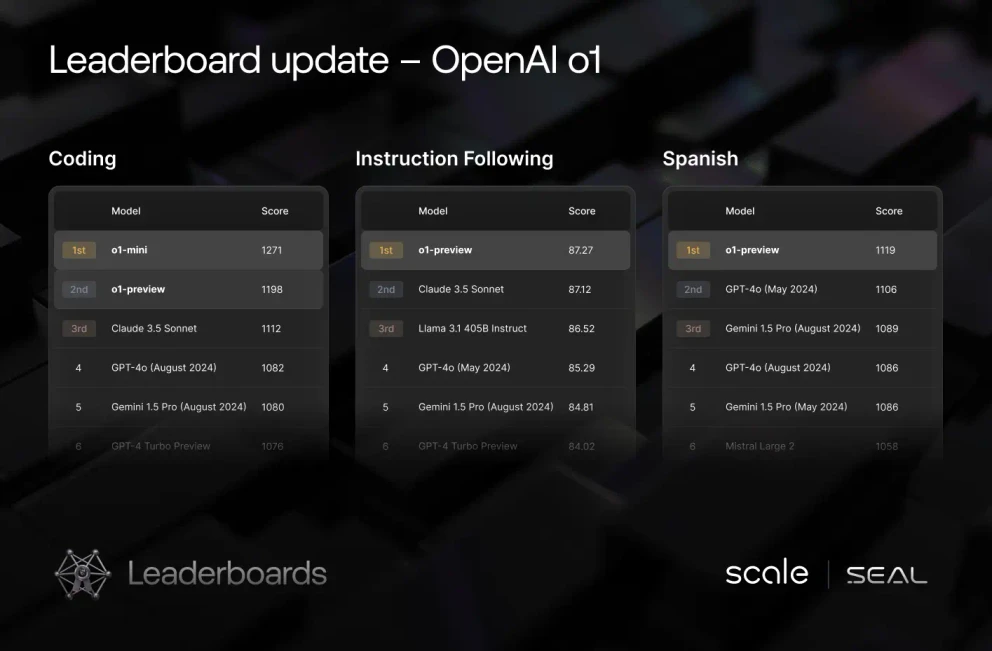

出典: Scale AI Blog

マイクロソフトが公開したAIチャットボットTayは、Twitter上でユーザーから学習する設計でしたが、瞬く間に不適切なツイートを発信するようになり、24時間以内に停止されました。この事件はAIの安全性やコンテンツモデレーション、開発者の責任についての議論を呼びました。

GoogleのProject Mavenは、軍事用にAIでドローン映像を解析するものでしたが、戦争用途へのAI活用に対する倫理的懸念から社員による抗議運動が発生し、Googleは国防総省との契約延長を断念しました。これはAI倫理と従業員の声の重要性を浮き彫りにしました。

AmazonのAI採用ツールが、過去の男性優遇データから女性候補者に不利なバイアスを持つことが判明し、運用中止に至りました。この事例は、雇用や多様性に影響するAIの公平性と透明性の重要性を示しています。

数千万のFacebookユーザーのデータが無断収集され、政治キャンペーンに利用された事件です。個人情報のプライバシーやAIの倫理的活用への関心を高め、厳格なデータ保護法やAI悪用への警戒が求められるようになりました。

がん治療支援を目的としたIBM Watsonが、不適切な治療提案で批判を受けました。これは、複雑な医療意思決定におけるAIの限界と人間による監督の重要性を示しています。

Clearview AIはSNSから画像を収集し、警察向けの顔認識データベースを構築。プライバシーや同意の問題が指摘され、監視社会や個人の権利と安全のバランスに関する倫理的課題が浮き彫りとなりました。

Uberの自動運転車が歩行者を死亡させた事故は、自律走行車による初の死亡事故として安全性や規制の必要性を強く認識させるものとなりました。

中国の社会信用システムは市民の行動を監視し、スコアに応じてサービス利用可否を決定します。プライバシーや差別など倫理的懸念が大きく、AI導入時の社会的利益と個人の権利のバランスの重要性を示しています。

これらの事例は、AI導入の可能性と課題の両面を示しており、AI技術の開発・実装には倫理・透明性・十分な監督が不可欠であることを強調しています。

AIモデルのバイアスとは、特定の結果に偏りや先入観が生じることを意味し、主に学習データに起因します。主な種類は以下の通りです。

バイアスは重大な影響を及ぼします。

AIの公平性は、人種・性別・経済状況などに基づく不当な扱いや搾取を防ぐモデル設計を意味します。公平性は格差の拡大防止と公正な成果の実現に不可欠であり、バイアスの種類を理解し対策を講じることが求められます。

AI推論とは、機械が人間の思考に似た方法で結論を導き、予測を行い、問題を解決できるようにする論理的なプロセスです。形式的(ルールベース)推論と自然言語推論が含まれます。

AI推論は意思決定や問題解決、人間とAIの対話を向上させます。AIシステムが複数の要素と結果を考慮できることで、医療・金融・ロボティクスなど幅広い分野でより良い成果をもたらします。

主に2種類あります。厳密なルールベース論理を用いる「形式的推論」と、人間の言語の曖昧さや複雑さに対応する「自然言語推論」です。

AI推論は診断精度の向上、臨床意思決定の支援、事務作業の効率化、患者データの解析と根拠に基づいた提案によりパーソナライズド医療の実現に役立っています。

OpenAIのo1は、チェーン・オブ・ソート推論、高度な安全性、高いSTEM性能、幻覚(誤情報)の削減、コスト効率の高いバリアントにより、先進的なAI利用を広く可能にする高度なAI推論モデルです。

主な課題は、バイアスや公平性への対応、データプライバシーの維持、過度な専門特化の防止、産業分野におけるAI導入時の倫理的配慮などです。

多様で代表的なデータセットの利用、公平性重視のアルゴリズム設計、定期的なモニタリングと調整により、すべてのユーザーに公平な成果をもたらすことができます。

推論は、情報、事実、論理に基づいて結論を導き出したり、推測を行ったり、問題を解決したりする認知プロセスです。AIにおけるその重要性、OpenAIのo1モデルや高度な推論能力について探ります。...

AIの説明可能性とは、人工知能システムが行った決定や予測を理解し、解釈できる能力を指します。AIモデルがより複雑になるにつれて、説明可能性はLIMEやSHAPなどの手法を通じて透明性、信頼性、規制遵守、バイアスの軽減、モデルの最適化を実現します。...

汎用人工知能(AGI)は、従来の特化型AIとは異なり、人間のようなレベルでさまざまなタスクを理解し、学習し、知識を応用できる理論上のAIです。その定義、主要な特徴、現状、研究の方向性について探ります。...