ヒューマン・イン・ザ・ループ

ヒューマン・イン・ザ・ループ(HITL)は、AIおよび機械学習において人間の専門知識をAIシステムの学習、調整、適用プロセスに組み込む手法であり、精度の向上、エラーの削減、倫理的な遵守を実現します。...

ヒューマン・イン・ザ・ループ(HITL)がAIチャットボットに人間の監督を加えることで、より高い精度、倫理的なコンプライアンス、ユーザー満足度を実現する方法を学びましょう。FlowHuntが自動会話における人間の介入をシームレスに可能にする仕組みをご紹介します。

ヒューマン・イン・ザ・ループ(HITL)は、人工知能(AI)や機械学習(ML)システム、特にチャットボットの構築と活用において重要な考え方です。HITLは、重要な場面で人間の判断や専門知識をAIと組み合わせることを意味します。この人と機械の連携によって、AIの成果が向上し、倫理規範を守り、システム全体のパフォーマンスを高めることができます。

ヒューマン・イン・ザ・ループは、データ収集、モデル学習、AIシステムの継続的な監視など、さまざまな段階で人間の関与を含みます。人間による監督を加えることで、HITLシステムはバイアスを抑え、より正確な結果を出し、AIモデルの理解性を高めます。これは特にチャットボットにおいて、会話の質やユーザー満足度を保つ上で欠かせません。

HITLは、AIやMLのプロセスにおいて、人間がフィードバックや検証、修正を行う手法です。この人間の関与により、誤りを減らし、バイアスを抑え、AIシステムの精度が向上します。チャットボットにおいては、HITLによりリアルタイムでの介入や調整が可能となり、複雑でデリケートな会話にも柔軟に対応できます。

チャットボットが社会的なバイアスを拡散したり、予期せぬ問題を引き起こすことがないようにするためにも、人間の判断が不可欠です。たとえば、コンテンツのモデレーションやカスタマーサービスにおいては、AIでは捉えきれない微妙なニュアンスや文脈を理解するために人間の判断が必要となります。

ヒューマン・イン・ザ・ループは、さまざまな分野で幅広く活用されています。医療分野では、HITLが医療チャットボットに組み込まれることで、正確な健康情報の提供や診断サポートを行い、繊細で複雑な健康相談にも適切に対応しています。カスタマーサービスでは、HITLを備えたチャットボットが一般的な質問には効率的に対応し、難易度の高い案件には人間が介入します。

ECサイトでも、HITLチャットボットを活用して顧客とのコミュニケーションを強化し、パーソナライズされたショッピング体験を実現しています。人間による監督が、チャットボットの対応品質や企業イメージを守る役割も果たします。

HITLをチャットボットに導入することで、システムの正確性や信頼性が高まり、ユーザーの信頼と満足度の向上にもつながります。AI技術が進化し続ける中で、人間は自動化システムと人間中心のニーズをつなぐ重要な役割を担い続けます。

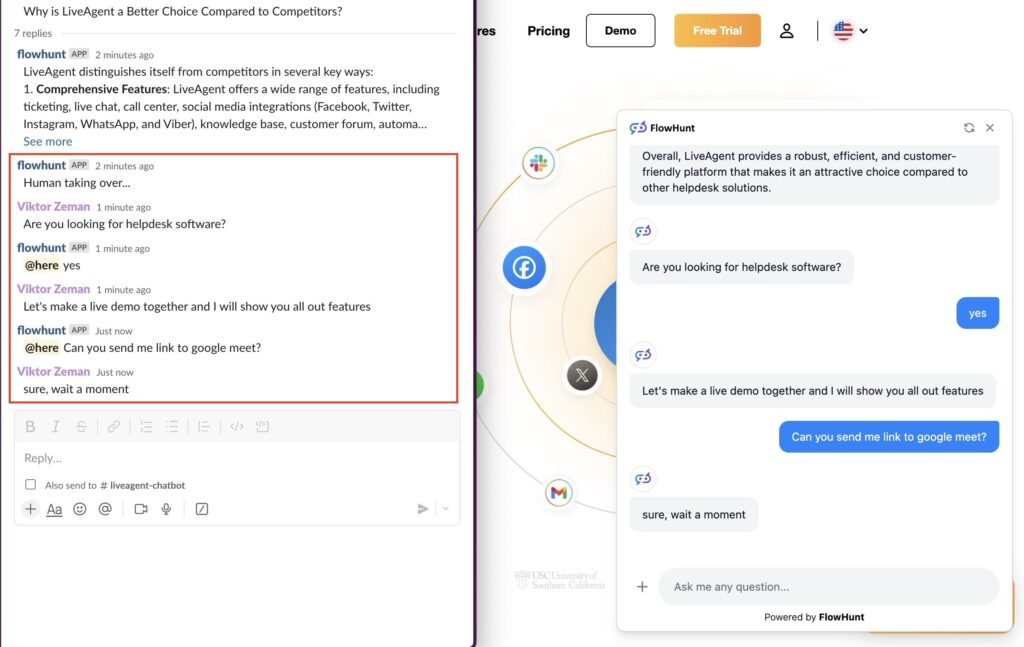

上の画像は、AIチャットボットにおけるヒューマン・イン・ザ・ループのプロセスを示しています。人間がオンライン訪問者とのチャットボットのやり取りを監視し、必要に応じて会話を引き継ぐ様子です。

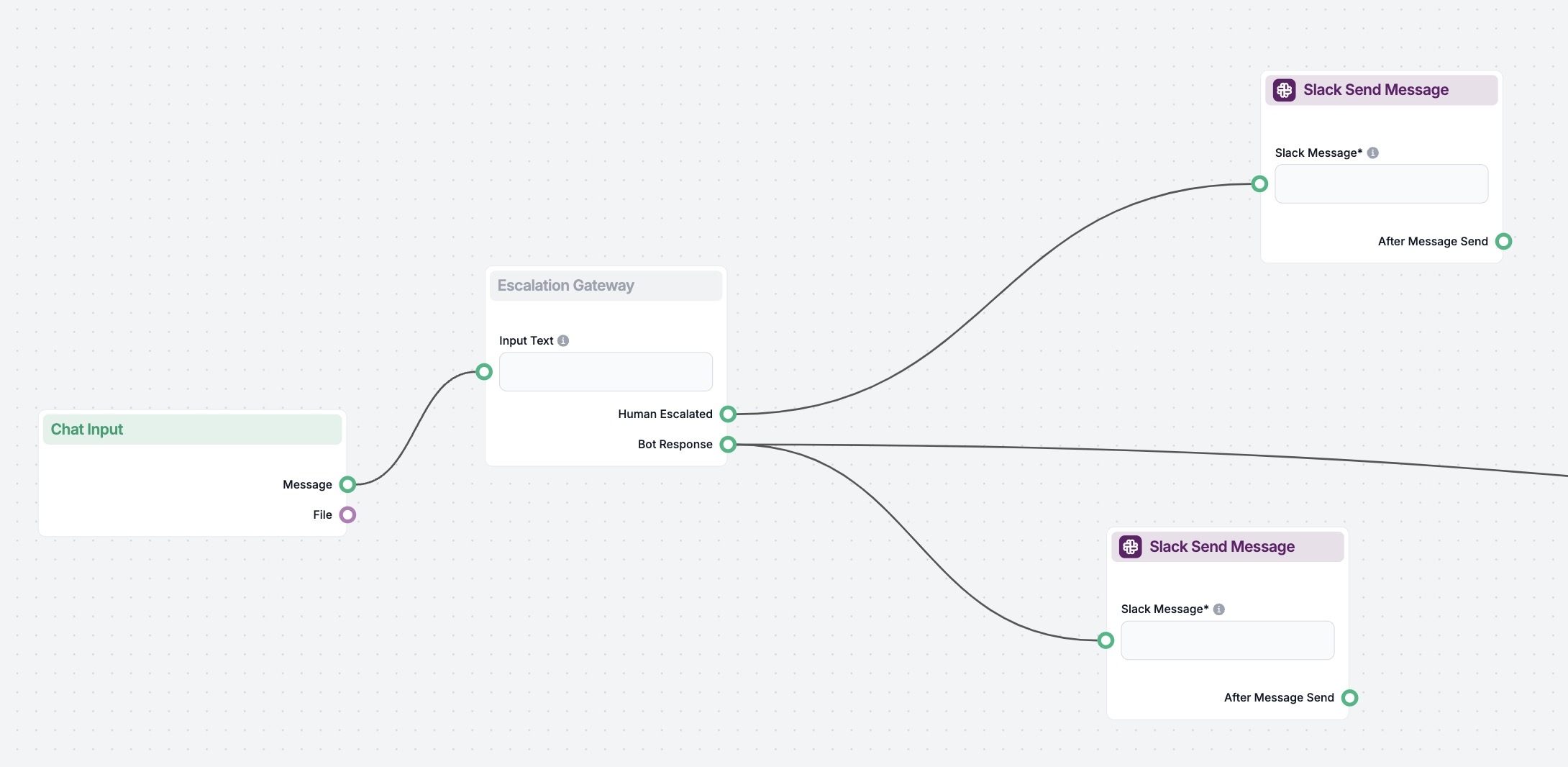

FlowHuntでは、チャットボットの自動会話にエスカレーション・ゲートウェイをシームレスに組み込むことができます。この機能により、必要に応じて会話をリアルな担当者に引き継ぐことができ(例:Slack経由など)、複雑な問い合わせやデリケートな課題にも、サポート担当者による個別対応でしっかりサポートできます。

エスカレーション・ゲートウェイ・コンポーネント

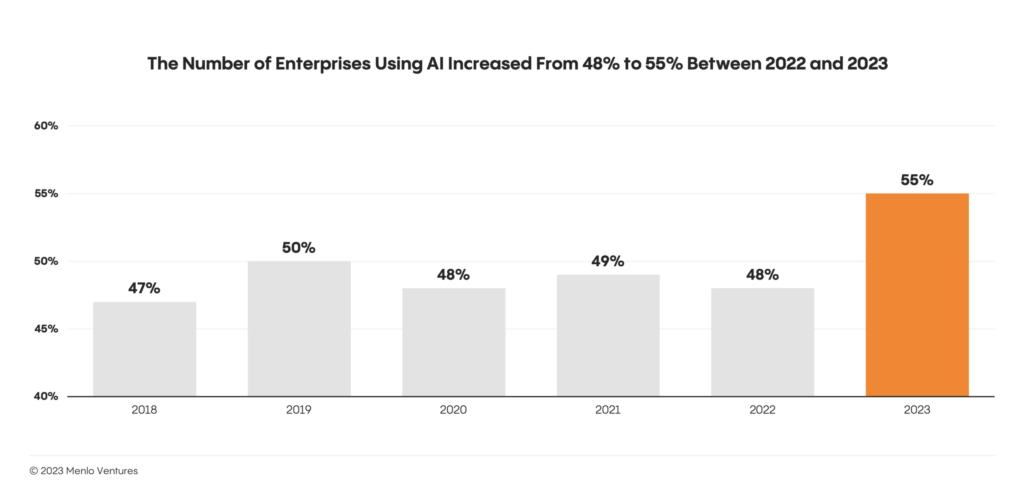

企業レベルでのAI活用において、ヒューマン・イン・ザ・ループ(HITL)の導入が急速に拡大しています。より多くの業界が、AIシステムに人間の監督を加えることのメリットを認識し、意思決定の質や倫理基準の維持に活用しています。HITLは、企業がAIプロセスの主導権を維持し、オートメーションに伴うリスクを低減するのに役立ちます。金融や医療などの分野では、人間による監督がAI出力のチェックに不可欠であり、バイアスや誤りを防ぎます。企業はHITLを活用することで、よりパーソナライズされた正確なサービスを提供し、リアルタイムの人間の介入によって業務効率も向上させています。

画像出典:Menlo Ventures

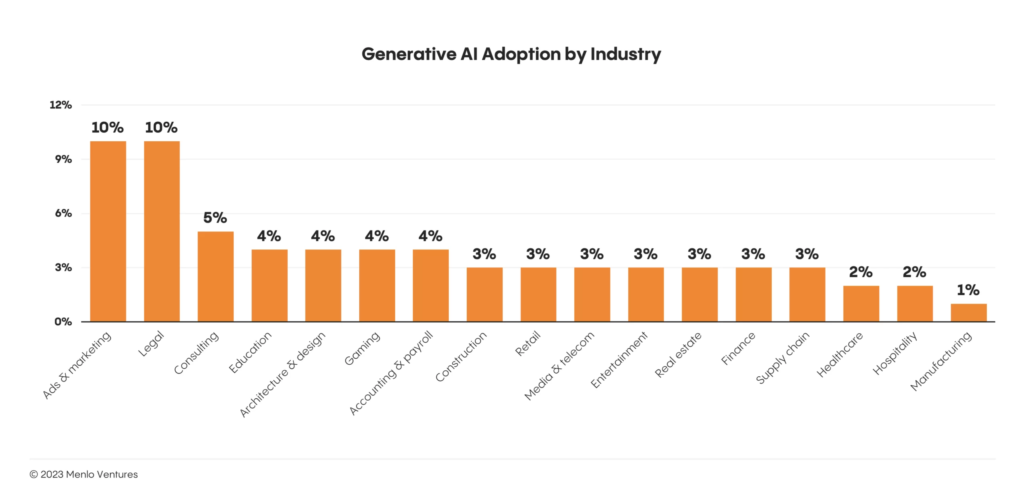

HITLと生成AIの連携は、会話型AIシステムのあり方を大きく変えつつあります。生成AIは自らコンテンツを生み出しますが、人間のガイダンスによってその価値がさらに高まります。人間のオペレーターが生成モデルを指導することで、より文脈に合った顧客対応ができるようになり、特にカスタマーサービスチャットボットでその効果を発揮します。この協業によって、対話の質が向上するだけでなく、AIシステムが人間の価値観やビジネス目標と整合した形で運用されます。生成力と人間の洞察を組み合わせることで、組織はより高度で柔軟なAIソリューションを構築でき、変化するユーザーニーズに対応可能です。

画像出典:Menlo Ventures

HITLの導入拡大は、AI技術の進化におけるその重要な役割を強調しています。AIがさまざまな分野に広がる中、人間の判断や創造性を取り入れたシステムへの需要が高まっています。この流れは、倫理的なAI実践の必要性を示し、革新的で信頼できる成果を得るための人間とAIの協働の価値を浮き彫りにしています。

HITLシステムは、人間による監督を活用し、AIの出力を継続的に改善します。初期段階では、人間の専門家がデータにラベル付けを行い、AIモデルの学習や予測の基礎となる「正解データ」を提供します。モデルが稼働し始めると、人間からのフィードバックがパフォーマンス評価や誤り修正、バイアス対策に欠かせません。この継続的なプロセスにより、AIシステムの出力が現実社会の期待や価値観に合致するようになります。

例えば、会話型システムでは、HITLによって人間の担当者がリアルタイムでAI生成の回答を修正・承認できるため、適切で正確な対応が保証されます。これは、カスタマーサービスや医療など、AIの生成内容が大きな影響を及ぼす分野で特に重要です。

HITLの導入は、パフォーマンス向上だけでなく、生成AIの倫理的な運用にも寄与します。バイアスの監視・修正手段を提供することで、より包括的で公平な成果につながります。これにより、AIアプリケーションのユーザー信頼維持や倫理基準の遵守が実現します。人間の判断を取り入れることで、AIによる自律的な意思決定に伴うリスク(ステレオタイプの強化や有害なコンテンツ生成など)も低減できます。

HITLと生成AIの連携は、AI技術の進化とともにさらに拡大していきます。人間による継続的な関与が、AIシステムの新たな状況や入力への適応力を高め、常に最新かつ正確な状態を維持します。今後、AIモデルがより高度化するにつれて、HITLの必要性も高まり、これらの技術が強力であると同時に、責任ある人間中心のものとなることが保証されます。

まとめると、ヒューマン・イン・ザ・ループと生成AIモデルの統合は、会話型システムの変革のカギとなります。精度向上、倫理基準の確保、継続的な学習の仕組みを提供することで、HITLシステムは信頼されるAIソリューションの開発に不可欠なものとなっています。今後もこれらの技術が進化する中で、人間による監督は効果的なAI展開の根幹を成し続けるでしょう。

ヒューマン・イン・ザ・ループ(HITL)システムをチャットボットに導入するには、いくつかの大きな課題があります。主な課題の一つはスケーラビリティです。人間の監督を加えることで、AIアプリケーションの拡張が難しくなる場合があります。データややり取りが増加すると、人間の関与を維持するには多くの人材や技術が求められます。

もう一つの課題はコストです。AIシステムの監督・連携を担う専門家を雇うことは、追加コストにつながります。特に人員リソースに限りがある中小企業やスタートアップにとっては、広範な人間関与のための予算を確保するのが難しい場合もあります。また、人間の監督をAIワークフローに組み込む複雑さから、統合面での問題も生じやすくなります。人間エージェントとAIが円滑に連携するためには、先進的なシステム設計と強固なコミュニケーション手法が求められます。

倫理的な課題もHITL導入時の大きなポイントです。自動化と人間の関与のバランスを取るには、既存バイアスの再強化や新たな倫理的リスクを生まないよう細心の注意が必要です。人間の監督は、機械にはできない文脈や判断を提供することでこうしたリスクを緩和しますが、多様で包摂的な人材チームによって多角的な視点を反映させることも重要です。

まとめると、チャットボットにおけるヒューマン・イン・ザ・ループの今後は、さまざまな発展と可能性を秘めています。人間の知性とAIの能力を融合させることで、HITLはより倫理的で効率的、ユーザーに優しいAI環境の実現に貢献していきます。

ヒューマン・イン・ザ・ループ(HITL)とは、AIチャットボットの開発や運用の重要な段階(データ収集、モデル学習、リアルタイム介入など)に人間の専門知識を組み込むことで、精度向上、バイアス低減、倫理基準の確保を図る仕組みです。

HITLは、チャットボットが正確で偏りのない、文脈に合った回答を提供するために重要です。人間による監督は、倫理的な問題を防ぎ、特に医療やカスタマーサービスなどのセンシティブな分野でユーザーの信頼構築に役立ちます。

FlowHuntは、チャットボット運営者がエスカレーション・ゲートウェイを組み込むことで、複雑またはデリケートな問い合わせが発生した際にリアルな人間による介入を可能にしています。これにより、自動対応だけでは不十分な場合も、パーソナライズされた効果的なサポートを提供できます。

課題としては、スケーラビリティや運用コストの増大、統合の複雑さ、多様な人間の監督が新たなバイアスや倫理的リスクを生まないようにする必要がある点などが挙げられます。

人間がデータのラベリングや出力の検証、フィードバックを行うことで、HITLシステムはモデルの精度を継続的に改善し、バイアスの是正にも取り組めます。これにより、AIの出力が実社会の価値観や期待に沿ったものになります。

ヴィクトル・ゼマンはQualityUnitの共同所有者です。20年以上会社を率いてきた今も、主にソフトウェアエンジニアとして、AI、プログラム的SEO、バックエンド開発を専門としています。LiveAgent、PostAffiliatePro、FlowHunt、UrlsLabなど、数多くのプロジェクトに貢献してきました。

ヒューマン・イン・ザ・ループ(HITL)は、AIおよび機械学習において人間の専門知識をAIシステムの学習、調整、適用プロセスに組み込む手法であり、精度の向上、エラーの削減、倫理的な遵守を実現します。...

ビジネスリーダーが責任あるAIガバナンス、リスク低減、コンプライアンス、そして企業AIシステムへの信頼構築のためにHuman-in-the-Loop(HITL)フレームワークを導入するための実践的なガイド。...

AIにおけるハルシネーションとは何か、なぜ発生するのか、そしてどのように回避できるのか?実践的かつ人間中心の戦略で、AIチャットボットの回答を正確に保つ方法を学びましょう。...