LLM OpenAI

FlowHuntは、OpenAIをはじめとする数十種類のテキスト生成モデルに対応しています。ここでは、AIツールやチャットボットでChatGPTを使用する方法をご紹介します。...

Custom OpenAI LLM コンポーネントは、OpenAI 互換の独自言語モデルを接続・設定し、柔軟で高度な会話型 AI フローを実現します。

コンポーネントの説明

Custom LLM OpenAI コンポーネントは、OpenAI API と互換性のある大規模言語モデルと柔軟に連携できるインターフェースを提供します。これには OpenAI だけでなく、JinaChat、LocalAI、Prem などの代替プロバイダーのモデルも含まれます。このコンポーネントは高いカスタマイズ性を持ち、自然言語処理が必要なさまざまな AI ワークフローシナリオに適しています。

このコンポーネントは、AI ワークフローと OpenAI API 標準に準拠した言語モデルとの橋渡しをします。モデルプロバイダーや API エンドポイント、その他のパラメータを指定することで、ワークフロー内でテキスト生成・処理、チャット、その他の言語ベースの出力を実現できます。コンテンツの要約、質問応答、クリエイティブなテキスト生成、その他の NLP タスクなど、用途に合わせて柔軟に設定可能です。

このコンポーネントの挙動は、以下のパラメータで制御できます。

| パラメータ | 型 | 必須 | デフォルト | 説明 |

|---|---|---|---|---|

| 最大トークン数 | int | いいえ | 3000 | 生成されるテキスト出力の最大長を制限します。 |

| モデル名 | string | いいえ | (空欄) | 使用するモデル名を正確に指定します(例: gpt-3.5-turbo)。 |

| OpenAI API ベース | string | いいえ | (空欄) | カスタム API エンドポイントを設定可能(例: JinaChat、LocalAI、Prem 用)。空欄の場合は OpenAI を使用。 |

| API キー | string | はい | (空欄) | 選択した言語モデルプロバイダーへのアクセス用の秘密の API キーです。 |

| 温度 | float | いいえ | 0.7 | 出力の創造性を制御します。値が低いほど結果は決定的になります。範囲:0~1。 |

| キャッシュを使用 | bool | いいえ | true | クエリのキャッシュ有効化/無効化で効率化とコスト削減が可能です。 |

注記: これらのすべての設定オプションはアドバンスド(上級)設定となっており、モデルの挙動や統合をきめ細かくコントロールできます。

入力:

このコンポーネントには入力ハンドルはありません。

出力:

BaseChatModel オブジェクトを出力します。ワークフロー内の次のコンポーネントでさらなる処理や対話に利用できます。| 機能 | 説明 |

|---|---|

| プロバイダー対応 | OpenAI、JinaChat、LocalAI、Prem、または OpenAI API 互換サービス全般 |

| 出力タイプ | BaseChatModel |

| API エンドポイント | 設定可能 |

| セキュリティ | API キー必須(秘密保持) |

| 利便性 | パワーユーザー向けの高度な設定も可能、デフォルトでも多くの用途に対応 |

このコンポーネントは、OpenAI 直利用でも代替プロバイダー利用でも、柔軟で堅牢かつカスタマイズ可能な LLM 機能を AI ワークフローに統合したい全ての方に最適です。

Custom OpenAI LLM コンポーネントは、JinaChat、LocalAI、Prem など、OpenAI 互換の任意の言語モデルを、独自の API 認証情報とエンドポイントを設定して接続できるため、AI の能力を完全にコントロールできます。

モデル名、API キー、API エンドポイント、温度、最大トークン数、そして最適化されたパフォーマンスや柔軟性のための結果キャッシュの有効化などを設定できます。

はい。モデルが OpenAI API インターフェースに対応していれば、JinaChat、LocalAI、Prem などの代替モデルも接続できます。

API キーはモデル接続に必要であり、プラットフォームによって安全に管理されます。認可されていない第三者に共有または漏洩されることはありません。

はい。キャッシュを有効にすることで以前の結果を保存・再利用でき、繰り返しのクエリによる待機時間や API 使用量を削減できます。

FlowHuntは、OpenAIをはじめとする数十種類のテキスト生成モデルに対応しています。ここでは、AIツールやチャットボットでChatGPTを使用する方法をご紹介します。...

FlowHuntは、AnthropicのClaudeモデルを含む数十種類のAIモデルに対応しています。カスタマイズ可能な設定で、ClaudeをAIツールやチャットボットに組み込み、最適な応答を得る方法をご紹介します。...

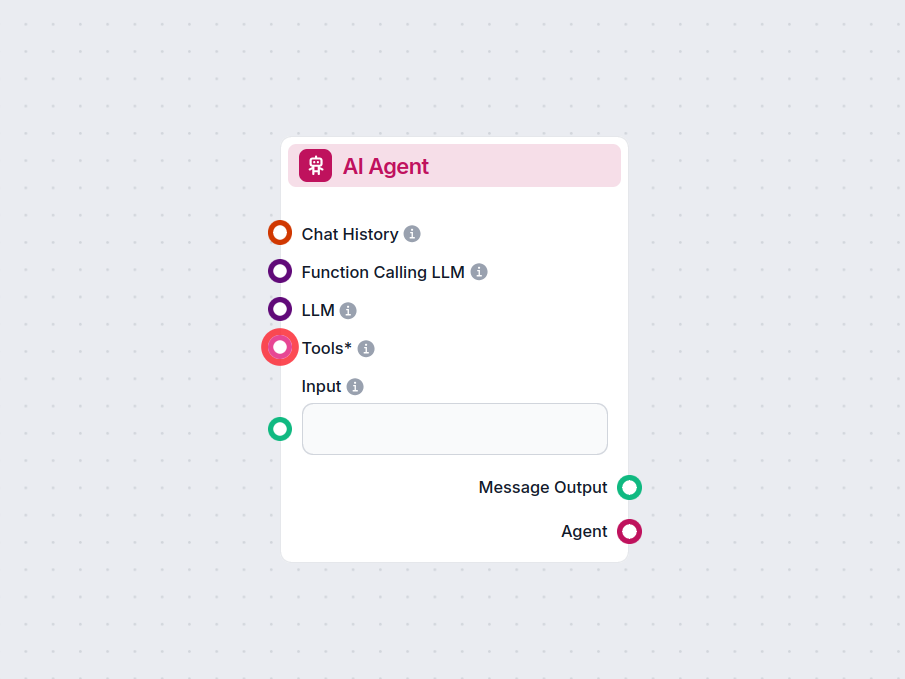

FlowHuntのAIエージェントコンポーネントは、ワークフローに自律的な意思決定とツール使用の能力を与えます。大規模言語モデルを活用し、さまざまなツールと連携してタスクを解決し、目標を達成し、知的な応答を提供します。高度な自動化や対話型AIソリューションの構築に最適です。...