LLM Meta AI

FlowHuntは、MetaのLlamaモデルを含む数十種類のテキスト生成モデルをサポートしています。LlamaをAIツールやチャットボットに統合する方法、最大トークン数や温度などの設定をカスタマイズする方法、AI活用ワークフローを効率化する方法をご紹介します。...

FlowHuntのLLM xAIを使えば、Grok-betaのようなxAIのテキスト生成モデルをチャットボットやAIツールに統合でき、トークン数や温度、モデル選択など柔軟な設定が可能です。

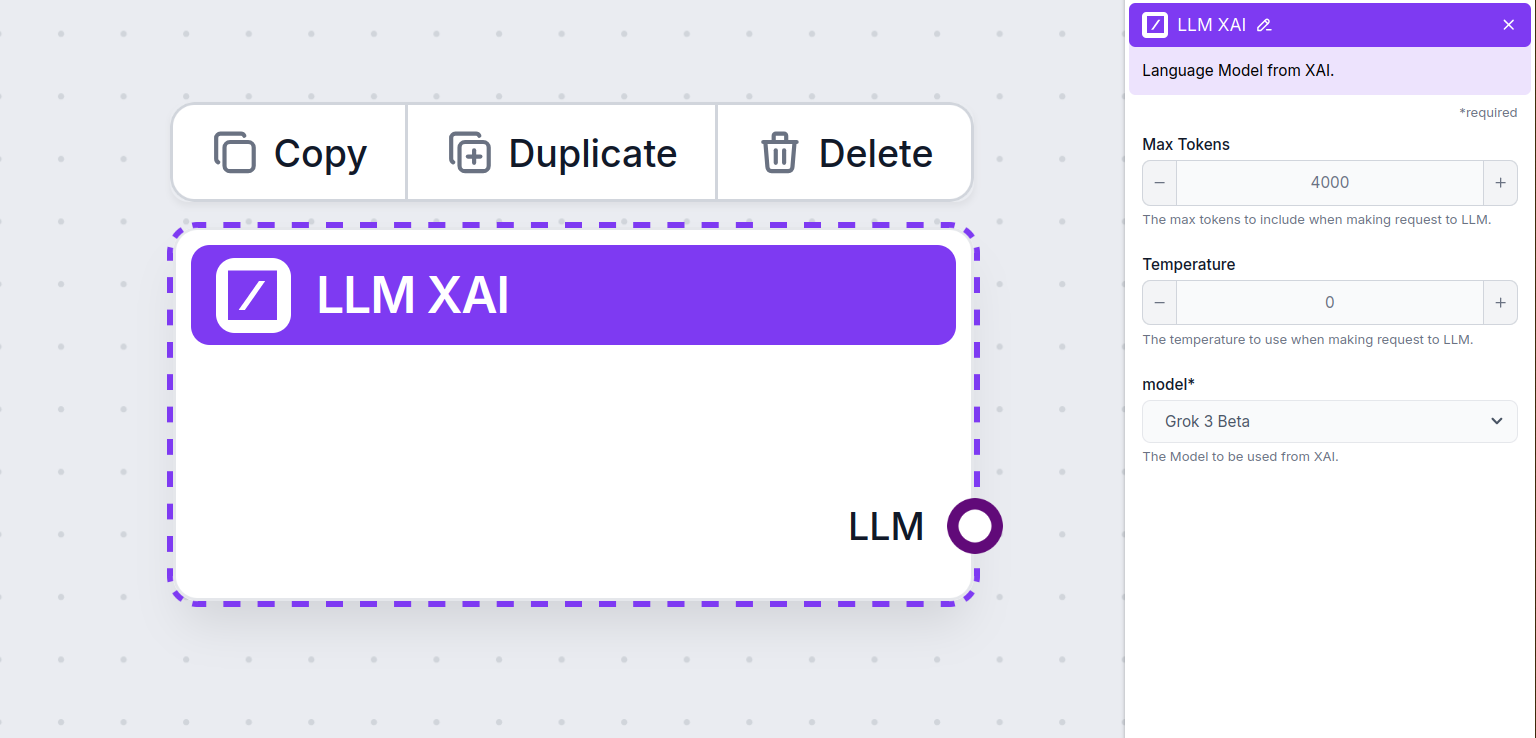

コンポーネントの説明

LLM xAIコンポーネントは、Grokモデルをあなたのフローに接続します。実際の生成や処理はジェネレーターやエージェントで行われますが、LLMコンポーネントによって使用するモデルを制御できます。すべてのコンポーネントはデフォルトでChatGPT-4を搭載しています。モデルを変更したい場合や、より細かくコントロールしたい場合は、このコンポーネントを接続してください。

LLMコンポーネントの接続はオプションであることを忘れないでください。LLMを使うすべてのコンポーネントはデフォルトでChatGPT-4oが設定されています。LLMコンポーネントを使えば、モデルの変更やモデル設定のコントロールが可能です。

トークンは、モデルが処理・生成するテキストの最小単位です。モデルごとにトークンの扱いは異なり、1トークンは単語やサブワード、1文字の場合もあります。モデルの利用料金は通常、数百万トークン単位で設定されています。

最大トークン数の設定は、1回のやりとりやリクエストで処理できるトークンの合計数を制限し、応答が適切な範囲で生成されるようにします。デフォルトの制限は4,000トークンで、ドキュメントや複数の情報源を要約して回答を作成するのに最適なサイズです。

温度は、応答の多様性を0から1の間で制御します。

0.1の温度では、非常に簡潔ですが、繰り返しや不十分な回答になる可能性があります。

1の高い温度では、最大限にクリエイティブな応答が得られますが、無関係な内容や幻覚的な回答になるリスクがあります。

例えば、カスタマーサポート用のボットには0.2~0.5の温度が推奨されます。この範囲なら、回答はスクリプト通りでありながら自然なバリエーションが生まれます。

ここでモデルを選択します。xAIプロバイダーが提供するすべての対応モデルが表示されます。xAIの主力テキストモデルはGrokです。現在サポートしているのはgrok-betaモデルのみで、これはパブリックAPIとして公開されている唯一のモデルです。

Grok-betaの詳細や他モデルとの比較について知りたい方は、こちらの記事をご覧ください。

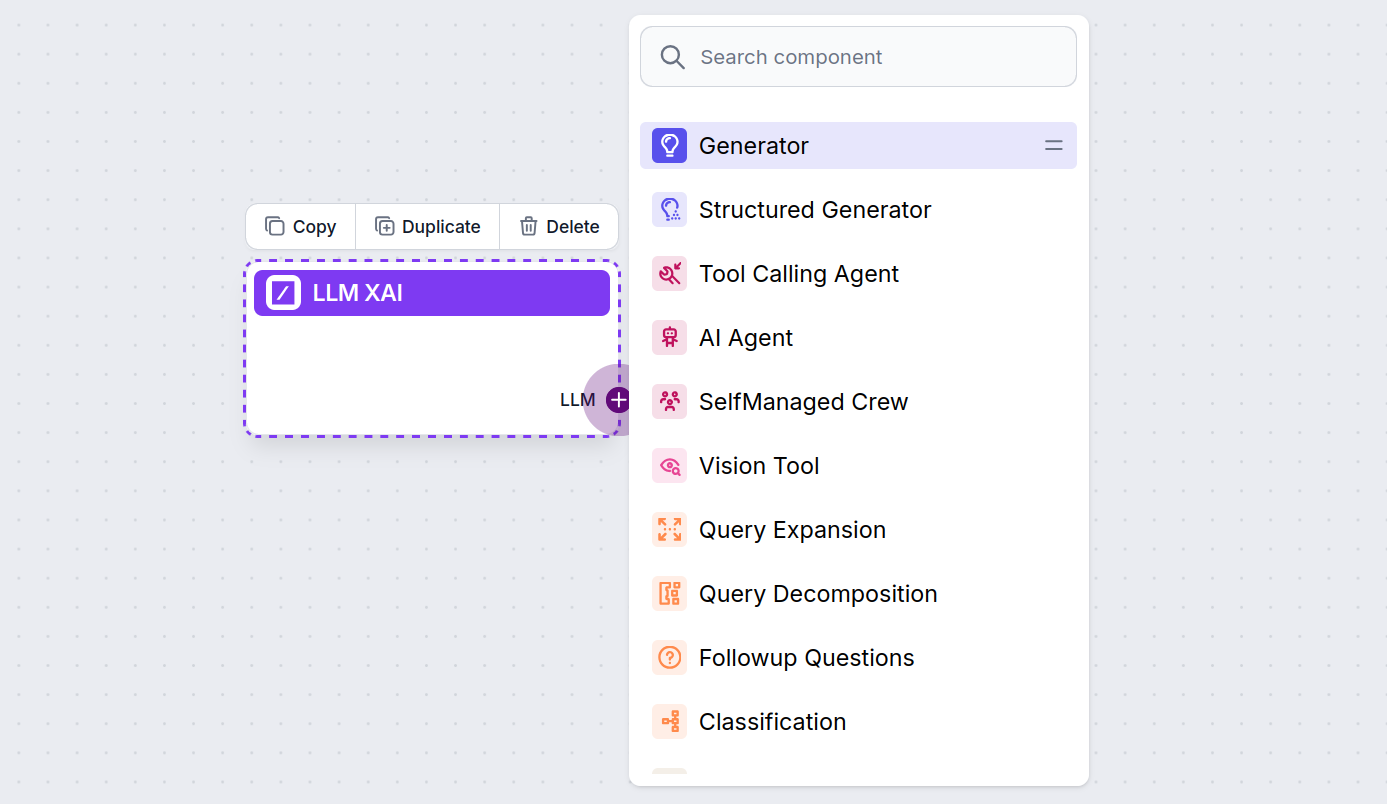

すべてのLLMコンポーネントには出力ハンドルのみがあることに気付きます。入力はこのコンポーネントを通過せず、モデルを表すだけで、実際の生成はAIエージェントやジェネレーターが担当します。

LLMハンドルは常に紫色です。LLM入力ハンドルは、テキスト生成やデータ処理をAIで行うすべてのコンポーネントにあります。ハンドルをクリックすると、選択肢が表示されます。

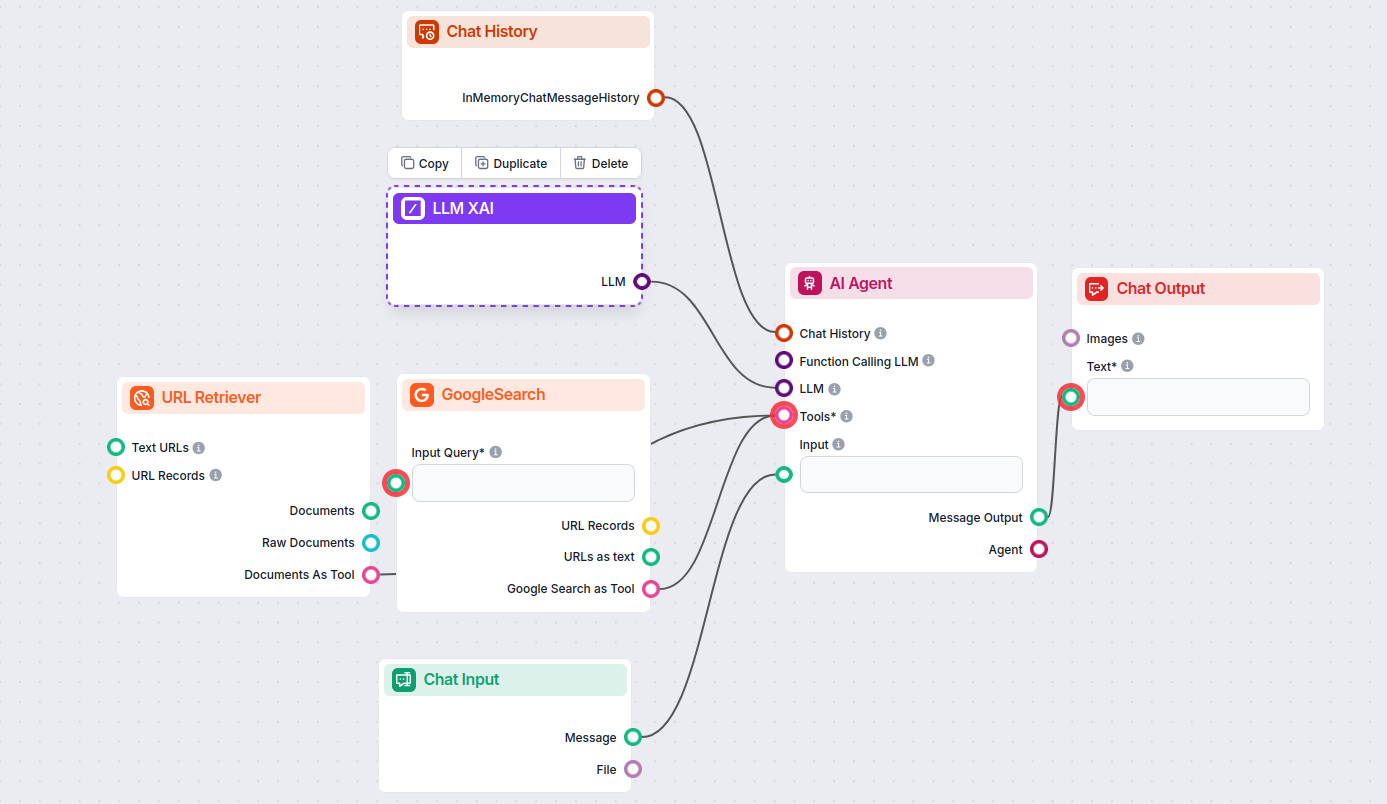

これにより、さまざまなツールを自由に作成できます。実際にコンポーネントを使ってみましょう。下図は、xAIのgrok-betaを使って応答を生成しているシンプルなAIエージェント型チャットボットフローの例です。基本的なxAIチャットボットと考えることができます。

このシンプルなチャットボットフローは以下を含みます:

LLM xAIは、xAIプロバイダーのGrok-betaなどのテキスト生成モデルを、AIフローやチャットボット内で接続・制御できるFlowHuntのコンポーネントです。

現在、FlowHuntはxAIのgrok-betaモデルに対応しており、今後APIが公開され次第、さらに多くのモデルに対応予定です。

最大トークン数、温度(応答の多様性)、利用可能なxAIモデルの選択など、チャットボットやAIツールの動作を細かく調整できます。

いいえ、必須ではありません。デフォルトではChatGPT-4oが使用されますが、xAIモデルに切り替えたり、さらに細かく制御したい場合にLLM xAIを接続できます。

フローにLLMコンポーネントを追加するだけでOKです。これがモデル選択の役割を果たし、実際のテキスト生成は接続されたAIエージェントやジェネレーターで行われます。

FlowHuntは、MetaのLlamaモデルを含む数十種類のテキスト生成モデルをサポートしています。LlamaをAIツールやチャットボットに統合する方法、最大トークン数や温度などの設定をカスタマイズする方法、AI活用ワークフローを効率化する方法をご紹介します。...

FlowHuntは、AnthropicのClaudeモデルを含む数十種類のAIモデルに対応しています。カスタマイズ可能な設定で、ClaudeをAIツールやチャットボットに組み込み、最適な応答を得る方法をご紹介します。...

FlowHuntは、OpenAIをはじめとする数十種類のテキスト生成モデルに対応しています。ここでは、AIツールやチャットボットでChatGPTを使用する方法をご紹介します。...