セマンティックセグメンテーション

セマンティックセグメンテーションは、画像を複数のセグメントに分割し、各ピクセルに物体や領域を表すクラスラベルを割り当てるコンピュータビジョン技術です。これにより、CNN、FCN、U-Net、DeepLabなどのディープラーニングモデルを用いて、自動運転、医療画像診断、ロボティクスなどの応用で詳細な理解が可能になります。...

インスタンスセグメンテーションは、画像内の各オブジェクトをピクセルレベルで検出・分割し、先進的なAIアプリケーションのための精密な物体認識を可能にします。

インスタンスセグメンテーションは、画像内に現れるそれぞれの個別オブジェクトを検出し、境界を明確に区分するタスクです。従来の物体検出がオブジェクトをバウンディングボックスで囲むのに対し、インスタンスセグメンテーションはさらに進んで、各オブジェクトのピクセル単位の位置を特定し、画像内容をより精密かつ詳細に理解します。

インスタンスセグメンテーションは、単にオブジェクトを検出するだけでなく、同じクラスに属する複数のオブジェクトを区別し、それぞれの形状や位置を正確に把握することが重要なシナリオで不可欠です。

インスタンスセグメンテーションを十分に理解するためには、他の画像セグメンテーションタスク(セマンティックセグメンテーション、パノプティックセグメンテーション)と比較すると分かりやすいです。

セマンティックセグメンテーションは、画像内の各ピクセルをあらかじめ定められたクラス(例:「車」「人」「木」など)に分類します。同じクラスに属するピクセルはすべて同じラベルとなり、個別のオブジェクトは区別されません。

一方、インスタンスセグメンテーションは、すべてのピクセルを分類するだけでなく、同じクラス内の個別オブジェクトも区別します。たとえば、画像内に複数の車があれば、それぞれを個別に認識・区分し、一意の識別子を付与します。これは個別オブジェクトの認識や追跡が必要な用途で特に重要です。

パノプティックセグメンテーションは、セマンティックセグメンテーションとインスタンスセグメンテーションの目標を統合したものです。画像内のすべてのピクセルにセマンティックラベルとインスタンスIDを割り当て、シーン全体を理解します。カウント可能な「物」クラス(例:人や車)と、形のない「もの」クラス(例:空、道路、草など)の両方を扱います。インスタンスセグメンテーションは主に「物」にフォーカスし、個別オブジェクトの検出・分割を行います。

インスタンスセグメンテーションのアルゴリズムは、主にディープラーニング技術、特に畳み込みニューラルネットワーク(CNN)を用いて画像を解析し、各オブジェクトインスタンスのセグメンテーションマスクを生成します。

Mask R-CNNは、インスタンスセグメンテーションで最も広く使われるアーキテクチャの一つです。Faster R-CNNモデルをベースに、各Region of Interest(RoI)ごとにセグメンテーションマスクを予測するブランチを追加しています。

Mask R-CNNの仕組み:

インスタンスセグメンテーションは、さまざまな業界で複雑なタスクに対応するための詳細な物体検出・分割機能を提供します。

インスタンスセグメンテーションはコンピュータビジョンタスクですが、AI自動化において、詳細な画像理解を通じて自動化システムが物理世界と知的に連携するために重要な役割を果たします。

チャットボットは基本的にテキストベースですが、インスタンスセグメンテーションを組み合わせることで視覚的なインターフェースが拡張されます。

インスタンスセグメンテーションはディープラーニングや計算手法の進化とともに急速に発展しています。

インスタンスセグメンテーションはAIシステムの現実世界への働きかけ能力を向上させ、医用画像解析、自動運転、ロボティクスなど多様な領域で進化を牽引しています。今後さらに中心的な技術となっていくでしょう。

インスタンスセグメンテーションは、画像内の各オブジェクトインスタンスを検出・分類・分割する重要なコンピュータビジョンタスクです。物体検出とセマンティックセグメンテーションを組み合わせ、詳細な洞察を提供します。主な研究成果を紹介します:

Learning Panoptic Segmentation from Instance Contours

この研究では、セマンティックセグメンテーションとインスタンスの輪郭(オブジェクトの境界)からインスタンスセグメンテーションを学習する全結合ニューラルネットワークを提案しました。インスタンス境界とセマンティックセグメンテーションを組み合わせて境界認識型セグメンテーションを実現し、連結成分ラベリングでインスタンスセグメンテーションを導出します。CityScapesデータセットで複数の検証を実施。

Ensembling Instance and Semantic Segmentation for Panoptic Segmentation

この論文は、2019年COCOパノプティックセグメンテーションタスクに対し、インスタンスセグメンテーションとセマンティックセグメンテーションを個別に実行し、最終的に統合する手法を紹介しました。データ不均衡にはMask R-CNNのエキスパートモデル、最良のインスタンスセグメンテーションにはHTCモデルを活用。アンサンブル戦略で性能をさらに向上し、COCOパノプティックtest-devデータでPQスコア47.1を達成。

続きを読む

Insight Any Instance: Promptable Instance Segmentation for Remote Sensing Images

この研究は、リモートセンシングインスタンスセグメンテーションにおける前景・背景の不均衡や小さなインスタンスの課題に対し、新たなプロンプトパラダイムを提案しています。ローカル・グローバルプロンプトモジュールがコンテキストをモデル化し、プロンプト可能性とセグメンテーション性能を向上。

続きを読む

インスタンスセグメンテーションは、画像内の各個別オブジェクトをピクセルレベルで検出・分類・分割するコンピュータビジョン技術であり、従来の物体検出やセマンティックセグメンテーションよりも詳細な情報を提供します。

セマンティックセグメンテーションは各ピクセルにクラスラベルを割り当てますが、同じクラス内の個別オブジェクトを区別しません。インスタンスセグメンテーションは各ピクセルにラベルをつけるだけでなく、同じクラス内の個別のオブジェクトも区別します。

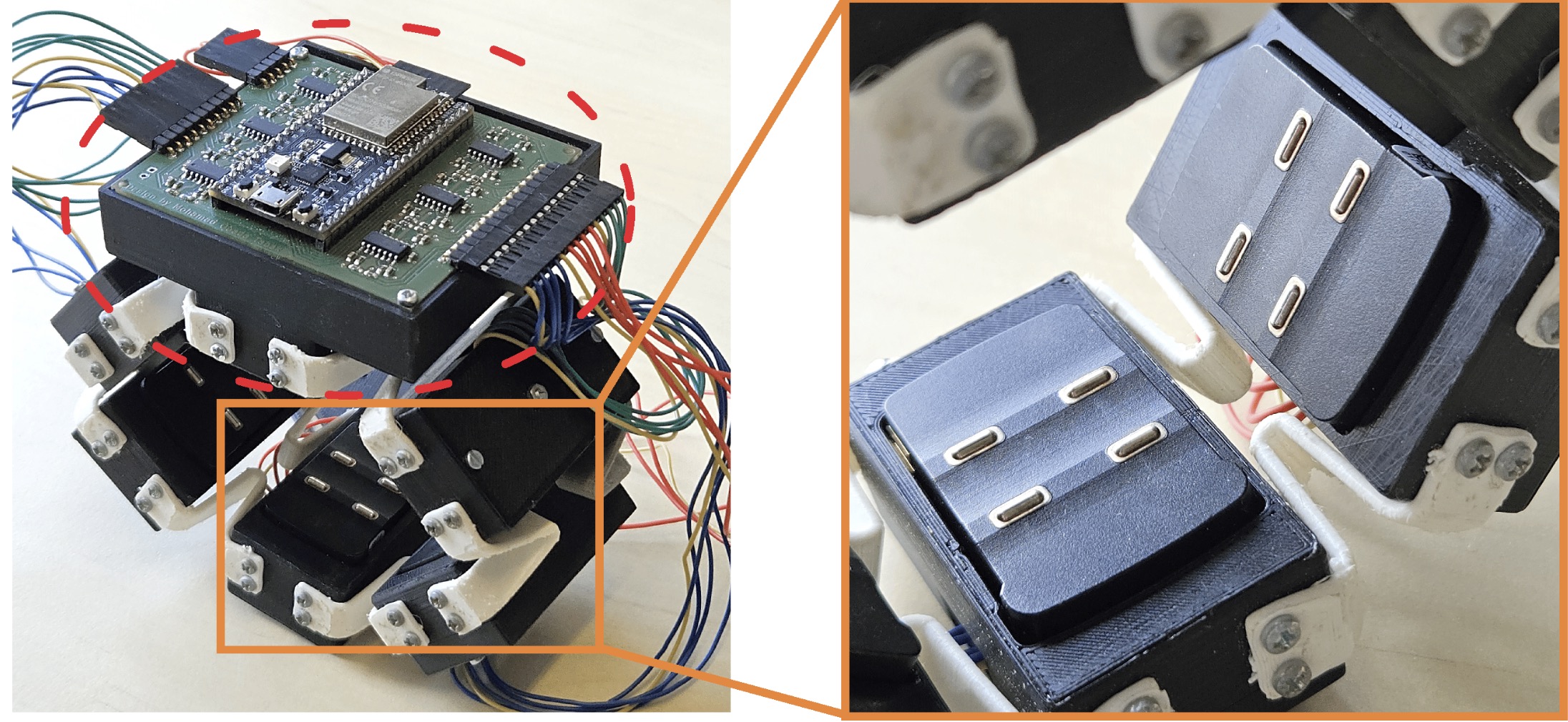

インスタンスセグメンテーションは、医用画像解析(例:腫瘍検出)、自動運転(物体認識・追跡)、ロボティクス(物体操作)、衛星画像(都市計画)、製造業(品質管理)、AR、ビデオ監視などで利用されています。

代表的なモデルには、Mask R-CNN、YOLACT、SOLO、SOLOv2、BlendMaskなどがあり、いずれもディープラーニング技術を用いて高精度なインスタンスごとのセグメンテーションマスクを生成します。

インスタンスセグメンテーションは、精密な物体境界線を提供することで、AIシステムが物理世界と知的に相互作用できるようにします。これにより、ロボットによるピッキング、リアルタイムナビゲーション、自動検査、画像理解を伴うチャットボットの強化などが可能となります。

FlowHuntのAIツールを活用して、先進的な自動化や詳細な物体検出、より賢い意思決定にインスタンスセグメンテーションを役立てる方法をご覧ください。

セマンティックセグメンテーションは、画像を複数のセグメントに分割し、各ピクセルに物体や領域を表すクラスラベルを割り当てるコンピュータビジョン技術です。これにより、CNN、FCN、U-Net、DeepLabなどのディープラーニングモデルを用いて、自動運転、医療画像診断、ロボティクスなどの応用で詳細な理解が可能になります。...

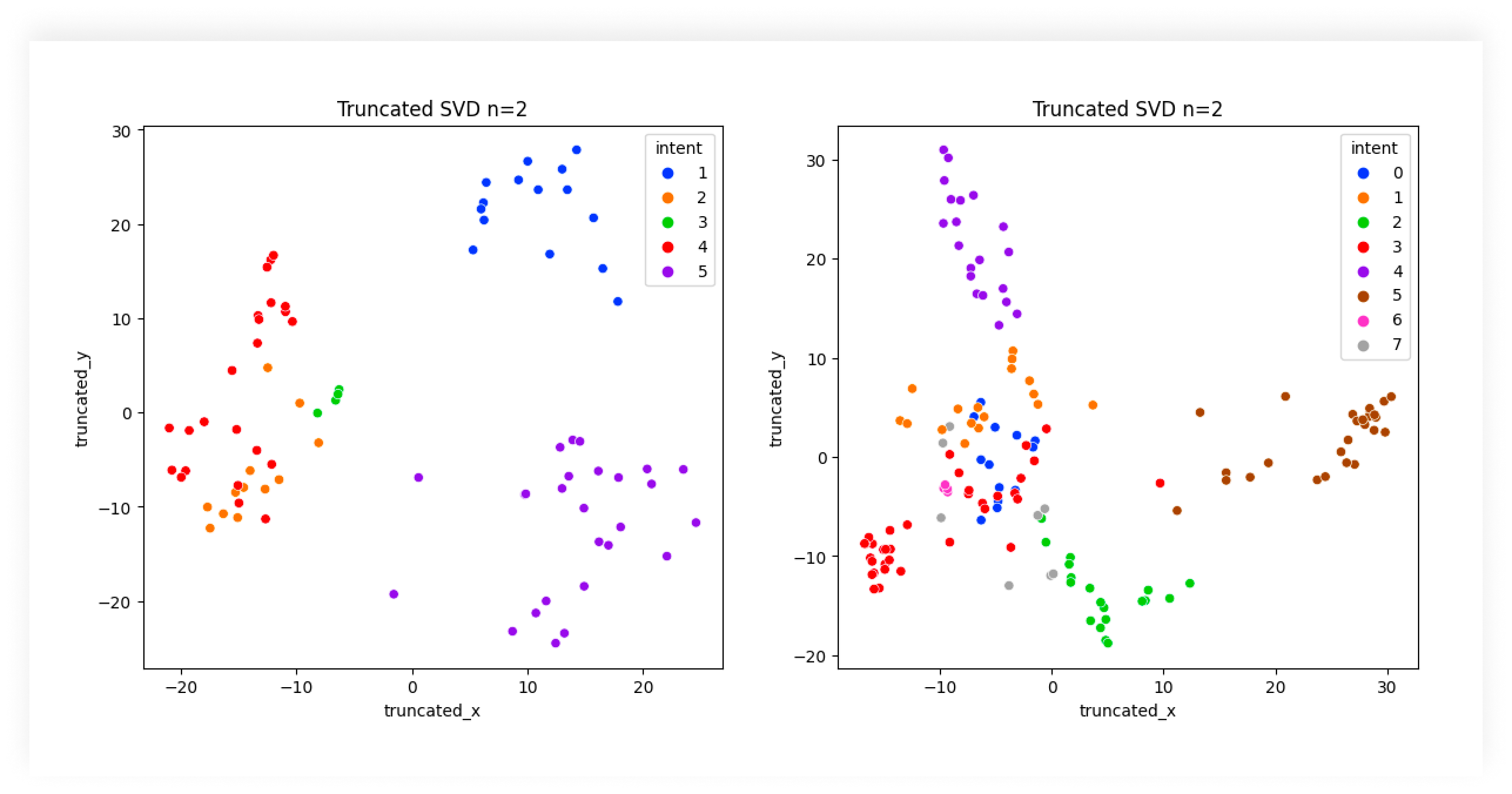

AIインテント分類の基礎、手法、実際の応用例、課題、そして人間と機械の対話を強化するための今後のトレンドについて学びましょう。...

AIインテント分類が、ユーザーとテクノロジーのやり取りを強化し、カスタマーサポートを向上させ、先進的なNLPと機械学習技術によってビジネスオペレーションを効率化する上で重要な役割を果たすことを発見しましょう。...