AllenNLP

AllenNLPは、AI2によってPyTorch上に構築された堅牢なオープンソースNLP研究用ライブラリです。モジュール式で拡張可能なツール、事前学習済みモデル、spaCyやHugging Faceなどのライブラリとの容易な統合を提供し、テキスト分類や共参照解析などのタスクをサポートします。...

AllenNLPは、AI2によってPyTorch上に構築された堅牢なオープンソースNLP研究用ライブラリです。モジュール式で拡張可能なツール、事前学習済みモデル、spaCyやHugging Faceなどのライブラリとの容易な統合を提供し、テキスト分類や共参照解析などのタスクをサポートします。...

BERT(Bidirectional Encoder Representations from Transformers)は、Googleによって開発された自然言語処理向けのオープンソース機械学習フレームワークです。BERTの双方向TransformerアーキテクチャがAIの言語理解をどのように革新したのか、そのNLP...

BMXNetは、Apache MXNetをベースとしたバイナリニューラルネットワーク(BNN)のオープンソース実装であり、バイナリ重みと活性化を用いて省電力デバイス向けに効率的なAI展開を可能にします。...

Caffeは、BVLCによって開発されたオープンソースのディープラーニングフレームワークであり、畳み込みニューラルネットワーク(CNN)の構築における高速性とモジュール性の最適化が特徴です。画像分類、物体検出などのAIアプリケーションで広く使用されており、柔軟なモデル構成、高速な処理、強力なコミュニティサポートを提供し...

Chainerはオープンソースのディープラーニングフレームワークで、柔軟で直感的、かつ高性能なニューラルネットワーク構築プラットフォームです。動的なdefine-by-runグラフ、GPUアクセラレーション、幅広いアーキテクチャのサポートを特徴とし、Preferred Networksによって開発され、大手テック企業の...

DALL-EはOpenAIによって開発されたテキストから画像を生成するモデルのシリーズで、ディープラーニングを用いてテキスト記述からデジタル画像を生成します。その歴史や、アート、マーケティング、教育分野での応用、倫理的な考慮点について解説します。...

DL4J(DeepLearning4J)は、Java仮想マシン(JVM)向けのオープンソースで分散型のディープラーニングライブラリです。Eclipseエコシステムの一部として、Java、Scala、その他のJVM言語を使ったディープラーニングモデルのスケーラブルな開発とデプロイメントを可能にします。...

FastaiはPyTorch上に構築されたディープラーニングライブラリであり、高レベルAPIや転移学習、レイヤードアーキテクチャを提供し、画像認識、NLP、表形式データなどのニューラルネットワーク開発を容易にします。Jeremy HowardとRachel Thomasによって開発され、Fastaiはオープンソースかつ...

Horovodは、複数のGPUやマシン間での効率的なスケーリングを可能にする、堅牢でオープンソースの分散ディープラーニングトレーニングフレームワークです。TensorFlow、Keras、PyTorch、MXNetをサポートし、機械学習モデルのトレーニングにおける速度とスケーラビリティを最適化します。...

Ideogram AIは、人工知能を活用してテキストプロンプトを高品質な画像に変換する革新的な画像生成プラットフォームです。深層学習ニューラルネットワークを活用することで、テキストとビジュアルの関係性を理解し、ユーザーの説明に忠実な画像を生成できます。...

Kerasは、Pythonで書かれた強力かつユーザーフレンドリーなオープンソースの高水準ニューラルネットワークAPIであり、TensorFlow、CNTK、Theanoの上で動作可能です。高速な実験を可能にし、生産環境から研究用途まで、モジュール性とシンプルさで幅広くサポートします。...

Apache MXNetは、ディープニューラルネットワークの効率的かつ柔軟なトレーニングとデプロイのために設計されたオープンソースのディープラーニングフレームワークです。スケーラビリティ、ハイブリッドプログラミングモデル、複数言語対応で知られており、研究者や開発者が高度なAIソリューションを構築するのを支援します。...

PyTorchはMeta AIによって開発されたオープンソースの機械学習フレームワークであり、その柔軟性、動的計算グラフ、GPUアクセラレーション、Pythonとのシームレスな統合で高く評価されています。ディープラーニング、コンピュータビジョン、NLP、研究用途で広く利用されています。...

Stable Diffusionは、テキストの説明から高品質でフォトリアリスティックな画像を生成する先進的なテキストから画像への生成モデルです。潜在拡散モデルとして、拡散モデルと機械学習を効率的に組み合わせ、与えられたプロンプトに非常に近い画像を生成できる、生成AI分野の大きなブレークスルーです。...

TensorFlowはGoogle Brainチームによって開発されたオープンソースのライブラリで、数値計算と大規模な機械学習を目的としています。ディープラーニングやニューラルネットワークをサポートし、CPU、GPU、TPU上で動作可能。データ取得、モデル学習、デプロイを簡素化します。...

Torchは、Luaをベースにしたオープンソースの機械学習ライブラリおよび科学計算フレームワークで、深層学習やAIタスク向けに最適化されています。ニューラルネットワーク構築用のツールを提供し、GPUによる高速化をサポート、PyTorchの前身としても知られています。...

AIや機械学習におけるシーケンスモデリングを解説—テキスト、音声、DNAなどのデータで、RNN・LSTM・GRU・Transformerを使ってシーケンスを予測・生成。主要な概念、応用例、課題、最新研究を探ります。...

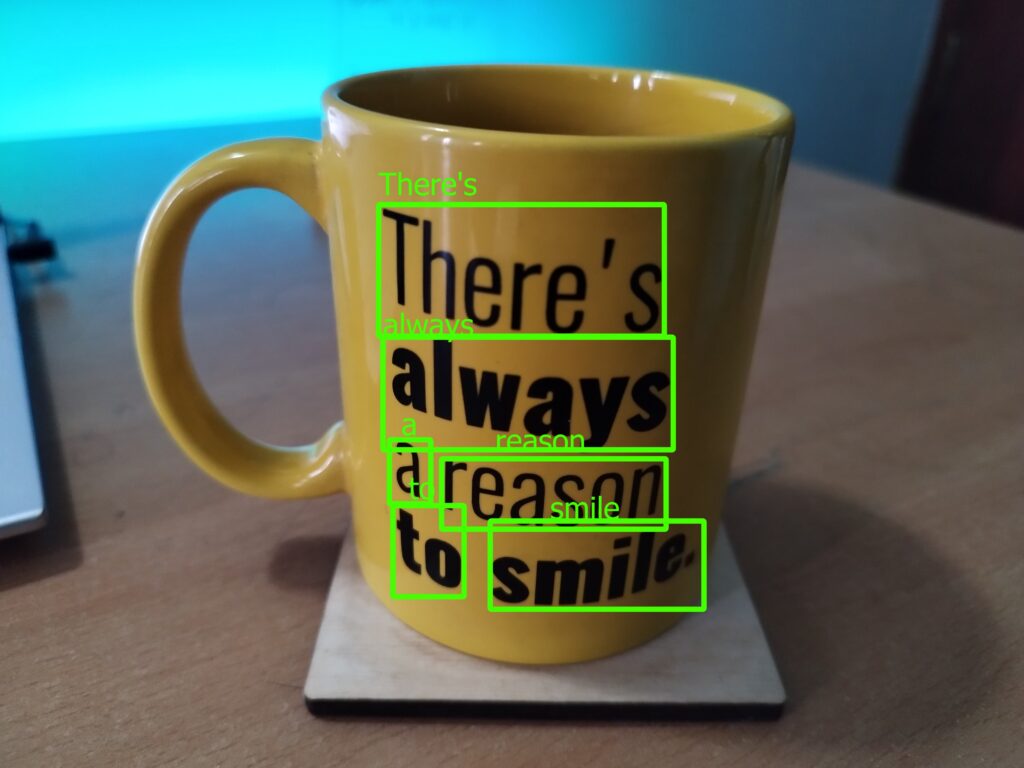

シーンテキスト認識(STR)は、AIとディープラーニングモデルを活用して、自然なシーンで撮影された画像内のテキストを特定・解釈する光学式文字認識(OCR)の専門分野です。STRは、複雑な実世界のテキストを機械可読な形式に変換することで、自動運転車、拡張現実、スマートシティインフラなどのアプリケーションを支えています。...

インスタンスセグメンテーションは、画像内の各個別オブジェクトをピクセルレベルで検出・区分するコンピュータビジョンタスクです。物体検出やセマンティックセグメンテーションよりも詳細な理解を提供し、医用画像解析、自動運転、ロボティクスなどの分野で重要な役割を果たします。...

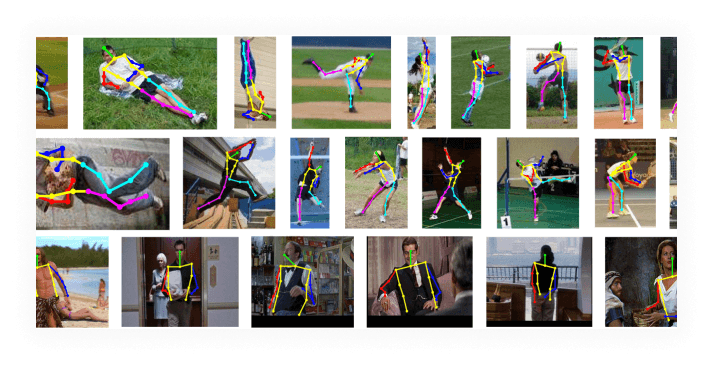

ポーズ推定は、画像や動画内の人物や物体の位置や姿勢を、キーポイントを特定・追跡することで予測するコンピュータビジョン技術です。スポーツ分析、ロボティクス、ゲーム、自動運転などのアプリケーションに不可欠です。...

コンピュータビジョンは、人工知能(AI)の分野の一つで、コンピュータが視覚的な世界を解釈し理解できるようにすることに焦点を当てています。カメラやビデオ、ディープラーニングモデルからのデジタル画像を活用することで、機械は物体を正確に識別・分類し、見たものに応じて反応することができます。...

セマンティックセグメンテーションは、画像を複数のセグメントに分割し、各ピクセルに物体や領域を表すクラスラベルを割り当てるコンピュータビジョン技術です。これにより、CNN、FCN、U-Net、DeepLabなどのディープラーニングモデルを用いて、自動運転、医療画像診断、ロボティクスなどの応用で詳細な理解が可能になります。...

ディープ・ビリーフ・ネットワーク(DBN)は、深層アーキテクチャと制限付きボルツマンマシン(RBM)を利用して、階層的なデータ表現を学習する高度な生成モデルであり、画像認識や音声認識などの教師あり・教師なしタスクに活用されます。...

ディープラーニングは、人工知能(AI)における機械学習の一分野であり、人間の脳の働きを模倣してデータを処理し、意思決定に利用するパターンを作り出します。これは人工ニューラルネットワークと呼ばれる脳の構造と機能に着想を得ています。ディープラーニングのアルゴリズムは複雑なデータの関係性を分析・解釈し、高精度な音声認識、画像...

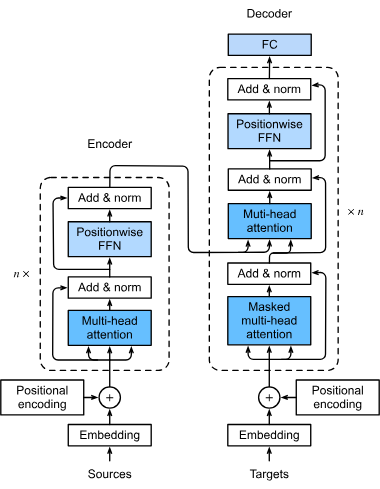

トランスフォーマーは、人工知能、特に自然言語処理に革命をもたらしたニューラルネットワークアーキテクチャです。2017年の「Attention is All You Need」で導入され、効率的な並列処理を可能にし、BERTやGPTなどのモデルの基盤となり、NLPや画像処理など幅広い分野に影響を与えています。...

ドロップアウトはAI、特にニューラルネットワークにおける正則化手法で、トレーニング中にランダムにニューロンを無効化することで過学習を防ぎ、頑健な特徴学習と新しいデータへの汎化能力を向上させます。...

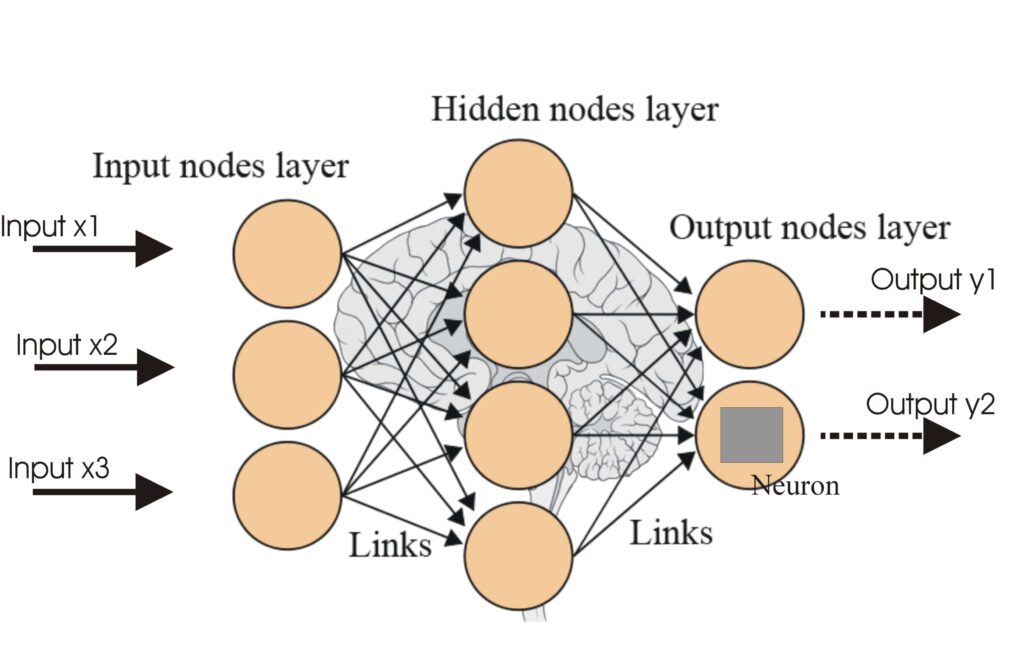

ニューラルネットワーク(人工ニューラルネットワーク / ANN)は、人間の脳に着想を得た計算モデルであり、パターン認識、意思決定、ディープラーニング応用など、AIや機械学習に不可欠です。...

ニューロモルフィック・コンピューティングは、ハードウェアとソフトウェアの両方の要素を人間の脳や神経系に倣って設計する最先端のコンピュータ工学のアプローチです。この学際的な分野は、ニューロモルフィック・エンジニアリングとも呼ばれ、コンピュータサイエンス、生物学、数学、電子工学、物理学から着想を得て、生体模倣型のコンピュー...

バックプロパゲーションは、予測誤差を最小限に抑えるために重みを調整し、人工ニューラルネットワークを訓練するアルゴリズムです。その仕組みやステップ、ニューラルネットワーク訓練の原則について学びましょう。...

バッチ正規化は、ディープラーニングにおいて内部共変量シフトを解消し、活性化を安定させることで、ニューラルネットワークの学習プロセスを大幅に強化し、より速く安定した学習を可能にする画期的な手法です。...

モデルのファインチューニングは、事前学習済みのモデルを新しいタスクに適応させるために軽微な調整を行い、データやリソースの必要性を削減します。ファインチューニングが転移学習をどのように活用し、さまざまな手法、ベストプラクティス、評価指標によってNLPやコンピュータビジョンなどの分野で効率的にモデル性能を向上させるかを学び...

フレシェ・インセプション・ディスタンス(FID)は、生成モデル、特にGANsによって生成された画像の品質を評価するための指標です。FIDは生成画像と実画像の分布を比較し、画像の品質と多様性をより包括的に測定します。...

ヘルスケアにおける人工知能(AI)は、機械学習、自然言語処理(NLP)、ディープラーニングなどの先進的なアルゴリズムや技術を活用し、複雑な医療データを分析、診断の強化、治療の個別化、業務効率の向上を実現し、患者ケアを変革しつつ創薬の加速も促進します。...

画像における異常検知は、通常とは異なるパターンを特定する技術であり、産業検査や医用画像診断などで重要な役割を果たします。教師なし・弱教師あり手法、AIの統合、実際のユースケースについて解説します。...

AIにおける画像認識とは何か、その用途、最新トレンド、類似技術との違いについてご紹介します。

活性化関数は人工ニューラルネットワークの基礎であり、非線形性を導入して複雑なパターンの学習を可能にします。本記事では、AI・ディープラーニング・ニューラルネットワークにおける活性化関数の目的、種類、課題、主要な応用例について解説します。...

強化学習(RL)は、機械学習の一分野であり、エージェントが環境内で一連の意思決定を行い、報酬や罰則というフィードバックを通じて最適な行動を学習することに焦点を当てています。強化学習の主要な概念、アルゴリズム、応用例、課題について探ってみましょう。...

光学文字認識(OCR)は、スキャンした書類、PDF、画像などのドキュメントを編集・検索可能なデータに変換する革新的な技術です。OCRの仕組み、種類、用途、メリット、制限、そしてAIを活用した最新のOCRシステムの進歩について学びましょう。...

勾配降下法は、機械学習や深層学習で広く用いられる基本的な最適化アルゴリズムで、モデルのパラメータを反復的に調整することでコスト関数や損失関数を最小化します。ニューラルネットワークなどのモデル最適化に不可欠であり、バッチ、確率的、ミニバッチ勾配降下法などの形式で実装されます。...

再帰型ニューラルネットワーク(RNN)は、以前の入力の記憶を活用して逐次データを処理する高度な人工ニューラルネットワークの一種です。RNNは、データの順序が重要となるNLP、音声認識、時系列予測などのタスクで優れた性能を発揮します。...

自然言語処理(NLP)は、計算言語学、機械学習、ディープラーニングを用いて、コンピュータが人間の言語を理解・解釈・生成できるようにする技術です。NLPは翻訳、チャットボット、感情分析などのアプリケーションを支え、産業を変革し、人間とコンピュータのインタラクションを向上させています。...

AIにおける収束(コンバージェンス)とは、機械学習やディープラーニングモデルが反復学習を通じて安定した状態に到達し、予測値と実際の結果との差(損失関数)を最小化することで正確な予測を実現するプロセスを指します。これは、自動運転車やスマートシティなど、さまざまなアプリケーションにおけるAIの有効性と信頼性の基盤となります...

畳み込みニューラルネットワーク(CNN)は、画像のような構造化されたグリッドデータを処理するために設計された特殊な人工ニューラルネットワークです。CNNは、画像分類、物体検出、画像セグメンテーションなど、視覚データを扱うタスクに特に効果的です。人間の脳の視覚処理メカニズムを模倣しており、コンピュータビジョン分野の基盤と...

人工ニューラルネットワーク(ANN)は、人間の脳をモデルにした機械学習アルゴリズムの一種です。これらの計算モデルは、相互に接続されたノード(「ニューロン」)で構成されており、複雑な問題を解決するために協力します。ANNは、画像や音声認識、自然言語処理、予測分析などの分野で広く利用されています。...

生成型事前学習トランスフォーマー(GPT)は、深層学習技術を活用して人間の文章に極めて近いテキストを生成するAIモデルです。トランスフォーマーアーキテクチャに基づき、GPTは自己注意メカニズムを用いて効率的にテキストを処理・生成し、コンテンツ制作やチャットボットなどのNLPアプリケーションを革新しました。...

生成系AIは、テキスト、画像、音楽、コード、動画など新しいコンテンツを生成できる人工知能アルゴリズムのカテゴリを指します。従来のAIとは異なり、生成系AIは学習したデータに基づいて独自のアウトプットを生み出し、さまざまな業界で創造性と自動化を実現します。...

双方向長短期記憶(BiLSTM)は、順方向と逆方向の両方で系列データを処理する高度なリカレントニューラルネットワーク(RNN)アーキテクチャであり、NLP、音声認識、バイオインフォマティクスのアプリケーションにおいてコンテキスト理解を強化します。...

大規模言語モデル(LLM)は、膨大なテキストデータで訓練されたAIの一種で、人間の言語を理解・生成・操作することができます。LLMはディープラーニングやトランスフォーマーニューラルネットワークを用い、テキスト生成、要約、翻訳など多様な業界でのタスクを実現します。...

長短期記憶(LSTM)は、時系列データにおける長期的な依存関係を学習するために設計された、再帰型ニューラルネットワーク(RNN)の特殊なアーキテクチャです。LSTMネットワークはメモリーセルとゲーティング機構を利用して勾配消失問題に対処し、言語モデル、音声認識、時系列予測などのタスクで不可欠な存在となっています。...

転移学習は、あるタスクで訓練されたモデルを関連する別のタスクに再利用する高度な機械学習手法であり、特にデータが不足している場合に効率と性能を向上させます。...

転移学習は、事前学習済みモデルを新たなタスクに適応させ、限られたデータでも性能を向上させ、画像認識や自然言語処理(NLP)など多様なアプリケーションで効率性を高める強力なAI/ML技術です。...

埋め込みベクトルは、データの意味的・文脈的な関係を捉える多次元空間上の高密度な数値表現です。NLP、画像処理、レコメンデーションなどAIのさまざまなタスクを支える埋め込みベクトルの仕組みを解説します。...