AIにおける透明性

人工知能(AI)における透明性とは、AIシステムの意思決定プロセス、アルゴリズム、データなどの運用に関する開示性と明確さを指します。これはAI倫理とガバナンスに不可欠であり、説明責任、信頼性、法規制遵守を確保します。...

1 分で読める

AI

Transparency

+4

人工知能(AI)における透明性とは、AIシステムの意思決定プロセス、アルゴリズム、データなどの運用に関する開示性と明確さを指します。これはAI倫理とガバナンスに不可欠であり、説明責任、信頼性、法規制遵守を確保します。...

AIの透明性とは、人工知能システムの仕組みや意思決定プロセスを関係者にとって理解可能にする実践です。その重要性、主要構成要素、規制枠組み、実装手法、課題、実際のユースケースについて学びましょう。...

説明可能なAI(XAI)は、AIモデルの出力を人間が理解できるようにするための一連の手法とプロセスです。これにより、複雑な機械学習システムにおける透明性、解釈性、説明責任が促進されます。...

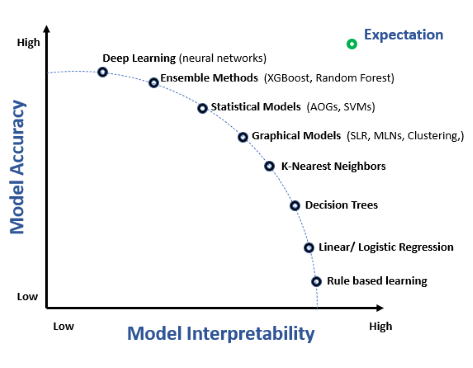

モデルの解釈性とは、機械学習モデルが行う予測や意思決定を理解し、説明し、信頼できる能力を指します。これはAIにとって重要であり、特に医療、金融、自律システムにおける意思決定の際に不可欠です。複雑なモデルと人間の理解力のギャップを埋める役割を果たします。...

AIの説明可能性とは、人工知能システムが行った決定や予測を理解し、解釈できる能力を指します。AIモデルがより複雑になるにつれて、説明可能性はLIMEやSHAPなどの手法を通じて透明性、信頼性、規制遵守、バイアスの軽減、モデルの最適化を実現します。...