質問応答 検索拡張生成(RAG)による質問応答は、リアルタイムな外部データを統合することで、言語モデルの応答をより正確かつ関連性の高いものに強化します。動的な分野でのパフォーマンスを最適化し、精度の向上、動的コンテンツ、関連性の強化を実現します。

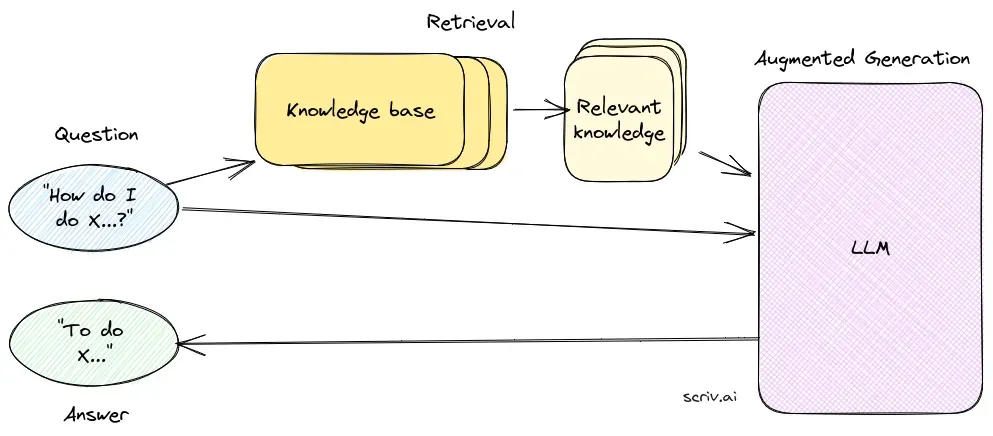

検索拡張生成(RAG)による質問応答 は、情報検索と自然言語生成の強みを組み合わせて人間らしいテキストをデータから生成し、AIやチャットボット、レポート、パーソナライズ体験を強化する革新的な手法です。このハイブリッドアプローチは、大規模言語モデル(LLM)の応答に外部データソースから取得した関連性が高く最新の情報を補完することで、その能力を高めます。従来の事前学習済みモデルに頼る手法と異なり、RAGは外部データを動的に統合し、特に最新情報や専門知識が必要な分野で、より正確かつ文脈に即した回答を可能にします。

RAGは、内部データセットだけでなくリアルタイムかつ権威あるソースに基づいて回答を生成することで、LLMのパフォーマンスを最適化します。このアプローチは、情報が絶えず更新される動的な分野での質問応答タスクに不可欠です。

RAGの主な構成要素 1. 検索コンポーネント 検索コンポーネントは、膨大なデータセット(通常はベクターデータベースに格納)から関連情報を取得する役割を担います。このコンポーネントはセマンティックサーチ技術を用い、ユーザーのクエリに高く関連するテキスト断片や文書を特定・抽出します。

ベクターデータベース :文書のベクター表現を保存する専門データベース。これらの埋め込みにより、ユーザーのクエリと意味的に一致するテキスト断片の効率的な検索・取得が可能です。セマンティックサーチ :単なるキーワード一致ではなく、ベクター埋め込みを活用することで意味的な類似性に基づいて文書を探し、取得した情報の関連性と正確性を向上させます。2. 生成コンポーネント 生成コンポーネントは、通常GPT-3やBERTなどのLLMが担当し、ユーザーのクエリと取得した文脈を組み合わせて回答を生成します。このコンポーネントは、一貫性があり文脈に即した応答を生み出すために重要です。

言語モデル(LLM) :入力プロンプトに基づいてテキストを生成するように訓練されており、RAGシステムでは取得文書を文脈として利用し、回答の品質と関連性を高めます。RAGシステムのワークフロー 文書準備 :システムはまず大量の文書をロードし、解析しやすい形式に変換します。通常、文書は小さなチャンクに分割されます。ベクター埋め込み :各文書チャンクを、言語モデルによって生成された埋め込みベクターに変換します。これらのベクターは効率的な検索のためベクターデータベースに保存されます。クエリ処理 :ユーザーからクエリを受け取ると、システムはクエリをベクター化し、ベクターデータベースで類似検索を行い関連する文書チャンクを特定します。文脈的な回答生成 :取得した文書チャンクをユーザーのクエリと組み合わせてLLMに入力し、最終的に文脈が強化された回答を生成します。出力 :システムは、クエリに対して正確かつ関連性の高い、文脈に即した情報で補強された回答を返します。ビジネスを成長させる準備はできましたか? 今日から無料トライアルを開始し、数日で結果を確認しましょう。

RAGの利点 精度の向上 :関連する文脈を取得することで、RAGは単体のLLMで起こりがちな誤ったり古い回答のリスクを最小限に抑えます。動的コンテンツ :RAGシステムは最新のナレッジベースから最新情報を統合できるため、最新データが必要な分野に最適です。関連性の強化 :検索プロセスによって、生成される回答がクエリの文脈に最適化され、応答の質と関連性が高まります。ユースケース チャットボットとバーチャルアシスタント :RAG搭載システムは、正確で文脈認識された応答を提供し、ユーザー体験と満足度を向上させます。カスタマーサポート :RAGシステムは、関連するポリシー文書や商品情報を取得し、ユーザーの問い合わせに正確な回答を提供します。コンテンツ生成 :RAGモデルは、取得した情報を統合して文書やレポートを自動生成する用途にも適しています。教育ツール :教育分野では、RAGシステムが最新の教育コンテンツに基づく説明や要約を提供する学習アシスタントとして活用できます。ニュースレターに登録 最新のヒント、トレンド、お得な情報を無料で入手。

技術的な実装 RAGシステムの実装には、いくつかの技術的なステップが必要です。

ベクター保存と検索 :PineconeやFAISSなどのベクターデータベースを利用し、ドキュメント埋め込みを効率的に保存・検索します。言語モデル統合 :GPT-3やカスタムモデルをHuggingFace Transformersなどのフレームワークで統合し、生成部分を管理します。パイプライン構成 :検索から回答生成までの流れを管理するパイプラインを構築し、全てのコンポーネントが円滑に連携するようにします。課題と考慮点 コストとリソース管理 :RAGシステムはリソース消費が多くなるため、計算コストの最適化が求められます。事実の正確性 :取得した情報が正確かつ最新であることを保証し、誤解を招く回答の生成を防ぐことが重要です。セットアップの複雑さ :RAGシステムの初期構築は複雑であり、複数のコンポーネントを慎重に統合・最適化する必要があります。検索拡張生成(RAG)による質問応答の研究

検索拡張生成(RAG)は、検索機構と生成モデルを組み合わせて質問応答システムを強化する手法です。近年、様々な文脈でのRAGの有効性と最適化に関する研究が進められています。

長文脈言語モデル時代におけるRAGの有用性の擁護 :この論文では、より長いテキストシーケンスを処理する長文脈言語モデルの登場にもかかわらず、RAGの重要性は依然高いと主張しています。著者らは、長文脈型質問応答タスクにおけるRAGの性能を最適化するOrder-Preserve Retrieval-Augmented Generation(OP-RAG)を提案し、実験を通じて、OP-RAGが長文脈モデルと比較してより少ないトークンで高品質な回答が得られることを示しています。Read more.CLAPNQ: RAGシステム向けNatural Questionsにおけるパッセージ根拠の一貫した長文回答 :この研究は、RAGシステムによる一貫性のある長文回答生成の評価用ベンチマークデータセットClapNQを紹介しています。本データセットは、幻覚を含まない特定パッセージに根拠を持つ回答に焦点を当て、RAGモデルに簡潔で一貫した回答形式への適応を促します。著者らは、RAGシステムの改善余地を示すベースライン実験も提供しています。詳しくはこちら Elasticsearchによる検索拡張生成の最適化と質問応答システムの強化 :この研究では、ElasticsearchをRAGフレームワークに統合し、質問応答システムの効率と精度を向上させています。Stanford Question Answering Dataset(SQuAD)バージョン2.0を用いて、様々な検索手法を比較し、ES-RAGスキームが検索効率・精度ともに他手法を0.51ポイント上回ることを示しています。今後はElasticsearchと言語モデルの連携による応答強化のさらなる可能性が期待されています。Read more.