워드 임베딩

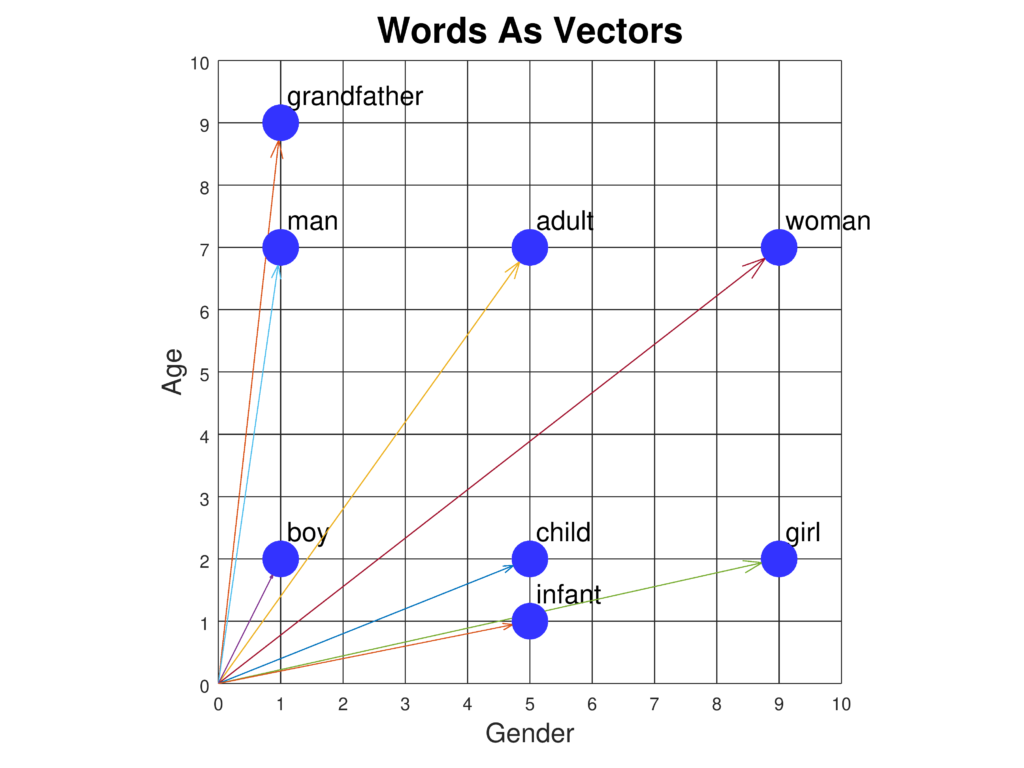

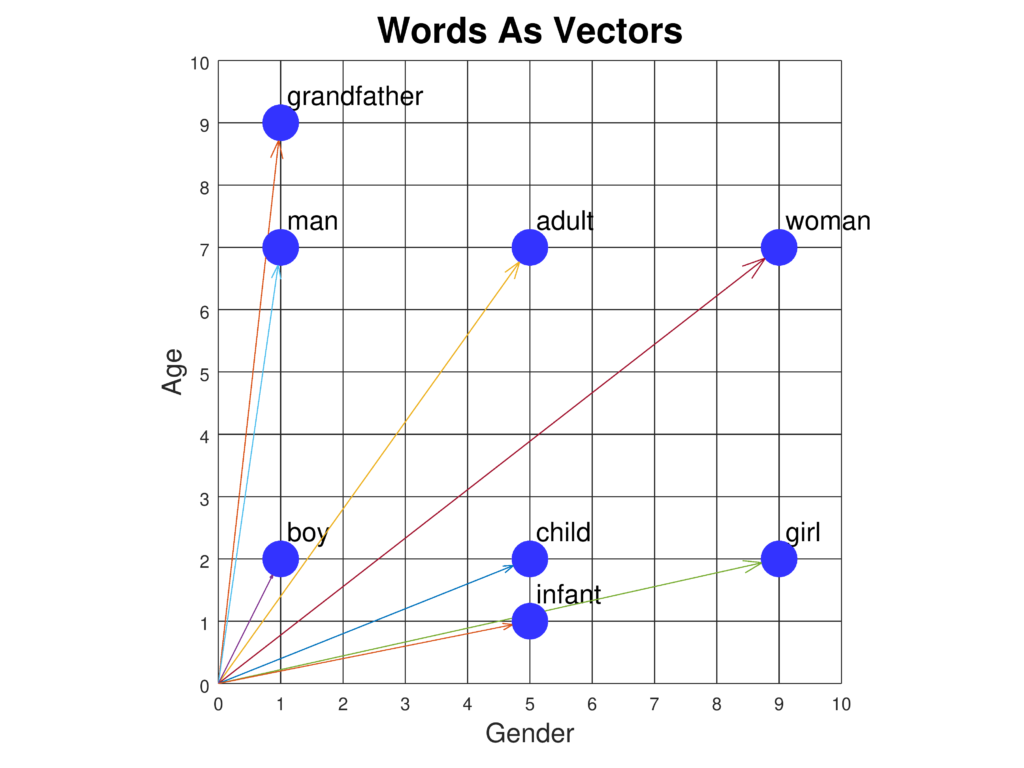

워드 임베딩은 연속적인 벡터 공간에서 단어를 정교하게 표현하여, 의미적·구문적 관계를 포착함으로써 텍스트 분류, 기계 번역, 감정 분석 등 고급 자연어 처리(NLP) 작업에 활용됩니다....

임베딩 벡터는 데이터의 의미적 및 맥락적 관계를 포착하는 다차원 공간에서의 밀집 수치 표현입니다. 임베딩 벡터가 자연어 처리, 이미지 처리, 추천 등 다양한 AI 작업을 어떻게 지원하는지 알아보세요.

임베딩 벡터는 각 데이터가 다차원 공간의 한 점으로 매핑되는 데이터의 밀집 수치 표현입니다. 이 매핑은 데이터 간의 의미 정보와 맥락적 관계를 포착하도록 설계되었습니다. 유사한 데이터 포인트는 이 공간에서 더 가깝게 배치되어, 분류, 군집화, 추천 등의 작업을 용이하게 합니다.

임베딩 벡터는 본질적으로 데이터가 지닌 고유 특성과 관계를 담는 숫자 배열입니다. 복잡한 데이터 유형을 이 벡터로 변환함으로써 AI 시스템은 다양한 연산을 더 효율적으로 수행할 수 있습니다.

임베딩 벡터는 다양한 AI 및 머신러닝 애플리케이션의 핵심입니다. 고차원 데이터를 단순화하여 분석과 해석을 쉽게 만듭니다.

임베딩 벡터를 생성하는 과정은 다음과 같습니다.

Huggingface의 Transformers 라이브러리는 BERT, RoBERTa, GPT-3 등 최신 트랜스포머 모델을 제공합니다. 이 모델들은 방대한 데이터셋으로 사전 학습되어 있으며, 특정 작업에 맞춰 파인튜닝할 수 있는 고품질 임베딩을 제공합니다. robust한 NLP 애플리케이션 구현에 적합합니다.

먼저, Python 환경에 transformers 라이브러리를 설치해야 합니다. pip을 이용해 설치할 수 있습니다.

pip install transformers

다음으로, Huggingface 모델 허브에서 사전 학습된 모델을 불러옵니다. 여기서는 BERT를 예로 사용합니다.

from transformers import BertModel, BertTokenizer

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertModel.from_pretrained(model_name)

입력 텍스트를 모델에 맞게 토크나이즈합니다.

inputs = tokenizer("Hello, Huggingface!", return_tensors='pt')

토크나이즈된 텍스트를 모델에 입력하여 임베딩을 얻습니다.

outputs = model(**inputs)

embedding_vectors = outputs.last_hidden_state

위 단계를 포함한 전체 예시는 다음과 같습니다.

from transformers import BertModel, BertTokenizer

# 사전 학습 BERT 모델과 토크나이저 불러오기

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertModel.from_pretrained(model_name)

# 입력 텍스트 토크나이징

text = "Hello, Huggingface!"

inputs = tokenizer(text, return_tensors='pt')

# 임베딩 벡터 생성

outputs = model(**inputs)

embedding_vectors = outputs.last_hidden_state

print(embedding_vectors)

SNE는 Geoffrey Hinton과 Sam Roweis가 개발한 초기 차원 축소 기법입니다. 고차원 공간에서 쌍별 유사도를 계산하고, 이를 저차원 공간에서도 최대한 보존하도록 합니다.

SNE의 개선된 버전으로, 고차원 데이터를 시각화할 때 널리 사용됩니다. 원본 공간과 축소 공간의 쌍별 유사도를 각각 확률 분포로 나타내고, Student-t 분포를 이용해 두 분포 간의 차이를 최소화합니다.

UMAP은 t-SNE보다 빠르고 전역 데이터 구조 보존이 더 뛰어난 최신 기법입니다. 고차원 그래프를 구성하고, 저차원 그래프가 구조적으로 최대한 유사하도록 최적화합니다.

여러 도구와 라이브러리가 임베딩 벡터 시각화를 지원합니다.

워드 임베딩은 연속적인 벡터 공간에서 단어를 정교하게 표현하여, 의미적·구문적 관계를 포착함으로써 텍스트 분류, 기계 번역, 감정 분석 등 고급 자연어 처리(NLP) 작업에 활용됩니다....

AI 검색은 검색 쿼리의 의도와 맥락적 의미를 이해하기 위해 머신러닝 모델을 사용하는 의미 기반 또는 벡터 기반 검색 방법론으로, 기존의 키워드 기반 검색보다 더 관련성 높고 정확한 결과를 제공합니다....

비지도 학습은 기계 학습의 한 분야로, 라벨이 없는 데이터에서 패턴, 구조, 관계를 찾아내어 클러스터링, 차원 축소, 연관 규칙 학습과 같은 작업을 가능하게 하며, 고객 세분화, 이상 감지, 추천 엔진 등 다양한 응용 분야에 활용됩니다....