자연어 처리(NLP)

자연어 처리(NLP)는 컴퓨터가 계산 언어학, 기계 학습, 딥러닝을 활용해 인간의 언어를 이해하고 해석하며 생성할 수 있도록 합니다. NLP는 번역, 챗봇, 감정 분석 등 다양한 애플리케이션의 기반이 되어 산업을 혁신하고 인간-컴퓨터 상호작용을 향상시킵니다....

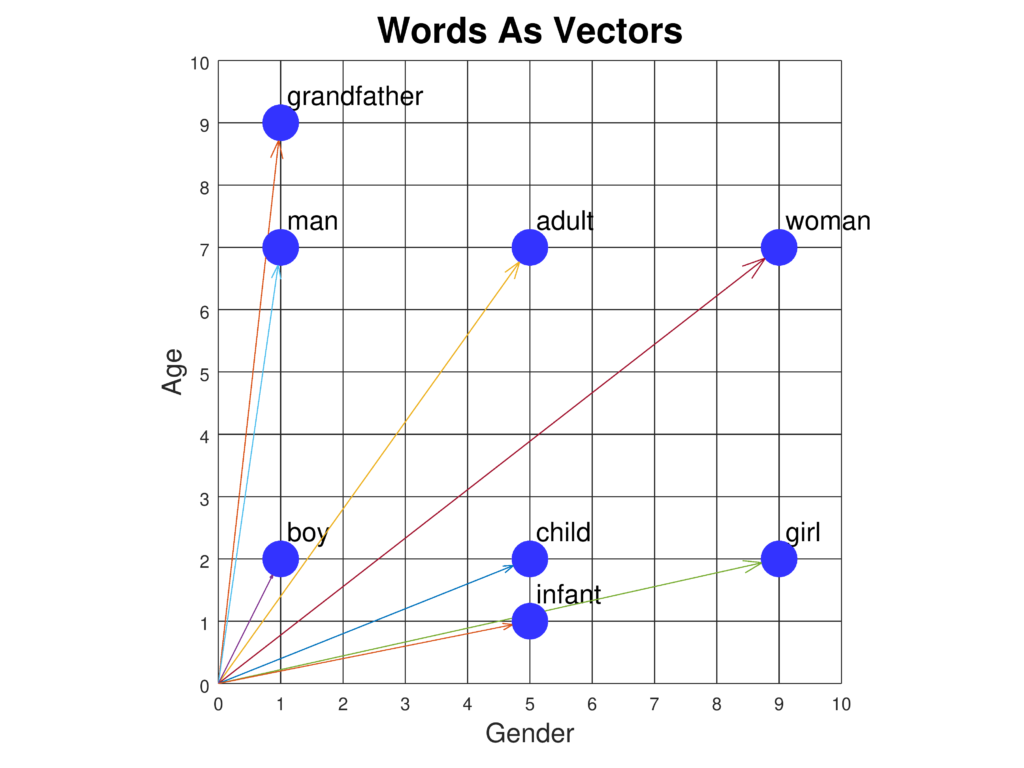

워드 임베딩은 연속적인 벡터 공간에서 단어를 정교하게 표현하여, 의미적·구문적 관계를 포착함으로써 텍스트 분류, 기계 번역, 감정 분석 등 고급 자연어 처리(NLP) 작업에 활용됩니다.

워드 임베딩은 NLP에서 인간-컴퓨터 상호작용의 핵심을 이루는 기술입니다. 그 주요 개념, 동작 방식, 활용 사례를 지금 확인해보세요!

NLP 분야 워드 임베딩 관련 연구

Learning Word Sense Embeddings from Word Sense Definitions

*Qi Li, Tianshi Li, Baobao Chang (2016)*은 다의어 및 동음이의어 문제를 해결하기 위해 단어 의미별 임베딩을 단어 정의로부터 학습하는 방법을 제안했습니다. 코퍼스 기반 훈련을 통해 고품질의 의미별 임베딩을 얻었으며, 단어 유사도 및 의미 중의성 해소 작업에서 성능이 향상됨을 입증했습니다. 해당 연구는 의미별 임베딩의 NLP 활용 가능성을 보여줍니다. 더 알아보기

Neural-based Noise Filtering from Word Embeddings

*Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016)*는 임베딩 내 불필요한 정보를 제거하는 두 가지 노이즈 필터링 모델을 제안했습니다. 비지도 학습을 활용해 임베딩의 핵심 정보는 강화하고 노이즈는 줄이며, 딥 피드포워드 신경망으로 성능이 향상된 임베딩을 생성했습니다. 벤치마크 작업에서 탁월한 결과를 보였습니다. 더 알아보기

A Survey On Neural Word Embeddings

*Erhan Sezerer, Selma Tekir (2021)*는 신경망 기반 워드 임베딩의 발전과 NLP에 미친 영향을 종합적으로 정리했습니다. 주요 이론과 의미별·형태소·컨텍스트 임베딩 등 다양한 종류를 다루며, 벤치마크 데이터셋과 성능 평가도 분석했습니다. 신경망 임베딩이 NLP 작업에 미치는 변혁적 영향을 강조합니다. 더 알아보기

Improving Interpretability via Explicit Word Interaction Graph Layer

*Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023)*는 WIGRAPH라는 신경망 계층을 통해 단어 간의 글로벌 상호작용 그래프를 구축하여 NLP 모델의 해석 가능성과 예측 성능 모두를 높였습니다. 이 계층은 어떤 텍스트 분류기에도 적용 가능하며, 단어 간 상호작용의 중요성을 강조합니다. 더 알아보기

Word Embeddings for Banking Industry

*Avnish Patel (2023)*은 금융 분야에서 워드 임베딩의 활용(감정 분석, 텍스트 분류 등)을 다루었습니다. Word2Vec, GloVe 등 정적 임베딩과 컨텍스트 모델 모두의 활용 사례를 분석하며, 업계 특화 NLP 작업에 끼치는 영향을 강조합니다. 더 알아보기

자연어 처리(NLP)는 컴퓨터가 계산 언어학, 기계 학습, 딥러닝을 활용해 인간의 언어를 이해하고 해석하며 생성할 수 있도록 합니다. NLP는 번역, 챗봇, 감정 분석 등 다양한 애플리케이션의 기반이 되어 산업을 혁신하고 인간-컴퓨터 상호작용을 향상시킵니다....

자연어 처리(NLP)는 인공지능(AI)의 한 분야로, 컴퓨터가 인간의 언어를 이해하고 해석하며 생성할 수 있도록 합니다. 주요 개념, 작동 방식, 산업별 응용 사례를 알아보세요....

임베딩 벡터는 데이터의 의미적 및 맥락적 관계를 포착하는 다차원 공간에서의 밀집 수치 표현입니다. 임베딩 벡터가 자연어 처리, 이미지 처리, 추천 등 다양한 AI 작업을 어떻게 지원하는지 알아보세요....