대형 언어 모델 메타 AI (LLaMA)

대형 언어 모델 메타 AI (LLaMA)는 Meta에서 개발한 최첨단 자연어 처리 모델입니다. 최대 650억 개의 파라미터를 보유한 LLaMA는 번역, 요약, 챗봇 등 다양한 작업에서 인간과 유사한 텍스트 이해 및 생성에 뛰어납니다....

컴포넌트 설명

LLM 메타 AI 컴포넌트는 Claude 계열의 모델을 Flow에 연결합니다. 실제 생성이나 작업은 Generator와 Agent에서 이루어지지만, LLM 컴포넌트를 통해 사용되는 모델을 제어할 수 있습니다. 모든 컴포넌트는 기본적으로 ChatGPT-4를 탑재하고 있습니다. 모델을 변경하거나 세부적으로 제어하고 싶을 때 이 컴포넌트를 연결하면 됩니다.

LLM 컴포넌트 연결은 선택 사항임을 기억하세요. LLM을 사용하는 모든 컴포넌트는 기본적으로 ChatGPT-4o로 설정되어 있습니다. LLM 컴포넌트는 모델 변경 및 설정 제어를 가능하게 합니다.

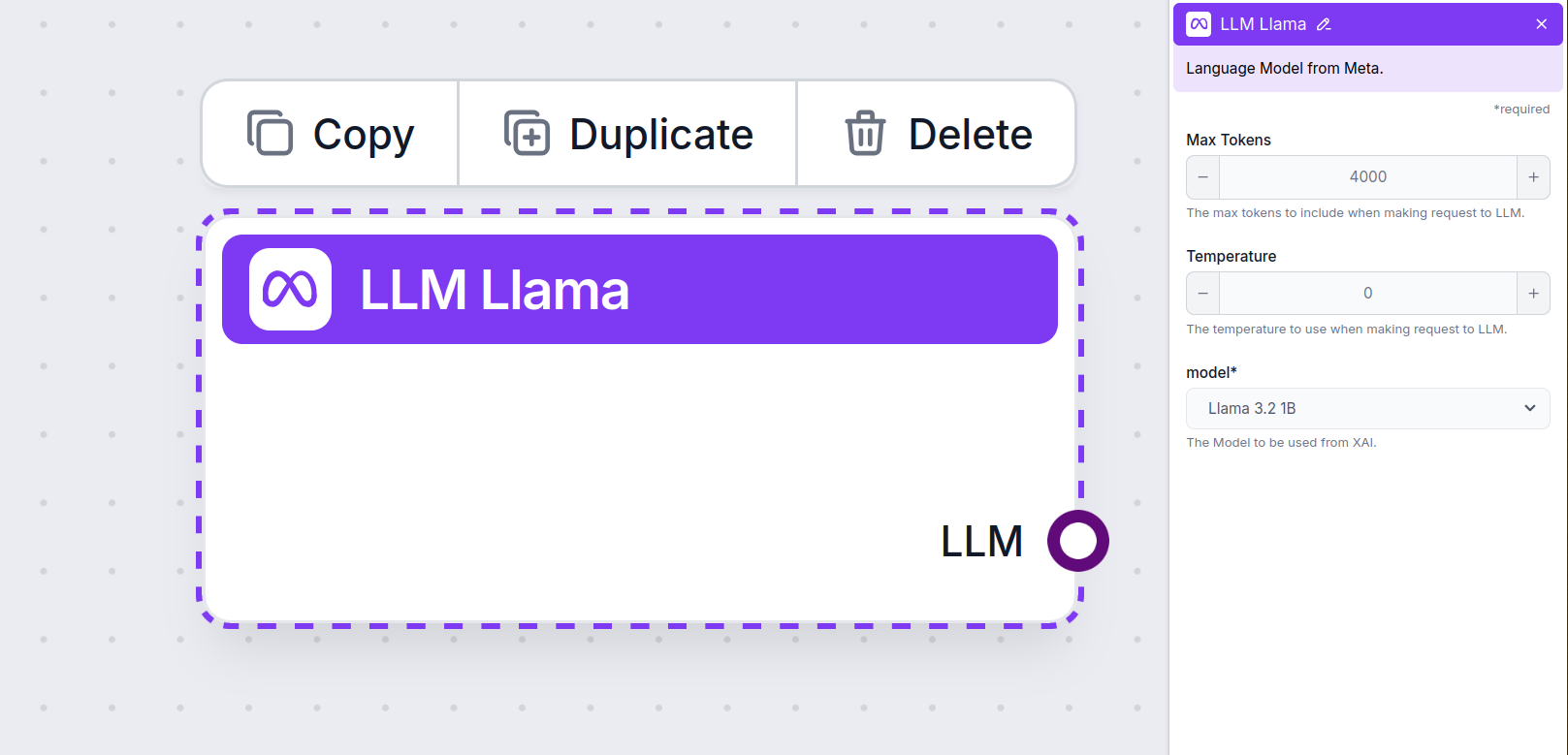

토큰은 모델이 처리하고 생성하는 텍스트의 개별 단위를 의미합니다. 토큰 사용량은 모델에 따라 다르며, 하나의 토큰은 단어, 서브워드, 또는 한 글자일 수 있습니다. 대부분의 모델은 수백만 개의 토큰 단위로 과금됩니다.

최대 토큰 설정은 한 번의 상호작용 또는 요청에서 처리할 수 있는 토큰의 총량을 제한하여, 응답이 적절한 범위 내에서 생성되도록 합니다. 기본 제한은 4,000토큰으로, 문서나 여러 소스를 요약해 답변을 생성하기에 최적의 크기입니다.

온도는 답변의 다양성을 0~1 사이로 조절합니다.

0.1의 온도에서는 답변이 매우 간결하지만 반복적이고 부족할 수 있습니다.

1의 높은 온도는 최대한 창의적인 답변을 허용하지만, 무관하거나 비현실적인(헛소리) 답변이 나올 위험이 있습니다.

예를 들어, 고객센터 챗봇의 권장 온도는 0.2~0.5 사이입니다. 이 범위에서는 답변이 스크립트와 관련성을 유지하면서도 자연스러운 변화를 허용합니다.

이곳에서 모델을 선택할 수 있습니다. Meta AI에서 지원하는 모든 모델이 제공됩니다. Meta의 오픈소스 경량 Llama 모델을 지원하며, 이 모델들은 온디바이스 및 엣지 배포에 최적화되어 있습니다.

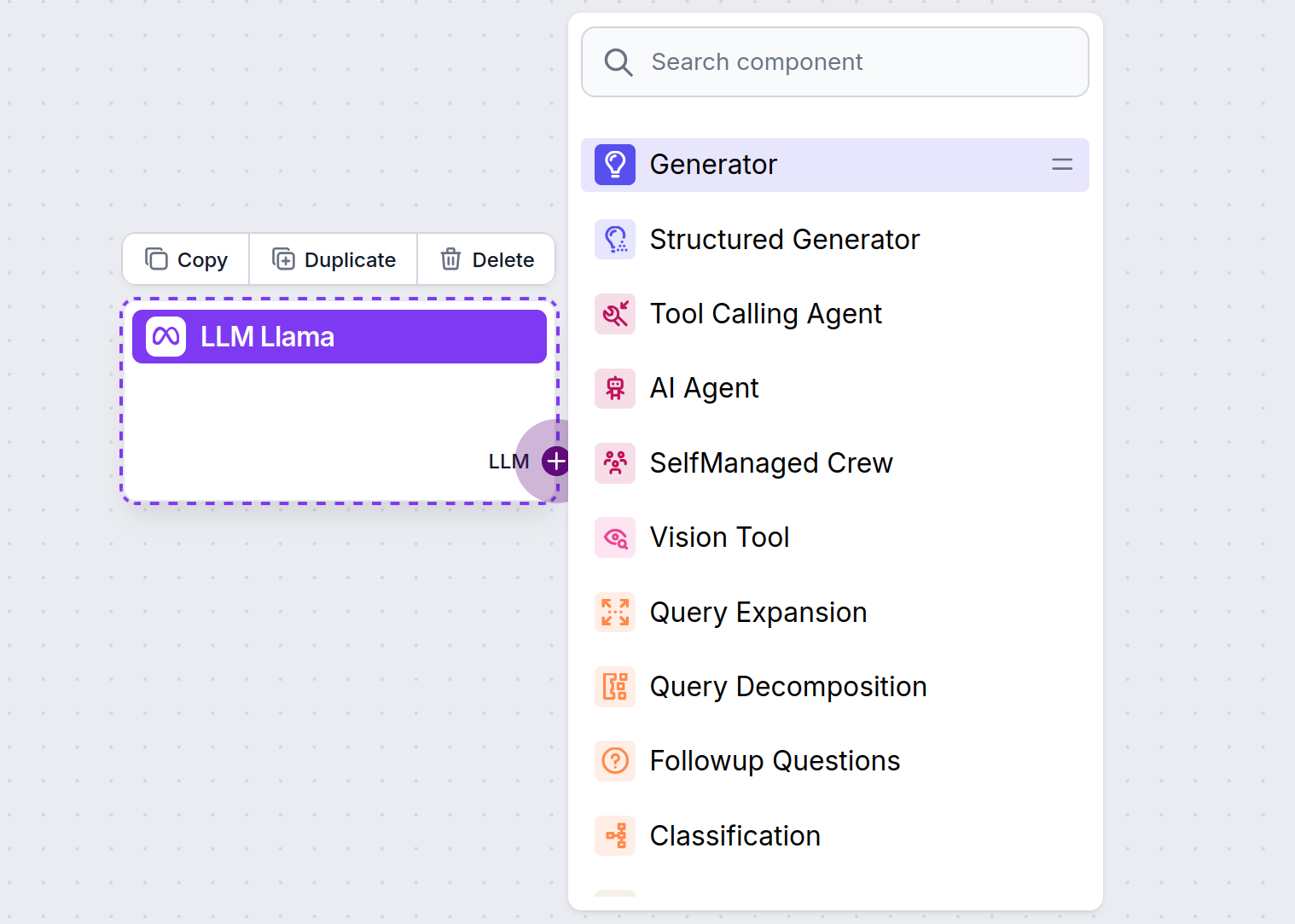

모든 LLM 컴포넌트에는 출력 핸들만 있다는 점을 알 수 있습니다. 입력은 컴포넌트를 통과하지 않으며, 이 컴포넌트는 모델 자체만을 나타내고 실제 생성은 AI Agent와 Generator에서 이루어집니다.

LLM 핸들은 항상 보라색입니다. LLM 입력 핸들은 텍스트 생성이나 데이터 처리에 AI를 사용하는 모든 컴포넌트에서 확인할 수 있습니다. 핸들을 클릭하면 옵션이 나타납니다:

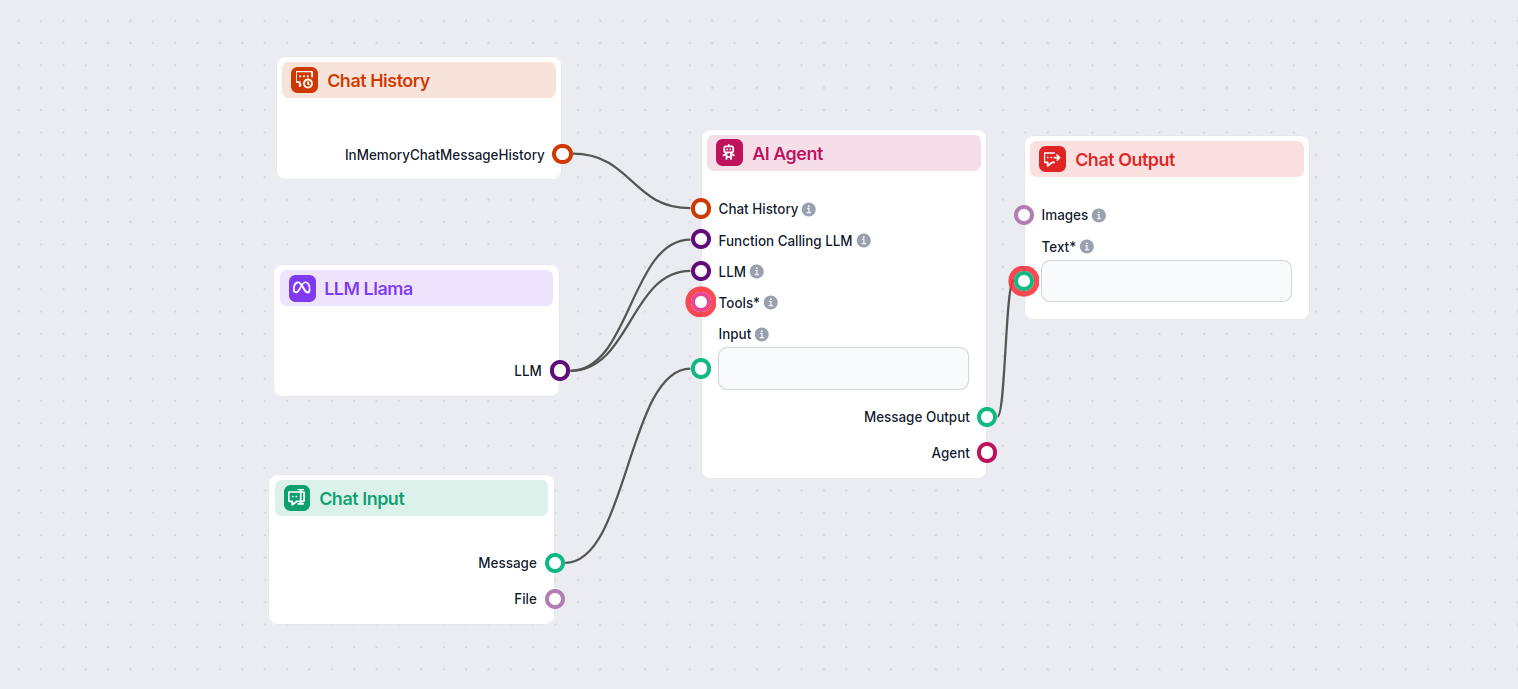

이로써 다양한 도구를 만들 수 있습니다. 실제 동작 예시를 살펴보겠습니다. 아래는 Meta AI의 Llama 3.2 1B를 활용해 응답을 생성하는 간단한 AI Agent 챗봇 플로우입니다. 기본적인 Llama 챗봇으로 생각하시면 됩니다.

이 간단한 챗봇 플로우는 다음을 포함합니다:

대형 언어 모델 메타 AI (LLaMA)는 Meta에서 개발한 최첨단 자연어 처리 모델입니다. 최대 650억 개의 파라미터를 보유한 LLaMA는 번역, 요약, 챗봇 등 다양한 작업에서 인간과 유사한 텍스트 이해 및 생성에 뛰어납니다....

FlowHunt의 LLM 컨텍스트를 통합하여 AI 지원 개발을 가속화하세요. 스마트 파일 선택, 고급 컨텍스트 관리, 직접적인 LLM 통합을 통해 관련 코드 및 문서 컨텍스트를 선호하는 대형 언어 모델 챗 인터페이스에 원활하게 주입할 수 있습니다....