LLM 메타 AI

FlowHunt는 Meta의 Llama 모델을 포함한 수십 개의 텍스트 생성 모델을 지원합니다. Llama를 AI 도구와 챗봇에 통합하고, 최대 토큰 및 온도와 같은 설정을 맞춤화하며, AI 기반 워크플로우를 간소화하는 방법을 알아보세요....

FlowHunt의 LLM Mistral은 고급 Mistral AI 모델을 챗봇 및 AI 도구에서 유연하게 통합하여 자연스러운 텍스트 생성을 제공합니다.

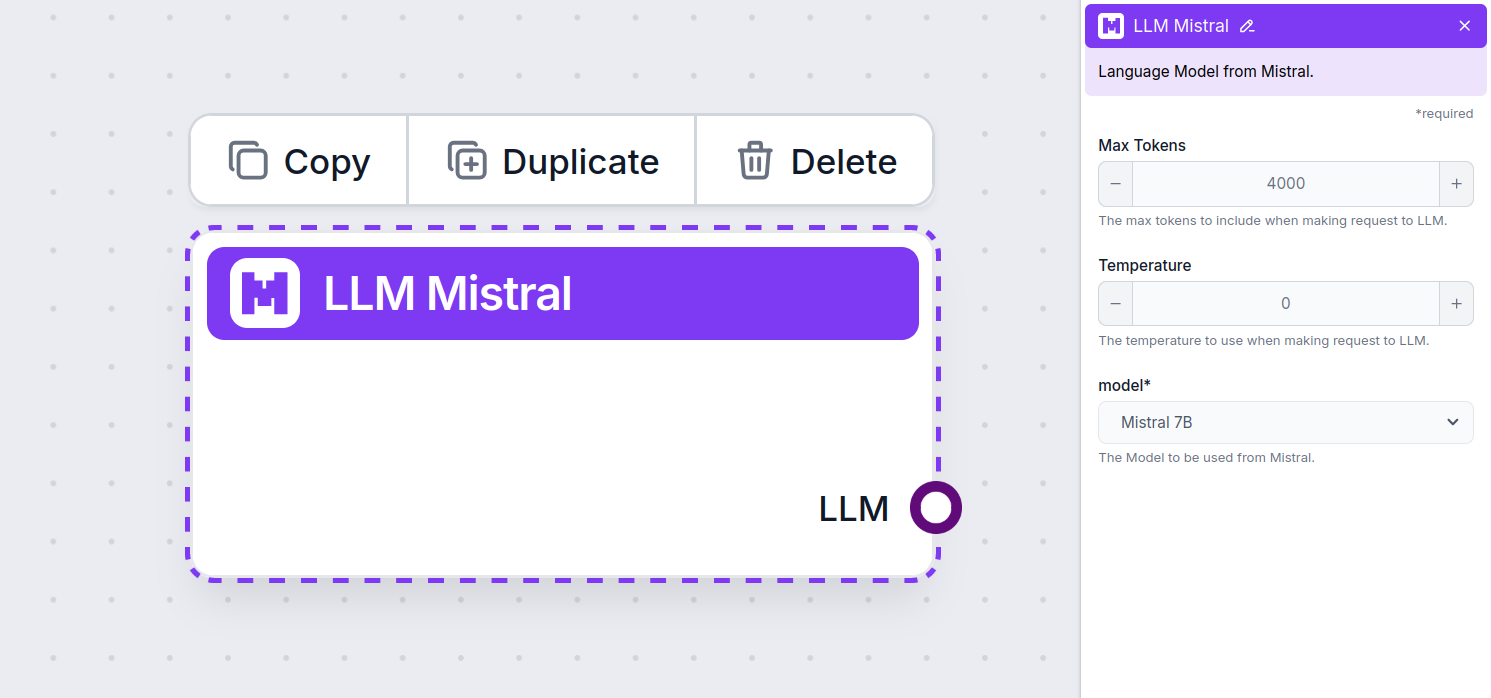

컴포넌트 설명

LLM 미스트랄 컴포넌트는 Mistral 모델을 플로우에 연결합니다. 실제 텍스트 생성은 제너레이터와 에이전트에서 이루어지지만, LLM 컴포넌트를 통해 사용할 모델을 직접 선택하고 제어할 수 있습니다. 모든 컴포넌트는 기본적으로 ChatGPT-4를 사용하며, 이 컴포넌트를 연결하면 모델을 변경하거나 더 세밀하게 제어할 수 있습니다.

LLM 컴포넌트 연결은 선택 사항임을 기억하세요. LLM을 사용하는 모든 컴포넌트는 기본값으로 ChatGPT-4o를 탑재하고 있습니다. LLM 컴포넌트는 모델 변경과 모델 설정 제어를 가능하게 합니다.

토큰은 모델이 처리하고 생성하는 텍스트의 개별 단위를 의미합니다. 토큰 사용량과 단위는 모델마다 다르며, 한 토큰은 단어, 서브워드, 혹은 문자 하나일 수 있습니다. 모델 요금은 일반적으로 수백만 토큰 단위로 책정됩니다.

최대 토큰 설정은 한 번의 요청 또는 상호작용에서 처리될 수 있는 토큰의 총량을 제한해, 응답이 적절한 범위를 넘지 않도록 보장합니다. 기본값은 4,000토큰이며, 이는 문서 요약이나 여러 자료의 답변 생성에 최적화된 크기입니다.

템퍼러처는 답변의 다양성과 창의성을 0에서 1까지 조절합니다.

0.1의 템퍼러처는 매우 간결하지만 반복적이고 단조로운 답변이 생성될 수 있습니다.

1의 높은 템퍼러처는 최대한 창의적인 답변을 허용하지만, 관련 없는 내용이나 환각(hallucination)이 발생할 위험도 커집니다.

예를 들어, 고객 응대 챗봇에는 0.2~0.5의 템퍼러처를 권장합니다. 이 범위는 답변을 스크립트에 맞게 유지하면서도 자연스러운 변화를 허용합니다.

여기서 원하는 Mistral 지원 모델을 선택할 수 있습니다. 현재 지원되는 모델은 다음과 같습니다.

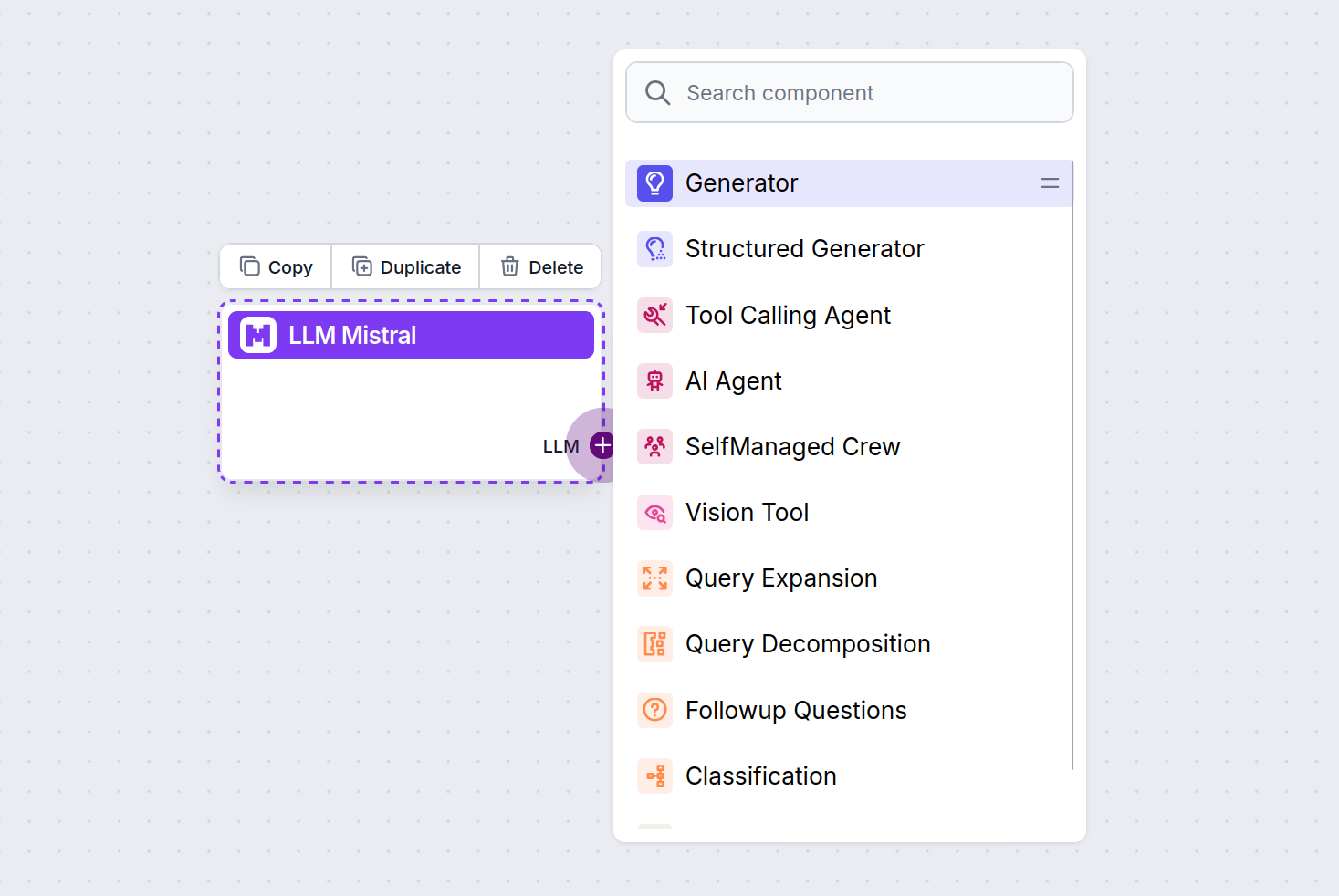

LLM 미스트랄을 플로우에 추가하는 방법

모든 LLM 컴포넌트에는 출력 핸들만 있다는 점을 알 수 있습니다. 입력은 이 컴포넌트를 통과하지 않으며, 해당 컴포넌트는 모델만 나타내고 실제 텍스트 생성은 AI 에이전트와 제너레이터에서 이루어집니다.

LLM 핸들은 항상 보라색입니다. LLM 입력 핸들은 AI가 텍스트를 생성하거나 데이터를 처리하는 모든 컴포넌트에 있습니다. 핸들을 클릭하면 연결 옵션을 볼 수 있습니다.

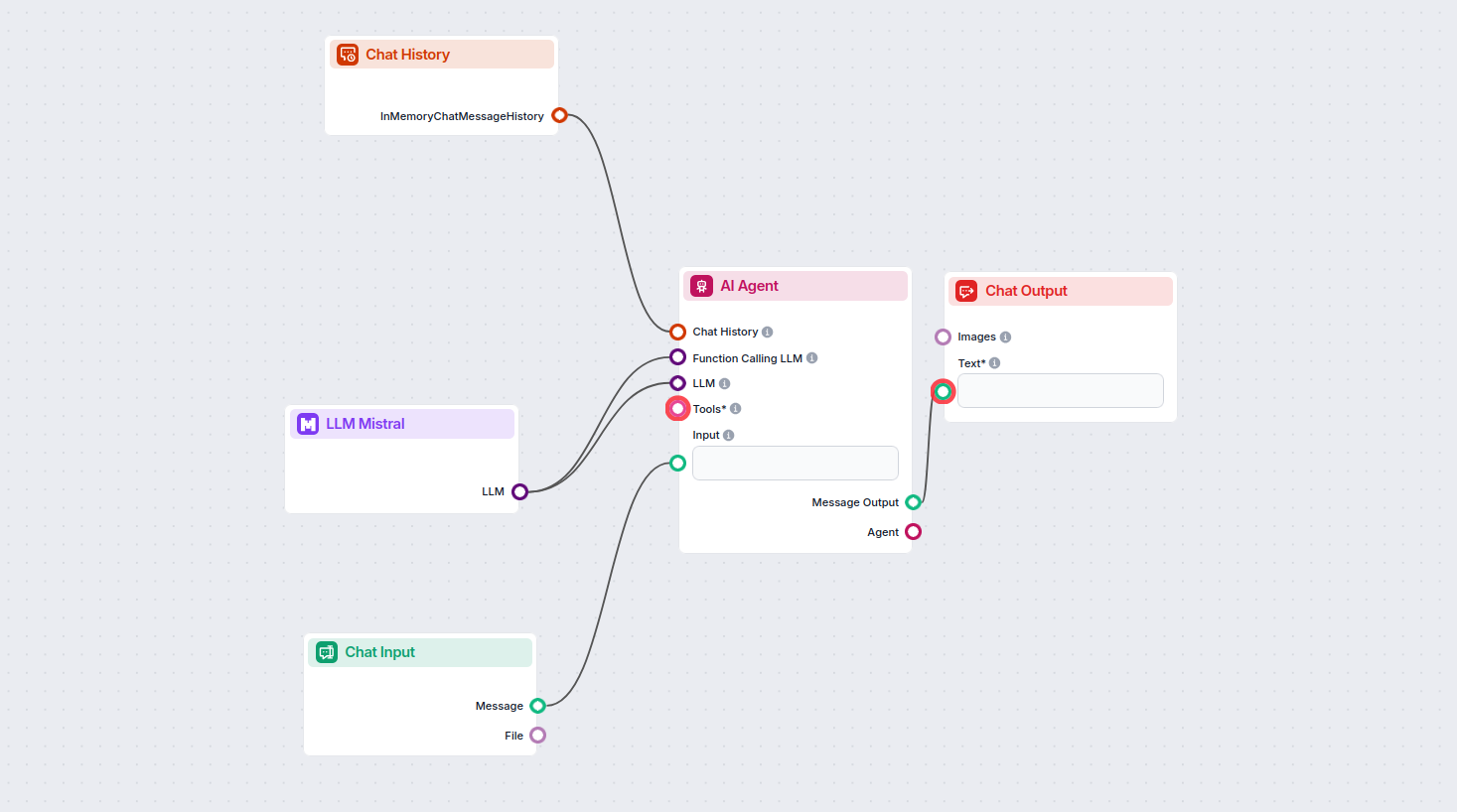

이를 통해 다양한 도구를 만들 수 있습니다. 실제 컴포넌트 활용 예시를 살펴보겠습니다. 아래는 Mistral 7B 모델을 사용하여 답변을 생성하는 간단한 AI 에이전트 챗봇 플로우입니다. 기본적인 Mistral 챗봇이라고 생각하시면 됩니다.

이 간단한 챗봇 플로우에는 다음 요소가 포함됩니다.

LLM 미스트랄 컴포넌트는 Mistral AI 모델을 FlowHunt 프로젝트에 연결하여 챗봇과 AI 에이전트에서 고급 텍스트 생성을 가능하게 합니다. 모델 교체, 설정 제어, Mistral 7B, Mixtral(8x7B), Mistral Large와 같은 모델의 통합이 가능합니다.

FlowHunt는 Mistral 7B, Mixtral(8x7B), Mistral Large를 지원하며, 각각 다양한 텍스트 생성 요구에 맞게 성능과 파라미터 수준이 다릅니다.

최대 토큰, 템퍼러처 등 다양한 설정을 조절할 수 있으며, 지원하는 Mistral 모델을 선택해 응답 길이, 창의성, 모델 동작을 직접 제어할 수 있습니다.

아니요, LLM 컴포넌트 연결은 필수가 아닙니다. 기본적으로 FlowHunt 컴포넌트는 ChatGPT-4o를 사용합니다. 더 세부적인 제어나 특정 Mistral 모델을 사용하고 싶을 때 LLM Mistral 컴포넌트를 이용하세요.

FlowHunt는 Meta의 Llama 모델을 포함한 수십 개의 텍스트 생성 모델을 지원합니다. Llama를 AI 도구와 챗봇에 통합하고, 최대 토큰 및 온도와 같은 설정을 맞춤화하며, AI 기반 워크플로우를 간소화하는 방법을 알아보세요....

FlowHunt는 혁신적인 DeepSeek 모델을 포함하여 수십 가지 AI 모델을 지원합니다. 이 글에서는 DeepSeek를 AI 도구와 챗봇에서 활용하는 방법을 안내합니다....

FlowHunt는 Claude를 비롯한 Anthropic의 다양한 AI 모델을 지원합니다. 맞춤화 가능한 설정을 통해 AI 도구와 챗봇에서 Claude를 활용하는 방법을 알아보세요....