장기 단기 메모리(LSTM)

장기 단기 메모리(Long Short-Term Memory, LSTM)는 순차 데이터의 장기 의존성을 학습하도록 설계된 특수한 종류의 순환 신경망(RNN) 아키텍처입니다. LSTM 네트워크는 메모리 셀과 게이팅 메커니즘을 활용하여 기울기 소실 문제를 해결하므로, 언어 모델링, 음성 인식...

양방향 장기 단기 메모리(BiLSTM)는 순차 데이터를 더 잘 이해하기 위해 특별히 설계된 고급 순환 신경망(RNN) 아키텍처입니다. 정보를 전방향과 역방향 모두에서 처리함으로써, BiLSTM은 감정 분석, 텍스트 분류, 기계 번역 등 자연어 처리(NLP) 작업에서 특히 효과적입니다.

이 구조는 시간 단계마다 두 개의 LSTM 레이어를 사용합니다. 한 레이어는 시퀀스를 처음부터 끝까지(전방향) 처리하고, 다른 한 레이어는 끝에서 처음까지(역방향) 처리합니다. 이러한 이중 레이어 접근 방식은 과거와 미래 상태의 맥락을 모두 포착하여, 시퀀스를 더 완벽하게 이해할 수 있게 해줍니다.

일반 LSTM에서는 과거 정보만을 활용하여 예측을 내립니다. 하지만 일부 작업에서는 과거와 미래의 정보를 모두 이해하는 것이 도움이 됩니다. 예를 들어, “He crashed the server.”라는 문장에서 “crashed”와 “the”라는 단어가 “server”가 컴퓨터 서버를 의미한다는 것을 명확히 하는 데 도움이 됩니다. BiLSTM 모델은 이 문장을 양방향으로 처리하여 맥락을 더 잘 파악할 수 있습니다.

양방향 LSTM(BiLSTM)은 순차 데이터를 전방향과 역방향 모두에서 처리하여, 과거와 미래의 맥락을 모두 포착함으로써 성능을 향상시키는 고급 순환 신경망(RNN) 아키텍처입니다.

양방향 LSTM은 감정 분석, 텍스트 분류, 기계 번역 등 자연어 처리(NLP) 작업뿐 아니라, 음성 인식과 유전체 서열 분석 등 생물정보학 분야에서도 널리 사용됩니다.

일반 LSTM은 데이터를 한 방향(과거에서 미래로)으로만 처리하지만, 양방향 LSTM은 데이터를 양방향으로 처리하여, 시퀀스 내의 앞과 뒤 맥락을 모두 활용할 수 있습니다.

장기 단기 메모리(Long Short-Term Memory, LSTM)는 순차 데이터의 장기 의존성을 학습하도록 설계된 특수한 종류의 순환 신경망(RNN) 아키텍처입니다. LSTM 네트워크는 메모리 셀과 게이팅 메커니즘을 활용하여 기울기 소실 문제를 해결하므로, 언어 모델링, 음성 인식...

인공지능(AI)에서의 연상 기억은 시스템이 패턴과 연관성을 바탕으로 정보를 회상할 수 있도록 하여 인간의 기억을 모방합니다. 이 기억 모델은 패턴 인식, 데이터 검색, 그리고 챗봇·자동화 도구 등 AI 애플리케이션에서 학습 능력을 향상시킵니다....

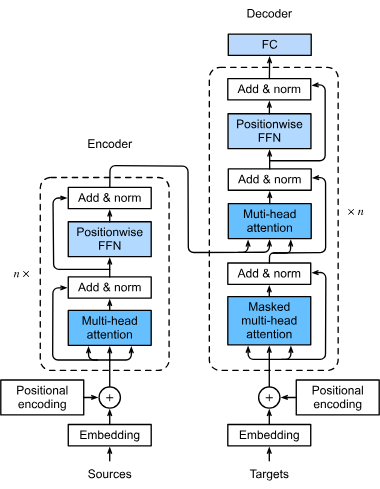

트랜스포머는 인공지능, 특히 자연어 처리 분야를 혁신적으로 변화시킨 신경망 아키텍처입니다. 2017년 'Attention is All You Need'에서 도입되어 효율적인 병렬 처리를 가능하게 했으며, BERT와 GPT와 같은 모델들의 기반이 되어 NLP, 비전 등 다양한 분야에 큰 ...