트랜스포머

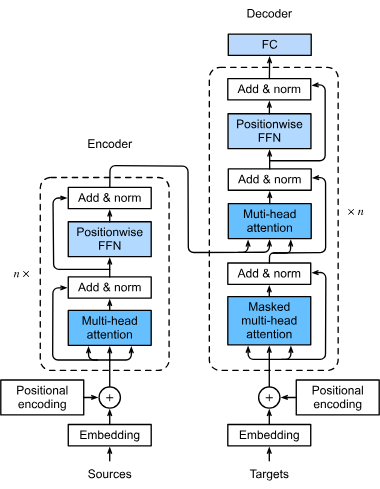

트랜스포머는 인공지능, 특히 자연어 처리 분야를 혁신적으로 변화시킨 신경망 아키텍처입니다. 2017년 'Attention is All You Need'에서 도입되어 효율적인 병렬 처리를 가능하게 했으며, BERT와 GPT와 같은 모델들의 기반이 되어 NLP, 비전 등 다양한 분야에 큰 ...

허깅페이스 트랜스포머는 다양한 머신러닝 분야에서 트랜스포머 모델 구현을 간소화하기 위해 설계된 선구적인 오픈소스 파이썬 라이브러리입니다. 이 모델들은 자연어 처리(NLP), 컴퓨터 비전, 오디오 처리 등 다양한 작업에서 우수한 성능으로 잘 알려져 있습니다. 라이브러리는 사용자가 수천 개의 사전 학습 모델에 접근할 수 있도록 하여, PyTorch, TensorFlow, JAX 등 복잡한 프레임워크에 대한 깊은 지식 없이도 최신 머신러닝 기능을 활용할 수 있게 합니다.

사전 학습 모델

허깅페이스 라이브러리는 다양한 작업에 맞춘 수많은 사전 학습 모델을 제공합니다. 이 모델들은 최소한의 설정만으로도 바로 사용할 수 있는 견고한 기반을 제공하며, 특정 데이터셋에 맞게 파인튜닝하여 애플리케이션의 성능을 높일 수 있습니다.

프레임워크 호환성

이 라이브러리는 PyTorch, TensorFlow, JAX와 같은 주요 머신러닝 프레임워크 간의 전환을 손쉽게 지원합니다. 이러한 호환성은 모델 학습과 추론에서 유연성을 보장하며, 개발자가 선호하는 도구와 환경을 자유롭게 선택할 수 있게 합니다.

멀티모달 지원

허깅페이스 트랜스포머의 범용성은 텍스트 처리를 넘어 컴퓨터 비전과 오디오 작업까지 확장됩니다. 이미지 분류, 음성 인식 등 다양한 응용이 가능하며, 다양한 데이터 타입을 처리해야 하는 종합 솔루션 개발에 필수적입니다.

사용의 용이성

사용자 친화적인 API를 제공하여 머신러닝에 익숙하지 않은 사람도 쉽게 시작할 수 있습니다. pipeline 추상화는 흔한 작업을 간소화하고, AutoModel과 AutoTokenizer는 고급 사용자가 모델 선택과 커스터마이징을 세밀하게 제어할 수 있도록 지원합니다.

커뮤니티와 허브

허깅페이스 허브는 협업을 위한 활기찬 플랫폼으로, 모델, 데이터셋, 아이디어를 공유할 수 있습니다. 커뮤니티 중심의 접근 방식은 혁신을 촉진하고, 머신러닝 실무자들에게 방대한 모델과 데이터셋을 제공하는 중앙 리소스로 기능합니다.

자연어 처리(NLP):

허깅페이스 트랜스포머는 텍스트 분류, 감성 분석, 질의응답, 개체명 인식, 언어 번역 등 NLP 작업에서 탁월한 성능을 보입니다. BERT, GPT와 같은 모델은 인간 언어를 이해하고 생성하는 다양한 애플리케이션에 널리 활용됩니다.

컴퓨터 비전:

이 라이브러리는 DETR, Vision Transformer(ViT) 등 모델을 활용한 이미지 분류, 객체 탐지와 같은 이미지 관련 작업도 지원합니다. 의료 영상 분석(헬스케어)이나 얼굴 인식(보안) 등 다양한 산업에 적용할 수 있습니다.

오디오 처리:

자동 음성 인식, 오디오 분류 등 작업에 대한 지원으로, 음성 비서나 녹취 서비스 등 음성 기반 애플리케이션 개발에 중요한 역할을 합니다.

멀티모달 애플리케이션:

여러 데이터 타입을 통합하는 모델 지원을 통해 시각적 질의응답 등 고도화된 작업이 가능하며, 교육 도구나 인터랙티브 미디어 분야에 적용할 수 있습니다.

허깅페이스 트랜스포머는 다양한 기술과의 통합을 통해 기능을 확장할 수 있습니다:

클라우드 서비스:

Amazon SageMaker, Google Cloud와 같은 플랫폼은 대규모 데이터셋 처리와 복잡한 연산을 위한 확장성 높은 인프라를 제공하여 트랜스포머 모델의 배포를 용이하게 합니다.

추론 가속화:bitsandbytes, accelerate 라이브러리는 AWS Inferentia, Google TPU와 같은 특수 하드웨어에서 모델 추론을 최적화하여 지연 시간을 줄이고 성능을 향상시킵니다.

보조 라이브러리:

대규모 데이터 처리를 위한 datasets, 모델 성능 추적을 위한 evaluate, 웹 애플리케이션 배포를 위한 transformer.js 등과도 원활하게 연동됩니다.

허깅페이스 트랜스포머의 실용적인 예로 챗봇 개발을 들 수 있습니다. BERT나 GPT와 같은 모델을 도메인 특화 데이터에 파인튜닝하여, 정확하고 상황에 맞는 답변을 제공하는 챗봇을 개발할 수 있으며, 이는 고객 서비스 등에서 사용자 경험을 크게 향상시킵니다.

허깅페이스 트랜스포머는 최신 트랜스포머 아키텍처에 집중하여 강력한 머신러닝 모델 구축 및 배포를 지원하는 인기 오픈소스 라이브러리입니다. 이 라이브러리는 자연어 처리, 컴퓨터 비전 등 다양한 응용 분야에서의 활용성과 사용 편의성 덕분에 인공지능 커뮤니티에서 큰 주목을 받고 있습니다.

최근 연구 하이라이트:

The last Dance: Robust backdoor attack via diffusion models and Bayesian approach (Orson Mengara, 2024)

이 논문은 허깅페이스 트랜스포머 모델의 백도어 공격 취약성을 다룹니다. 오디오 트랜스포머에 백도어 디퓨전 샘플링과 베이지안 접근법을 적용하여 이러한 공격의 가능성을 입증하며, AI 프레임워크의 보안 문제를 부각시킵니다.

더 알아보기

Harnessing the Power of Hugging Face Transformers for Predicting Mental Health Disorders in Social Networks (Alireza Pourkeyvan 외, 2023)

본 연구는 허깅페이스의 사전 학습 언어 모델을 활용해 소셜 미디어 데이터를 기반으로 정신 질환을 예측하는 방법을 조사합니다. 해당 모델들이 기존 기법을 뛰어넘는 최대 97%의 정확도를 달성하여, 소셜 미디어 데이터가 정신 건강 선별에 유용할 수 있음을 시사합니다.

더 알아보기

Leveraging open-source models for legal language modeling and analysis: a case study on the Indian constitution (Vikhyath Gupta, Srinivasa Rao P, 2024)

이 논문은 허깅페이스 모델을 활용한 법률 언어 모델링의 혁신적인 접근을 제시합니다. 저자들은 이러한 모델이 법률 문서 요약 및 분석에 효과적임을 보여주며, 법률 연구 및 판례 예측 분야에 혁신을 가져올 수 있음을 시사합니다.

더 알아보기

허깅페이스 트랜스포머는 자연어 처리, 컴퓨터 비전, 오디오 처리 작업을 위한 최신 트랜스포머 모델의 구현과 배포를 간소화하는 오픈소스 파이썬 라이브러리입니다.

주요 특징으로는 수천 개의 사전 학습 모델 제공, PyTorch, TensorFlow, JAX와의 프레임워크 호환성, 텍스트·비전·오디오를 아우르는 멀티모달 지원, 사용자 친화적 API, 그리고 협업이 가능한 모델 허브가 있습니다.

대표적인 활용 사례로는 텍스트 분류, 감성 분석, 질의응답, 이미지 분류, 객체 탐지, 음성 인식, 챗봇 구축 등이 있습니다.

AWS SageMaker, Google Cloud와 같은 클라우드 서비스와 통합되며, 데이터 핸들링 및 모델 추적을 위한 datasets, evaluate 같은 라이브러리와 추론 가속화 도구도 지원합니다.

네, 허깅페이스 트랜스포머는 컴퓨터 비전과 오디오 처리도 지원하여 이미지 분류, 객체 탐지, 자동 음성 인식과 같은 작업에도 활용할 수 있습니다.

트랜스포머는 인공지능, 특히 자연어 처리 분야를 혁신적으로 변화시킨 신경망 아키텍처입니다. 2017년 'Attention is All You Need'에서 도입되어 효율적인 병렬 처리를 가능하게 했으며, BERT와 GPT와 같은 모델들의 기반이 되어 NLP, 비전 등 다양한 분야에 큰 ...

AllenNLP는 AI2에서 개발한 강력한 오픈소스 자연어 처리(NLP) 연구용 라이브러리로, PyTorch 기반으로 구축되었습니다. 모듈형 확장 도구, 사전 학습된 모델, spaCy 및 Hugging Face와 같은 라이브러리와의 손쉬운 통합을 제공하며, 텍스트 분류, 지시 대명사 해...

트랜스포머 모델은 텍스트, 음성, 시계열 데이터와 같은 순차 데이터를 처리하도록 특별히 설계된 신경망입니다. 기존의 RNN, CNN과 달리 트랜스포머는 어텐션 메커니즘을 활용하여 입력 시퀀스의 요소별 중요도를 가중치로 반영하며, 이를 통해 NLP, 음성 인식, 유전체학 등 다양한 분야에...